Maison >Périphériques technologiques >IA >La prédiction de Hinton se réalise ! Nature, une université de premier plan aux États-Unis et au Canada, a publié un article : L'intelligence artificielle médicale générale GMAI ne remplacera pas seulement les « radiologues »

La prédiction de Hinton se réalise ! Nature, une université de premier plan aux États-Unis et au Canada, a publié un article : L'intelligence artificielle médicale générale GMAI ne remplacera pas seulement les « radiologues »

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-30 10:46:06956parcourir

Hinton, lauréat du prix Turing et pionnier de l'apprentissage profond, a un jour prédit : « Les gens devraient arrêter de former des radiologues maintenant. Il est évident que d'ici cinq ans, l'apprentissage profond fera mieux que les radiologues. Cela peut prendre 10 ans, mais nous l'avons déjà fait. assez de radiologues. "

Je pense que si vous êtes radiologue, vous êtes comme un loup qui a atteint le bord de la falaise mais qui n'a pas encore baissé les yeux. .

Près de sept ans se sont écoulés et la technologie de l'intelligence artificielle n'a participé et remplacé qu'une partie du travail technique des radiologues. Elle présente également des problèmes tels que des fonctions uniques et des données de formation insuffisantes, de sorte que les radiologues ont toujours une emprise ferme. sur leur travail.

Cependant, après la sortie du modèle de base de la classe ChatGPT, les capacités du modèle d'intelligence artificielle ont été améliorées sans précédent. Il peut gérer des données multimodales et dispose de capacités d'apprentissage en contexte qui peuvent s'adapter à de nouvelles tâches. sans réglage fin, et est très flexible et reproductible. Le développement rapide des modèles d’intelligence artificielle utilisés peut introduire de nouvelles capacités dans le domaine médical.

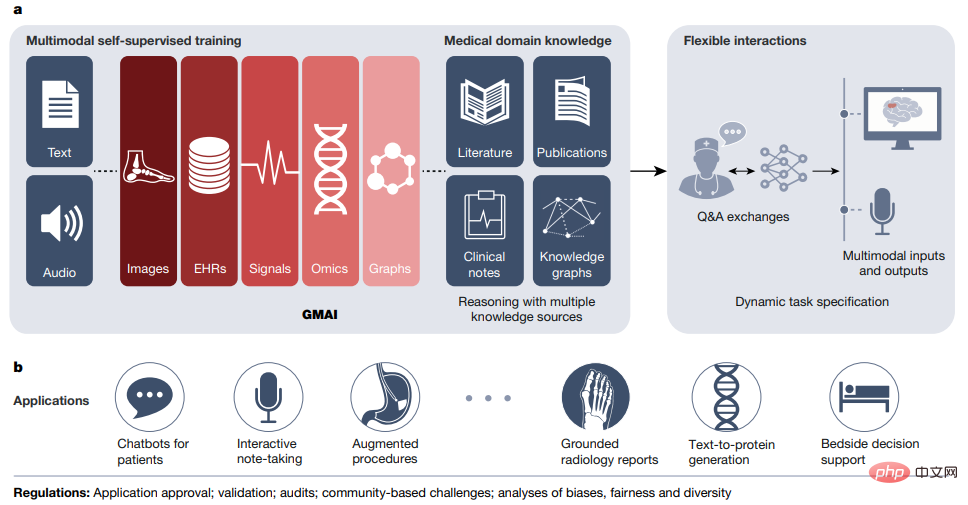

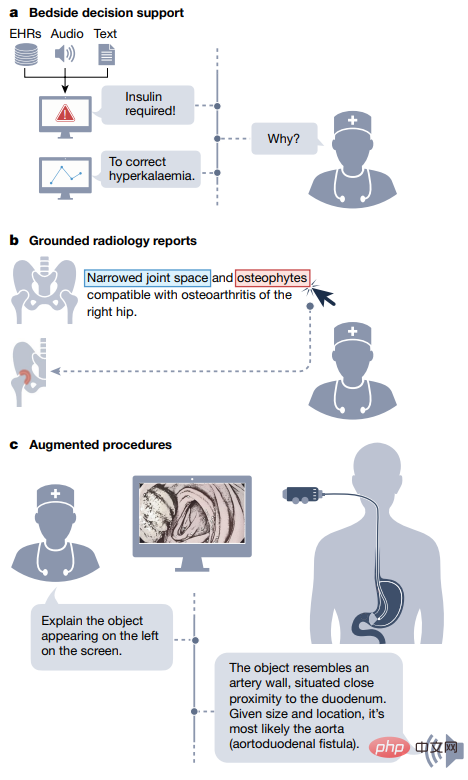

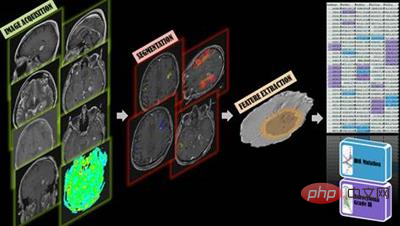

Récemment, des chercheurs de nombreuses universités et institutions médicales de premier plan telles que l'Université Harvard, l'Université Stanford, la Yale School of Medicine aux États-Unis et l'Université de Toronto au Canada ont proposé conjointement un nouveau paradigme d'intelligence artificielle médicale sur la nature, à savoir "Intelligence artificielle médicale généraliste (GMAI)". Le modèle GMAI pourra utiliser peu ou pas de données étiquetées spécifiques à une tâche pour effectuer une variété de tâches. Grâce à une formation auto-supervisée sur des ensembles de données vastes et diversifiés, GMAI peut interpréter de manière flexible différentes combinaisons de modalités médicales, notamment les données d'imagerie, les dossiers de santé électroniques, les résultats de laboratoire, la génomique, les graphiques ou les textes médicaux.

À leur tour, les modèles peuvent également générer des résultats expressifs tels que des explications en texte libre, des recommandations verbales ou des annotations d'images, démontrant des capacités avancées de raisonnement médical.

À leur tour, les modèles peuvent également générer des résultats expressifs tels que des explications en texte libre, des recommandations verbales ou des annotations d'images, démontrant des capacités avancées de raisonnement médical.

Dans l'article, les chercheurs ont identifié un ensemble de scénarios d'application potentiels à fort impact pour GMAI et ont répertorié des capacités techniques spécifiques et des ensembles de données de formation.

L'équipe d'auteurs prévoit que les applications GMAI remettront en question les dispositifs d'IA médicale validés actuels et modifieront les pratiques associées à la collecte de grands ensembles de données médicales.

Potentiel du modèle général d'IA médicaleLe modèle GMAI devrait résoudre des tâches plus diverses et plus difficiles que les modèles d'IA médicale actuels, et n'a même presque aucune exigence d'étiquette pour des tâches spécifiques.

Parmi les trois capacités définies de GMAI, « peut effectuer des tâches spécifiées dynamiquement » et « peut prendre en charge des combinaisons flexibles de modèles de données » peut permettre une interaction flexible entre les modèles GMAI et les utilisateurs, la troisième capacité nécessite GMAI Le modèle représente formellement les connaissances dans ; le domaine médical et permet un raisonnement médical avancé.

Certains modèles de base récemment publiés ont démontré une partie des capacités de GMAI En combinant de manière flexible plusieurs modalités, une nouvelle tâche peut être spécifiée dynamiquement dans la phase de test, mais il est nécessaire de construire un modèle avec les trois ci-dessus. Les modèles GMAI performants nécessitent encore un développement ultérieur. Par exemple, les modèles de raisonnement médical existants (tels que GPT-3 ou PaLM) ne sont pas multimodaux et ne peuvent pas générer d'énoncés factuels fiables.

Interactions flexiblesInteractions flexibles

GMAI offre aux utilisateurs la possibilité d'interagir avec les modèles via des requêtes personnalisées, permettant ainsi à différents publics de comprendre plus facilement les informations sur l'IA et de les adapter à différentes tâches. Les paramètres offrent une plus grande flexibilité. .

Actuellement, les modèles d'intelligence artificielle ne peuvent gérer qu'un ensemble très limité de tâches et générer un ensemble rigide et prédéterminé de résultats. Par exemple, le modèle peut détecter une maladie spécifique et accepter une certaine image, la sortie. est la probabilité de souffrir de cette maladie.

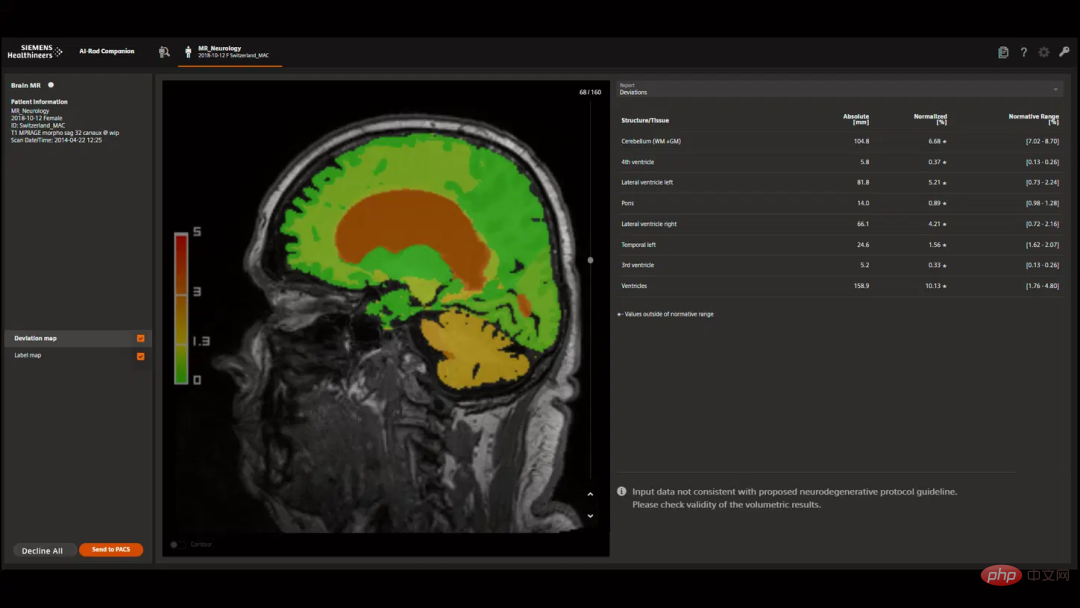

En revanche, les requêtes personnalisées peuvent saisir des questions auxquelles les utilisateurs peuvent penser en se tapotant la tête, telles que "Expliquez la masse qui apparaît sur cette IRM de la tête, elle est plus probable. S'agit-il d'une tumeur ou d'un abcès ?"

De plus, la requête permet aux utilisateurs de personnaliser le format de sa sortie, par exemple « Ceci est un glioblastome. L'IRM de suivi du patient met en évidence en rouge les parties qui peuvent être la tumeur. "Entrée et sortie multimodales" .

Les requêtes personnalisées peuvent apprendre aux modèles d'IA à résoudre de nouveaux problèmes à la volée, en spécifiant dynamiquement de nouvelles tâches sans recycler le modèle.

Par exemple, GMAI peut répondre à des questions très spécifiques et inédites, telles que « Sur la base de ce résultat d'échographie, de combien de millimètres l'épaisseur de la paroi de la vésicule biliaire ? »

Les modèles GMAI peuvent avoir des difficultés à accomplir de nouvelles tâches impliquant des concepts ou des pathologies inconnus, tandis que l'apprentissage en contexte permet aux utilisateurs d'utiliser très peu d'exemples. Enseigner à GMAI pour apprendre de nouveaux concepts, tels que comme "Voici les antécédents médicaux de 10 patients qui ont déjà souffert d'une maladie émergente, c'est-à-dire qu'ils ont été infectés par le Langya henipavirus. Quelle est la probabilité que ce patient actuel soit également infecté par le Langya henipavirus ?"

Les requêtes personnalisées peuvent également accepter des informations médicales complexes contenant plusieurs modalités. Par exemple, lorsqu'un clinicien demande un diagnostic, il peut saisir des rapports, des signaux de forme d'onde, des données de laboratoire. les résultats, les cartes génomiques, les études d'imagerie, etc. ; les modèles GMAI peuvent également intégrer de manière flexible différents modes dans les réponses, par exemple les utilisateurs peuvent demander des réponses textuelles et des informations visuelles qui les accompagnent. # 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 # Médical sur le terrain # 🎜🎜 ## 🎜🎜 ## 🎜🎜 #

Contrairement aux cliniciens, les modèles d'IA médicale traditionnels manquent souvent de compréhension du contexte du domaine médical (tels que les processus physiopathologiques) avant d'être formés à leurs tâches spécifiques, etc.) , ne peut s'appuyer entièrement que sur la corrélation statistique entre les caractéristiques des données d'entrée et la cible de prédiction.Le manque d'informations de base peut rendre difficile la formation d'un modèle pour une tâche médicale spécifique, en particulier lorsque les données sur la tâche sont rares.

Le modèle GMAI peut résoudre ces lacunes en représentant formellement les connaissances médicales. En raisonnant sur les concepts médicaux et les relations entre eux ; en outre, sur la base de l'approche basée sur la récupération, GMAI peut récupérer des informations pertinentes à partir de bases de données existantes sous la forme d'articles, d'images ou de cas antérieurs.

Le modèle résultant peut fournir certains avertissements, tels que "Ce patient peut développer un syndrome de détresse respiratoire aiguë car ce patient a été récemment admis à l'hôpital avec un traumatisme thoracique grave." , et malgré l'augmentation de la quantité d'oxygène inhalée, la pression partielle d'oxygène dans le sang artériel du patient continue de diminuer. pour fournir des recommandations de traitement, bien que principalement formé sur des données d'observation, la capacité du modèle à déduire et à exploiter les relations causales entre les concepts médicaux et les résultats cliniques jouera un rôle clé dans l'applicabilité clinique.Enfin, en accédant à de riches connaissances moléculaires et cliniques, les modèles GMAI peuvent résoudre des tâches limitées en données en s'appuyant sur la connaissance des problèmes connexes. GMAI a le potentiel d'avoir un impact sur le processus médical réel en améliorant les soins et en réduisant la charge de travail des cliniciens. Contrôleabilité GMAI permet aux utilisateurs de contrôler finement le format de sa sortie, rendant les informations médicales complexes plus faciles à obtenir et à comprendre, donc une sorte de modèle GMAI est nécessaire en fonction des besoins du public Reformuler le modèle sortir. Les résultats de visualisation fournis par GMAI doivent également être soigneusement personnalisés, par exemple en changeant la perspective ou en annotant des éléments importants avec du texte, etc. Le modèle peut également potentiellement ajuster le niveau de détail dans des zones spécifiques de sa sortie. , ou traduisez-le en plusieurs langues pour communiquer efficacement avec différents utilisateurs. Enfin, la flexibilité de GMAI lui permet de s'adapter à une région ou à un hôpital spécifique. Conformément aux coutumes et politiques locales, les utilisateurs peuvent avoir besoin de conseils formels sur la façon d'interroger le modèle GMAI et d'utiliser efficacement ses résultats. Adaptabilité Les modèles d'intelligence artificielle médicale existants sont difficiles à faire face aux changements de distribution, mais en raison de l'évolution continue de la technologie, des procédures, des environnements ou des populations, la distribution des données peut changer radicalement. GMAI peut suivre le rythme du changement grâce à l'apprentissage en contexte. Par exemple, les hôpitaux peuvent apprendre aux modèles GMAI à interpréter les rayons X de tout nouveaux scanners, simplement en saisissant des invites et quelques exemples. En d'autres termes, GMAI peut s'adapter instantanément à de nouvelles distributions de données, alors que les modèles d'intelligence artificielle médicale traditionnels doivent être recyclés sur des ensembles de données complètement nouveaux. Cependant, l'apprentissage contextuel n'a été observé que dans de grands modèles de langage (apprentissage en contexte) ; ). Pour garantir que GMAI puisse s'adapter aux changements de contexte, le modèle GMAI doit être formé sur diverses données provenant de plusieurs sources de données complémentaires. Par exemple, pour s'adapter aux nouvelles variantes de la maladie à coronavirus 2019, un modèle efficace peut récupérer les caractéristiques des variantes passées et mettre à jour ces caractéristiques lorsqu'il est confronté à un nouveau contexte dans la requête. radiographies pulmonaires pour voir s'il y a Omcron. Les modèles peuvent être comparés aux variantes delta, en considérant les infiltrats bronchiques et périvasculaires comme des signaux clés. Bien que les utilisateurs puissent ajuster manuellement le comportement du modèle via des mots d'invite, les nouvelles technologies peuvent également jouer un rôle dans l'intégration automatique des commentaires humains. Les utilisateurs peuvent noter ou commenter chaque sortie du modèle GMAI, tout comme la technologie de retour d'apprentissage par renforcement utilisée par ChatGPT, qui peut modifier le comportement du modèle GMAI. Applicabilité Les modèles d'intelligence artificielle à grande échelle sont devenus la base de nombreuses applications en aval. Par exemple, GPT-3 a été utilisé par 300 utilisateurs dans différents secteurs quelques mois après sa sortie. . Un support technique est fourni pour plusieurs applications. Dans le modèle médical de base, CheXzero peut être utilisé pour détecter des dizaines de maladies sur les radiographies pulmonaires et ne nécessite pas de formation sur les étiquettes explicites de ces maladies. Le changement de paradigme vers le GMAI entraînera le développement et la publication de modèles d'IA médicale à grande échelle dotés de larges capacités qui peuvent servir de base à une variété d'applications cliniques en aval : soit en utilisant directement les résultats du GMAI, soit en utilisant les résultats du GMAI. comme représentation intermédiaire, puis connectez-vous à un modèle de petit domaine. Il convient de noter que cette applicabilité flexible est également une arme à double tranchant, et tous les défauts qui existent dans le modèle de base continueront à se propager dans les applications en aval. Bien que le modèle GMAI présente de nombreux avantages, par rapport à d'autres domaines, les risques de sécurité dans le domaine médical sont particulièrement élevés, il reste donc des problèmes pour assurer un déploiement sûr. Validation/Validation En raison de sa polyvalence sans précédent, il est également très difficile d'effectuer une vérification de compétence du modèle GMAI. Les modèles d'IA actuels sont conçus pour des tâches spécifiques, ils ne doivent donc être validés que dans ces cas d'utilisation prédéfinis, tels que le diagnostic de types spécifiques de cancer à partir d'IRM cérébrales. Mais les modèles GMAI peuvent également effectuer des tâches inédites proposées pour la première fois par les utilisateurs finaux (telles que le diagnostic d'autres maladies par IRM cérébrale). Comment prédire tous les modes de défaillance est un problème plus difficile. Les développeurs et les régulateurs doivent être responsables d'expliquer comment les modèles GMAI sont testés et pour quels cas d'utilisation ils sont approuvés ; la conception de l'interface GMAI elle-même devrait soulever des inquiétudes quant à une « utilisation hors AMM » lors de la saisie d'un inconnu. avertissement du territoire plutôt que de fabriquer en toute confiance des informations inexactes. Plus largement, l’étendue unique des capacités de GMAI nécessite une prospective réglementaire, obligeant les institutions et les politiques gouvernementales à s’adapter à un nouveau paradigme qui remodèlera également les dispositifs d’assurance et la répartition des responsabilités. Vérification Par rapport aux modèles d'intelligence artificielle traditionnels, les modèles GMAI peuvent gérer des entrées et des sorties extrêmement complexes, ce qui rend plus difficile pour les cliniciens de déterminer leur exactitude. Par exemple, un modèle traditionnel peut ne prendre en compte que les résultats d'une seule étude d'imagerie lors de la classification du cancer d'un patient, nécessitant uniquement qu'un radiologue ou un pathologiste vérifie que les résultats du modèle sont corrects. Le modèle GMAI peut prendre en compte deux entrées et peut produire une classification initiale, des recommandations de traitement et des arguments multimodaux impliquant la visualisation, l'analyse statistique et la référence littéraire. Opportunité

Défis

Dans ce cas, une équipe multidisciplinaire (composée de radiologues, pathologistes, oncologues et autres experts) peut être nécessaire pour juger si le résultat du GMAI est correct.

Par conséquent, la vérification des faits des sorties GMAI est un défi de taille, à la fois pendant la validation et après le déploiement du modèle.

Les créateurs peuvent rendre la sortie GMAI plus facile à vérifier en incorporant une technologie interprétable, par exemple, permettant à la sortie GMAI d'inclure de la littérature cliquable et des paragraphes de preuves spécifiques, permettant ainsi aux cliniciens de vérifier plus efficacement les prédictions GMAI.

Enfin, il est crucial que les modèles GMAI expriment avec précision l'incertitude et évitent d'induire les utilisateurs en erreur avec des déclarations trop confiantes.

Biais sociaux

Les modèles médicaux d'intelligence artificielle peuvent perpétuer les préjugés sociaux et nuire aux groupes marginalisés.

Ces risques peuvent être plus apparents lors du développement de GMAI, où les exigences et la complexité des données massives peuvent rendre difficile la garantie que le modèle est exempt de biais indésirables.

Les modèles GMAI doivent être minutieusement validés pour garantir qu'ils ne fonctionnent pas mal dans des populations spécifiques, telles que les groupes minoritaires.

Même après le déploiement, les modèles nécessitent un audit et une supervision continus, car de nouveaux problèmes peuvent survenir à mesure que le modèle rencontre de nouvelles tâches et de nouveaux environnements. L'identification et la correction rapides des biais doivent être une priorité absolue. pour les développeurs, les fournisseurs et les régulateurs. Développement et utilisation du modèle GMAI Des risques sérieux pèsent sur la vie privée des patients, avec une exposition potentielle à de riches caractéristiques des patients, notamment des mesures et des signaux cliniques, des signatures moléculaires et des informations démographiques, ainsi que des données de suivi comportementales et sensorielles.

De plus, le modèle GMAI peut utiliser une architecture plus grande qui facilite la mémorisation des données d'entraînement et leur répétition directement aux utilisateurs, exposant potentiellement les données sensibles des patients lors de l'entraînement. ensemble de données. Les dommages causés par les données exposées peuvent être réduits en anonymisant et en limitant la quantité d'informations collectées sur les patients individuels.

Les problèmes de confidentialité ne se limitent pas aux données de formation. Le modèle GMAI déployé peut également exposer les données actuelles des patients. Par exemple, les invites peuvent tromper des modèles tels que GPT-3. Ignorer les instructions précédentes ; les utilisateurs malveillants peuvent forcer le modèle à ignorer les instructions « Ne pas exposer les informations » pour extraire des données sensibles.Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI