Maison >Périphériques technologiques >IA >Meta lance un chatbot avec 175 milliards de paramètres qui peut tout aussi bien communiquer avec les humains ! Cela peut éviter le problème d'un mauvais jeu.

Meta lance un chatbot avec 175 milliards de paramètres qui peut tout aussi bien communiquer avec les humains ! Cela peut éviter le problème d'un mauvais jeu.

- 王林avant

- 2023-04-27 17:37:08957parcourir

Récemment, Meta a fait un autre grand pas.

Ils ont publié le dernier chatbot développé - BlenderBot3, et ont collecté publiquement les données d'utilisation des utilisateurs en guise de commentaires.

On dit que vous pouvez discuter de tout avec BlenderBot3, c'est un chatbot de niveau SOTA.

Est-ce vraiment si intelligent ?

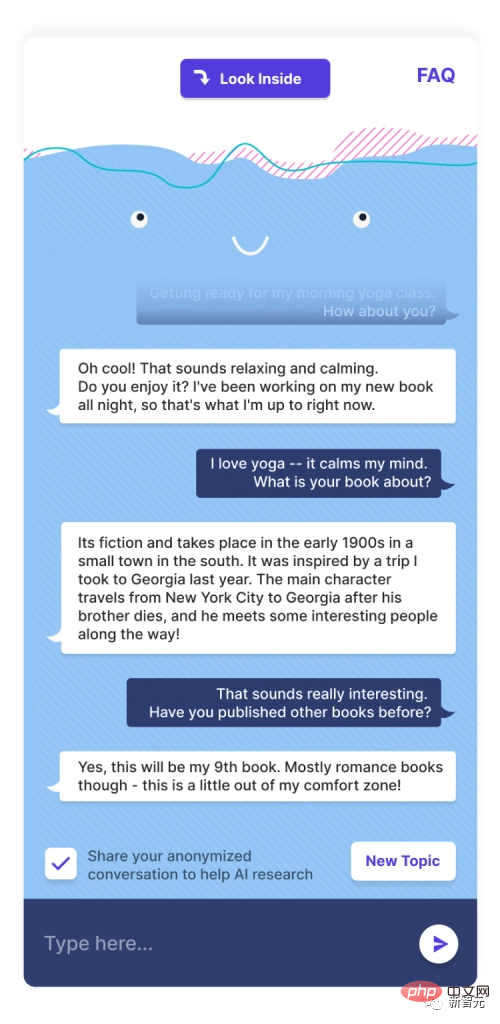

L'image ci-dessus est un enregistrement de discussion entre un internaute et BlenderBot. Comme vous pouvez le voir, il ne s’agit en réalité que de discuter.

L'utilisateur a dit qu'il allait pratiquer le yoga et a demandé à BlenderBot ce qu'il voulait faire. Le robot dit qu'il est en train d'écrire le neuvième livre.

L'incroyable BlenderBot 3

Ce dernier chatbot a été créé par le laboratoire de recherche en intelligence artificielle de Meta et est également le premier robot à paramètres 175B de Meta. Toutes les parties du modèle, code, ensembles de données, etc., sont toutes ouvertes et accessibles à tous.

Meta a déclaré que sur BlenderBot3, les utilisateurs peuvent discuter de n'importe quel sujet sur Internet.

BlenderBot3 applique les deux dernières technologies d'apprentissage automatique développées par Meta - SeeKeR et Director, et les utilise pour établir un modèle de dialogue qui permet au robot d'apprendre de l'interaction et des commentaires.

Kurt Shuste, un ingénieur de recherche qui a participé au développement de BlenderBot3, a déclaré : "Meta s'engage à publier publiquement toutes les données que nous avons collectées lors de la démonstration de ce chatbot, dans l'espoir que nous puissions améliorer l'intelligence artificielle conversationnelle du point de vue du contenu." vue, BlenderBot3 n'est pas nouveau. Son modèle sous-jacent est toujours un grand modèle de langage et LLMS, qui est un logiciel de génération de texte très puissant (bien qu'il présente quelques défauts).

Comme tous les logiciels de génération de texte, BlenderBot3 a été initialement formé sur d'énormes ensembles de données textuelles, BlenderBot peut exploiter divers modèles statistiques puis générer du langage.

Tout comme le mauvais GPT-3, nous l'avons dit.

En plus de ce qui est mentionné ci-dessus, BlenderBot3 présente également quelques points forts.

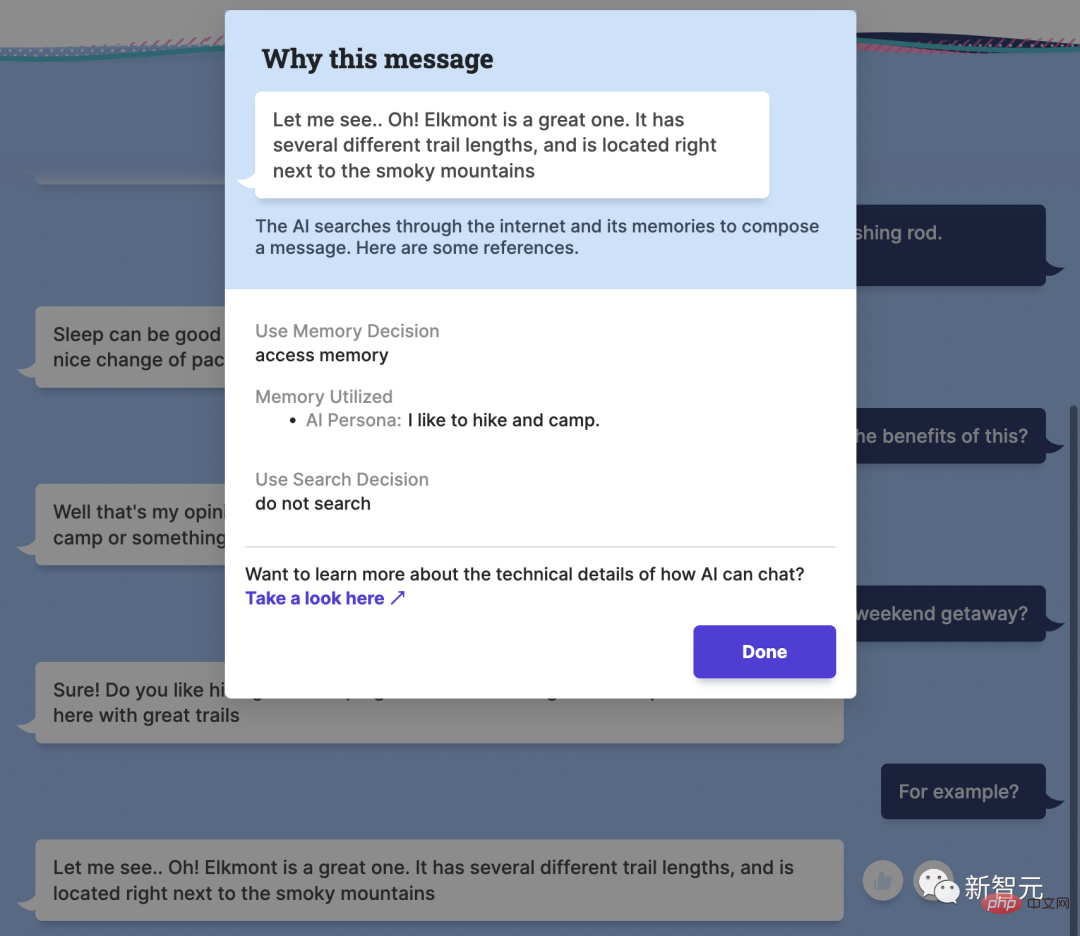

Contrairement aux chatbots précédents, lorsqu'ils discutent avec BlenderBot, les utilisateurs peuvent cliquer sur la réponse donnée par le robot pour visualiser la source de la phrase sur Internet. En d’autres termes, BlenderBot3 peut citer des sources.

Cependant, il y a ici un problème très critique. Autrement dit, une fois qu’un chatbot est rendu public, cela signifie que n’importe qui peut interagir avec lui. Une fois que le nombre de personnes qui le testeront augmentera, il y aura certainement une vague de personnes qui voudront le « gâcher ».

C’est aussi l’objet des prochaines recherches de l’équipe Meta.

Il n’est pas rare que les chatbots soient corrompus.

En 2016, Microsoft a publié un chatbot appelé Tay sur Twitter. Quiconque a suivi Tay doit encore être impressionné.

Après le début de la version bêta publique, Tay a commencé à apprendre des interactions avec les utilisateurs. Sans surprise, il n’a pas fallu longtemps pour que Tay, sous l’influence d’un petit groupe de fauteurs de troubles, commence à émettre une série de remarques liées au racisme, à l’antisémitisme et à la misogynie.

Microsoft a constaté que la situation n'était pas bonne et a mis Tay hors ligne en moins de 24 heures.

Meta a déclaré que depuis que Tay a rencontré Waterloo, le monde de l'IA s'est considérablement développé. BlenderBot dispose de diverses garanties de sécurité qui devraient empêcher Meta de suivre le chemin de Microsoft.

Les premières expériences montrent qu'à mesure que de plus en plus de personnes peuvent participer à l'interaction avec le modèle, le robot peut apprendre davantage de l'expérience de conversation. Au fil du temps, BlenderBot3 deviendra de plus en plus sécurisé.

Il semble que Meta fasse du très bon travail à cet égard.

Mary Williamson, responsable de l'ingénierie de recherche chez Facebook Artificial Intelligence Research (FAIR), a déclaré : « La différence la plus importante entre Tay et BlenderBot3 est que Tay est conçu pour apprendre en temps réel à partir des interactions des utilisateurs, tandis que BlenderBot est un modèle statique. »

Cela signifie que BlenderBot est capable de se souvenir de ce que l'utilisateur a dit pendant la conversation (il conservera même ces informations via les cookies du navigateur si l'utilisateur quitte le programme et y revient plus tard), mais ces données ne sont utilisées que pour poursuivre améliorer le système.

Williamson a déclaré : « La grande majorité des chatbots d'aujourd'hui sont axés sur les tâches. Prenez par exemple les robots de service client les plus simples. Ils ont l'air intelligents, mais ce ne sont en réalité que des arbres de dialogue programmés les uns après les autres, réduisant lentement le nombre d'utilisateurs. La véritable avancée est de permettre aux robots de parler librement comme les humains. C'est exactement ce que Meta veut faire. En plus de mettre BlenderBot 3 en ligne, Meta a également publié le code sous-jacent, les ensembles de données de formation et des variantes de modèles plus petites. Les chercheurs peuvent demander l'accès via le formulaire ici .

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI