Maison >Périphériques technologiques >IA >'MiniGPT-4 prouve ses étonnantes capacités de reconnaissance d'images et ses multiples fonctions : discuter avec des images, créer des sites Web avec des croquis, etc.'

'MiniGPT-4 prouve ses étonnantes capacités de reconnaissance d'images et ses multiples fonctions : discuter avec des images, créer des sites Web avec des croquis, etc.'

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-24 11:16:15970parcourir

Pour les humains, comprendre les informations d'une image n'est rien d'autre qu'une affaire triviale. Les humains peuvent donner la signification d'une image avec désinvolture sans réfléchir. Tout comme l'image ci-dessous, le chargeur sur lequel le téléphone est branché est quelque peu inapproprié. Les humains peuvent voir le problème d’un seul coup d’œil, mais pour l’IA, cela reste très difficile.

L'émergence de GPT-4 a commencé à simplifier ces problèmes. Il peut rapidement signaler le problème de l'image : la ligne VGA chargeant l'iPhone.

En fait, le charme de GPT-4 est bien moindre que cela. Ce qui est encore plus excitant, c'est d'utiliser des croquis dessinés à la main pour générer directement le site Web, dessiner un schéma griffonné sur du papier brouillon, prendre une photo, puis envoyez-le à GPT-4 pour le laisser suivre. Le diagramme schématique est utilisé pour écrire le code du site Web, et whoosh, GPT-4 a écrit le code de la page Web.

Mais malheureusement, cette fonction de GPT-4 n'est pas encore ouverte au public, et il est impossible de s'y lancer et d'en faire l'expérience. Cependant, certaines personnes ne peuvent plus attendre et une équipe de l'Université des sciences et technologies du Roi Abdallah (KAUST) a développé un produit similaire au GPT-4 - MiniGPT-4. Les chercheurs de l'équipe comprennent Zhu Deyao, Chen Jun, Shen Xiaoqian, Li Xiang et Mohamed H. Elhoseiny, tous issus du groupe de recherche Vision-CAIR de KAUST.

- Adresse papier : https://github.com/Vision-CAIR/MiniGPT-4/blob/main/MiniGPT_4.pdf

- Page d'accueil du papier : https:// minigpt-4.github.io/

- Adresse du code : https://github.com/Vision-CAIR/MiniGPT-4

MiniGPT-4 montre de nombreuses capacités similaires à GPT-4 telles que comme la génération de descriptions d'images détaillées et la création de sites Web à partir de brouillons manuscrits. De plus, les auteurs ont observé d'autres capacités émergentes de MiniGPT-4, notamment la création d'histoires et de poèmes basés sur des images données, la fourniture de solutions aux problèmes montrés dans les images, l'enseignement aux utilisateurs sur la façon de cuisiner à partir de photos de plats, etc.

MiniGPT-4 Il est facile de parler rien qu'en regardant les images

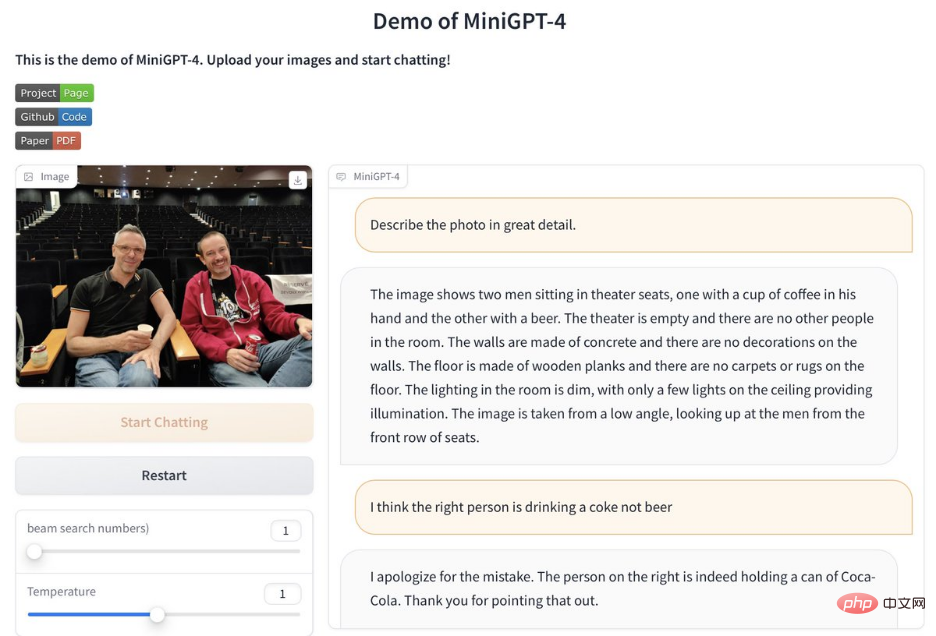

Quelle est l'efficacité du MiniGPT-4 ? Commençons par quelques exemples. De plus, afin d'avoir une meilleure expérience avec MiniGPT-4, il est recommandé d'utiliser la saisie en anglais pour les tests.

Tout d’abord, examinons la capacité du MiniGPT-4 à décrire des images. Pour l'image de gauche, la réponse donnée par MiniGPT-4 est à peu près « L'image représente un cactus poussant sur un lac gelé. Il y a d'énormes cristaux de glace autour du cactus, et il y a des sommets enneigés au loin... " Si vous demandez alors, ce scénario pourrait-il se produire dans le monde réel ? La réponse donnée par MiniGPT-4 est que cette image n’est pas courante dans le monde réel et c’est pour cette raison.

Ensuite, jetons un coup d'œil à la capacité de questions et réponses d'image MiniGPT-4. Question : "Qu'est-ce qui ne va pas avec cette plante ? Que dois-je faire ?" MiniGPT-4 a non seulement souligné le problème, mais a également déclaré que les feuilles avec des taches brunes peuvent être causées par une infection fongique et a donné les étapes de traitement :

En regardant quelques exemples, la fonction de visualisation d'images et de discussion de MiniGPT-4 est déjà très puissante. De plus, MiniGPT-4 peut créer des sites Web à partir de croquis. Par exemple, laissez MiniGPT-4 dessiner une page Web selon le brouillon d'image à gauche. Après avoir reçu l'instruction, MiniGPT-4 donne le code HTML correspondant et le site Web correspondant comme requis :

Avec MiniGPT-4, rédiger des slogans publicitaires pour les images est devenu très simple. Demandez à MiniGPT-4 de rédiger un texte publicitaire pour la tasse de gauche. MiniGPT-4 a souligné avec précision le motif de chat endormi sur la tasse, ce qui convient très bien aux amateurs de café et aux amoureux des chats. Il a également souligné le matériau de la tasse, etc. :

MiniGPT-4. peut également faire face Générer une recette à partir d'une image et devenir un expert en cuisine :

Expliquez le mème largement diffusé :

Écrivez un poème basé sur l'image :

De plus, il convient de mentionner que la démo MiniGPT-4 est désormais ouverte et peut être jouée en ligne. Vous pouvez en faire l'expérience vous-même (il est recommandé de tester en anglais) :

Adresse de démonstration : https://0810e8582bcad31944.gradio.live/

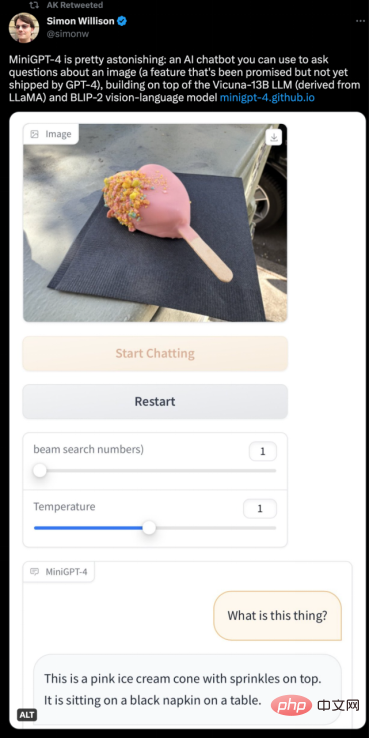

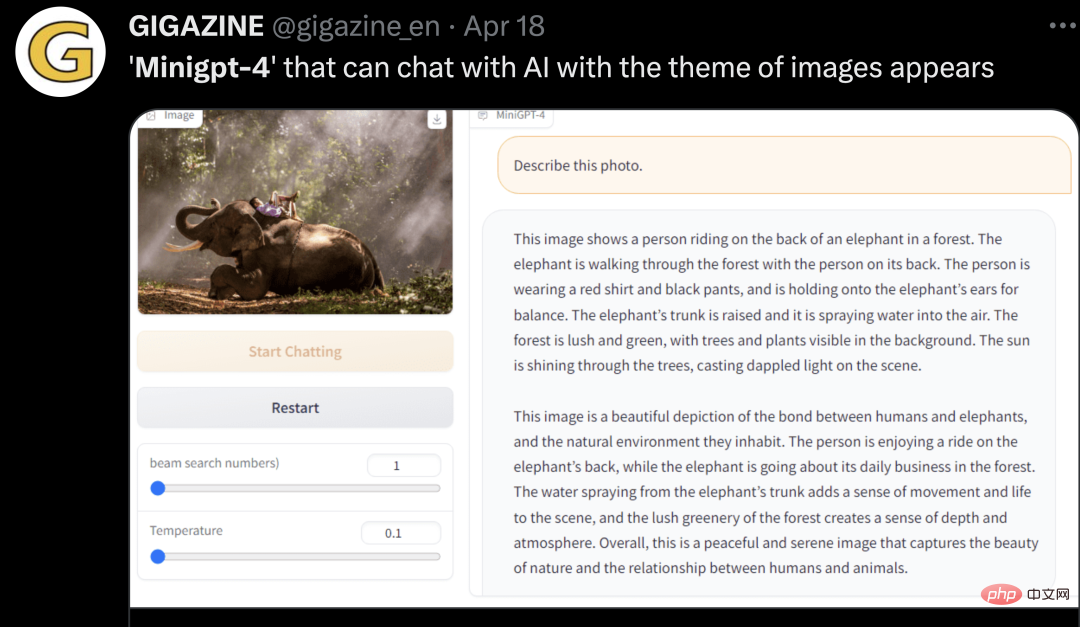

Une fois le projet publié, il a attiré l'attention des internautes. Par exemple, laissez MiniGPT-4 expliquer les objets dans l'image :

Il y a d'autres expériences de test d'internautes ci-dessous :

Introduction à la méthode

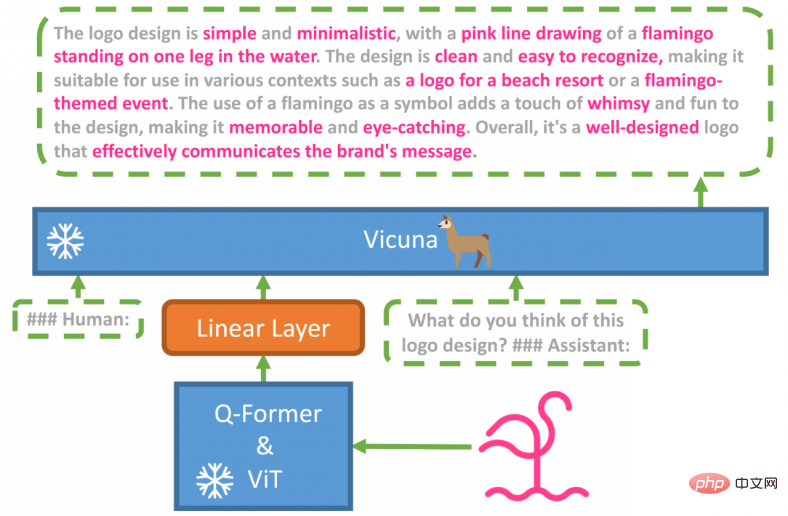

Auteur On pense que le modèle de langage étendu (LLM) avancé de GPT-4 est la principale raison de ses capacités avancées de génération multimodale. Pour étudier ce phénomène, les auteurs proposent MiniGPT-4, qui utilise une couche de projection pour aligner un encodeur visuel gelé et un LLM gelé (Vicuna).

MiniGPT-4 se compose d'un encodeur visuel ViT et Q-Former pré-entraîné, d'une couche de projection linéaire séparée et d'un modèle de langage avancé à grande échelle Vicuna. MiniGPT-4 ne nécessite que des couches linéaires de formation pour aligner les caractéristiques visuelles avec Vicuna.

MiniGPT-4 a subi deux étapes de formation. La première étape de pré-formation traditionnelle a duré 10 heures pour s'entraîner sur 4 GPU A100 en utilisant environ 5 millions de paires image-texte alignées. Après la première étape, Vicuna était capable de comprendre les images. Mais les capacités de génération de texte de Vicuna ont été grandement affectées.

Pour résoudre ce problème et améliorer la convivialité, les chercheurs ont proposé une nouvelle façon de créer des paires image-texte de haute qualité via le modèle lui-même et ChatGPT. Sur cette base, l’étude a créé un ensemble de données restreint mais de haute qualité (3 500 paires au total).

La deuxième étape de réglage fin est formée sur cet ensemble de données à l'aide de modèles de conversation pour améliorer considérablement sa fiabilité de génération et sa convivialité globale. Cette étape est efficace sur le plan informatique et ne nécessite qu’un A100GPU en 7 minutes environ.

Autres travaux connexes :

- VisualGPT : https://github.com/Vision-CAIR/VisualGPT

- ChatCaptioner : https://github.com/Vision-CAIR/ChatCaptioner

De plus, des bibliothèques de code open source, notamment BLIP2, Lavis et Vicuna, sont également utilisées dans le projet.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI