Maison >Périphériques technologiques >IA >Le modèle SOTA innovant de Meta peut générer des vidéos étonnantes basées sur une seule phrase, déclenchant un engouement sur Internet !

Le modèle SOTA innovant de Meta peut générer des vidéos étonnantes basées sur une seule phrase, déclenchant un engouement sur Internet !

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-23 09:22:071627parcourir

Je vais vous donner un paragraphe et vous demander de faire une vidéo, pouvez-vous le faire ?

Meta a dit, je peux le faire.

Vous avez bien entendu : grâce à l'IA, vous pouvez aussi devenir cinéaste !

Récemment, Meta a lancé un nouveau modèle d'IA, et le nom est très simple : Make-A-Video.

Quelle est la puissance de ce modèle ?

Avec une seule phrase, vous pouvez réaliser la scène de "Trois chevaux au galop".

Même LeCun a dit que ce qui est censé arriver viendra toujours.

Les effets visuels sont époustouflants

Sans plus tard, regardons simplement les effets.

Deux kangourous sont occupés à cuisiner dans la cuisine (qu'ils puissent manger, c'est une autre affaire)

Plan rapproché : Le peintre peint sur la toile

Le monde à deux les gens marchent sous la forte pluie (pas uniformes)

Le cheval boit de l'eau

La ballerine danse sur le gratte-ciel

Un golden retriever est manger sur une belle plage tropicale d'été Glace (les pattes ont évolué)

Le propriétaire du chat regarde la télévision avec la télécommande (les pattes ont évolué)

Un ours en peluche dessine un auto- portrait de lui-même

Ce qui est inattendu mais raisonnable, c'est que les "mains" utilisées par les chiens pour tenir les glaces, les chats pour tenir les télécommandes et les ours en peluche pour dessiner ont toutes "évolué" comme les humains ! (Tactical Backward)

Bien sûr, en plus de transformer du texte en vidéo, Make-A-Video peut également transformer des images statiques en Gifs.

Entrée :

Sortie :

Entrée :

Sortie : (La lumière semble un peu déplacée)

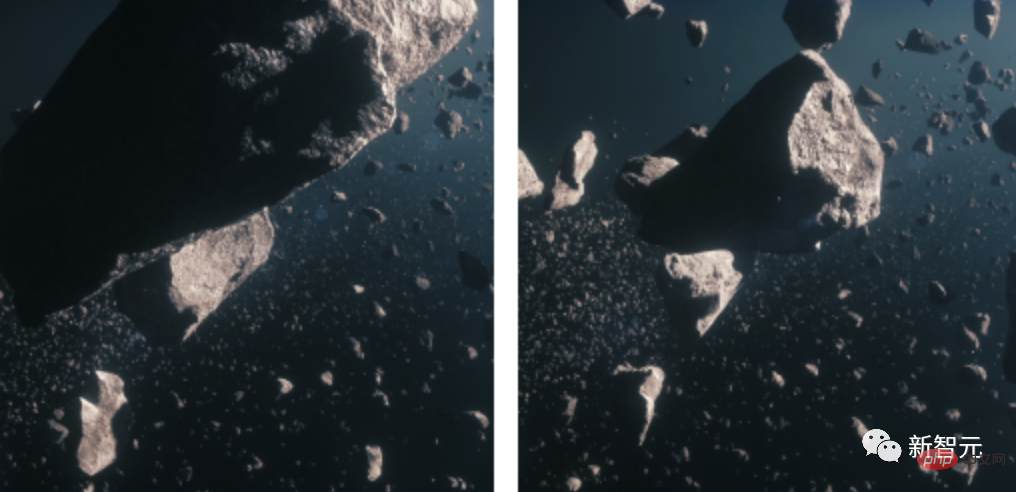

2 images statiques dans GIF, saisissez l'image de la météorite

Sortie :

Et transformer la vidéo en vidéo ?

Entrée :

Sortie :

Entrée :

Sortie :

Principes techniques

Aujourd'hui, Meta a publié son propre dernier recherche MAKE-A-VIDEO : GÉNÉRATION DE TEXTE À VIDÉO SANS DONNÉES TEXTE-VIDÉO.

Adresse papier : https://makeavideo.studio/Make-A-Video.pdf

Avant l'apparition de ce modèle, nous avions déjà la diffusion stable.

Des scientifiques intelligents ont déjà demandé à l'IA de générer des images avec une seule phrase. Que feront-ils ensuite ?

Évidemment, il s'agit de générer une vidéo.

Un chien de super-héros portant une cape rouge volant dans le ciel

Générer une vidéo est bien plus difficile que générer une image. Non seulement nous devons générer plusieurs images du même sujet et de la même scène, mais nous devons également les rendre opportunes et cohérentes.

Cela augmente la complexité de la tâche de génération d'images - nous ne pouvons pas simplement utiliser DALLE pour générer 60 images puis les assembler dans une vidéo. L'effet sera très médiocre et irréaliste.

Par conséquent, nous avons besoin d'un modèle capable de comprendre le monde de manière plus puissante et de lui permettre de générer une série cohérente d'images basées sur ce niveau de compréhension. Ce n’est qu’alors que les images peuvent se fondre harmonieusement.

En d'autres termes, notre objectif est de simuler un monde puis de simuler ses records. Comment faire ?

Selon les idées précédentes, les chercheurs utiliseraient un grand nombre de paires texte-vidéo pour entraîner le modèle, mais dans la situation actuelle, cette méthode de traitement n'est pas réaliste. Parce que ces données sont difficiles à obtenir et que les coûts de formation sont très chers.

Les chercheurs ont donc ouvert leur esprit et adopté une toute nouvelle approche.

Ils ont choisi de développer un modèle texte-image puis de l'appliquer aux vidéos.

Par coïncidence, il y a quelque temps, Meta a développé Make-A-Scene, un modèle du texte à l'image.

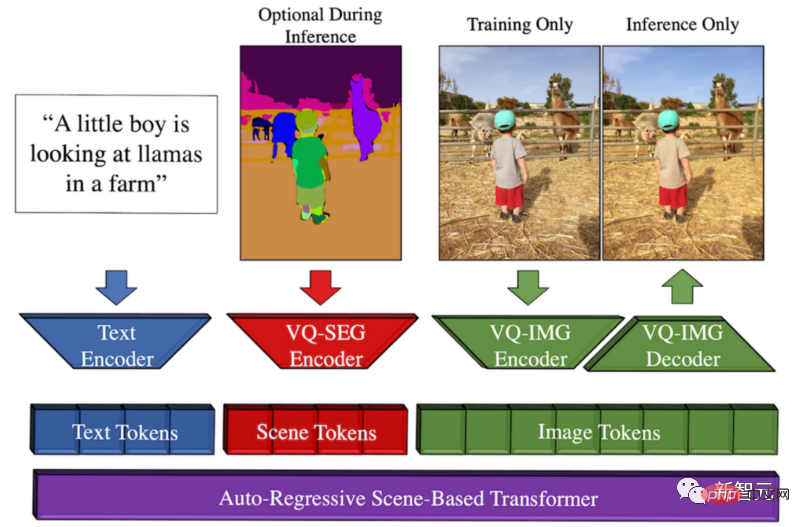

Aperçu de la méthode Make-A-Scene

L'opportunité de ce modèle est que Meta espère promouvoir l'expression créative et comparer cette tendance du texte à l'image avec la précédente esquisse -modèle d'image Combiné, résultant en une fusion fantastique entre le texte et la génération d'images conditionnées par des croquis.

Cela signifie que nous pouvons rapidement dessiner un chat et écrire le type d'image que nous voulons. En suivant les croquis et le texte, le modèle produira l'illustration parfaite que nous souhaitons en quelques secondes.

Vous pouvez considérer cette approche d'IA générative multimodale comme un modèle Dall-E avec plus de contrôle sur la génération, car elle peut également prendre des croquis rapides en entrée.

La raison pour laquelle on l'appelle multimodal est qu'il peut prendre plusieurs modalités en entrée, telles que du texte et des images. En revanche, Dall-E ne peut générer des images qu'à partir de texte.

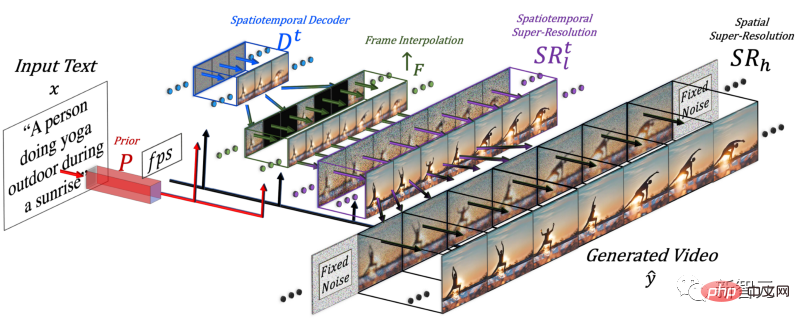

Pour générer une vidéo, la dimension du temps doit être ajoutée, c'est pourquoi les chercheurs ont ajouté un pipeline spatio-temporel au modèle Make-A-Scene.

Après avoir ajouté la dimension temporelle, ce modèle ne génère pas une seule image, mais 16 images basse résolution pour créer une courte vidéo cohérente.

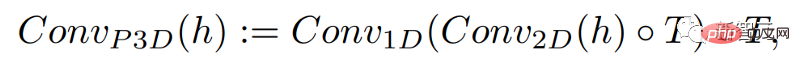

Cette méthode est en fait similaire au modèle texte-image, mais la différence est que, basée sur la convolution bidimensionnelle conventionnelle, elle ajoute une convolution unidimensionnelle.

En ajoutant simplement une convolution unidimensionnelle, les chercheurs ont pu maintenir inchangée la convolution bidimensionnelle pré-entraînée tout en ajoutant une dimension temporelle. Les chercheurs peuvent ensuite s’entraîner à partir de zéro, en réutilisant une grande partie du code et des paramètres du modèle d’image Make-A-Scene.

Dans le même temps, les chercheurs souhaitent également utiliser la saisie de texte pour guider ce modèle, qui sera très similaire au modèle d'image utilisant l'intégration CLIP.

Dans ce cas, les chercheurs ont augmenté la dimension spatiale en mélangeant des caractéristiques de texte avec des caractéristiques d'image. La méthode est la même que ci-dessus : conserver le module d'attention dans le modèle Make-A-Scene et ajouter une dimension unidimensionnelle à celui-ci. time. Module Attention - copiez et collez le modèle du générateur d'images et répétez le module de génération pour une dimension supplémentaire pour obtenir 16 images initiales.

Mais en s'appuyant uniquement sur ces 16 images initiales, la vidéo ne peut pas être générée.

Les chercheurs doivent produire une vidéo haute définition à partir de ces 16 images principales. Leur approche consiste à accéder aux images précédentes et futures et à les interpoler de manière itérative simultanément dans les dimensions temporelle et spatiale.

De cette façon, entre ces 16 images initiales, ils ont généré de nouvelles images plus grandes basées sur les images avant et après, de sorte que le mouvement devienne cohérent et que la vidéo globale devienne fluide.

Cela se fait via un réseau d'interpolation de trames, qui peut prendre des images existantes pour combler les lacunes et générer des informations intermédiaires. Dans la dimension spatiale, il fait la même chose : agrandit l'image, comble les lacunes en pixels et rend l'image plus haute définition.

Pour résumer, pour générer des vidéos, les chercheurs ont affiné un modèle de conversion texte-image. Ils ont pris un modèle puissant déjà formé, l'ont peaufiné et formé pour s'adapter à la vidéo.

Grâce à l'ajout de modules spatiaux et temporels, vous pouvez simplement adapter le modèle à ces nouvelles données sans avoir à le recycler, ce qui permet d'économiser beaucoup de coûts.

Ce type de recyclage utilise des vidéos non étiquetées et n'a besoin que d'apprendre au modèle à comprendre la cohérence de la vidéo et des images vidéo, ce qui facilite la construction de l'ensemble de données.

Enfin, les chercheurs ont à nouveau utilisé le modèle d'optimisation d'image pour améliorer la résolution spatiale et ont utilisé le composant d'interpolation d'images pour ajouter plus d'images afin de rendre la vidéo plus fluide.

Bien entendu, les résultats actuels de Make-A-Video présentent encore des lacunes, tout comme le modèle texte-image. Mais nous savons tous à quel point les progrès dans le domaine de l’IA sont rapides.

Si vous souhaitez en savoir plus, vous pouvez vous référer à l'article Meta AI dans le lien. La communauté développe également une implémentation de PyTorch, alors restez à l'écoute si vous souhaitez l'implémenter vous-même.

Introduction à l'auteur

Un certain nombre de chercheurs chinois ont participé à cet article : Yin Xi, An Jie, Zhang Songyang, Qiyuan Hu.

Yin Xi, chercheur scientifique FAIR. Auparavant, il a travaillé pour Microsoft en tant que scientifique principal des applications pour Microsoft Cloud et l'IA. Il a obtenu son doctorat du Département d'informatique et d'ingénierie de l'Université d'État du Michigan et son baccalauréat en génie électrique de l'Université de Wuhan en 2013. Les principaux domaines de recherche sont la compréhension multimodale, la détection de cibles à grande échelle, le raisonnement facial, etc.

Anjie est doctorante au Département d'informatique de l'Université de Rochester. Étude auprès du professeur Roger Bo. A déjà obtenu une licence et une maîtrise de l'Université de Pékin en 2016 et 2019. Les intérêts de recherche incluent la vision par ordinateur, les modèles génératifs profonds et l’IA+art. Participation à la recherche Make-A-Video en tant que stagiaire.

Zhang Songyang est doctorant au Département d'informatique de l'Université de Rochester, étudiant sous la direction du professeur Roger Bo. Il a obtenu son baccalauréat de l'Université du Sud-Est et sa maîtrise de l'Université du Zhejiang. Les intérêts de recherche incluent la localisation des moments du langage naturel, l'induction grammaticale non supervisée, la reconnaissance d'actions basée sur le squelette, etc. Participation à la recherche Make-A-Video en tant que stagiaire.

Qiyuan Hu, alors résident en IA à FAIR, était engagé dans des recherches sur des modèles génératifs multimodaux qui améliorent la créativité humaine. Elle a obtenu son doctorat en physique médicale à l’Université de Chicago et a travaillé sur l’analyse d’images médicales assistée par l’IA. Je travaille actuellement chez Tempus Labs en tant que scientifique en apprentissage automatique.

Les internautes ont été choqués

Il y a quelque temps, de grandes entreprises comme Google ont publié leurs propres modèles de conversion texte-image, comme Parti, etc.

Certains pensent même que les modèles génératifs texte-vidéo sont encore loin.

De façon inattendue, Meta a largué une bombe cette fois.

En fait, il existe aujourd'hui également un modèle de génération texte-vidéo Phenaki, qui a été soumis à l'ICLR 2023. Comme il est encore en phase de révision à l'aveugle, l'institution de l'auteur est encore inconnue.

Les internautes ont dit que de DALLE à Stable Diffuson en passant par Make-A-Video, tout s'est passé trop vite.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI