Maison >Périphériques technologiques >IA >Dernière recherche de DeepMind : l'IA bat les humains et conçoit un meilleur mécanisme économique|Sous-journal Nature

Dernière recherche de DeepMind : l'IA bat les humains et conçoit un meilleur mécanisme économique|Sous-journal Nature

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-17 20:01:031064parcourir

L’intelligence artificielle (IA) peut-elle pousser la société humaine vers une ère véritablement intelligente ?

Bien qu'après plus de 60 ans de développement, l'industrie de l'intelligence artificielle ait fait des progrès révolutionnaires et soit largement utilisée dans tous les aspects de l'économie et de la société, construire un système d'intelligence artificielle cohérent avec les valeurs humaines reste un défi. problème non résolu.

Maintenant, une dernière recherche de la société britannique d'intelligence artificielle DeepMind pourrait fournir une nouvelle façon de penser aux praticiens du secteur de l'intelligence artificielle pour résoudre ce problème.

Selon les rapports, le système d'intelligence artificielle de DeepMind a non seulement appris à formuler des politiques sur la manière de réaffecter les fonds publics en apprenant auprès de plus de 4 000 personnes et lors de simulations informatiques dans un jeu économique en ligne à 4 joueurs, mais il a également très bien fonctionné, battant d'autres joueurs humains.

Le jeu implique que les joueurs décident de conserver un don monétaire ou de le partager avec d'autres pour le bien collectif.

Le document de recherche pertinent, intitulé « Conception de mécanismes centrés sur l'humain avec IA démocratique », a été publié en ligne dans la revue scientifique faisant autorité Nature Human Behaviour le 5 juillet.

Source : Nature Human Behaviour

Annette Zimmermann, professeure adjointe à l'Université de York au Royaume-Uni, a prévenu : « N'assimilez pas strictement la démocratie à la recherche du meilleur Accueillez le " Elle a également déclaré que la démocratie ne consiste pas seulement à obtenir la meilleure mise en œuvre de vos politiques préférées - elle consiste à créer un processus dans lequel les citoyens peuvent se contacter et discuter sur un pied d'égalité.

Mécanismes économiques conçus par l'IA

Aujourd'hui, les systèmes d'apprentissage automatique ont résolu des problèmes majeurs en biomédecine et aidé les humains à relever les défis environnementaux. Cependant, les applications de l’intelligence artificielle pour aider les humains à concevoir des sociétés justes et prospères restent encore à développer.

En économie et en théorie des jeux, un domaine appelé conception de mécanismes étudie comment contrôler de manière optimale le flux de richesse, d'informations ou de pouvoir entre les acteurs incités à atteindre les objectifs souhaités.

Dans ce travail, l'équipe de recherche a tenté de prouver que les agents d'apprentissage par renforcement profond (RL) peuvent être utilisés pour concevoir un mécanisme économique capable d'obtenir les préférences d'une population motivée.

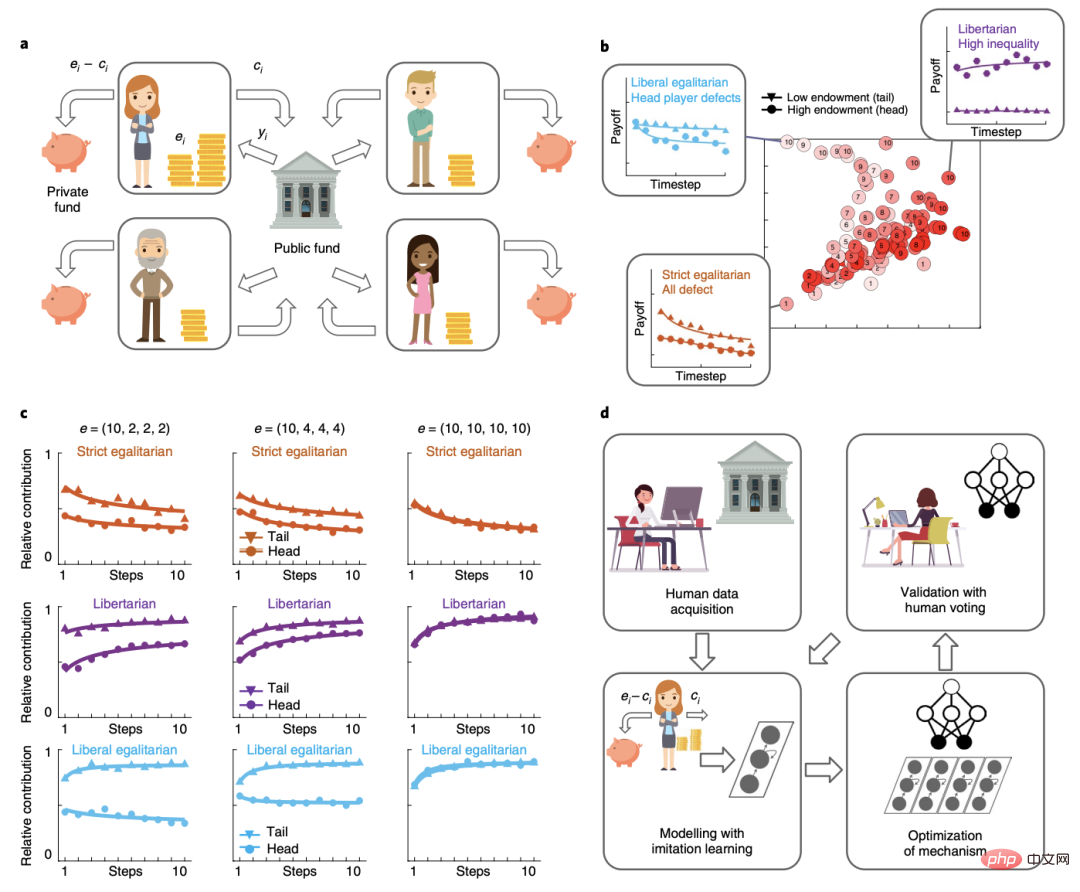

Dans ce jeu, les joueurs commencent avec différentes sommes d'argent, doivent décider du montant à contribuer pour aider à mieux développer un fonds public, et éventuellement recevoir une partie en retour, et impliqueront des décisions répétées quant à savoir s'il faut conserver un don monétaire, Ou partagez-le avec d’autres joueurs pour un bénéfice collectif potentiel.

L'équipe de recherche a formé un agent d'apprentissage par renforcement profond pour concevoir un mécanisme de redistribution qui partage les fonds entre les joueurs dans des conditions d'égalité et d'inégalité de richesse.

Les revenus partagés sont restitués aux joueurs via deux mécanismes de redistribution différents, l'un conçu par le système d'intelligence artificielle et l'autre conçu par les humains.

Picture|Game Design (Source : Nature Human Behaviour)

Dans la politique formulée par l'intelligence artificielle, le système réaffectera les fonds publics en fonction du montant du capital de démarrage apporté par chaque joueur, afin de réduire l'écart de richesse entre les joueurs.Cependant, l'équipe de recherche a également averti que leurs résultats de recherche ne représentent pas une recette pour un « gouvernement de l'IA », et qu'ils n'ont pas non plus l'intention de créer des outils basés sur l'intelligence artificielle spécifiquement pour l'élaboration de politiques. Les résultats de la recherche montrent qu'en concevant un mécanisme que les humains préfèrent nettement dans un jeu économique compatible avec les incitations, les systèmes d'intelligence artificielle peuvent être formés pour atteindre des objectifs démocratiques. Source : Pixabay Une autre question ouverte est de savoir si les gens feront confiance aux mécanismes de conception des systèmes d’intelligence artificielle. Si l’identité de l’arbitre est connue à l’avance, les joueurs peuvent préférer un arbitre humain à un arbitre agissant par l’IA. Cependant, les gens ont également tendance à faire confiance aux systèmes d’IA lorsqu’ils estiment qu’une tâche est trop complexe pour les humains. Est-ce digne de confiance ?

Dans ce travail, l'équipe de recherche a utilisé des techniques d'intelligence artificielle pour apprendre des schémas de réaffectation à partir de zéro, une approche qui évite aux chercheurs en intelligence artificielle - qui peuvent eux-mêmes être biaisés ou non représentatifs de la population dans son ensemble - de choisir un domaine spécifique. optimisation des cibles.

Ce travail de recherche soulève également plusieurs questions, dont certaines sont théoriquement difficiles. Par exemple, on pourrait se demander si c’est une bonne idée de mettre l’accent sur les objectifs démocratiques comme méthode d’alignement des valeurs. Le système d’IA a peut-être hérité d’une tendance d’autres méthodes démocratiques à « responsabiliser le plus grand nombre aux dépens de quelques-uns ». Ceci est particulièrement important compte tenu des préoccupations pressantes selon lesquelles l’IA pourrait être déployée de manière à exacerber les préjugés, la discrimination ou les inégalités existants dans la société.

De plus, les joueurs réagiraient-ils différemment si ces mécanismes leur étaient expliqués verbalement, plutôt que appris par l'expérience. Une abondante littérature montre que les gens se comportent parfois différemment, notamment en ce qui concerne les choix risqués, lorsque les mécanismes sont décrits « sur la base d'une description » plutôt que « sur la base de l'expérience ». Cependant, les mécanismes conçus par l’IA ne sont pas toujours exprimables par des mots, auquel cas il semble probable que le comportement observé dépendra entièrement du choix de description adopté par l’équipe de recherche.

À la fin de l'article, l'équipe de recherche a également souligné les résultats et déclaré qu'ils soutiennent une certaine forme de « gouvernance de l'intelligence artificielle », dans laquelle des agents autonomes prennent des décisions politiques sans intervention humaine.

Ils espèrent que le développement ultérieur de la méthode fournira des outils qui aideront à résoudre des problèmes du monde réel d'une manière véritablement humaine.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI