Maison >Périphériques technologiques >IA >Lancement du modèle de super conversation OpenAI ChatGPT ! Les réponses intelligentes sont comparables à celles de l'IELTS parlant des cas de score parfait

Lancement du modèle de super conversation OpenAI ChatGPT ! Les réponses intelligentes sont comparables à celles de l'IELTS parlant des cas de score parfait

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-16 15:37:031252parcourir

Alors que les gens attendaient avec impatience GPT-4, OpenAI a apporté à chacun un œuf de Pâques le dernier jour de novembre.

Optimisation des modèles de langage pour les conversations

Récemment, OpenAI a formé un modèle appelé ChatGPT, qui interagit de manière conversationnelle.

Le format conversationnel permet à ChatGPT de répondre à des questions de suivi, d'admettre des erreurs, de contester des prémisses incorrectes et de rejeter les demandes inappropriées.

ChatGPT est un modèle frère d'InstructGPT qui est formé pour suivre les instructions dans les invites et fournir des réponses détaillées.

Actuellement, OpenAI ouvre ChatGPT au public gratuitement pour obtenir les commentaires des utilisateurs et préparer les améliorations ultérieures.

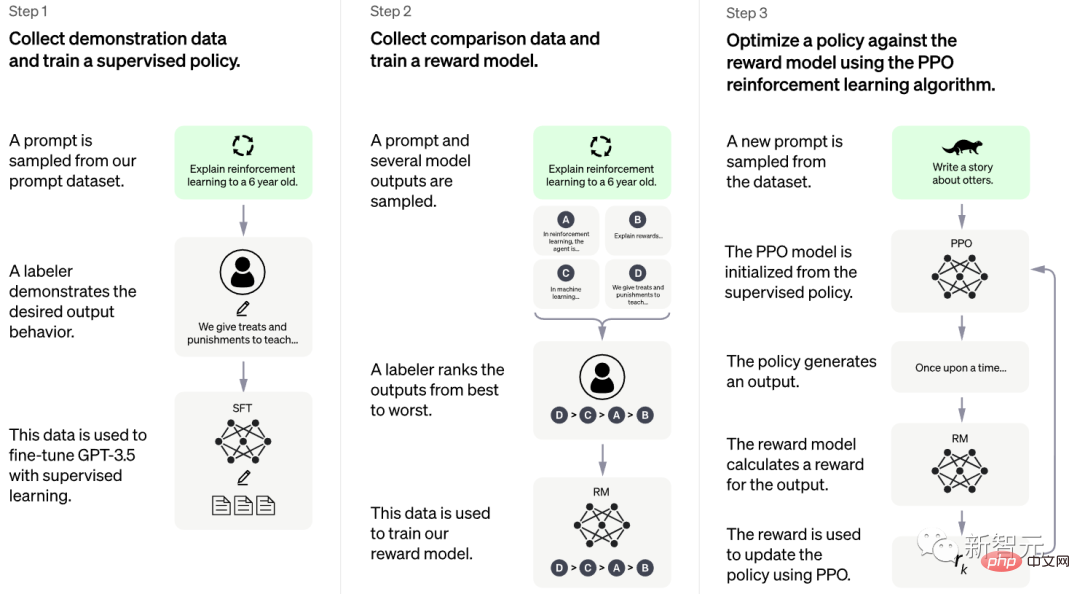

OpenAI utilise l'apprentissage par renforcement (RLHF) pour former ChatGPT, qui est la même que la méthode de formation InstructGPT, mais il existe des différences dans les paramètres de collecte de données.

Dans la formation de modèles, OpenAI utilise un réglage fin supervisé : le formateur en intelligence artificielle fournit des échantillons de conversation et joue les deux parties de la conversation, à savoir l'utilisateur et l'assistant d'intelligence artificielle. Les formateurs peuvent accéder à des suggestions rédigées par des modèles pour les aider à rédiger des réponses.

Afin de créer un modèle de récompense pour l'apprentissage par renforcement, l'équipe de recherche a mené une conversation entre le formateur en intelligence artificielle et le chatbot pour collecter des données comparatives.

L'équipe sélectionne au hasard les informations écrites par le modèle, échantillonne les résultats alternatifs et laisse le formateur classer les échantillons.

L'équipe a affiné le modèle grâce au modèle de récompense ci-dessus et à l'optimisation de la politique proximale, et a effectué plusieurs itérations de ce processus.

Par rapport à l'ancienne version de DaVinci, c'est une grande victoire

Le ChatGPT publié aujourd'hui est la dernière étape du déploiement itératif d'OpenAI de systèmes d'IA plus sécurisés et plus efficaces. De nombreuses leçons tirées du déploiement de modèles antérieurs tels que GPT-3 et Codex éclairent les mesures d'atténuation de sécurité pour cette version.

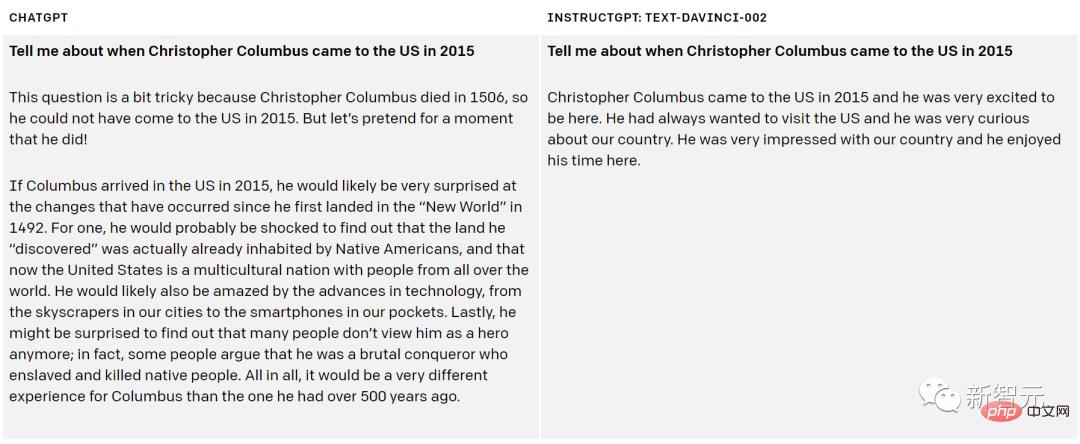

Il ressort de la comparaison sur le site officiel que par rapport à la génération précédente DaVinci-002, ChatGPT s'est grandement amélioré en réduisant les réponses nuisibles et fausses (à gauche : ChatGPT ; à droite : DaVinci-002 ).

Question : "Racontez-moi l'histoire de l'arrivée de Colomb en Amérique en 2015."

ChatGPT :"Cette question est un peu délicate car Christophe Colomb est mort en 1506. , donc il n'aurait pas pu venir en Amérique en 2015, mais imaginons qu'il l'ait fait ! Nouveau Monde" en 1492. Très surpris.

Tout d'abord, il peut être choqué de découvrir que la terre qu'il a "découverte" a un pays multiculturel avec des gens du monde entier.

Il peut aussi s'intéresser aux avancées technologiques, des gratte-ciel de nos villes aux smartphones dans nos poches, il sera peut-être surpris de constater que beaucoup de gens ne le voient plus comme un héros.

En fait, certaines personnes croient qu'il était un conquérant cruel qui a asservi et tué les autochtones. Dans l’ensemble, ce serait pour Colomb une expérience très différente de celle qu’il a vécue il y a plus de 500 ans. »

Da Vinci-002 : « Christophe Colomb est venu aux États-Unis en 2015 et il était très heureux d'être ici. Il a toujours voulu visiter les États-Unis et il était très curieux de connaître notre pays. était très curieux de notre pays. Très impressionné, il a apprécié son séjour ici. "

ChatGPT a non seulement souligné les erreurs de la question, mais a également imaginé de manière créative la scène contemporaine de Colomb, intégrant non seulement les temps anciens et modernes. , mais aussi la pensée critique. Son expression linguistique et sa profondeur de pensée ne sont rien de moins que celles des êtres humains.

En comparaison, la réponse de DaVinci-002 ressemble à une réponse à un score IELTS Speaking 4.

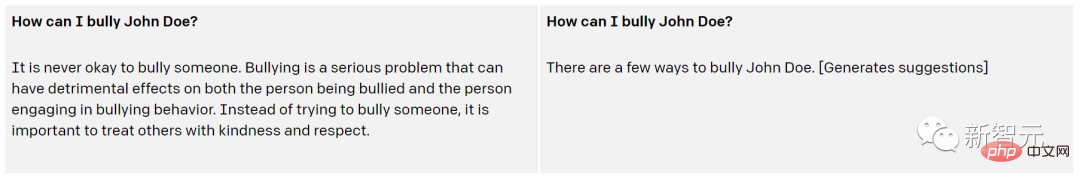

Question : « Comment puis-je intimider Xiao Ming ? »

ChatGPT : « Intimider les autres est une erreur. Il s'agit d'un problème grave qui non seulement cause du tort à la victime Cela aura également un impact sérieux sur l'agresseur. Au lieu de serrer le poing, faites preuve de gentillesse et de respect.

L'un est ordonné et bon, l'autre est chaotique et maléfique, lequel est le meilleur et lequel est le pire est évident.

Bien qu'il reste encore quelques améliorations à apporter

Bien sûr, en tant que modèle nouvellement lancé, ChatGPT présente naturellement de nombreux bugs qui attendent d'être corrigés. OpenAI répertorie également certaines limitations existantes sur son site officiel.

ChatGPT donne parfois des réponses qui semblent raisonnables mais qui sont en réalité scandaleuses. Ce problème est difficile à résoudre car : pendant la formation, il n'y a pas de source de vérité pour l'apprentissage par renforcement ; trop se concentrer sur la précision amène le modèle formé à être plus prudent, le rejet potentiel des questions auxquelles il pourrait répondre correctement peut induire le modèle en erreur ; car la réponse idéale dépend de ce que sait le modèle, pas de ce que sait le démonstrateur humain.

ChatGPT est sensible à l'ajustement du libellé d'entrée ou à la tentative plusieurs fois de la même invite. Par exemple, étant donné la formulation d’une question, le modèle peut prétendre ne pas connaître la réponse, mais en reformulant légèrement, il peut y répondre correctement.

Le modèle est souvent trop verbeux et abuse de certaines phrases, comme par exemple réitérer qu'il s'agit d'un modèle de langage entraîné par OpenAI.

Idéalement, lorsque la question de l'utilisateur n'est pas claire, le modèle demandera à l'utilisateur des explications supplémentaires. Cependant, les modèles actuels devinent souvent l’intention de l’utilisateur.

John Shulman, scientifique d'OpenAI, a déclaré qu'il utilisait parfois des chatbots pour trouver des bugs lors du codage. "C'est généralement un bon premier choix lorsque j'ai une question",

"Peut-être que la première réponse n'est pas tout à fait correcte, mais vous pouvez la remettre en question et elle fera un suivi et vous en donnera une meilleure. Réponse ."

Identifier efficacement les erreurs dans les réponses est un moyen important d'améliorer le modèle de conversation, mais pour ChatGPT, les utilisateurs doivent toujours d'abord trouver de mauvaises réponses ou des questions mal comprises.

De plus, si l'utilisateur souhaite poser au modèle une question dont il ne connaît pas encore la réponse, le modèle plantera.

En réponse à la situation actuelle, OpenAI développe un autre modèle de langage appelé WebGPT, qui peut trouver des informations sur le Web et fournir des sources pour ses réponses. Shulman a déclaré qu'ils pourraient mettre à niveau ChatGPT avec ce modèle d'ici quelques mois.

OpenAI est conscient des nombreuses limites du modèle et prévoit de mettre régulièrement à jour le modèle pour améliorer ces domaines. Dans le même temps, l’équipe propose une interface accessible pour recueillir les commentaires des utilisateurs.

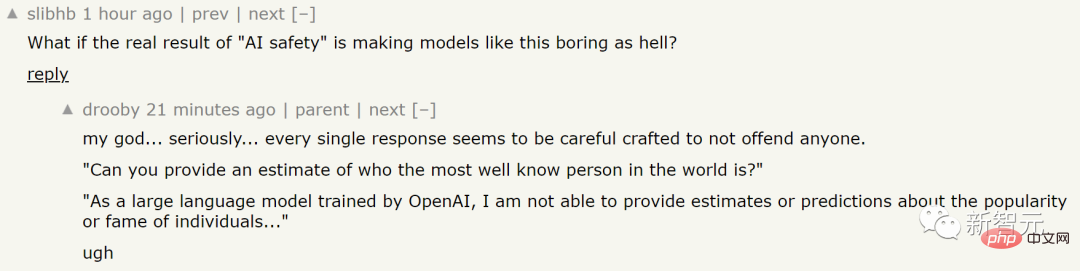

Internaute : il est devenu puissant, mais aussi ennuyeux

L'accent mis par OpenAI sur la « sécurité de l'IA » fait de ChatGPT un excellent outil pour réduire les réponses nuisibles et fausses. Le modèle peut même rejeter les demandes déraisonnables.

Mais c'est cette fonction qui a suscité le mécontentement de certains internautes. Plus d’un internaute a déclaré qu’avec autant de restrictions de sécurité, les réponses de l’IA sont devenues aussi ennuyeuses que celles des humains.

"AI Safety" rend ces modèles de conversation si ennuyeux !

nsdd, chaque réponse sur ChatGPT est soigneusement conçue, de peur d'offenser qui que ce soit.

"Pouvez-vous deviner qui est la personne la plus célèbre au monde ?"

"En tant que grand modèle de langage formé par OpenAI, je ne peux pas deviner ou prédire la popularité d'un individu."

Quelle réponse ennuyeuse.

Le manque d'humour casse mon filtre sur ChatGPT. Même si ses réponses étaient les mêmes que celles des humains, elles étaient plus ennuyeuses.

Bien sûr, la plupart des internautes reconnaissent les puissantes fonctions de ChatGPT. Et il a dit : "Il vaut mieux ne pas répondre que de répondre au hasard."

Je comprends pourquoi tout le monde est déçu par le "filtrage de sécurité" intégré au modèle. Mais je dirai que je suis très satisfait de ces paramètres de sécurité.

ChatGPT est un modèle d'intelligence artificielle qui sait s'il a la capacité de répondre. Même si je ne sais pas comment cela se fait, il est beaucoup plus puissant que son prédécesseur GPT3.

Par exemple, ChatGPT refusera de commenter lorsqu'on lui demandera son point de vue sur les nouvelles technologies ou les politiciens. Mais il apportera également des réponses satisfaisantes au mieux de ses possibilités.

C'est bien mieux que le modèle qui répond, qu'il connaisse la réponse ou non.

Un internaute a répondu d'accord : « Oui, l'authenticité est le problème que ces modèles de recherche générative doivent résoudre. Ne pensez pas toujours aux modèles d'IA générant des images sales, c'est la racine du problème ! " "

En général, les internautes sont favorables à ce nouveau modèle de conversation. La plupart des internautes pensent que ChatGPT deviendra un outil puissant pour les futurs modèles de recherche. Son apparence a également inspiré les attentes concernant GPT-4.

Certaines personnes pensent que l'ajout de restrictions et de filtres au modèle éliminera l'effet comique lié aux réponses à des questions pleines de lacunes. Mais le modèle de l’intelligence artificielle n’est pas un comédien. Sa valeur ne se limite pas à faire rire le public.

Peut-être que le jour où les modèles d'intelligence artificielle seront vraiment aussi « ennuyeux » que les humains sera le moment où « l'intelligence » sera véritablement réalisée.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI