Maison >Périphériques technologiques >IA >Microsoft gagne ! Des milliards de formations de paires texte-image, multimodales Florence démarre un essai gratuit, disponible sur Azure

Microsoft gagne ! Des milliards de formations de paires texte-image, multimodales Florence démarre un essai gratuit, disponible sur Azure

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-15 08:43:021371parcourir

En novembre 2021, Microsoft a publié un modèle de base de vision multimodale Florence (Florence), qui balayait plus de 40 tâches de référence et était facilement applicable à de nombreuses tâches telles que la classification, la détection de cibles, la VQA, la conversation à travers des images, la récupération de vidéos, l'action. tâche de reconnaissance, etc.

Après un an et demi, Florence a officiellement lancé sa phase commerciale !

Que peut faire Florence ?

Récemment, Huang Xuedong, directeur de la technologie mondiale de l'intelligence artificielle de Microsoft, a officiellement annoncé la version préliminaire publique du modèle de base de Microsoft Florence.

Le modèle Florence a été formé avec des milliards de paires texte-image et a été intégré à Azure Cognitive Vision Service. Il a atteint les exigences de « l'environnement de production » en termes de « prix » et de « performances » et est actuellement dans le étape d'essai gratuit.

Les services de vision améliorés permettent aux développeurs de créer des applications de vision par ordinateur de pointe, prêtes à être commercialisées et responsables dans divers secteurs. Les clients peuvent numériser, analyser et connecter en toute transparence leurs données dans des interactions en langage naturel pour extraire des informations plus précises du contenu image et vidéo, protéger les utilisateurs contre les contenus nuisibles, améliorer la sécurité et accélérer la réponse aux incidents.

Les capacités réelles de Florence sont également très puissantes et les utilisateurs peuvent en faire l'expérience « prêt à l'emploi » dans Vision Studio.

Site Web d'expérience : https://portal.vision.cognitive.azure.com/gallery/featured

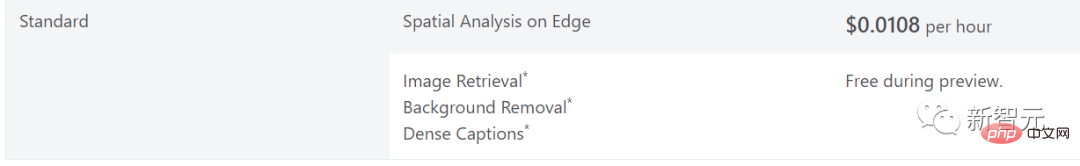

Inclure spécifique :

Légendes denses (description détaillée) : peuvent automatiquement fournir des informations de description riches et des suggestions de conception, accessibles texte alternatif, référencement, gestion intelligente des photos et bien plus encore pour prendre en charge le contenu numérique.

Récupération d'images : utilisez des requêtes en langage naturel pour mesurer de manière transparente les similitudes entre les images et le texte afin d'améliorer les recommandations de recherche et les annonces.

Suppression de l'arrière-plan : les personnes et les objets peuvent être facilement séparés de l'arrière-plan d'origine et remplacés par d'autres scènes d'arrière-plan, modifiant ainsi l'apparence de l'image.

Personnalisation des modèles : réduisez le coût et le temps de livraison de modèles personnalisés pour répondre aux besoins commerciaux uniques avec une plus grande précision, même avec seulement un petit nombre d'images disponibles.

Résumé vidéo : recherchez et interagissez avec le contenu vidéo de la même manière intuitive que les humains pensent et écrivent. Peut aider à trouver du contenu pertinent et ne nécessite aucune métadonnée supplémentaire.

Tiffany Ong, chef de produit produits de consommation Reddit, a déclaré que grâce à la technologie Vision de Microsoft, elle peut permettre aux utilisateurs de découvrir et de comprendre plus facilement le contenu sur Reddit.

Les descriptions d'images nouvellement créées facilitent l'accès des utilisateurs à Reddit, en utilisant des descriptions d'images pour aider les utilisateurs à améliorer les résultats de recherche d'articles, en donnant aux utilisateurs de Reddit plus d'opportunités d'explorer les images sur le site, de participer à des conversations et, finalement, d'établir des connexions et une communauté. détection.

Florence est capable de générer jusqu'à 10 000 balises par image, donnant à Reddit plus de contrôle sur le nombre d'objets dans une image et aidant à générer de meilleures descriptions d'image.

Microsoft 365

En plus de Microsoft Data Center, Microsoft améliore également les capacités des services visuels dans les applications Microsoft 365 (notamment Teams, PowerPoint, Outlook, Word, Designer, OneDrive).

Grâce aux capacités de segmentation d'images, Teams stimule l'innovation dans l'espace numérique et porte l'expérience de réunion virtuelle vers de nouveaux sommets.

PowerPoint, Outlook et Word améliorent l'accessibilité avec des descriptions d'images qui remplacent automatiquement le texte.

Microsoft Designer et OneDrive simplifient la découverte et l'édition des images grâce à des descriptions d'images, une recherche d'images et une génération d'arrière-plan améliorées.

Les centres de données Microsoft exploitent Vision Services pour améliorer la sécurité et la fiabilité de l'infrastructure.

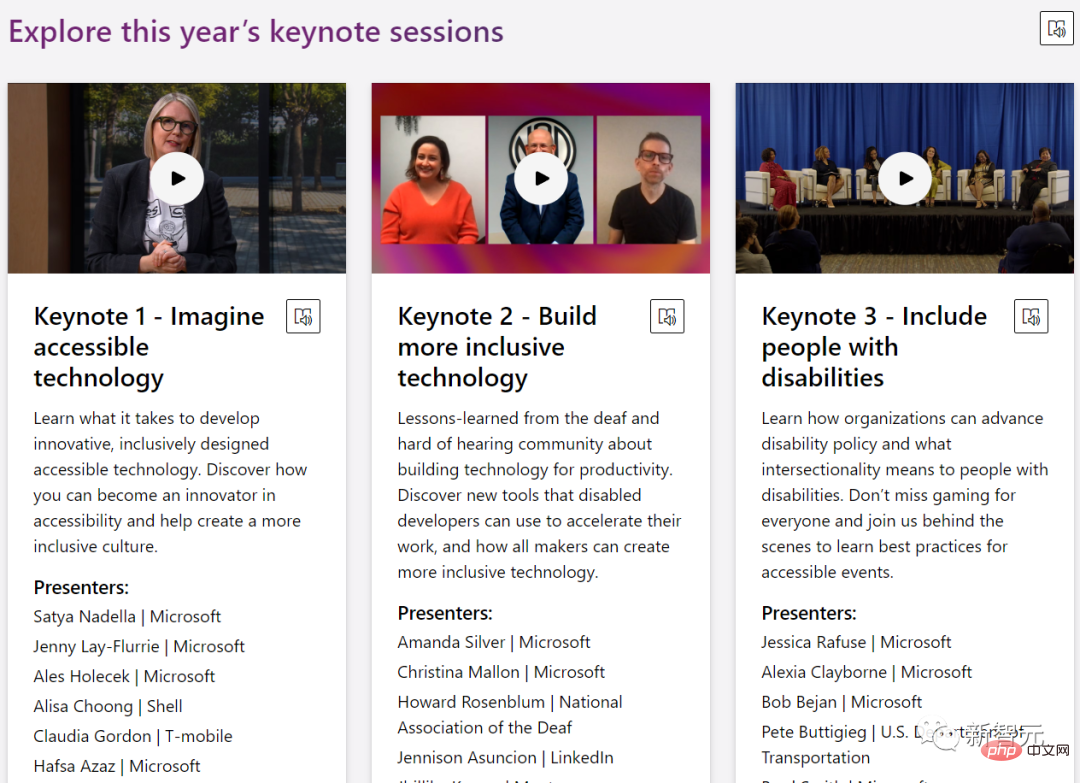

Jennison Asuncon, responsable de l'ingénierie de l'accessibilité chez LinkedIn, a déclaré que plus de 40 % des publications sur LinkedIn contiennent au moins une image. Pour les utilisateurs aveugles ou malvoyants, les services visuels peuvent permettre à tous les utilisateurs de le faire. un accès égal à la lecture et leur permettre de participer aux conversations en ligne.

Avec Azure Visual Cognitive Service, LinkedIn peut fournir une édition automatique de la description d'image et la prise en charge du texte alternatif, ce qui constitue une nouvelle expérience.

Non seulement je suis enthousiasmé par cela, mais mes collègues viennent de partager une photo d'eux-mêmes assistant à l'événement et le PDG de LinkedIn, Ryan Roslansky, était sur la photo.

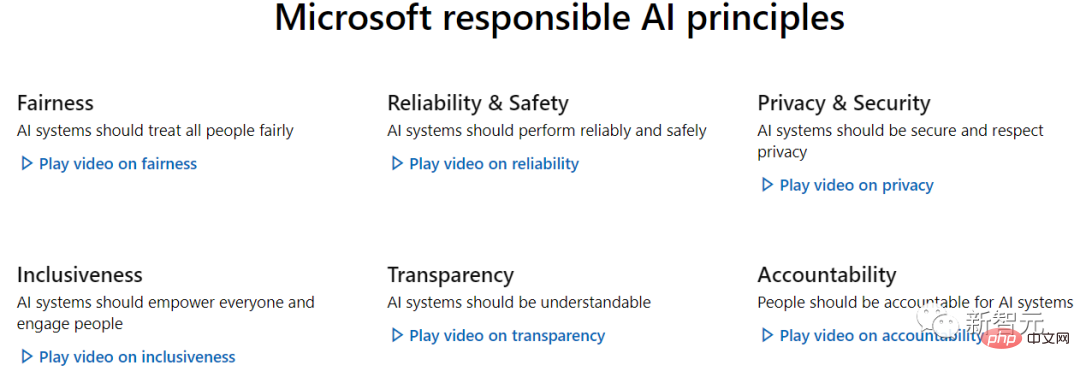

Innover de manière responsable

L'examen des principes d'intelligence artificielle responsable révèle comment Microsoft s'engage à développer des systèmes d'intelligence artificielle pour améliorer l'accessibilité du monde.

Microsoft s'engage à aider les organisations à tirer le meilleur parti de l'intelligence artificielle et investit massivement dans des projets qui fournissent des technologies, des ressources et une expertise pour responsabiliser ceux qui travaillent à créer un monde plus durable, plus sûr et plus accessible.

La multimodalité est l'avenir

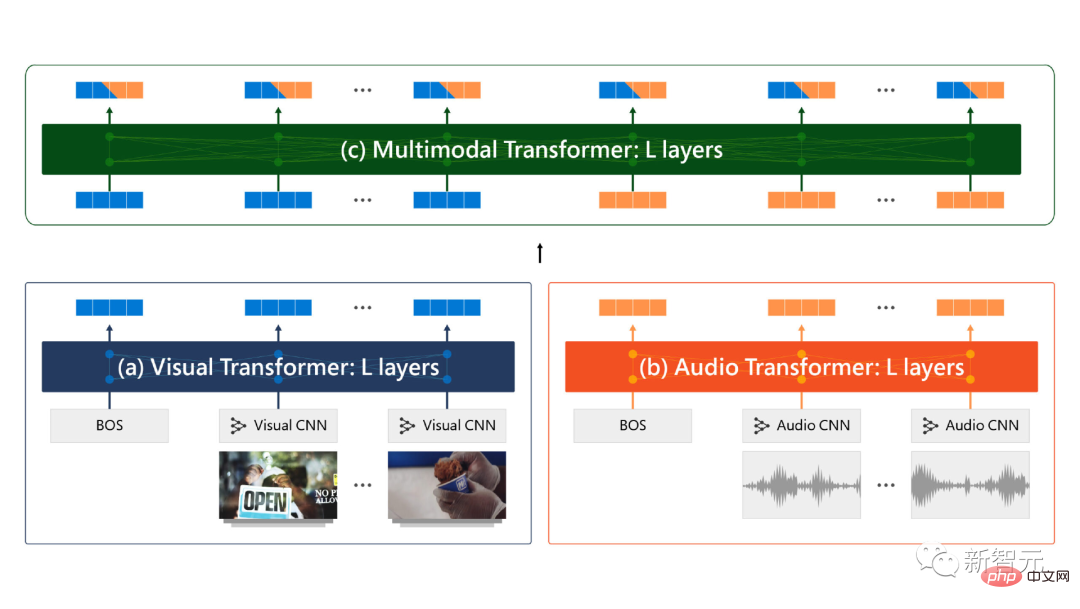

De nombreux géants de la technologie, dont Microsoft et Google, sont étonnamment cohérents dans la direction du développement de l'intelligence artificielle. Ils estiment que les « modèles multimodaux » sont le meilleur moyen d'améliorer les capacités des systèmes d'intelligence artificielle, c'est-à-dire un seul. Le modèle peut comprendre le langage, les images, les vidéos et les audios en même temps, et peut effectuer des tâches que les modèles monomodaux ne peuvent pas accomplir, comme l'ajout de descriptions textuelles aux vidéos.

Pourquoi ne pas enchaîner plusieurs modèles « monomodaux » pour atteindre le même objectif, comme utiliser un modèle pour comprendre les images et un autre modèle pour comprendre le langage ?

La première raison est que, avec les informations de base fournies par d'autres modalités, les modèles multimodaux peuvent être plus performants que les modèles monomodaux sur la même tâche dans certaines situations.

Par exemple, un assistant IA qui comprend les images, les données de prix et l'historique des achats peut fournir de meilleures recommandations de produits personnalisées qu'une IA qui « ne comprend que les données de prix ».

Et d'un point de vue informatique, les modèles multimodaux sont souvent plus efficaces, ce qui peut augmenter la vitesse de traitement des données et réduire les coûts back-end.

Il ne fait aucun doute que toutes les entreprises sont désireuses de réduire leurs coûts et d’augmenter leur efficacité.

Florence est capable de comprendre les images, les vidéos et les langages ainsi que les relations entre ces modalités, afin de pouvoir effectuer certaines tâches qui ne peuvent être accomplies par une seule modalité, comme mesurer la similarité entre les images et le texte, segmenter les objets dans les photos, puis collez-les sur un autre arrière-plan.

Presque toutes les formations de modèles d'IA sont confrontées à des problèmes de droits d'auteur sur les données. John Montgomery, vice-président d'entreprise (CVP) d'Azure AI, n'a pas révélé beaucoup d'informations en répondant sur les « données de formation de Florence ». Il a seulement déclaré que Florence utilisait des « données responsables ». Sources de données « acquises de manière aléatoire », y compris les données des partenaires ; en outre, Montgomery a déclaré que la suppression du contenu potentiellement problématique des données de formation est également une caractéristique courante des ensembles de données de formation publics.

Montgomery estime que lors de l'utilisation d'un modèle de base volumineux, le plus important est de garantir la qualité de l'ensemble de données de formation et de créer une base pour le modèle adaptatif pour chaque tâche visuelle. a passé des tests d'équité, des cas contradictoires et difficiles, et implémente le même service de révision de contenu qu'Azure Open AI Service et DALL-E.

À l'avenir, les consommateurs pourront utiliser Florence pour faire plus, comme détecter les défauts dans le processus de fabrication et permettre le paiement en libre-service dans les magasins de détail.

Cependant, Montgomery souligne que ces cas d'utilisation ne nécessitent pas réellement un modèle de vision multimodale, mais il affirme que la multimodalité peut ajouter quelque chose de précieux dans le processus.

Florence est un modèle visuel "complètement repensé" qui ouvre un tout nouveau monde de possibilités inconnues une fois qu'un processus de traduction simple et de haute qualité est réalisé entre les images et le texte.

Les clients peuvent bénéficier d'une recherche d'images considérablement améliorée, entraîner des modèles d'image et de vision ainsi que d'autres types de modèles tels que le langage et la parole dans des types d'applications entièrement nouveaux et améliorer facilement la qualité des modèles personnalisés.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI