Maison >Périphériques technologiques >IA >Réflexions sur les produits low-code apportés par ChatGPT

Réflexions sur les produits low-code apportés par ChatGPT

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-14 22:46:08712parcourir

Il a été mentionné à plusieurs reprises dans des articles précédents que nous développons une plateforme low-code, principalement à destination des entreprises ToB, pour aider les entreprises à améliorer leur construction d'informatisation et contribuer à leur transformation numérique.

L'objectif de la transformation numérique est de réduire les coûts et d'augmenter l'efficacité. De même, l'efficacité est également cruciale pour nous, ce qui se reflète principalement dans : la capacité à fournir rapidement des prototypes et à communiquer avec les clients avant la vente, une livraison efficace pendant le processus de mise en œuvre, et divers problèmes rencontrés après-vente peuvent recevoir une réponse immédiate.

Récemment, ChatGPT continue d'être populaire et de nouvelles applications peuvent être découvertes chaque jour. Alors, ChatGPT peut-il être combiné avec nos produits low-code ? Ou quel type d’amélioration de l’efficacité cette grande idée de modèle de langage peut-elle apporter au low-code ?

En fait, certains géants l'ont déjà fait.

Salesforce a annoncé le lancement du nouveau produit EinsteinGPT, un produit basé sur la technologie LLM qui s'intègre à la principale application Web de Salesforce et exploite le modèle OpenAI ChatGPT pour aider à suivre la fréquence à laquelle les commerciaux contactent les prospects et rédigent automatiquement des e-mails marketing, sans avoir besoin d'écrire des e-mails manuellement. .

D'autre part, Microsoft a également annoncé l'extension de la technologie ChatGPT à la Power Platform. Power Platform est un produit low-code de Microsoft, présenté dans « Deux livres Low-Code que j'ai lus récemment ». Cela signifie que Power Virtual Agents et AI Builder sur Power Platform ont été mis à jour avec les capacités de codage ChatGPT, permettant aux utilisateurs de développer leurs propres applications avec peu ou pas de codage.

Salesforce l'applique aux capacités commerciales et Microsoft améliore les capacités de la plateforme. Pour nous, ce qui est nécessaire lors de la pré-vente et de la mise en œuvre, c'est de créer rapidement des applications, et le service après-vente doit résoudre les problèmes rapidement. Il y a donc deux directions à suivre :

1.

2. Construisez un système de questions et réponses intelligent.

Les étapes actuelles de mise en œuvre du projet sont les suivantes :

- Après la communication de l'analyste des exigences avec le client, le document d'exigences est compilé.

- Les analystes des exigences effectuent des présentations des exigences aux ingénieurs en construction et aux développeurs.

- Les pièces qui peuvent être implémentées via la configuration sont construites et configurées par des ingénieurs en construction, et d'autres pièces sont personnalisées et développées par les développeurs puis intégrées à la plateforme.

Une fois que les produits low-code auront intégré les capacités de ChatGPT, le système deviendra comme ceci :

- Le système a la capacité de comprendre le langage naturel.

- Le document lui-même formé après analyse de la demande et chat client est décrit en langage naturel.

- Il existe des boîtes de dialogue de discussion et des interactions dans le système.

- Entrez la description de l'exigence dans la boîte de dialogue pour identifier les informations clés. Les informations clés incluent l'identification de l'interface et l'extraction des paramètres.

- Appelez l'interface de la plateforme pour créer des applications ou ajuster des fonctions locales.

- Il suffit de discuter et de terminer le système.

Par exemple : saisie dans la boîte de dialogue pour ajuster la largeur de colonne du nom du projet de la liste actuelle à 500. A ce moment, vous devez être capable d'identifier les paramètres : nom du projet et largeur 500, et savoir que vous devez appeler l'interface pour ajuster la largeur de la colonne.

Une fois que la plate-forme low-code existante a terminé diverses configurations en arrière-plan et cliqué sur Enregistrer, le front-end collecte toutes les données et les transmet à l'interface. L'interface a une granularité relativement grossière et stockera beaucoup de contenu à la fois. Cependant, dans l'exemple ci-dessus, une colonne est ajustée. Le paramètre de largeur de colonne nécessite une interface, ce qui nécessite que l'interface soit très fine. Par conséquent, la transformation de la granularité de l'interface est la première étape pour atteindre l'intelligence.

Comme mentionné ci-dessus, la possibilité d'intégrer ChatGPT n'est pas une interface directe avec ChatGPT, elle reste donc assez difficile à mettre en œuvre. Cependant, il y a un certain temps pour qu'une nouvelle technologie se développe et devienne complètement populaire sur le marché ToB. Tant que la direction est bonne, il est certainement temps de se préparer.

Il existe actuellement plusieurs problèmes dans le processus de mise en œuvre du projet, c'est pourquoi un système de questions intelligent est très important :

- Parce que la plateforme a de nombreuses fonctions et est très flexible, différentes personnes peuvent mettre en œuvre les mêmes besoins, méthodes et approches. sont différents et la charge de travail peut être plusieurs fois différente ;

- Pour divers problèmes de produit rencontrés au cours du processus de mise en œuvre, vous devez demander à des collègues familiers ou consulter l'équipe produit.

La méthode actuelle consiste à rechercher dans les documents. De nombreux documents ont été accumulés au fil des années, tels que : Cas de scénarios commerciaux, manuels d'exploitation, manuels de FAQ de mise en œuvre, etc., mais ils sont basés sur une recherche par mots clés. Utilisez la recherche par mot-clé. Il y a plusieurs problèmes :

- Souvent, je ne sais pas comment extraire des mots-clés.

- Il y a tellement de résultats de recherche qui ne peuvent pas être comparés avec précision. À mesure que le nombre de documents augmente, il est nécessaire de filtrer un grand nombre de résultats.

- Lorsque vous recherchez une solution de construction pour un certain scénario commercial, la correspondance est très mauvaise.

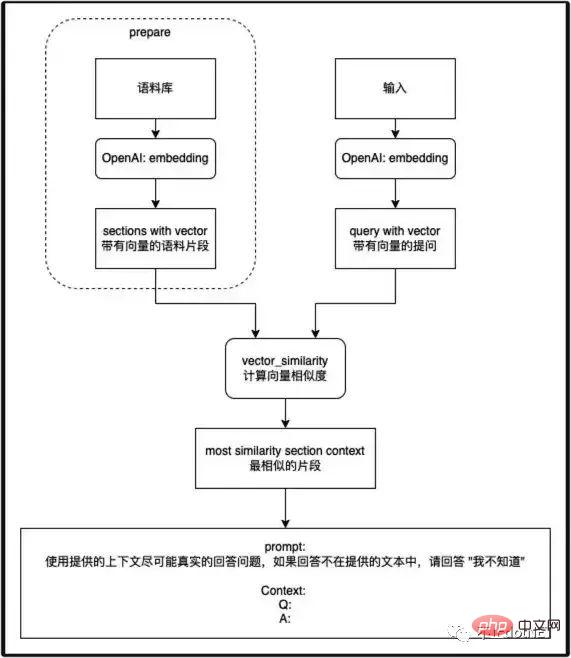

Si vous suivez les idées de ChatGPT, la logique du système intelligent de questions et réponses est la suivante :

- Tous les documents précipités (corpus) génèrent des données vectorielles et les stockent dans la base de données vectorielles.

- Le langage naturel d'entrée génère des vecteurs, calcule la similarité et trouve des résultats pertinents.

- Organisez la sortie.

Concernant cette question, j'ai posé la question à M. Zhang Shanyou sur Knowledge Planet. La photo ci-dessous a été fournie par Zhang Shanyou :

Baoyu a également répondu à des questions similaires sur Twitter :

https://twitter-thread .com. /t/1641656561650249730.

Cependant, les paramètres fournis par Zhang Shanyou et Baoyu reposent tous sur l'interface OpenAI. Existe-t-il un moyen d'y parvenir sans s'appuyer sur OpenAI ? Cela nécessite des études et des recherches plus approfondies.

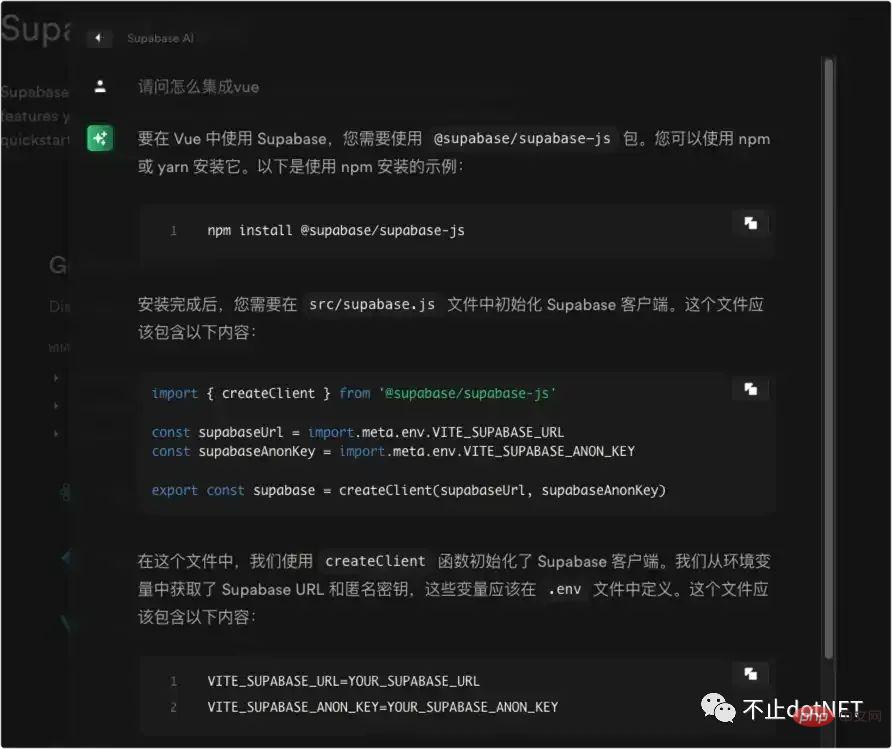

J'ai récemment vu que la documentation du produit Supabase fournit des questions et réponses sur l'IA (https://supabase.com/docs). Cet effet est ce que je souhaite obtenir. En résumé, il s'agit de donner une réponse précise basée sur une saisie en langage naturel.

Le futur est arrivé, les produits comme les individus doivent continuer à apprendre et à évoluer pour ne pas se faire éliminer.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI