Maison >Périphériques technologiques >IA >Pratique d'optimisation des coûts de formation du modèle publicitaire Tencent basé sur le « Tai Chi »

Pratique d'optimisation des coûts de formation du modèle publicitaire Tencent basé sur le « Tai Chi »

- PHPzavant

- 2023-04-14 18:46:031205parcourir

Ces dernières années, les modèles augmentés de big data sont devenus le paradigme standard pour la modélisation dans le domaine de l'IA. Dans la scène publicitaire, les grands modèles utilisent plus de paramètres de modèle et utilisent plus de données de formation. Les modèles ont des capacités de mémoire et de généralisation plus fortes, ouvrant plus d'espace pour améliorer les effets publicitaires. Cependant, les ressources requises pour les grands modèles dans le processus de formation ont également augmenté de façon exponentielle, et la pression de stockage et de calcul constitue d'énormes défis pour la plate-forme d'apprentissage automatique.

La plate-forme d'apprentissage automatique Tencent Taiji continue d'explorer des solutions de réduction des coûts et d'amélioration de l'efficacité. Elle utilise des ressources de déploiement hybrides dans des scénarios de formation publicitaire hors ligne pour réduire considérablement les coûts des ressources. Elle fournit chaque jour à Tencent Advertising des ressources de déploiement hybrides bon marché de 50 W. La formation du modèle hors ligne Tencent Advertising est réduite de 30 % et grâce à une série de méthodes d'optimisation, la stabilité des ressources colocalisées est égale à celle des ressources normales.

1. Introduction

Ces dernières années, alors que les grands modèles ont obtenu un grand succès dans le balayage de diverses commandes de Big Data dans le domaine de la PNL, les modèles Big Data et sont devenus le paradigme standard pour la modélisation dans le domaine de l'IA. La modélisation de la recherche, de la publicité et des recommandations ne fait pas exception. Avec des centaines de milliards de paramètres à chaque tour, les modèles de taille T sont devenus la norme pour les principaux scénarios de prédiction. Les capacités des grands modèles sont également devenues le point central de la course aux armements parmi les principales technologies. entreprises.

Dans la scène publicitaire, les grands modèles utilisent plus de paramètres de modèle et utilisent plus de données de formation. Le modèle a des capacités de mémoire et de généralisation plus fortes, ouvrant plus d'espace pour l'amélioration des effets publicitaires. Cependant, les ressources requises pour les grands modèles dans le processus de formation ont également augmenté de façon exponentielle, et la pression de stockage et de calcul constitue d'énormes défis pour la plate-forme d'apprentissage automatique. Dans le même temps, le nombre d'expériences que la plate-forme peut prendre en charge affecte directement l'efficacité des itérations de l'algorithme. La manière de fournir davantage de ressources expérimentales à moindre coût est au centre des efforts de la plate-forme.

La plate-forme d'apprentissage automatique Tencent Taiji continue d'explorer des solutions de réduction des coûts et d'amélioration de l'efficacité. Elle utilise des ressources de déploiement hybrides dans des scénarios de formation publicitaire hors ligne pour réduire considérablement les coûts des ressources. Elle fournit chaque jour à Tencent Advertising des ressources de déploiement hybrides bon marché de 50 W. La formation du modèle hors ligne Tencent Advertising est réduite de 30 % et grâce à une série de méthodes d'optimisation, la stabilité des ressources colocalisées est la même que celle des ressources normales.

2, Introduction à la plateforme d'apprentissage automatique Taiji

La plateforme d'apprentissage automatique Taiji s'engage à permettre aux utilisateurs de se concentrer davantage sur la résolution de problèmes et les applications de l'IA d'entreprise, et aux ingénieurs en algorithmes de solutions uniques pour proposer le traitement dans le processus de candidature à l'IA, la formation des modèles, le service de modèles et d'autres problèmes d'ingénierie. Actuellement, il prend en charge des activités clés telles que la publicité interne, la recherche, les jeux, Tencent Conference et Tencent Cloud.

Taiji Advertising Platform est une plate-forme d'apprentissage automatique haute performance conçue par Taiji Advertising System qui intègre la formation de modèles et le raisonnement en ligne. La plate-forme possède les capacités de formation et de raisonnement de modèles à mille milliards de paramètres. Actuellement, la plate-forme prend en charge le rappel publicitaire Tencent, le classement approximatif, le classement fin, des dizaines de formations de modèles et l'inférence en ligne en même temps, la plate-forme Taiji fournit un enregistrement de fonctionnalités à guichet unique, un enregistrement supplémentaire d'échantillons, une formation de modèles, une évaluation de modèles et des tests en ligne ; capacités, améliorant considérablement les capacités Améliorer l'efficacité des développeurs.

- Plateforme de formation : Actuellement, la formation de modèles prend en charge deux modes de formation : CPU et GPU En utilisant des opérateurs efficaces auto-développés, une formation de précision mixte, le parallélisme 3D et d'autres technologies, la vitesse de formation est augmentée de 1 par rapport à. l'ampleur des systèmes open source de l'industrie.

- Inference Framework : Le cadre informatique hétérogène HCF (Heterogeneous Computing Framework) auto-développé par Taiji offre une optimisation ultime des performances grâce à l'optimisation conjointe de la couche matérielle, de la couche de compilation et de la couche logicielle.

3. Mise en œuvre spécifique de l'optimisation des coûts

(1) Introduction globale de la solution

Avec le développement continu de la plateforme Taiji, le nombre de tâches et de types de tâches augmentent et les besoins en ressources sont également en augmentation. Afin de réduire les coûts et d'augmenter l'efficacité, la plateforme de Tai Chi, d'une part, améliore les performances de la plateforme et accélère la formation, d'autre part, nous recherchons également des ressources moins chères pour répondre à la demande croissante de ressources ;

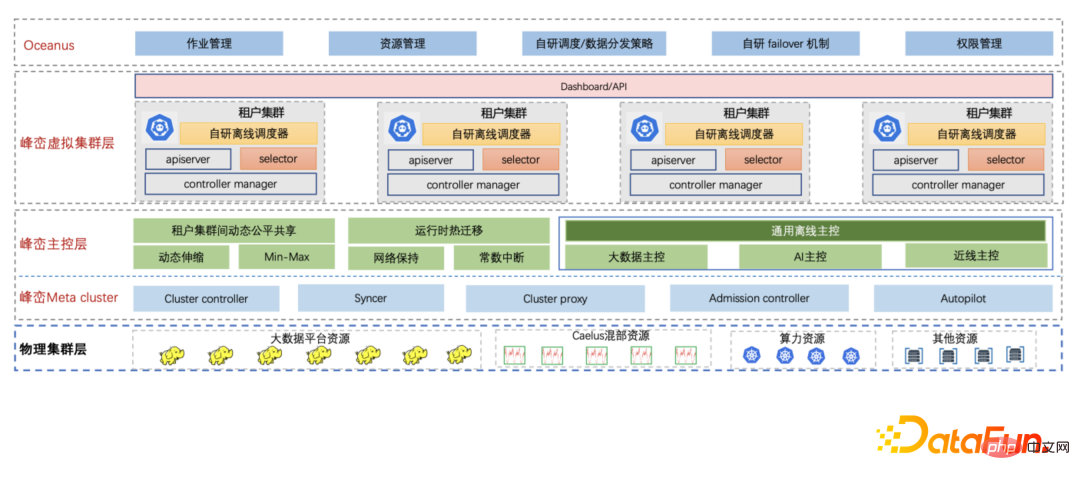

Fengluan - La plate-forme Big Data interne cloud native de Tencent utilise la technologie cloud native pour mettre à niveau l'ensemble de l'architecture Big data de l'entreprise. Afin de répondre à la demande croissante en ressources des entreprises du Big Data, Fengluan a introduit des ressources de colocalisation, qui peuvent non seulement répondre à la demande en ressources, mais également réduire considérablement les coûts des ressources. Fengluan propose une série de solutions pour les ressources de colocalisation dans différents scénarios, transformant les ressources de colocalisation instables en ressources stables et transparentes pour l'entreprise. La capacité de colocalisation de Fengluan prend en charge trois types de ressources de colocalisation :

- Réutilisez les ressources inactives en ligne. En raison des pics et des creux des ressources en ligne, de la surestimation de l'utilisation des ressources et de la fragmentation des ressources du cluster, l'utilisation des ressources du cluster est faible et il existe un grand nombre de ressources inutilisées. Fengluan exploite ces ressources temporairement inutilisées pour exécuter des tâches Big Data et les déploie actuellement dans des scénarios tels que la publicité en ligne, le stockage, les divertissements sociaux et les jeux.

- Prêt flexible de ressources hors ligne. Certaines tâches sur la plate-forme Big Data présentent également un phénomène de marée. Lorsque l'utilisation des ressources du cluster Big Data est faible pendant la journée, Fengluan prend en charge le prêt flexible temporaire de certaines ressources, puis récupère ces ressources avant le pic du cluster Big Data. arrive. Ce scénario est très approprié pour résoudre le problème des tâches en ligne nécessitant temporairement une grande quantité de ressources pendant les vacances et les promotions majeures. Fengluan prend actuellement en charge les grandes fêtes telles que la Fête du Printemps et le 618.

- Réutilisez les ressources informatiques. Les ressources informatiques sont extraites des ressources inutilisées de la machine mica sous la forme d'un CVM de mauvaise qualité. Le CVM dit de mauvaise qualité fait référence au démarrage d'une machine virtuelle CVM avec une priorité CPU inférieure sur cette machine virtuelle. être préempté par d'autres machines virtuelles en temps réel. Sur la base des informations sur les ressources fournies par la puissance de calcul sous-jacente, Fengluan a réalisé de nombreuses optimisations dans des aspects tels que la planification, la protection contre les surcharges et la migration de la puissance de calcul. Actuellement, les tâches Big Data comportant des millions de cœurs s'exécutent de manière stable sur les ressources de puissance de calcul.

Dans le même temps, Fengluan introduit la technologie de cluster virtuel cloud-native pour protéger les caractéristiques de dispersion causées par les ressources de colocalisation sous-jacentes provenant de différentes villes et régions. La plate-forme Taiji se connecte directement au cluster de locataires Fengluan, qui correspond à une variété de ressources de colocalisation sous-jacentes. Le cluster de locataires a une perspective de cluster indépendante et complète, et la plate-forme Taiji peut également être connectée de manière transparente.

(2) Solution de colocalisation de ressources

Ressources inactives en ligne

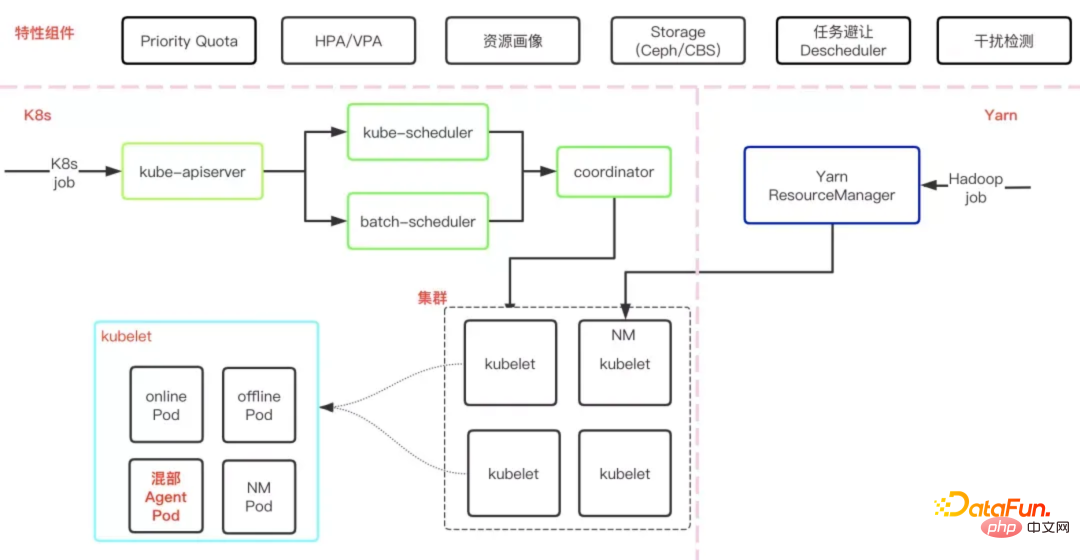

Fengluan a auto-développé la solution de colocalisation hors ligne Caelus pour tous les scénarios, en mélangeant les opérations en ligne et les opérations hors ligne Cette méthode exploite pleinement les ressources inutilisées des machines en ligne, améliore l'utilisation des ressources des machines en ligne et réduit le coût des ressources des opérations hors ligne.

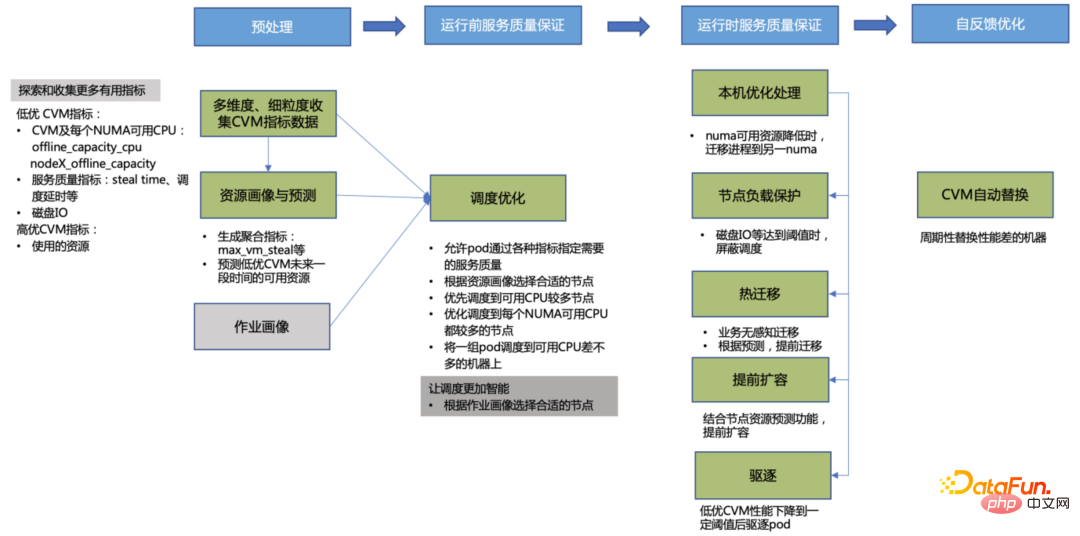

Comme le montre la figure ci-dessous, il s'agit de l'architecture de base de Caelus. Les différents composants et modules coopèrent entre eux pour assurer la qualité du déploiement mixte sous de nombreux aspects.

Tout d'abord, Caelus garantit la qualité de service des opérations en ligne de manière globale, ce qui est également l'une des conditions préalables importantes à la colocalisation. Par exemple, grâce à des mécanismes de détection et de traitement rapides des interférences, il détecte activement. la qualité des services en ligne, les gère en temps opportun et prend en charge la méthode d'extension du plug-in qui prend en charge les exigences spécifiques de détection des interférences de l'entreprise grâce à une isolation complète des ressources, des stratégies de gestion flexibles des ressources, etc., elle garantit la haute qualité des services en ligne ; priorité aux services en ligne.

Deuxièmement, Caelus assure le SLO des emplois hors ligne sous de nombreux aspects, tels que : faire correspondre les ressources appropriées aux emplois via des ressources de colocalisation et des portraits d'emploi hors ligne pour éviter la concurrence des ressources, optimiser les stratégies d'expulsion d'emplois hors ligne, hiérarchiser les expulsions et soutenir une sortie en douceur ; , la stratégie est flexible et contrôlable. Contrairement aux tâches hors ligne Big Data, qui sont pour la plupart des tâches courtes (minutes, voire secondes), la plupart des tâches de Tai Chi prennent plus de temps à s'exécuter (heures, voire jours). Grâce à la prévision des ressources à long terme et aux portraits d'emploi, nous pouvons mieux guider la planification pour trouver des ressources appropriées pour les travaux avec des durées d'exécution différentes et des besoins en ressources différents, et éviter que les emplois ne soient expulsés après avoir fonctionné pendant des heures, voire des jours, entraînant une perte de statut d'emploi. perte de ressources et de temps. Lorsqu'une tâche hors ligne doit être expulsée, la migration dynamique d'exécution sera d'abord utilisée pour migrer l'instance de tâche d'une machine à une autre, tout en gardant l'état de la mémoire et l'adresse IP inchangés. Il n'y aura presque aucun impact sur la tâche, ce qui améliore considérablement la situation. efficacité du travail. Afin de mieux utiliser les ressources de colocalisation, Caelus dispose également de plus de fonctionnalités. Pour plus de détails, consultez la solution de colocalisation hors ligne avec scénario complet de Caelus(https://www.php.cn. /link /caaeb10544b465034f389991efc90877).

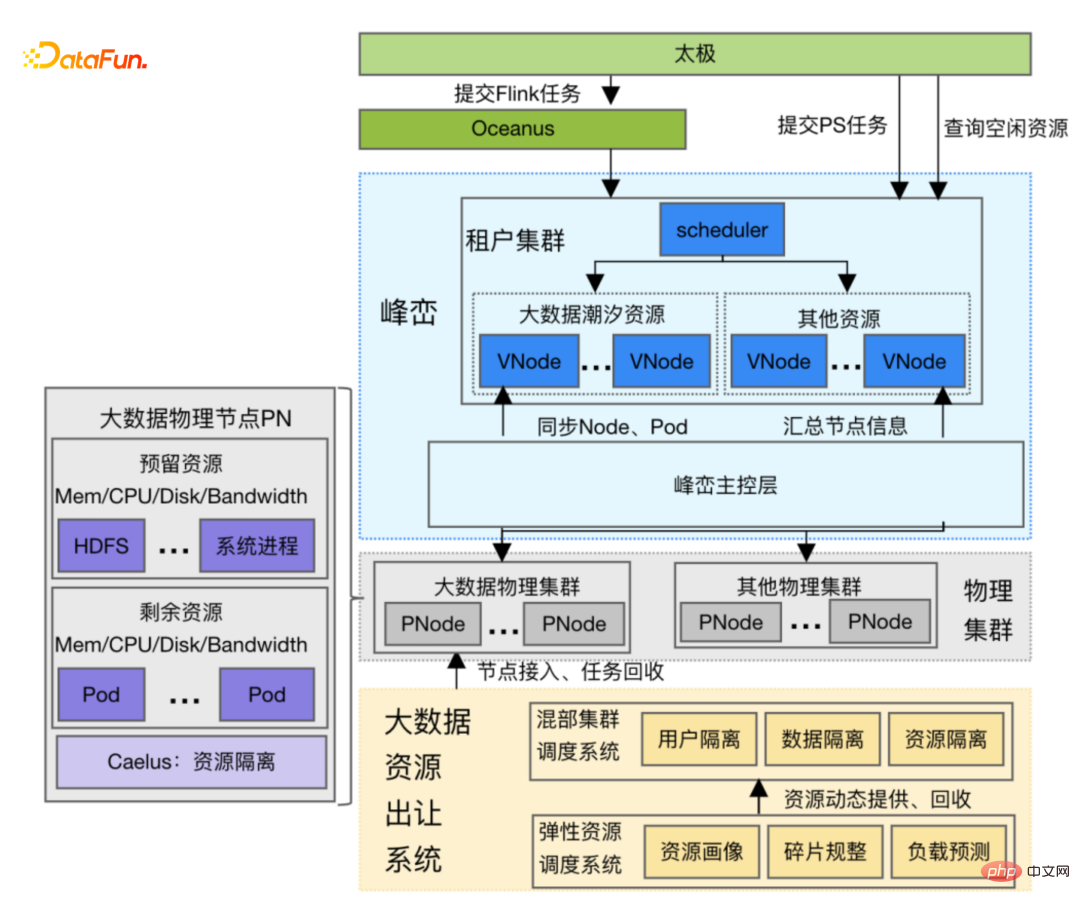

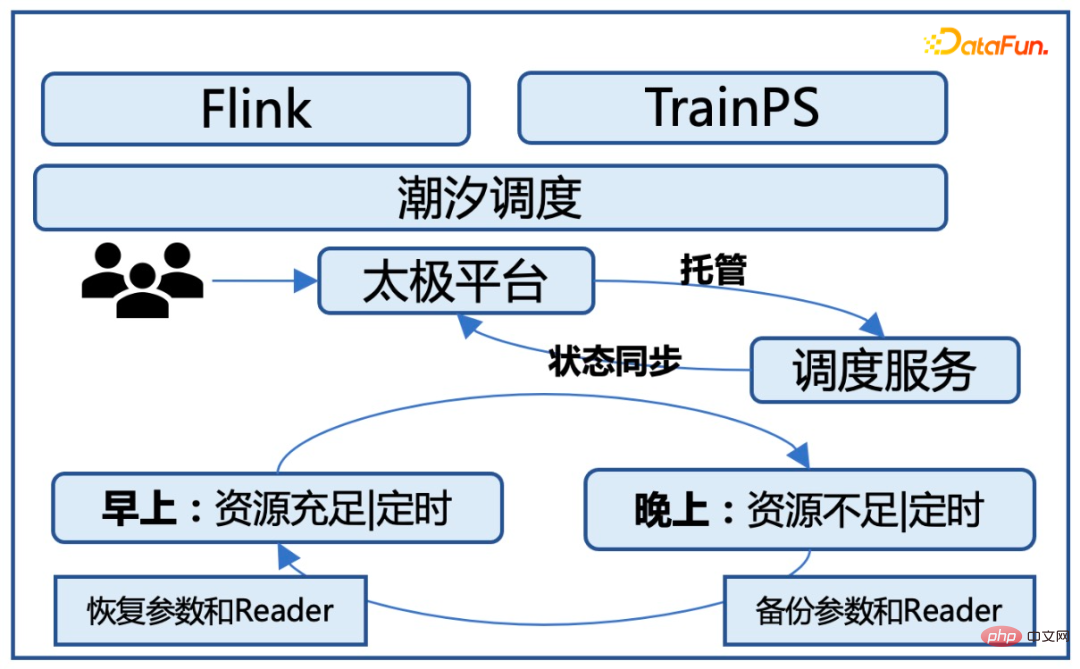

Ressources de marée

Les tâches Big Data ont généralement relativement peu de tâches pendant la journée et plus de tâches la nuit. Fengluan transfère une partie des ressources Big Data inutilisées pendant la journée vers la plate-forme Taiji, et. recycle cette partie les ressources nocturnes, nous appelons cette ressource ressources marémotrices. La caractéristique des ressources Tidal est que les tâches Big Data sur les nœuds sont presque complètement abandonnées, mais le service de stockage Big Data HDFS est toujours conservé sur les nœuds. Le service HDFS ne peut pas être affecté lors de l'exécution de tâches de Tai Chi. Lorsque la plate-forme Taiji utilise des ressources marémotrices, elle doit parvenir à un accord avec la plate-forme Fengluan. La plate-forme Fengluan examinera à l'avance un lot de nœuds sur la base des données historiques à un moment précis. Une fois la tâche Big Data terminée, elle le fera. informez la plate-forme Taiji que de nouveaux nœuds ont rejoint, et la plate-forme Taiji commencera à Le cluster de locataires soumet plus de tâches. Avant l'heure d'emprunt, Fengluan informe Taiji Platform que certains nœuds doivent être recyclés, et Taiji Platform renvoie les nœuds de manière ordonnée.

Comme le montre la figure ci-dessous, l'excavation, la gestion et l'utilisation des ressources marémotrices impliquent la division du travail et la coopération de plusieurs systèmes :

- Système de transfert de ressources Big Data : ce système trouvera le nœud de machine le plus approprié pour être hors ligne sur la base de l'algorithme d'apprentissage automatique en fonction des différentes conditions d'exécution des tâches sur chaque machine et des données de fonctionnement du cluster au cours de la période écoulée. Répondez aux besoins spécifiques en ressources et ayez un impact minimal sur les tâches en cours d'exécution, puis interdisez la planification de nouvelles tâches sur ces nœuds et attendez la fin des tâches en cours d'exécution sur les nœuds pour minimiser l'impact sur les tâches Big Data.

- Système de colocalisation Caelus : Bien que les opérations Big Data ne s'exécutent plus sur les ressources de la machine libérées par le système de transfert, les services HDFS fonctionnent toujours sur celles-ci et des services de lecture et d'écriture de données sont fournis. Afin de protéger le service HDFS, le système de colocalisation Caelus est introduit, utilisant HDFS comme service en ligne et garantissant que la qualité du service HDFS n'est pas affectée grâce à la série de méthodes d'assurance de service en ligne de Caelus (telles que la détection s'il est affecté via les indicateurs clés HDFS).

- Utilisez les ressources Tidal via des clusters virtuels : Ces ressources machine transférées seront gérées et planifiées uniformément par Fengluan, et fournies à la plateforme Taichi sous forme de clusters virtuels, fournissant des interfaces natives K8S. La plate-forme supérieure protège les différences entre les ressources sous-jacentes pour garantir que les applications utilisent les ressources de la même manière.

- Connecté à la formation de reprise des points d'arrêt de la couche d'application : Les ressources de marée seront recyclées la nuit pour exécuter des tâches Big Data. Afin de réduire l'impact du recyclage, les fonctions de formation de reprise des points d'arrêt de la couche d'application ont été mises en œuvre. Ouvrez-vous pour réaliser un changement de ressources sans interrompre la formation, et le fonctionnement continu de l'entreprise ne sera pas affecté après le changement.

Ressources informatiques

La caractéristique des ressources informatiques est qu'elles présentent un CVM exclusif à l'entreprise, qui est plus convivial pour le côté business. Cependant, le défi de l'utilisation des ressources informatiques est que les ressources CPU du CVM de mauvaise qualité au niveau de la machine mica seront supprimées à tout moment par le CVM en ligne, ce qui entraînera des ressources informatiques très instables :

- La machine informatique est instable : la machine informatique sera instable en raison de la fragmentation. Elle s'est déconnectée en raison de la consolidation des ressources et d'une puissance insuffisante dans la salle informatique.

- Faible priorité des ressources informatiques : afin de garantir que la qualité de service des machines CVM normales n'est pas affectée, les tâches sur les ressources informatiques ont la priorité la plus basse et céderont inconditionnellement aux tâches sur les ressources de haute qualité, ce qui entraînera des problèmes extrêmement performances instables.

- Fréquence d'expulsion élevée : diverses raisons (performances insuffisantes des ressources informatiques, espace disque insuffisant, disque bloqué, etc.) déclencheront l'expulsion active des pods, augmentant ainsi la probabilité de défaillance des pods.

Afin de résoudre le problème de l'instabilité des ressources informatiques, diverses capacités sont étendues à travers la couche de contrôle principale de pointe, et les ressources informatiques sont optimisées sous de nombreux aspects pour améliorer la stabilité de la puissance de calcul :

① Portrait des ressources et prédiction : Explorez et collectez divers indicateurs de performances de la machine, générez des indicateurs agrégés et prédisez les ressources disponibles du CVM faiblement optimal à l'avenir. Ces informations sont utilisées par le planificateur pour planifier les pods et l'expulsion. composant pour expulser les pods afin de répondre aux exigences en ressources du pod.

② Optimisation de la planification : Afin d'assurer la qualité de service des opérations de Tai Chi, en fonction des besoins du travail et des caractéristiques des ressources, il existe de nombreuses optimisations dans la stratégie de planification, ce qui améliore la performance du travail. de plus de 2 fois.

- Planification intra-urbaine : la planification des tâches PST et de formation dans la même salle informatique dans la même ville minimise le délai réseau entre les instances de tâche, et le coût de la bande passante réseau dans la même ville est également inférieur, ce qui réduit les coûts.

- Optimisation de la planification sur une seule machine : en combinaison avec les résultats de la prévision des ressources et des indicateurs tels que le temps de vol du processeur, sélectionnez un processeur offrant de meilleures performances pour le travail et liez les cœurs pour mieux améliorer les performances du travail.

- Planification graduée : étiquetez et notez automatiquement toutes les ressources gérées, et planifiez automatiquement les tâches ayant des exigences élevées en matière de reprise après sinistre, telles que Job Manager, sur des ressources relativement stables.

- Ajustez les paramètres de planification : sur la base des portraits de ressources et des données de prévision, le planificateur donne la priorité aux nœuds offrant de meilleures performances et plus de stabilité pour les tâches. De plus, afin de résoudre le problème d'expiration d'échelon causé par des étapes incohérentes, les instances du même travail sont planifiées sur des machines ayant des performances similaires

③ Assurance qualité du service d'exécution

- Présentation de la chaleur d'exécution dans la phase d'expulsion active Migration, de sorte que l'entreprise soit fondamentalement imperceptible : afin de résoudre les problèmes d'instabilité des ressources et de destruction d'applications en raison de l'expulsion de pods, une migration à chaud d'exécution est mise en œuvre et une variété de stratégies de migration à chaud sont fournies pour répondre les besoins de différents scénarios. Selon les données en ligne actuelles, lors de l'utilisation de la stratégie de priorité de migration, pour les conteneurs dotés d'une grande mémoire, le temps d'interruption de la migration en direct est supérieur à 10 secondes. Nous avons également implémenté un temps d'interruption constant indépendant de la taille de la mémoire (une stratégie axée sur la récupération). Actuellement, plus de 20 000 pods sont activement migrés avec succès chaque jour et la migration à chaud entre clusters est prise en charge, ce qui réduit considérablement l'impact de l'expulsion.

- Optimisez la stratégie d'expulsion pour minimiser l'impact de l'expulsion : lorsque chaque machine est expulsée, les pods démarrés après l'expulsion sont prioritaires pour éviter d'affecter les tâches déjà démarrées. Chaque tâche n'expulse qu'un nœud à la fois. empêche l'expulsion simultanée de l'amont et de l'aval d'une tâche unique, provoquant des redémarrages au niveau de la tâche ; lorsqu'un pod est expulsé, il se connecte au framework Flink de couche supérieure et informe de manière proactive Flink pour une récupération rapide en un seul point.

④ Optimisation de l'auto-feedback : grâce au profilage des ressources, les machines aux performances médiocres sont périodiquement remplacées et connectées à la plate-forme sous-jacente pour obtenir une séparation en douceur du CVM, donnant aux sommets et aux montagnes la possibilité de n'avoir aucun impact sur l'entreprise Migrez les instances d'application une par une pour réduire l'impact sur les instances.

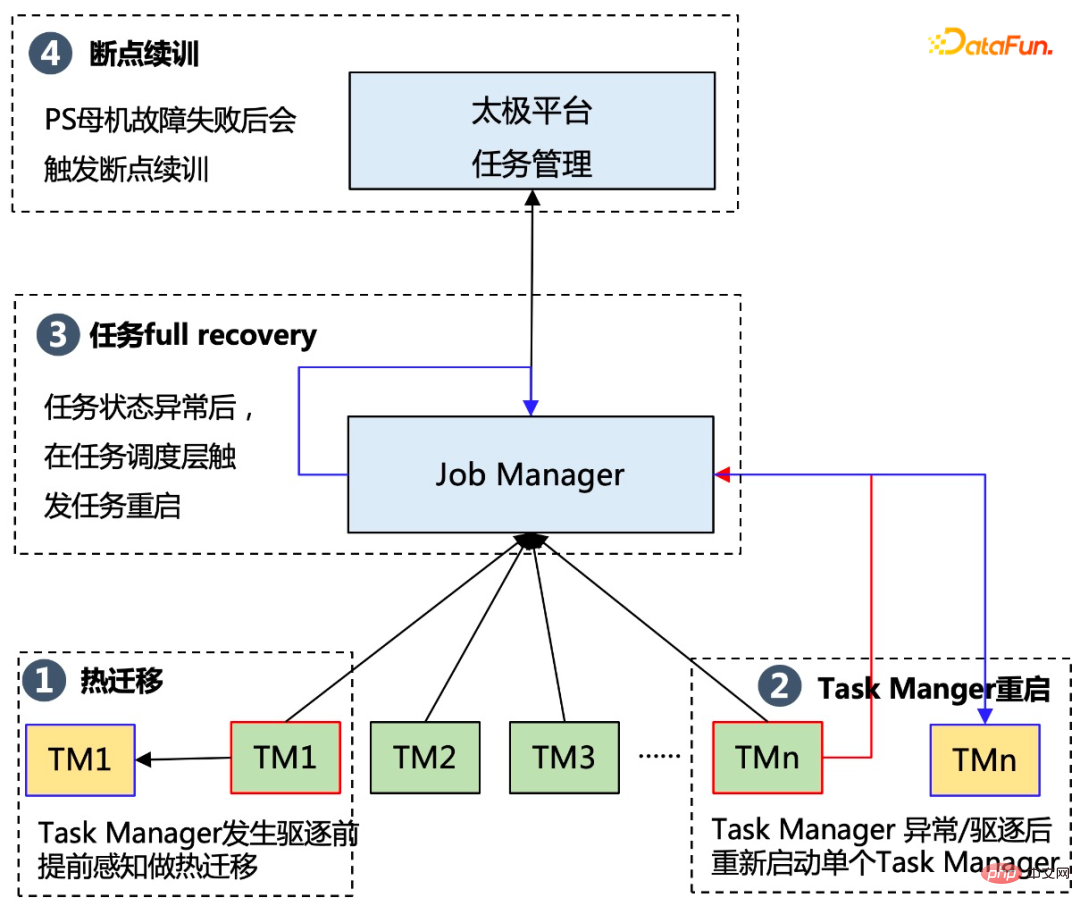

⑤ Améliorez la capacité de reprise après sinistre de la couche Flink, prenez en charge le redémarrage en un seul point et la planification hiérarchique

La capacité de redémarrage en un seul point de TM (Task Manager) évite l'échec de la tâche provoquant l'échec de l'ensemble du DAG et peut mieux s'adapter à l'informatique Il possède des fonctionnalités de prévention des forces ; la planification hiérarchique évite les attentes de travail excessives causées par la planification des gangs et évite le gaspillage lié à une application excessive des TM Pods.

(3) Solution d'optimisation de la couche d'application

Tolérance aux pannes commerciales

Une condition préalable majeure à l'utilisation de ressources bon marché pour les tâches de formation hors ligne est qu'elle ne peut pas affecter le fonctionnement normal des tâches d'origine sur les ressources, donc les ressources de colocalisation présentent les défis clés suivants :

- La plupart des ressources de colocalisation sont des ressources temporaires et seront fréquemment hors ligne

- Les ressources de colocalisation céderont inconditionnellement aux ressources de haute qualité, entraînant des performances de machine extrêmement instables ;

- Ressources de colocalisation Le mécanisme d'expulsion automatique augmente également considérablement la probabilité de défaillance des nœuds et des pods.

Afin de garantir que les tâches peuvent s'exécuter de manière stable sur les ressources de colocalisation, la plateforme utilise une stratégie de tolérance aux pannes à trois niveaux. Les solutions spécifiques sont les suivantes :

.- Technologie de migration à chaud : avant que le gestionnaire de tâches ne soit sur le point d'être expulsé, il détecte à l'avance et migre le gestionnaire de tâches correspondant vers un autre pod en même temps, il utilise la compression de mémoire, la concurrence de streaming, la migration à chaud entre clusters et ; d'autres fonctionnalités pour optimiser en permanence le succès de la migration à chaud.

- Redémarrage du gestionnaire de tâches : lorsqu'un gestionnaire de tâches dans la tâche échoue en raison d'une exception ou d'une expulsion, la tâche entière n'échouera pas et ne se terminera pas directement. Au lieu de cela, l'état du gestionnaire de tâches sera enregistré en premier, puis celui du gestionnaire de tâches. sera redémarré, réduisant ainsi la probabilité d’échec de l’ensemble de la tâche.

- Récupération complète de la tâche : Lorsqu'une tâche est dans un état irrécupérable en raison d'un statut Flink anormal, le redémarrage du Job Manager sera déclenché. Afin d'assurer la stabilité du Job Manager, la plateforme déploie le Job Manager dans. un emplacement indépendant avec une bonne stabilité en termes de ressources, assurez-vous que le statut de la tâche est normal.

- Reprise de l'entraînement aux points d'arrêt : Si les stratégies de tolérance aux pannes précédentes échouent, la plateforme redémarrera la tâche en fonction d'un certain ckpt dans l'historique.

Grâce à la tolérance aux pannes de la couche métier, la stabilité des tâches exécutées sur des ressources de colocalisation est passée de moins de 90 % initialement à 99,5 % à la fin, ce qui est fondamentalement la même que la stabilité des tâches exécutées. sur des ressources ordinaires exclusives.

Planification des tâches par marée

Selon les besoins en ressources de marée, les tâches de formation hors ligne ne peuvent être utilisées que pendant la journée et doivent être fournies pour une utilisation professionnelle en ligne la nuit. Par conséquent, la plate-forme de Tai Chi doit démarrer automatiquement la formation. tâches en fonction de la disponibilité des ressources pendant la journée ; la nuit Effectuer une veille froide pour la tâche et arrêter en même temps la tâche de formation correspondante. Dans le même temps, la priorité de chaque planification de tâche est gérée via la file d'attente de gestion des tâches. Les nouvelles tâches démarrées la nuit entreront automatiquement dans l'état de file d'attente et attendront que de nouvelles tâches soient démarrées le lendemain matin.

Défi principal :

- Phénomène de marée : des ressources peuvent être fournies pour des tâches hors ligne pendant la journée et doivent être recyclées la nuit.

- Changements dynamiques des ressources : Pendant la journée, les ressources sont également instables et changeront à tout moment. Généralement, les ressources sont relativement faibles le matin, puis les ressources augmentent progressivement et les ressources atteignent un pic la nuit.

Solution :

- Stratégie de planification tenant compte des ressources : à mesure que les ressources augmentent progressivement le matin, le service de planification des marées doit détecter les changements de ressources et suivre les conditions des ressources pour démarrer les tâches afin de poursuivre la formation.

- Capacité de sauvegarde automatique du modèle : avant le recyclage des ressources la nuit, toutes les tâches exécutées sur la plate-forme actuelle doivent être sauvegardées étape par étape, cela exerce beaucoup de pression sur le stockage et la bande passante de la plate-forme, car il y en a. Il y a des centaines de tâches sur la plateforme. La taille de la veille froide pour chaque tâche varie de quelques centaines de Go à plusieurs téraoctets. Si la veille froide est effectuée en même temps, des centaines de téraoctets de données doivent être transmis et stockés en un temps record. le temps, ce qui représente un énorme défi pour le stockage et le réseau ; il est donc nécessaire d'avoir une stratégie de planification raisonnable et de stocker progressivement le modèle.

- Capacité de planification intelligente des ressources : par rapport à la formation traditionnelle, la planification des marées entraîne une surcharge supplémentaire lorsqu'il s'agit de sauvegarder le modèle pour le recyclage des ressources la nuit et lorsque la tâche est recommencée chaque matin afin de réduire cette surcharge supplémentaire. Lorsque nous planifions, nous devons évaluer quelles tâches peuvent être accomplies le même jour et quelles tâches doivent être exécutées sur plusieurs jours. Pour les tâches qui peuvent être accomplies le même jour, nous accordons la priorité à leur allouer davantage de ressources pour garantir. que les tâches soient terminées le même jour.

Grâce à ces optimisations, nous pouvons garantir que les tâches peuvent s'exécuter de manière stable sur les ressources de marée et ignorent fondamentalement la couche métier. Dans le même temps, la vitesse d'exécution de la tâche ne sera pas grandement affectée et la surcharge supplémentaire causée par la planification du démarrage et de l'arrêt des tâches est contrôlée dans la limite de 10 %.

4. Effets en ligne et perspectives d'avenir

La solution d'optimisation de la distribution hybride hors ligne de Tai Chi a été mise en œuvre dans les scénarios publicitaires de Tencent. Elle fournit des ressources de déploiement hybrides de base de 30 W et des ressources de marée de base de 20 W pour la recherche et le modèle de publicité hors ligne de Tencent. formation quotidienne pour prendre en charge le rappel publicitaire, mise en page approximative, formation de modèles multi-scénarios de mise en page fine. En termes de coût en ressources, pour des tâches avec la même charge de calcul, le coût en ressources du déploiement hybride est 70 % de celui des ressources ordinaires. Après optimisation, la stabilité du système et le taux de réussite des tâches du cluster physique sont fondamentalement les mêmes.

À l'avenir, d'une part, nous continuerons d'augmenter l'utilisation de ressources informatiques hybrides, en particulier l'application de ressources informatiques hybrides, d'autre part, les activités en ligne de l'entreprise deviennent basées sur des GPU, donc dans l'application de ressources mixtes, en plus des ressources CPU traditionnelles, il essaiera également d'utiliser les ressources GPU en ligne lors de la formation hors ligne.

C'est tout pour le partage d'aujourd'hui, merci à tous.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI