Maison >Périphériques technologiques >IA >Pour la première fois, le « directeur pédagogique » est introduit dans la distillation modèle, et la compression à grande échelle est meilleure que 24 méthodes SOTA.

Pour la première fois, le « directeur pédagogique » est introduit dans la distillation modèle, et la compression à grande échelle est meilleure que 24 méthodes SOTA.

- PHPzavant

- 2023-04-14 15:46:031095parcourir

Face à des modèles de deep learning de plus en plus approfondis et au big data vidéo massif, les algorithmes d’intelligence artificielle sont de plus en plus dépendants des ressources informatiques. Afin d'améliorer efficacement les performances et l'efficacité des modèles profonds, en explorant la distillabilité et la parcimonie du modèle, cet article propose une technologie de compression de modèle unifiée basée sur le modèle « Doyen-enseignant-étudiant ».

Cette réalisation a été réalisée par une équipe de recherche conjointe du People's College of Science and Technology et de l'Institut d'automatisation de l'Académie chinoise des sciences. L'article pertinent a été publié dans la principale revue internationale sur l'intelligence artificielle, IEEE Transactions. sur l'analyse de modèles et l'intelligence artificielle (TPAMI). Cette réalisation est la première fois que le rôle de « directeur pédagogique » est introduit dans la technologie de distillation de modèles, unifiant la distillation et la personnalisation de modèles profonds.

Adresse papier : https://ieeexplore.ieee.org/abstract/document/9804342

Actuellement, ce résultat a été appliqué au moteur de recherche intelligent multimodal développé indépendamment par People's Science et Technologie. "Baize" brise les barrières d'expression de l'information entre différentes modalités telles que les graphiques, le texte, l'audio et la vidéo, et mappe différentes informations modales telles que le texte, les images, la voix et la vidéo dans un espace de représentation de fonctionnalités unifié, avec la vidéo comme noyau, l'apprentissage modalités multiples Une mesure de distance unifiée peut être utilisée pour combler le fossé sémantique du contenu multimodal tel que le texte, la voix et la vidéo afin d'obtenir des capacités de recherche unifiées.

Cependant, face aux données Internet massives, notamment vidéo big data, la consommation de ressources informatiques par les modèles profonds multimodaux augmente progressivement. Sur la base de ces résultats de recherche, « Baize » peut compresser la taille du modèle à grande échelle tout en garantissant les performances de l'algorithme, obtenant ainsi des capacités de compréhension et de recherche intelligentes multimodales à haut débit et à faible consommation. Selon des applications pratiques préliminaires, cette technologie peut comprimer l’échelle des paramètres des grands modèles de plus de quatre fois en moyenne. D'une part, cela peut réduire considérablement la consommation du modèle en ressources informatiques hautes performances telles que les serveurs GPU. D'autre part, les grands modèles qui ne peuvent pas être déployés en périphérie peuvent être distillés et compressés pour obtenir un déploiement à faible consommation en périphérie. bord.

Cadre d'apprentissage fédéré pour la compression de modèles

La compression et l'accélération de modèles d'algorithmes profonds peuvent être obtenues grâce à l'apprentissage par distillation ou au découpage clairsemé structuré, mais il existe certaines limites dans les deux domaines. Pour la méthode d'apprentissage par distillation, elle vise à former un modèle léger (c'est-à-dire un réseau d'étudiants) pour simuler un modèle complexe et volumineux (c'est-à-dire un réseau d'enseignants). Sous la direction du réseau d'enseignants, le réseau d'étudiants peut obtenir de meilleures performances que la formation seule.

Cependant, les algorithmes d'apprentissage par distillation se concentrent uniquement sur l'amélioration des performances des réseaux d'étudiants et ignorent souvent l'importance de la structure du réseau. La structure du réseau étudiant est généralement prédéfinie et fixée au cours du processus de formation.

Pour le découpage clairsemé structuré ou le découpage de filtre, ces méthodes visent à découper un réseau redondant et complexe en un réseau clairsemé et compact. Cependant, le recadrage modèle n’est utilisé que pour obtenir une structure compacte. Aucune des méthodes existantes n'utilise pleinement les « connaissances » contenues dans le modèle complexe original. Des recherches récentes combinent l'apprentissage par distillation avec un élagage clairsemé structuré afin d'équilibrer les performances et la taille du modèle. Mais ces méthodes se limitent à de simples combinaisons de fonctions de perte.

Afin d'analyser les problèmes ci-dessus en profondeur, cette étude a d'abord formé le modèle sur la base de la détection compressée. En analysant les performances et la structure du modèle, il a été constaté qu'il existe deux attributs importants pour les modèles d'algorithmes profonds : la distillabilité (distillabilité). ) et la parcimonie (sparsabilité).

Plus précisément, la distillabilité fait référence à la densité de connaissances efficaces qui peuvent être distillées à partir du réseau d'enseignants. Elle peut être mesurée par les gains de performance réalisés par le réseau d’étudiants sous la direction du réseau d’enseignants. Par exemple, les réseaux d’étudiants ayant une distillabilité plus élevée peuvent atteindre des performances plus élevées. La distillabilité peut également être analysée quantitativement au niveau de la couche réseau.

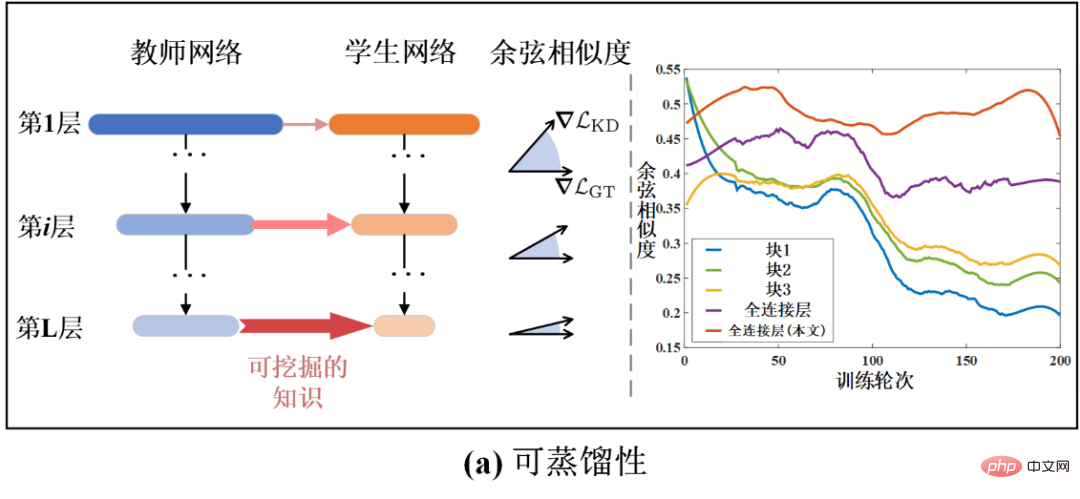

Comme le montre la figure 1-(a), le graphique à barres représente la similarité cosinus (similarité cosinus) entre le gradient de perte d'apprentissage par distillation et le gradient de perte de classification de valeur réelle. Une similarité cosinus plus grande indique que la connaissance de la distillation actuelle est plus utile pour les performances du modèle. De cette manière, la similarité cosinus peut également être une mesure de distillabilité. Il ressort de la figure 1-(a) que la distillabilité augmente progressivement à mesure que le nombre de couches de modèle devient plus profond. Cela explique également pourquoi la supervision couramment utilisée dans l’apprentissage de la distillation est appliquée dans les dernières couches du modèle. De plus, selon les cycles de formation, le modèle étudiant a également une distillabilité différente, car la similarité cosinusoïdale change également à mesure que le temps de formation change. Par conséquent, il est nécessaire d’analyser dynamiquement la distillabilité des différentes couches au cours du processus de formation.

D'autre part, la parcimonie fait référence au taux de recadrage (ou taux de compression) que le modèle peut obtenir avec une perte de précision limitée. Une plus grande séparabilité correspond au potentiel de taux de culture plus élevés. Comme le montre la figure 1-(b), différentes couches ou modules du réseau présentent une séparabilité différente. Semblable à la distillabilité, la séparabilité peut également être analysée au niveau de la couche réseau et dans la dimension temporelle. Cependant, il n’existe actuellement aucune méthode pour explorer et analyser la distillabilité et la raréfaction. Les méthodes existantes utilisent souvent un mécanisme d’entraînement fixe, ce qui rend difficile l’obtention d’un résultat optimal.

Figure 1 Diagramme schématique de la distillabilité et de la séparabilité des réseaux de neurones profonds

Afin de résoudre les problèmes ci-dessus, cette étude a analysé le processus de formation de la compression du modèle pour obtenir des informations sur la distillabilité et les résultats liés à la séparabilité. Inspirée par ces résultats, cette étude propose une méthode de compression de modèles basée sur l'apprentissage conjoint de la distillabilité dynamique et de la parcimonie. Il peut combiner dynamiquement l'apprentissage de la distillation et le découpage clairsemé structuré, et ajuster de manière adaptative le mécanisme de formation conjoint en apprenant la distillabilité et la parcimonie. Différent du cadre classique « Enseignant-Étudiant », la méthode proposée dans cet article peut être qualifiée de cadre « Apprentissage à l'école » car elle contient trois modules majeurs : Réseau d'enseignants, Réseau d'étudiants et Réseau de doyens.

Plus précisément, comme avant, le réseau d'enseignants enseigne au réseau d'élèves. Le réseau des directeurs pédagogiques est chargé de contrôler l’intensité de l’apprentissage en ligne des étudiants et la manière dont ils apprennent. En obtenant le statut du réseau d'enseignants et du réseau d'étudiants actuels, le réseau des doyens peut évaluer la distillabilité et la rareté du réseau d'étudiants actuel, puis équilibrer et contrôler dynamiquement la force de la supervision de l'apprentissage de la distillation et de la supervision structurée de l'écrêtage clairsemé.

Afin d'optimiser la méthode dans cet article, cette recherche propose également un algorithme d'optimisation conjoint de l'apprentissage de la distillation & du clipping basé sur la méthode du multiplicateur de direction alternée pour mettre à jour le réseau étudiant. Afin d’optimiser et de mettre à jour le réseau des directeurs pédagogiques, cet article propose un algorithme d’optimisation des directeurs pédagogiques basé sur le méta-apprentissage. La distillabilité peut à son tour être influencée en ajustant dynamiquement le signal de supervision. Comme le montre la figure 1-(a), la méthode présentée dans cet article s'avère capable de retarder la tendance à la baisse de la distillabilité et d'améliorer la distillabilité globale en utilisant rationnellement les connaissances en matière de distillation.

Le cadre global de l'algorithme et l'organigramme de la méthode de cet article sont présentés dans la figure ci-dessous. Le cadre contient trois modules principaux : le réseau d'enseignants, le réseau d'étudiants et le réseau de directeurs pédagogiques. Parmi eux, le réseau redondant complexe initial à compresser et à réduire est considéré comme le réseau des enseignants, et dans le processus de formation ultérieur, le réseau d'origine qui se raréfie progressivement est considéré comme le réseau des étudiants. Le réseau des doyens est un méta-réseau qui saisit les informations du réseau d'enseignants et du réseau d'étudiants pour mesurer la distillabilité et la rareté actuelles, contrôlant ainsi l'intensité de supervision de l'apprentissage et de la rareté de la distillation.

De cette manière, à chaque instant, le réseau étudiant peut être guidé et dispersé par des connaissances distillées de manière dynamique. Par exemple, lorsque le réseau étudiant a une distillabilité plus élevée, le doyen laissera un signal de supervision de distillation plus fort guider le réseau étudiant (voir le signal flèche rose dans la figure 2 au contraire, lorsque le réseau étudiant a une propriété de rareté plus élevée) ; le doyen exercera un signal de supervision clairsemé plus fort sur le réseau étudiant (voir le signal de la flèche orange dans la figure 2).

Figure 2 Diagramme schématique de l'algorithme de compression de modèle basé sur l'apprentissage conjoint de la distillabilité et de la rareté

Résultats expérimentaux

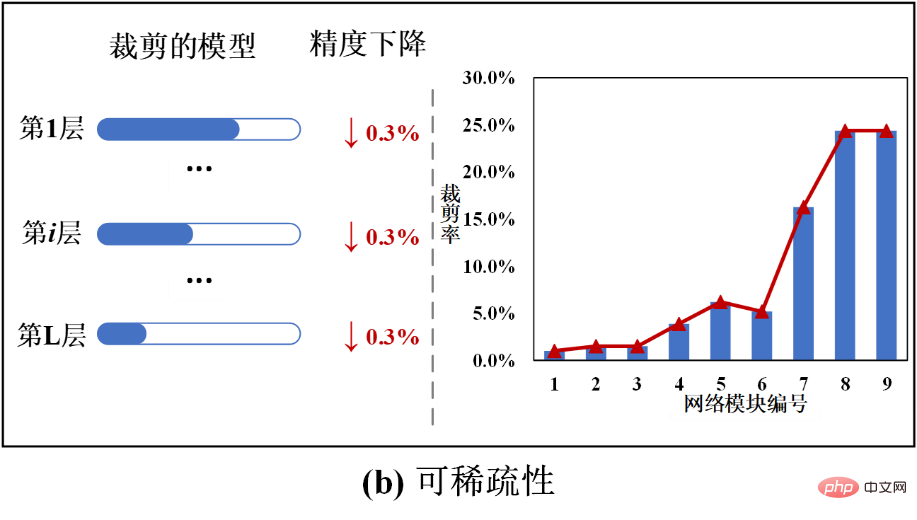

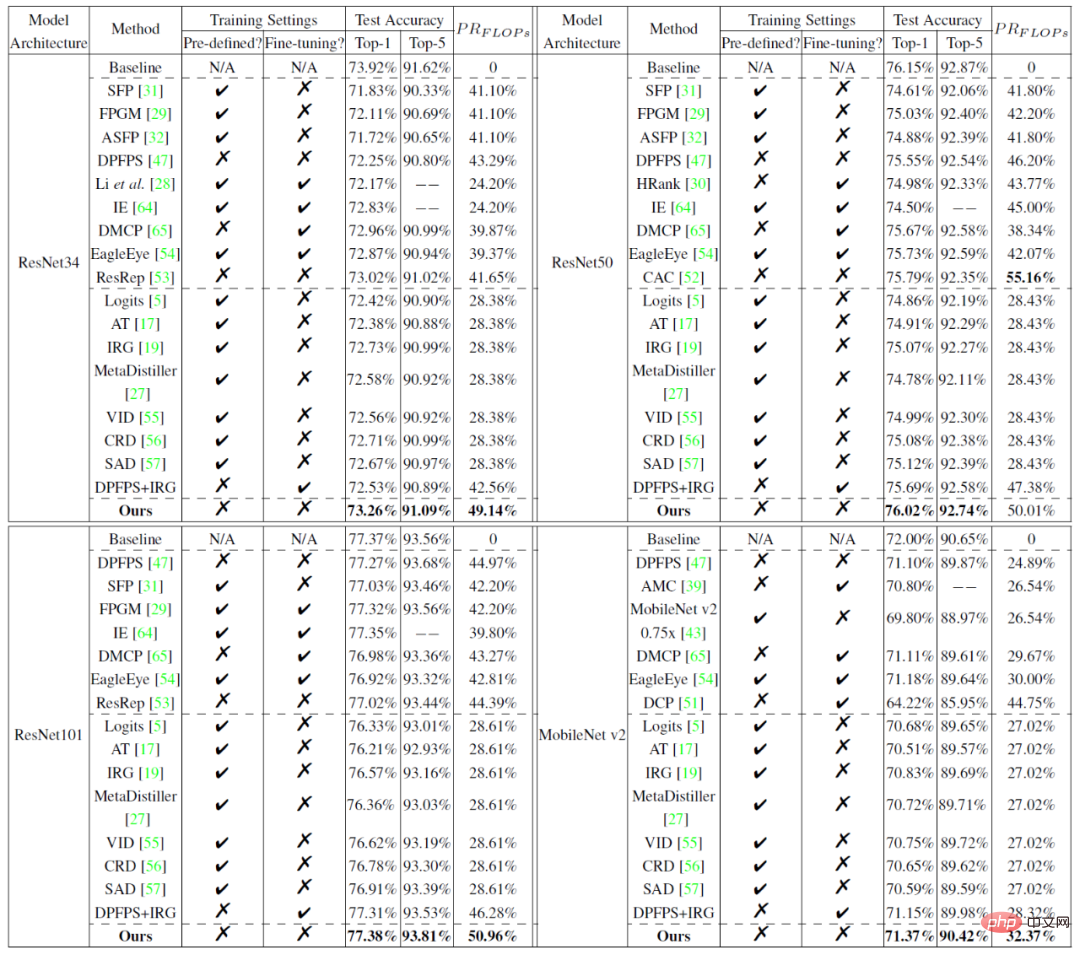

Les expériences comparent la méthode proposée dans cet article avec 24 méthodes de compression de modèle traditionnelles (y compris les méthodes d'écrêtage clairsemé ) et méthodes d'apprentissage par distillation) sont comparés sur l'ensemble de données à petite échelle CIFAR et l'ensemble de données à grande échelle ImageNet. Les résultats expérimentaux sont présentés dans la figure ci-dessous, qui prouvent la supériorité de la méthode proposée dans cet article.

Tableau 1 Comparaison des performances des résultats de recadrage du modèle sur CIFAR10 :

Tableau 2 Comparaison des performances des résultats de recadrage du modèle sur ImageNet :

Pour plus de détails sur la recherche, veuillez vous référer à l'original papier.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI