Maison >Périphériques technologiques >IA >La dernière revue de « l'apprentissage continu » de Tsinghua, 32 pages détaillant l'examen des théories, méthodes et applications de l'apprentissage continu

La dernière revue de « l'apprentissage continu » de Tsinghua, 32 pages détaillant l'examen des théories, méthodes et applications de l'apprentissage continu

- 王林avant

- 2023-04-13 23:31:011488parcourir

D'une manière générale, l'apprentissage continu est clairement limité par des oublis catastrophiques, et l'apprentissage de nouvelles tâches entraîne souvent une forte baisse des performances sur les anciennes tâches.

En plus de cela, un nombre croissant de progrès ont été réalisés ces dernières années qui ont considérablement élargi la compréhension et l'application de l'apprentissage continu.

L'intérêt croissant et généralisé pour cette direction démontre son importance pratique et sa complexité.

Adresse papier : https://www.php.cn/link/82039d16dce0aab3913b6a7ac73deff7

Cet article fournit une introduction complète à apprentissage continu L'enquête tente d'établir des liens entre les paramètres de base, les fondements théoriques, les méthodes représentatives et les applications pratiques.

Sur la base des résultats théoriques et empiriques existants, les objectifs généraux de l'apprentissage continu sont résumés comme suit : assurer des compromis stabilité-plasticité appropriés et des capacités de généralisation intra/inter-tâches suffisantes dans le contexte de l'efficacité des ressources.

Fournit une taxonomie de pointe et détaillée qui analyse en profondeur la façon dont les stratégies représentatives abordent l'apprentissage continu et comment elles s'adaptent aux défis spécifiques dans diverses applications.

Grâce à une discussion approfondie des tendances actuelles en matière d'apprentissage continu, des perspectives transversales et des liens interdisciplinaires avec les neurosciences, nous pensons que cette perspective holistique peut grandement faciliter l'exploration ultérieure dans ce domaine et dans d'autres domaines.

Introduction

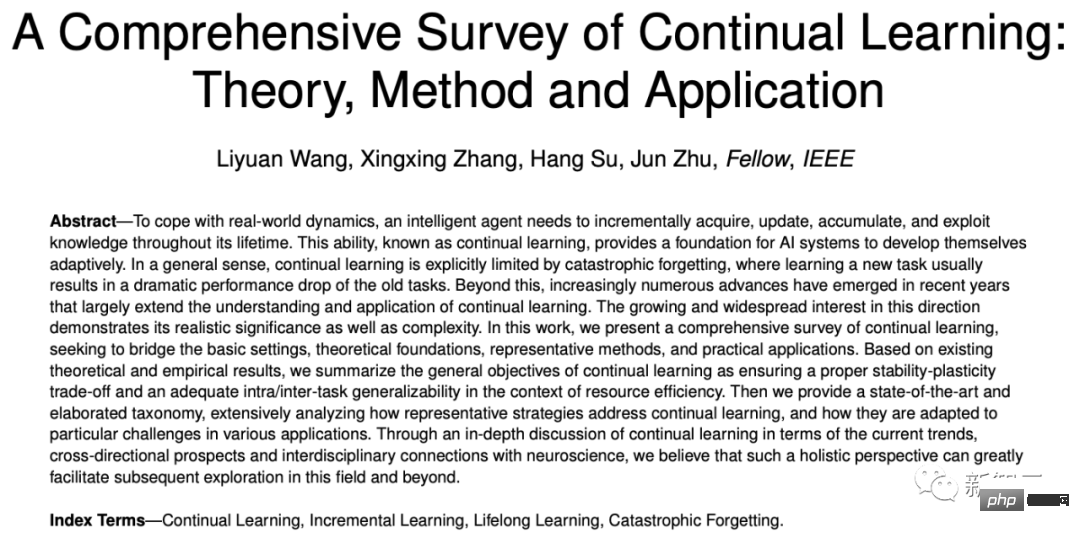

L'apprentissage est la base des systèmes intelligents pour s'adapter à l'environnement. Afin de faire face aux changements du monde extérieur, l’évolution a rendu les humains et d’autres organismes très adaptables et capables d’acquérir, de mettre à jour, d’accumuler et d’utiliser continuellement des connaissances [148], [227], [322]. Naturellement, nous nous attendons à ce que les systèmes d’intelligence artificielle (IA) s’adaptent de la même manière. Cela a inspiré des recherches sur l’apprentissage continu, où un cadre typique consiste à apprendre une séquence de contenus un par un et à se comporter comme s’ils étaient observés simultanément (Figure 1, a). Il peut s’agir de nouvelles compétences, de nouveaux exemples d’anciennes compétences, d’environnements différents, de contextes différents, etc., et contenir des défis spécifiques du monde réel [322], [413]. Étant donné que le contenu est fourni progressivement tout au long de la vie, l’apprentissage continu est également appelé apprentissage progressif ou apprentissage tout au long de la vie dans de nombreuses littératures, mais il n’existe pas de distinction stricte [70], [227].

Différent des modèles d'apprentissage automatique traditionnels basés sur la distribution de données statiques, l'apprentissage continu se caractérise par l'apprentissage à partir de la distribution dynamique de données. Un défi majeur est connu sous le nom d’oubli catastrophique [291], [292], où l’adaptation à une nouvelle distribution se traduit souvent par une capacité considérablement réduite à capturer l’ancienne distribution. Ce dilemme est l'un des aspects du compromis entre la plasticité de l'apprentissage et la stabilité de la mémoire : trop de la première interfère avec la seconde, et vice versa. Au-delà du simple équilibre entre ces deux aspects, une solution idéale pour l’apprentissage continu doit atteindre de fortes capacités de généralisation pour s’adapter aux différences de répartition au sein et entre les tâches (Figure 1, b). En tant que base de référence naïve, le recyclage de tous les anciens échantillons de formation (si cela est autorisé) peut facilement résoudre les défis ci-dessus, mais entraîne une énorme surcharge de calcul et de stockage (et des problèmes potentiels de confidentialité). En fait, l'objectif principal de l'apprentissage continu est d'assurer l'efficacité des ressources des mises à jour du modèle, de préférence proche de l'apprentissage de nouveaux échantillons de formation.

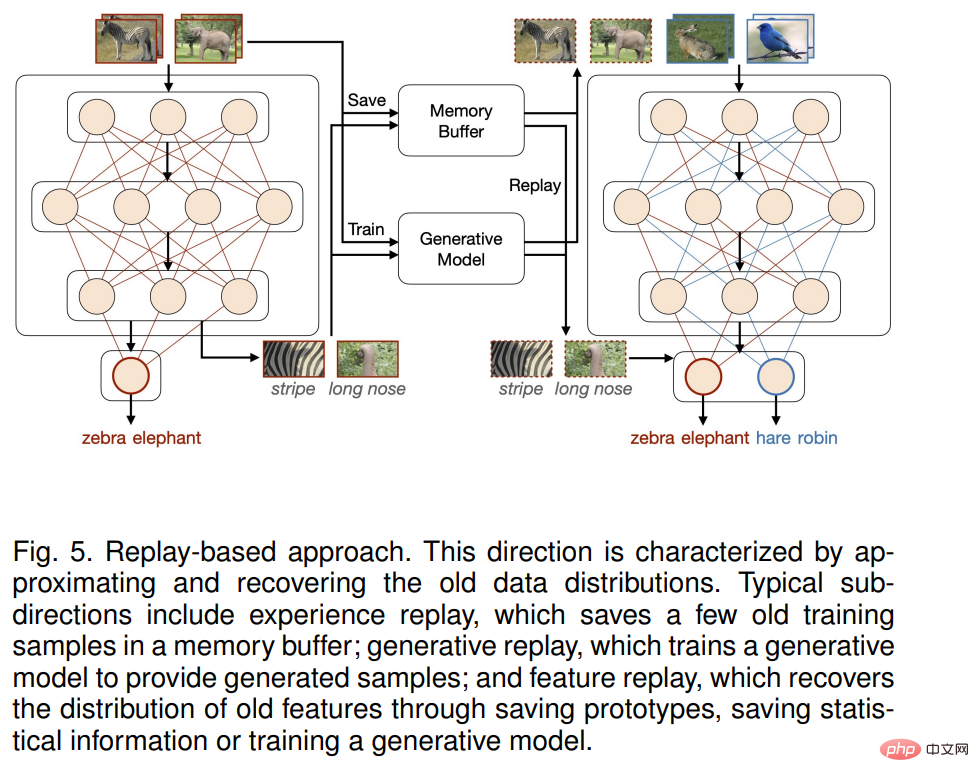

De nombreux efforts ont été consacrés à la résolution des défis ci-dessus, qui peuvent être conceptuellement divisés en cinq groupes (Figure 1, c) : Ajout de termes de régularisation en référence à l'ancien modèle (méthodes basées sur la régularisation) ; distribution de données anciennes (basée sur des méthodes de relecture) ; exploitation explicite de l'optimiseur (méthodes basées sur l'optimisation) ; apprentissage de représentations robustes et bien généralisées (méthodes basées sur la représentation) et construction de paramètres adaptatifs aux tâches à l'aide d'une architecture correctement conçue (architecture-) ; méthodes basées sur la méthode). Cette taxonomie étend les avancées récentes des taxonomies couramment utilisées et fournit des sous-directions affinées pour chaque catégorie. Il résume la manière dont ces méthodes atteignent les objectifs généraux proposés et fournit une analyse approfondie de leurs fondements théoriques et de leurs mises en œuvre typiques. En particulier, ces méthodes sont étroitement liées, telles que la régularisation et la relecture, qui corrigent finalement la direction du gradient lors de l'optimisation, et sont hautement synergiques, par exemple, l'effet de la relecture peut être amélioré en extrayant les connaissances de l'ancien modèle.

Les applications réelles posent des défis particuliers à l'apprentissage continu, qui peuvent être divisés en complexité de scène et spécificité de tâche. Pour le premier, par exemple, l'oracle de la tâche (c'est-à-dire quelle tâche effectuer) peut manquer dans la formation et les tests, et les échantillons de formation peuvent être introduits par petits lots ou même en une seule fois. En raison du coût et de la rareté de l’étiquetage des données, l’apprentissage continu doit être efficace dans des scénarios peu nombreux, semi-supervisés ou même non supervisés. Pour ces derniers, si les progrès actuels se concentrent principalement sur la classification visuelle, d'autres domaines visuels tels que la détection d'objets, la segmentation sémantique et la génération d'images, ainsi que d'autres domaines connexes tels que l'apprentissage par renforcement (RL), le traitement du langage naturel (NLP) et l'éthique considérations ) fait l'objet de plus en plus d'attention, ses opportunités et ses défis.

Compte tenu de la croissance significative de l'intérêt pour la formation continue, nous pensons que cette enquête la plus récente et complète peut fournir une perspective holistique pour les travaux ultérieurs. Bien qu'il existe quelques premières recherches sur l'apprentissage continu avec une couverture relativement large [70], [322], les progrès importants de ces dernières années n'ont pas été inclus. En revanche, les enquêtes récentes n’ont généralement rassemblé que les aspects locaux de l’apprentissage continu, en ce qui concerne ses bases biologiques [148], [156], [186], [227] et les paramètres spécialisés de classification visuelle [85], [283] , [ 289], [346], et des extensions en NLP [37], [206] ou RL [214]. À notre connaissance, il s’agit de la première enquête à résumer systématiquement les avancées récentes en matière d’apprentissage continu. En nous appuyant sur ces atouts, nous proposons une discussion approfondie sur l'apprentissage continu sur les tendances actuelles, les perspectives transversales (telles que les modèles de diffusion, la pré-formation à grande échelle, les transformateurs visuels, l'IA incarnée, la compression neuronale, etc.) et liens interdisciplinaires avec les neurosciences.

Les principales contributions comprennent :

(1) Une revue à jour et complète de l'apprentissage continu pour relier les avancées en théorie, méthodes et applications ;

(2) Basé ; sur l'actuel Certains résultats théoriques et empiriques résument les objectifs généraux de l'apprentissage continu et classent en détail les stratégies représentatives;

(3) Diviser les défis particuliers des applications réelles en complexité de scène et en tâches La particularité, et analysé en profondeur comment les stratégies d'apprentissage continu s'adaptent à ces défis

(4) Discussion approfondie des tendances actuelles de la recherche et des orientations de développement, en vue de fournir une référence pour les travaux ultérieurs dans des domaines connexes.

Cet article est organisé comme suit : Dans la section 2, nous présentons le cadre de l'apprentissage continu, y compris sa formule de base, ses scénarios typiques et ses mesures d'évaluation. Dans la section 3, nous résumons quelques efforts théoriques sur l’apprentissage continu avec leurs objectifs généraux. Dans la section 4, nous fournissons une classification à jour et détaillée des stratégies représentatives, analysant leurs motivations et leurs mises en œuvre typiques. Dans les sections 5 et 6, nous décrivons comment ces stratégies s'adaptent aux défis du monde réel liés à la complexité des scènes et à la spécificité des tâches. Dans la section 7, nous discutons des tendances actuelles, des perspectives d'orientations intersectionnelles et des liens interdisciplinaires en neurosciences.

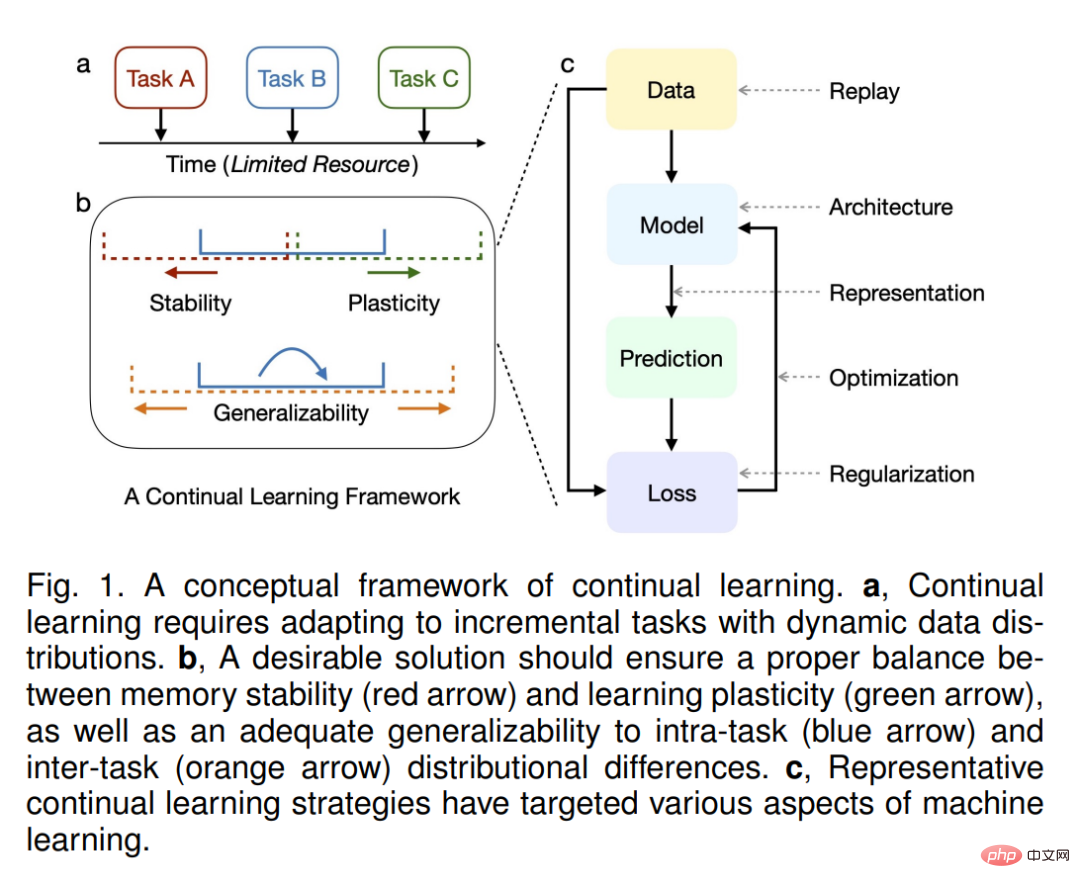

Dans cette section, nous détaillons la classification des méthodes d'apprentissage continu représentatives (voir Figure 3 et Figure 1, c) et analysons en profondeur leurs principales motivations, leurs mises en œuvre typiques et leurs propriétés empiriques.

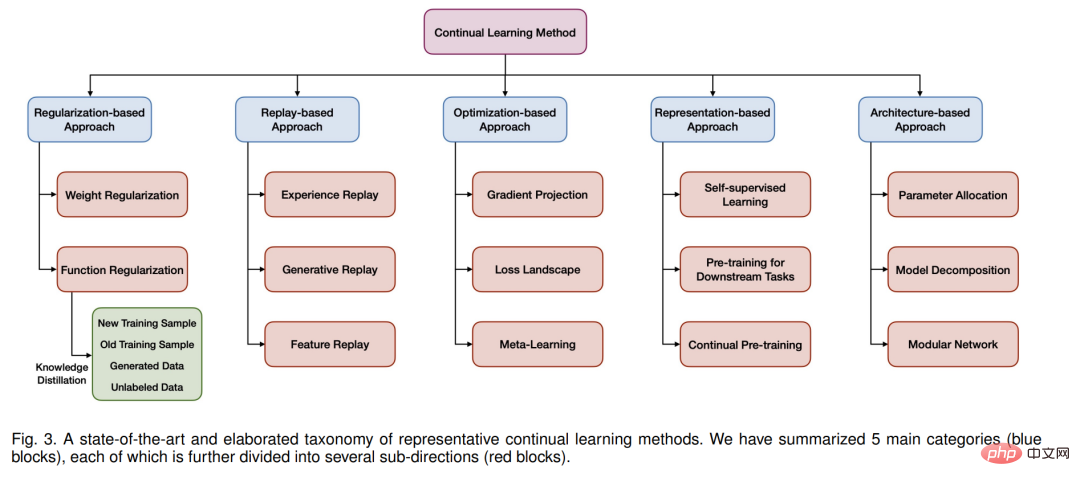

Méthode basée sur la régularisation

Cette direction se caractérise par l'ajout de termes de régularisation explicites pour équilibrer les tâches anciennes et nouvelles, ce qui nécessite souvent de stocker une copie figée de l'ancien modèle pour référence (voir Figure 4). Selon l’objectif de la régularisation, ces méthodes peuvent être divisées en deux catégories. Les méthodes basées sur la relecture et les méthodes qui rapprochent et restaurent les anciennes distributions de données sont regroupées dans cette direction (voir Figure 5). En fonction du contenu de la lecture, ces méthodes peuvent être divisées en trois sous-directions, chacune avec ses propres défis.

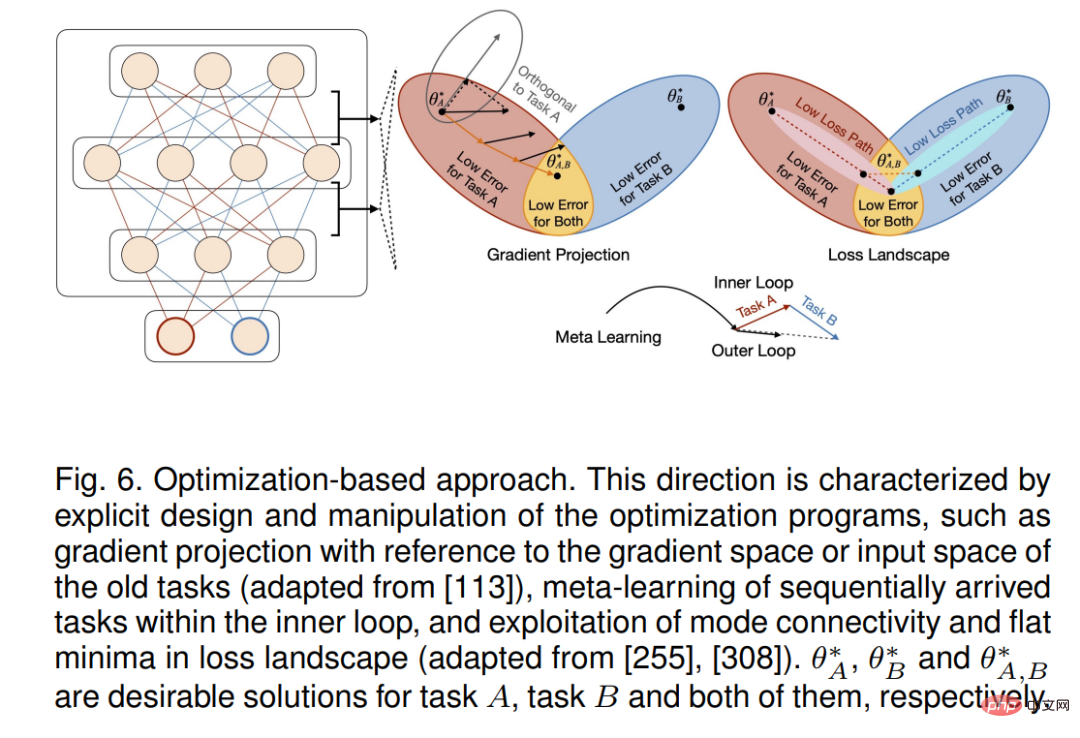

Approche basée sur l'optimisation

L'apprentissage continu peut être obtenu non seulement en ajoutant des termes supplémentaires à la fonction de perte (tels que la régularisation et la relecture), mais également en concevant et en des procédures d’optimisation opérationnelle sont mises en œuvre. Les méthodes basées sur les représentations entrent dans cette catégorie. En plus des premiers travaux sur l'obtention de représentations clairsemées grâce à la méta-formation [185], des travaux récents ont tenté de combiner l'apprentissage auto-supervisé (SSL) [125], [281], [335] et la pré-formation à grande échelle [295]. ], [380], [456] pour améliorer la représentation dans l’initialisation et l’apprentissage continu. Notez que ces deux stratégies sont étroitement liées, car les données de pré-formation sont souvent énormes et ne sont pas explicitement étiquetées, tandis que les performances de SSL lui-même sont principalement évaluées par un réglage fin (une série de) tâches en aval. Ci-dessous, nous discutons des sous-directions représentatives.

Approche basée sur l'architecture

La stratégie ci-dessus se concentre principalement sur l'apprentissage de toutes les tâches incrémentielles avec un ensemble de paramètres partagé (c'est-à-dire un modèle unique et un espace de paramètres), qui est le tâche principale, principale cause d'interférence. Au lieu de cela, la construction de paramètres spécifiques à une tâche peut résoudre explicitement ce problème. Les travaux antérieurs divisent généralement cette direction en isolation des paramètres et architecture dynamique selon que l'architecture du réseau est fixe ou non. Cet article se concentre sur les moyens d'implémenter des paramètres spécifiques à une tâche, en étendant les concepts ci-dessus à l'attribution de paramètres, à la décomposition de modèles et aux réseaux modulaires (Figure 8).

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI