Maison >Périphériques technologiques >IA >Gary Marcus a publiquement crié à Hinton et Musk : L'apprentissage profond se heurte à un mur, je parie 100 000 $

Gary Marcus a publiquement crié à Hinton et Musk : L'apprentissage profond se heurte à un mur, je parie 100 000 $

- PHPzavant

- 2023-04-13 19:40:011755parcourir

« Si quelqu'un dit que (l'apprentissage profond) s'est heurté à un mur, alors tout ce qu'il a à faire est de dresser une liste de choses que l'apprentissage profond ne peut pas faire. Dans 5 ans, nous serons en mesure de prouver que l'apprentissage profond y parvient. . »

6 Le 1er mars, le solitaire Geoffrey Hinton était l'invité du podcast du professeur Pieter Abbeel de l'UC Berkeley. Les deux ont eu une conversation de 90 minutes, allant des auto-encodeurs masqués, AlexNet aux réseaux neuronaux de pointe, etc.

Dans l'émission, Hinton a clairement remis en question l'idée selon laquelle "l'apprentissage profond s'est heurté à un mur".

La déclaration « L'apprentissage en profondeur a heurté un mur » vient d'un article publié en mars par le célèbre spécialiste de l'IA Gary Marcus. Pour être précis, il estime que le « pur apprentissage profond de bout en bout » a presque pris fin et que l'ensemble du domaine de l'IA doit trouver une nouvelle issue.

Où est la sortie ? Selon Gary Marcus, le traitement des symboles a un bel avenir. Cependant, ce point de vue n'a jamais été pris au sérieux par la communauté. Hinton a même déclaré auparavant : « Tout investissement dans les méthodes de traitement des symboles est une énorme erreur. »

La « réfutation » publique de Hinton dans le podcast a évidemment attiré l'attention de Gary Marcus.

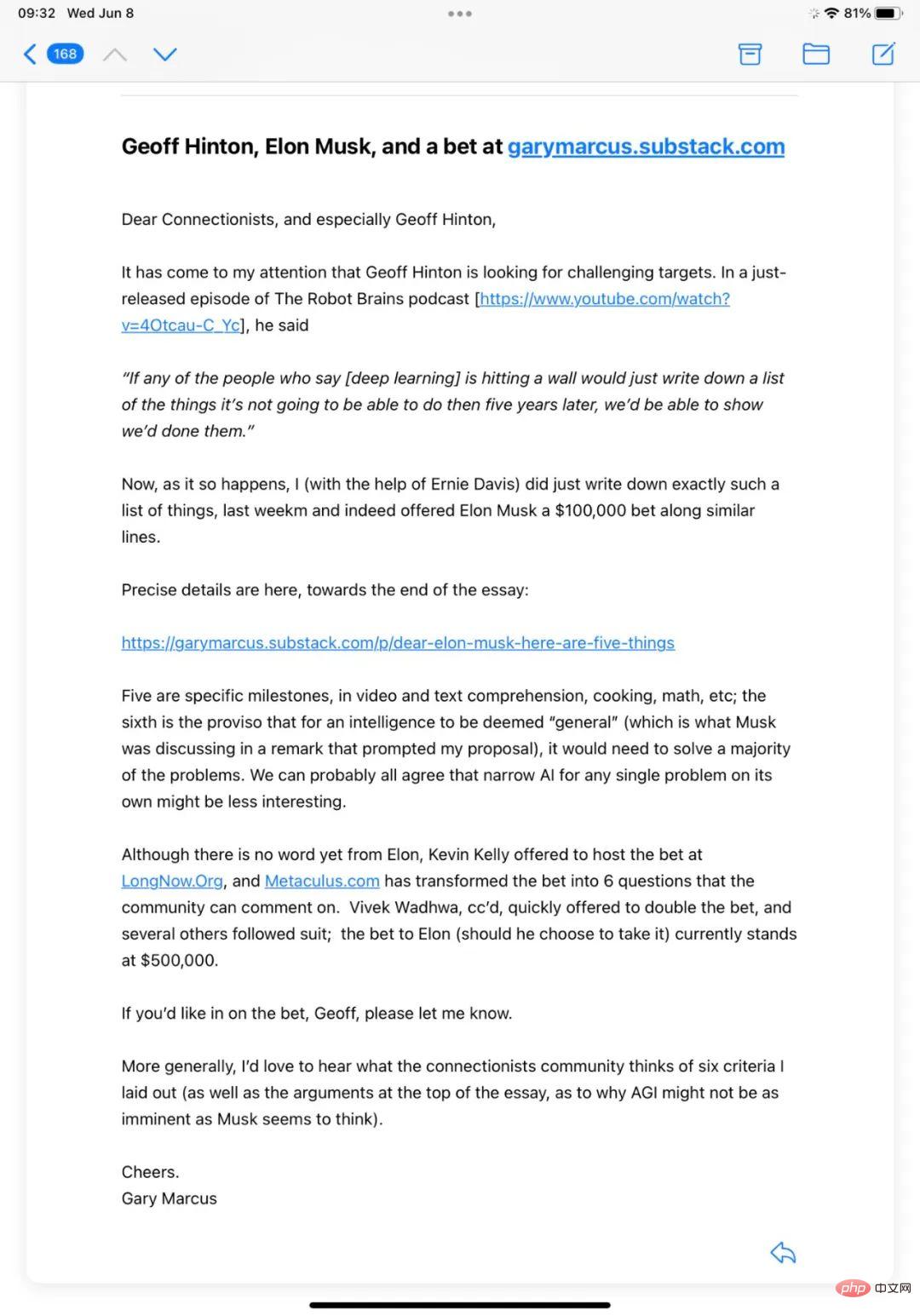

Il y a à peine une douzaine d'heures, Gary Marcus a envoyé une lettre ouverte à Geoffrey Hinton sur Twitter :

La lettre disait ceci : "J'ai remarqué que Geoffrey Hinton est à la recherche d'emplois stimulants. Objectif. En fait, j'ai écrit un tel avec l'aide d'Ernie Davis, et j'ai parié 100 000 $ sur Musk la semaine dernière : «

Que se passe-t-il avec Musk ici ? La raison commence par un tweet fin mai.

Un pari de 100 000 $ avec Musk

Pendant longtemps, les gens ont compris que l'AGI était le genre d'IA décrit dans des films tels que L'Odyssée de l'espace (HAL) et Iron Man (JARVIS). Contrairement à l’IA actuelle, qui est formée pour une tâche spécifique, l’AGI, comme le cerveau humain, peut apprendre à accomplir une tâche.

La plupart des experts estiment qu'il faudra des décennies pour atteindre l'AGI, tandis que certains pensent même que cet objectif ne sera jamais atteint. Dans une enquête menée auprès d'experts dans le domaine, il a été estimé qu'il y aurait 50 % de chances d'atteindre l'AGI d'ici 2099.

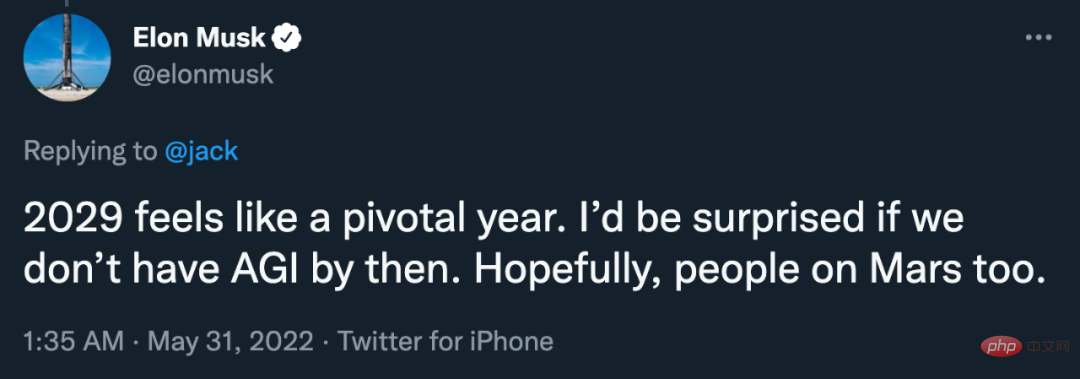

En revanche, Musk semble plus optimiste et s'exprime même publiquement sur Twitter : "2029 est une année critique. Si nous n'avons pas atteint l'AGI d'ici là, je serai surpris. J'espère que les gens sur Mars le seront aussi. Alors."

Gary Marcus, qui n'était pas d'accord, a rapidement demandé : « Combien êtes-vous prêt à parier ? »

Bien que Musk n'ait pas répondu à cette question, Gary Marcus a continué à dire : Vous pouvez configurer un jeu sur Long Bets et le montant est de 100 000 $.

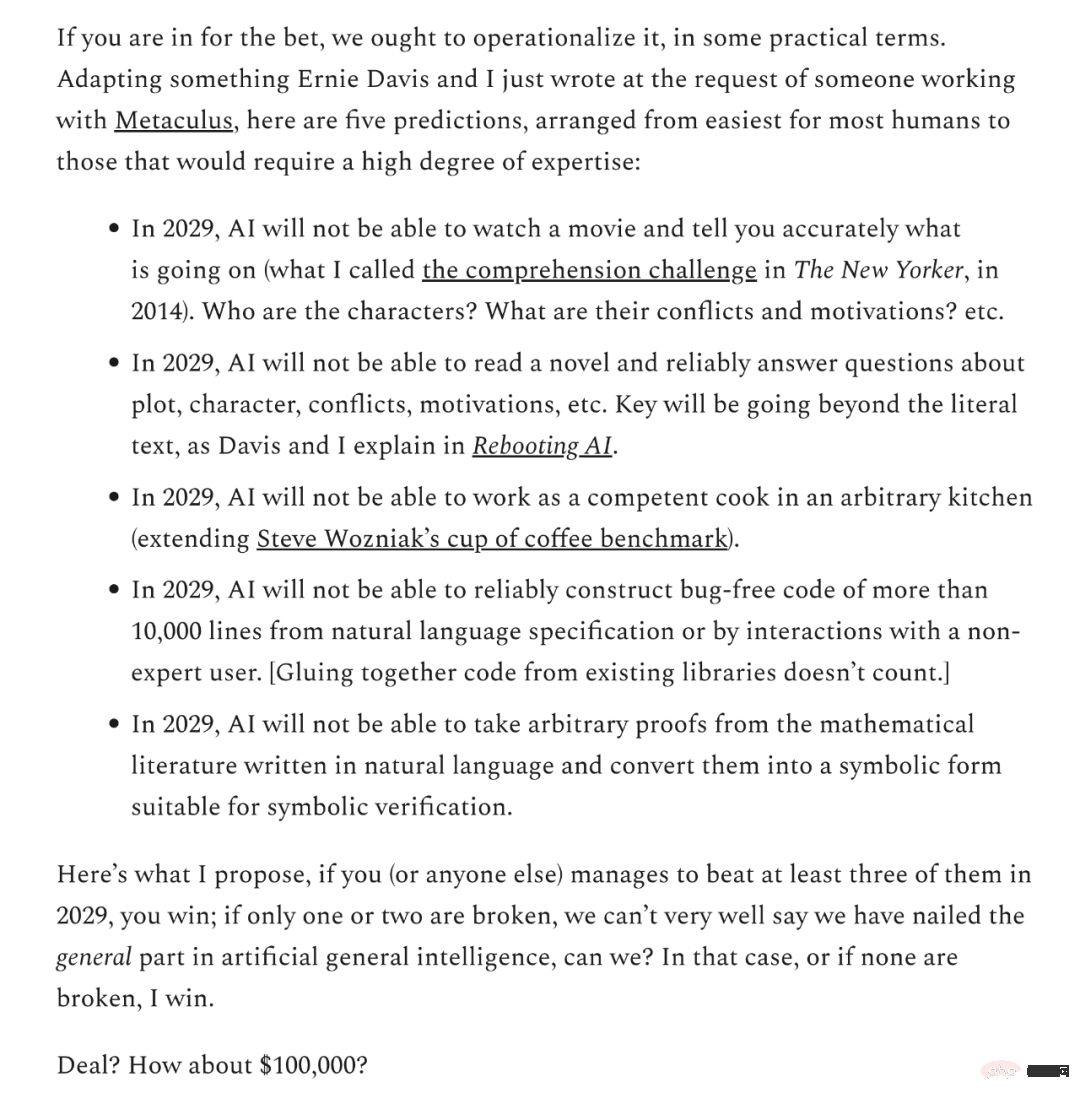

De l’avis de Gary Marcus, les opinions pertinentes de Musk ne sont pas fiables : « Par exemple, vous avez dit en 2015 qu’il faudrait deux ans pour parvenir à des voitures entièrement autonomes, depuis lors, vous dites la même chose presque chaque année. , la conduite entièrement autonome n'a pas encore été réalisée. Que vous arrive-t-il (qui sont les personnages, quels sont leurs conflits et motivations, etc.)

En 2029, l'IA ne sera pas capable de lire des romans et de répondre de manière fiable aux questions sur l'intrigue, les personnages, les conflits, les motivations, etc.

- En 2029, l'IA ne peut pas être un chef compétent dans n'importe quelle cuisine

- En 2029, l'IA ne peut pas créer de manière fiable plus de 10 000 lignes de code sans bug (en collant le code des bibliothèques existantes) via la spécification du langage naturel ou l'interaction avec des non-utilisateurs ; les utilisateurs experts réunis ne comptent pas)

- En 2029, l’IA ne pourra pas extraire arbitrairement des preuves de la littérature mathématique écrite en langage naturel et les convertir en une forme symbolique adaptée à la vérification symbolique.

"Voici ma suggestion, si vous (ou quelqu'un d'autre) parvenez à en terminer au moins trois en 2029, vous gagnez. Deal ? Que diriez-vous de cent mille dollars

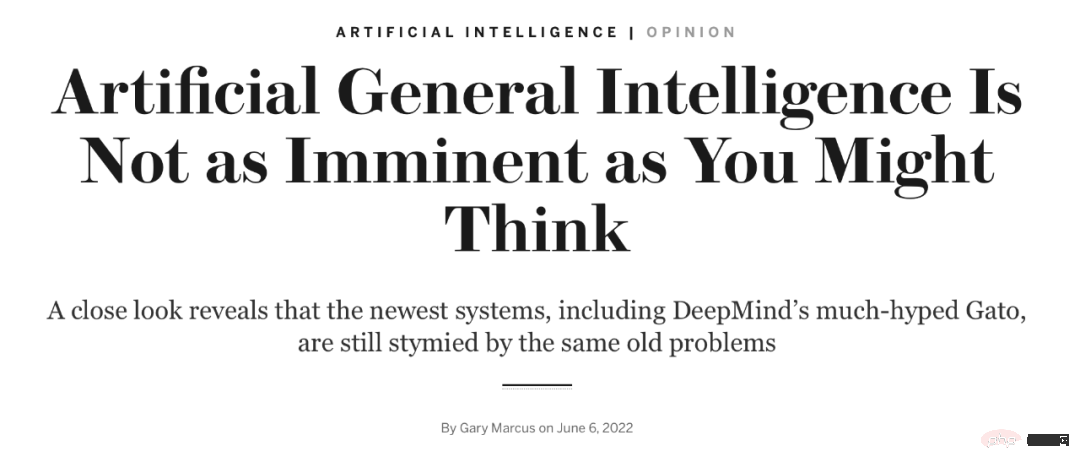

Gary Marcus : AGI n'est pas aussi « proche de nous » que vous le pensez

Le 6 juin, Gary Marcus a publié un article dans Scientific American, réitérant son point de vue : AGI n'est pas à portée de main.

Pour la personne moyenne, il semble que d'énormes progrès soient réalisés dans le domaine de l'intelligence artificielle. Parmi les rapports des médias : le DALL-E 2 d'OpenAI semble être capable de convertir n'importe quel texte en image, GPT-3 est omniscient et le système Gato de DeepMind, sorti en mai, fonctionne bien dans chaque tâche… Un cadre supérieur de DeepMind s'est même vanté d'avoir lancé la quête de l'intelligence générale artificielle (AGI), une IA avec des niveaux d'intelligence proches de ceux de l'humain...

Ne vous y trompez pas. Les machines seront peut-être un jour aussi intelligentes que les humains, peut-être même plus intelligentes, mais c'est loin d'être le cas aujourd'hui. Il reste encore beaucoup de travail à faire pour créer des machines capables de véritablement comprendre et raisonner sur le monde réel. Ce dont nous avons vraiment besoin maintenant, c’est de moins de postures et de plus de recherche fondamentale.

Certes, l’IA progresse effectivement dans certains domaines – les images de synthèse semblent de plus en plus réalistes, la reconnaissance vocale peut fonctionner dans des environnements bruyants – mais nous sommes encore loin d’une IA universelle à l’échelle humaine. Par exemple, l’intelligence artificielle n’est pas encore capable de comprendre le véritable sens des articles et des vidéos, ni de gérer les obstacles et les interruptions inattendus. Nous sommes toujours confrontés au défi que l’IA doit relever depuis des années : rendre l’IA fiable.

Prenons Gato comme exemple. Étant donné la tâche d'ajouter un titre à l'image d'un lanceur lançant une balle de baseball, le système renvoie trois réponses différentes : "Un joueur de baseball lance une balle sur un terrain de baseball", "Un homme lance une balle de baseball". balle à un joueur de baseball sur un terrain de baseball". Un lanceur lance une balle de baseball" et "Un joueur de baseball frappe et un receveur dans un match de baseball." La première réponse est correcte, tandis que les deux autres semblent contenir des joueurs supplémentaires non visibles sur l'image. Cela suggère que le système Gato ne sait pas ce qu’il y a réellement dans l’image, mais plutôt ce qui est typique d’images à peu près similaires. Tout fan de baseball peut dire qu'il s'agit du lanceur qui vient de lancer la balle. Alors que nous nous attendrions à un receveur et à un frappeur à proximité, ils sont visiblement absents de l'image.

De même, DALL-E 2 confondra ces deux relations de position : "cube rouge sur cube bleu" et "cube bleu sur cube rouge". De même, le modèle Imagen publié par Google en mai ne pouvait pas faire la distinction entre « un astronaute à cheval » et « un astronaute à cheval ».

Vous trouverez peut-être encore un peu drôle lorsqu'un système comme DALL-E tourne mal, mais certains systèmes d'IA peuvent causer de très graves problèmes s'ils tournent mal. Par exemple, une Tesla autonome s’est récemment dirigée directement vers un travailleur qui tenait un panneau d’arrêt au milieu de la route, obligeant le conducteur humain à intervenir avant de pouvoir ralentir. Le système de conduite autonome pouvait reconnaître les humains et les panneaux d'arrêt par lui-même, mais ne parvenait pas à ralentir lorsqu'il rencontrait des combinaisons inhabituelles des deux.

Malheureusement, les systèmes d’IA sont encore peu fiables et ont du mal à s’adapter rapidement aux nouveaux environnements.

Gato fonctionne bien sur toutes les tâches signalées par DeepMind, mais rarement aussi bien que d'autres systèmes contemporains. GPT-3 écrit souvent une prose fluide, mais il a encore du mal à maîtriser l'arithmétique de base et il a trop peu de compréhension de la réalité. Il est facile de produire des phrases incroyables telles que « Certains experts pensent que manger des chaussettes peut aider le cerveau à changer d'état. " .

Le problème derrière cela est que les plus grandes équipes de recherche dans le domaine de l'intelligence artificielle ne sont plus des institutions universitaires, mais de grandes entreprises technologiques. Contrairement aux universités, les entreprises ne sont pas incitées à rivaliser équitablement. Leur nouvel article a été publié dans la presse sans examen académique, ce qui a conduit à une couverture médiatique et a contourné l'examen par les pairs. Les informations que nous obtenons correspondent uniquement à ce que l’entreprise elle-même souhaite que nous sachions.

Dans l'industrie du logiciel, il existe un mot spécial qui représente cette stratégie commerciale « demoware », ce qui signifie que la conception du logiciel est adaptée à l'affichage, mais elle n'est pas forcément adaptée au monde réel.

Et les produits d'IA commercialisés de cette manière soit ne peuvent pas être commercialisés sans problème, soit ils sont en réalité un gâchis.

Le deep learning améliore la capacité de la machine à identifier des modèles de données, mais il présente trois défauts majeurs : les modèles appris sont superficiels plutôt que conceptuels ; les résultats produits sont difficiles à interpréter et à généraliser ; Comme l'a souligné Les Valiant, informaticien à Harvard : « Le principal défi de l'avenir est d'unifier la forme d'apprentissage et de raisonnement de l'IA.

Actuellement, les entreprises cherchent à dépasser les normes plutôt qu'à créer de nouvelles idées. Elles se contentent des technologies existantes. . Apportez de petites améliorations au lieu de vous arrêter pour réfléchir à des problèmes plus fondamentaux.

Nous avons besoin de plus de personnes pour poser des questions fondamentales telles que « Comment construire un système capable d'apprendre et de raisonner en même temps » au lieu de rechercher de magnifiques présentations de produits.

Ce débat sur l'AGI est loin d'être terminé, et d'autres chercheurs s'y joignent. Le chercheur Scott Alexander a souligné sur son blog que Gary Marcus est une légende et que ce qu'il a écrit ces dernières années est plus ou moins tout à fait exact, mais qu'il a toujours sa valeur.

Par exemple, Gary Marcus avait déjà critiqué certains problèmes de GPT-2. Huit mois plus tard, lorsque GPT-3 est né, ces problèmes ont été résolus. Mais Gary Marcus n'a pas fait preuve de pitié envers GPT-3, et a même écrit un article : "Le générateur de langage d'OpenAI ne sait pas de quoi il parle

En substance, un point de vue est correct pour l'instant : "Gary Marcus C'est." un gadget pour se moquer des grands modèles de langage, mais ensuite ces modèles deviendront de mieux en mieux, et si cette tendance se poursuit, AGI sera bientôt implémenté. »

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI