Maison >Périphériques technologiques >IA >Ne paniquez pas si vous révisez votre article 100 fois ! Meta publie un nouveau modèle de langage d'écriture PEER : des références seront ajoutées

Ne paniquez pas si vous révisez votre article 100 fois ! Meta publie un nouveau modèle de langage d'écriture PEER : des références seront ajoutées

- 王林avant

- 2023-04-13 15:55:061566parcourir

En près de deux ans et demi depuis sa sortie en mai 2020, GPT-3 a très bien aidé les humains à écrire grâce à ses capacités magiques de génération de texte.

Mais en dernière analyse, GPT-3 est un modèle de génération de texte, dont on peut dire qu'il est complètement différent du processus d'écriture humain.

Par exemple, si nous voulons rédiger un article ou une composition, nous devons d'abord construire un cadre dans notre esprit, vérifier les informations pertinentes, rédiger un brouillon, puis trouver un tuteur pour réviser et peaufiner constamment le texte pendant cette période. , nous pouvons aussi réviser les idées, et enfin nous pouvons devenir un bon article.

Le texte obtenu par le modèle génératif ne peut répondre qu'aux exigences grammaticales, mais n'a aucune logique dans la disposition du contenu et n'a pas la capacité de s'auto-modifier, il est donc encore loin de laisser l'IA écrire de manière indépendante.

Récemment, des chercheurs de Meta AI Research et de l'Université Carnegie Mellon ont proposé un nouveau modèle de génération de texte PEER (Plan, Edit, Explain, Repeat), qui simule complètement le processus d'écriture humaine, de la rédaction à la sollicitation de suggestions jusqu'à l'édition de texte, et itérer à partir de là.

Adresse papier : https://arxiv.org/abs/2208.11663

PEER résout le problème selon lequel les modèles de langage traditionnels ne généreront que des résultats finaux et que le texte généré ne peut pas être contrôlé en saisissant des commandes en langage naturel, PEER Des modifications peuvent être apportées au texte généré.

Le plus important est que les chercheurs ont formé plusieurs instances de PEER, qui peuvent remplir plusieurs liens dans le processus d'écriture, grâce auxquelles la technologie d'auto-formation peut être utilisée pour améliorer la qualité, la quantité et la qualité des données de formation. Diversité.

La capacité de générer des données de formation signifie que le potentiel de PEER va bien au-delà de la rédaction d'essais et peut également être utilisé dans d'autres domaines sans modifier l'historique, ce qui lui permet d'améliorer progressivement sa capacité à suivre des instructions, à rédiger des commentaires utiles et à expliquer son contenu. actes.

La PNL s'applique également à la bionique

Après la pré-formation avec le langage naturel, l'effet de génération de texte des grands réseaux de neurones est déjà très fort, mais la méthode de génération de ces modèles consiste essentiellement à sortir le texte résultat immédiatement de gauche à droite , ce qui est différent des êtres humains. Le processus itératif d'écriture est très différent.

La génération unique présente également de nombreux inconvénients. Par exemple, il est impossible de retracer les phrases dans le texte à modifier ou à améliorer, ni d'expliquer la raison pour laquelle une certaine phrase de texte a été générée. Elle est également difficile à tester. l'exactitude du texte généré, et des hallucinations (halluciner) sont souvent générées dans le contenu des résultats, c'est-à-dire un texte qui n'est pas conforme aux faits. Ces défauts limitent également la capacité du modèle à écrire en collaboration avec des humains, qui ont besoin d'un texte cohérent et factuel.

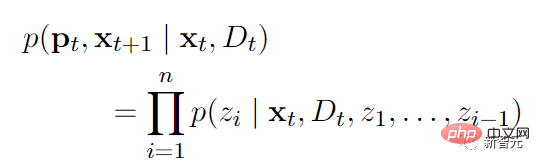

Le modèle PEER est formé sur « l'historique d'édition » du texte, permettant au modèle de simuler le processus d'écriture humain.

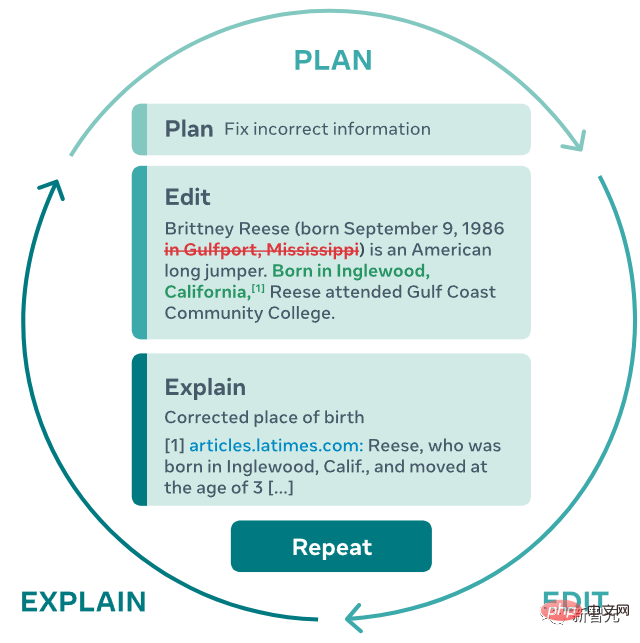

1. Lorsque le modèle PEER est en cours d'exécution, l'utilisateur ou le modèle doit spécifier un plan (Plan) et décrire l'action (action) qu'il souhaite effectuer en langage naturel, comme l'ajout d'informations ou la correction d'erreurs de grammaire. ;

2 , puis mettre en œuvre cette action en éditant le texte

3. Le modèle peut utiliser le langage naturel et pointer vers des ressources pertinentes pour expliquer les résultats de l'édition, comme l'ajout d'une référence à la fin du texte ; 4. Répétez (Répétez) ce processus jusqu'à ce que le texte généré ne nécessite plus de mises à jour supplémentaires.

Cette approche itérative permet non seulement au modèle de décomposer la tâche complexe d'écriture d'un texte cohérent, cohérent et factuel en plusieurs sous-tâches plus faciles, mais permet également aux humains d'intervenir à tout moment du processus de génération, de guider le modèle dans le bon sens. direction, fournissez aux utilisateurs des plans et des commentaires, ou commencez à le modifier vous-même.

Il ressort de la description de la méthode que la chose la plus difficile dans la mise en œuvre de la fonction n'est pas d'utiliser Transformer pour construire un modèle, mais de trouver des données d'entraînement. Nous voulons trouver une méthode capable d'apprendre ce processus. l'échelle requise pour former un grand modèle de langage. Les données sont évidemment très difficiles car la plupart des sites Web ne fournissent pas d'historique d'édition, de sorte que les pages Web obtenues via les robots d'exploration ne peuvent pas être utilisées comme données de formation.

Il ressort de la description de la méthode que la chose la plus difficile dans la mise en œuvre de la fonction n'est pas d'utiliser Transformer pour construire un modèle, mais de trouver des données d'entraînement. Nous voulons trouver une méthode capable d'apprendre ce processus. l'échelle requise pour former un grand modèle de langage. Les données sont évidemment très difficiles car la plupart des sites Web ne fournissent pas d'historique d'édition, de sorte que les pages Web obtenues via les robots d'exploration ne peuvent pas être utilisées comme données de formation.

Même explorer la même page Web à des moments différents en tant qu'historique des modifications n'est pas réalisable car il n'y a pas de texte pertinent qui planifie ou explique la modification.

PEER est similaire aux méthodes d'édition itératives précédentes, utilisant Wikipédia comme source de données pour les éditeurs principaux et les commentaires associés, car Wikipédia fournit un historique d'édition complet, comprenant des commentaires sur une variété de sujets, et est de grande taille, souvent inclus dans les articles. Citation, utile pour trouver des documents pertinents.

Mais s'appuyer uniquement sur Wikipédia comme seule source de données de formation présente également divers inconvénients :

1. Le modèle formé en utilisant uniquement Wikipédia doit être similaire à Wikipédia en termes d'apparence attendue du contenu du texte et de planification et d'édition prévues

; 2. Les commentaires dans Wikipédia sont bruyants, donc dans de nombreux cas, les commentaires ne sont pas appropriés pour la planification ou l'explication.

3 De nombreux passages dans Wikipédia ne contiennent aucune citation, bien que ces informations générales puissent être corrigées en utilisant un système de recherche ; , mais même un tel système peut ne pas être en mesure de trouver des informations de base pour de nombreux éditeurs.

Les chercheurs ont proposé une méthode simple pour résoudre tous les problèmes causés par le fait que Wikipédia est la seule source d'historique d'édition des commentaires : à savoir, former plusieurs instances PEER et utiliser ces instances pour apprendre à renseigner divers aspects du processus d'édition. Ces modèles peuvent être utilisés pour générer des données synthétiques en remplacement des parties manquantes du corpus de formation.

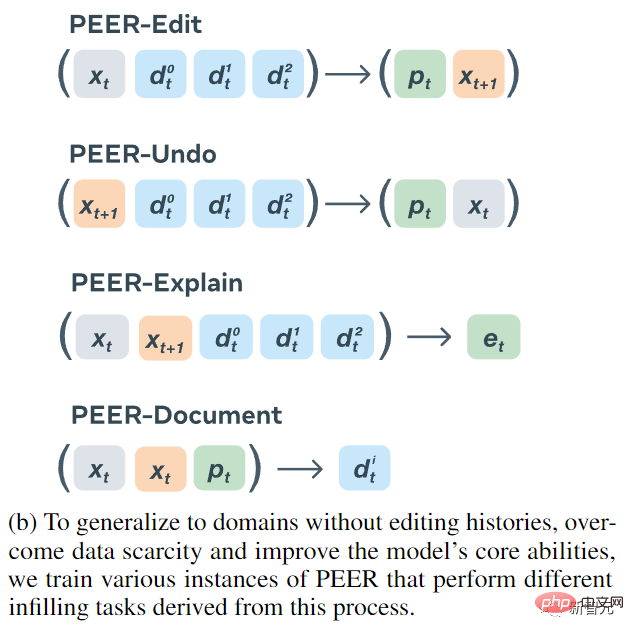

Quatre modèles d'encodeur-décodeur ont finalement été formés :

1. L'entrée de PEER-Edit est le texte x et un ensemble de documents, et la sortie du modèle est le texte planifié et édité, où p est le texte prévu .

2. L'entrée de PEER-Undo est le texte modifié et un ensemble de documents, et la sortie du modèle indique s'il faut annuler la modification.

3. PEER-Explain est utilisé pour générer une explication de la modification. L'entrée est le texte source, le texte édité et un ensemble de documents associés.

4. Le document PEER saisit le texte source, le texte modifié et le plan, et la sortie du modèle constitue l'information de base la plus utile dans cette modification.

Toutes les variantes de modèles de PEER sont utilisées pour générer des données synthétiques, à la fois pour générer des données d'entraînement afin de compléter les parties manquantes et pour remplacer les parties « de mauvaise qualité » des données existantes.

Afin de pouvoir entraîner des données de texte arbitraires, même si le texte n'a pas d'historique d'édition, PEER-Undo est utilisé pour générer une édition synthétique "en arrière", c'est-à-dire que PEER-Undo est appliqué à plusieurs reprises au texte source jusqu'à ce que le le texte est vide, puis appelé PEER-Edit trains dans la direction opposée.

Lors de la génération de plans, utilisez PEER-Explain pour corriger de nombreux commentaires de mauvaise qualité dans le corpus, ou pour traiter des textes sans commentaires. Échantillonnez aléatoirement plusieurs résultats de la sortie de PEER-Explain en tant que « plans potentiels », calculez la probabilité d'une modification réelle et sélectionnez celui avec la probabilité la plus élevée comme nouveau plan.

Si le document pertinent ne peut pas être trouvé pour une opération d'édition spécifique, PEER-Document est utilisé pour générer un ensemble de documents synthétiques contenant les informations permettant d'effectuer l'opération d'édition. Plus important encore, PEER-Edit ne le fait que pendant la formation et ne fournit aucun document synthétique pendant la phase d'inférence.

Pour améliorer la qualité et la diversité des plans, des modifications et de la documentation générés, les chercheurs ont également mis en œuvre un mécanisme de contrôle qui prédéfinit des marqueurs de contrôle spécifiques dans les séquences de sortie générées par le modèle en cours d'entraînement, puis les ont utilisés lors de l'inférence. Balises de contrôle pour guider génération de modèle. Les balises incluent :

1. type est utilisé pour contrôler le type de texte généré par PEER-Explain. Les valeurs facultatives sont instructionon (la sortie doit commencer par un infinitif pour ....) et autre ; 2. length, contrôle la longueur de sortie de PEER-Explain. Les valeurs facultatives incluent s (moins de 2 mots), m (2-3 mots), l (4-5 mots) et xl (supérieur ou égal à 6). mots);

3. se chevauchent, si les mots générés par PEER-Explain peuvent être répétés avec le texte édité, les valeurs facultatives sont vraies et fausses

4. texte et texte édité Le nombre de mots différents entre eux, les valeurs facultatives sont toutes des nombres entiers ;

5, contient, utilisé pour garantir que le texte généré par PEER-Document contient une certaine sous-chaîne

PEER n'introduit pas de contrôle caractères à modifier par PEER, c'est-à-dire qu'il ne suppose pas que l'utilisateur Les types de tâches d'édition qui pourraient être résolues avec le modèle rendent le modèle plus général.

Dans la phase de comparaison expérimentale, PEER utilise la version paramètre 3B de LM-Adapted T5 pour l'initialisation pré-entraînement.

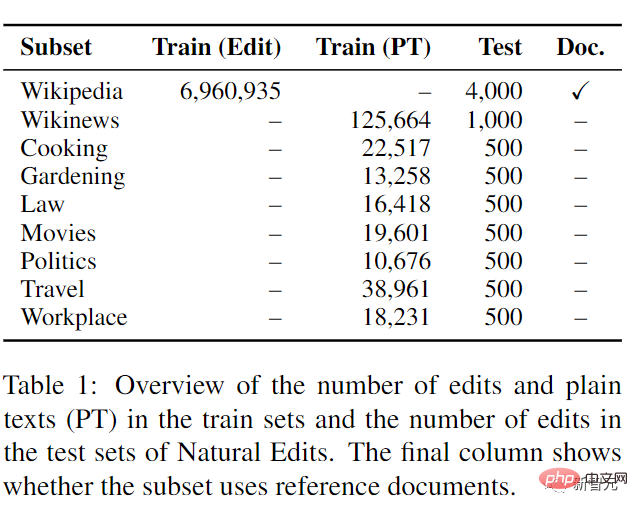

Pour évaluer la capacité de PEER à suivre une série de plans, à utiliser les documents fournis et à effectuer des modifications dans différents domaines, en particulier dans les domaines sans historique de modification, un nouvel ensemble de données Natural Edits est introduit. et les champs.

Les données ont été collectées à partir de trois sources Web en anglais : des pages d'encyclopédie de Wikipédia, des articles de presse de Wikinews et des questions des sous-forums Cuisine, Jardinage, Droit, Film, Politique, Voyage et Lieu de travail, tous ces sites fournissent. un historique des modifications avec des commentaires qui détaillent l'intention de l'éditeur et la fournissent au modèle sous forme de plan.

Dans la formation des sous-ensembles Wikinews et StackExchange, seules les données en texte brut sont fournies au lieu de l'édition réelle, testant ainsi la capacité d'édition dans les zones sans historique d'édition.

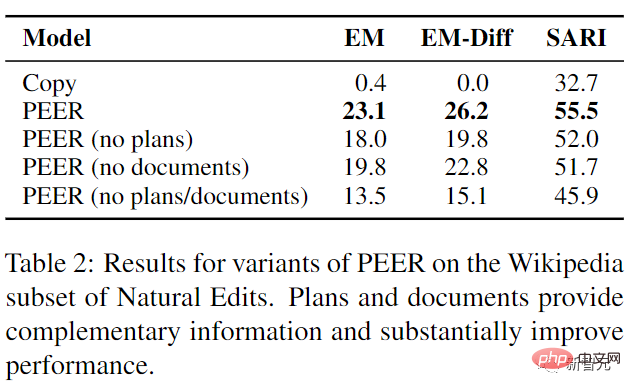

Les résultats expérimentaux montrent que PEER surpasse toutes les lignes de base dans une certaine mesure, et le plan et la documentation fournissent des informations complémentaires que le modèle peut utiliser

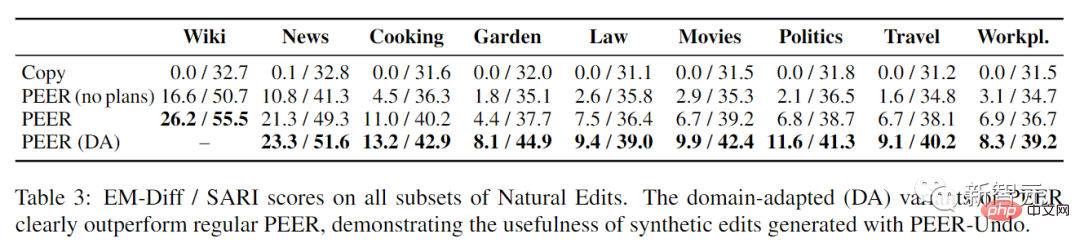

Il peut être trouvé après avoir évalué PEER sur tous les sous-ensembles de modifications naturelles, la planification a été d’une grande aide dans tous les domaines, ce qui suggère que la capacité à comprendre la planification dans l’édition de Wikipédia est directement transférable à d’autres domaines. Il est important de noter que la variante adaptative au domaine de PEER surpasse considérablement le PEER standard sur tous les sous-ensembles de Natural Edits, en particulier avec de grandes améliorations sur les sous-ensembles de jardinage, de politique et de cinéma (84 %, 71 %, et 48 % d'EM-). Diff), montre également l'efficacité de la génération de modifications synthétiques lors de l'application de PEER dans différents domaines.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI