Maison >Périphériques technologiques >IA >Le premier modèle de diffusion de détection de cible, meilleur que Faster R-CNN et DETR, détecte directement à partir d'images aléatoires

Le premier modèle de diffusion de détection de cible, meilleur que Faster R-CNN et DETR, détecte directement à partir d'images aléatoires

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-13 08:34:07958parcourir

Le modèle de diffusion, en tant que nouveau SOTA dans les modèles de génération profonde, a surpassé le SOTA d'origine dans les tâches de génération d'images : telles que GAN, et offre d'excellentes performances dans de nombreux domaines d'application, tels que la vision par ordinateur, la PNL et la modélisation graphique moléculaire, le temps modélisation en série, etc.

Récemment, l'équipe de Luo Ping de l'Université de Hong Kong et des chercheurs du Tencent AI Lab ont proposé conjointement un nouveau framework DiffusionDet, qui applique le modèle de diffusion à la détection de cibles. À notre connaissance, aucune recherche ne permet d'appliquer avec succès le modèle de diffusion à la détection de cibles. On peut dire qu'il s'agit du premier travail utilisant le modèle de diffusion pour la détection de cibles.

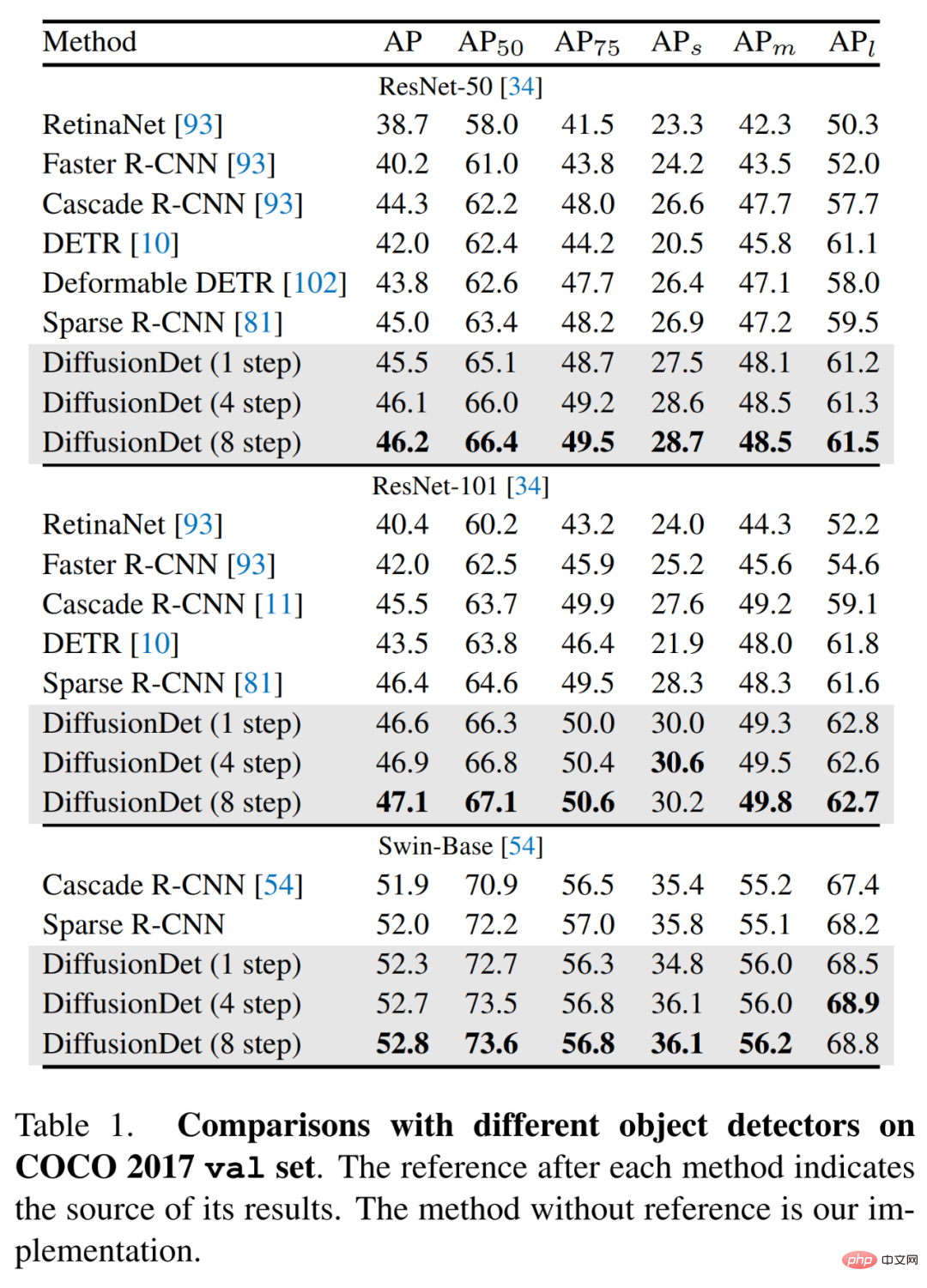

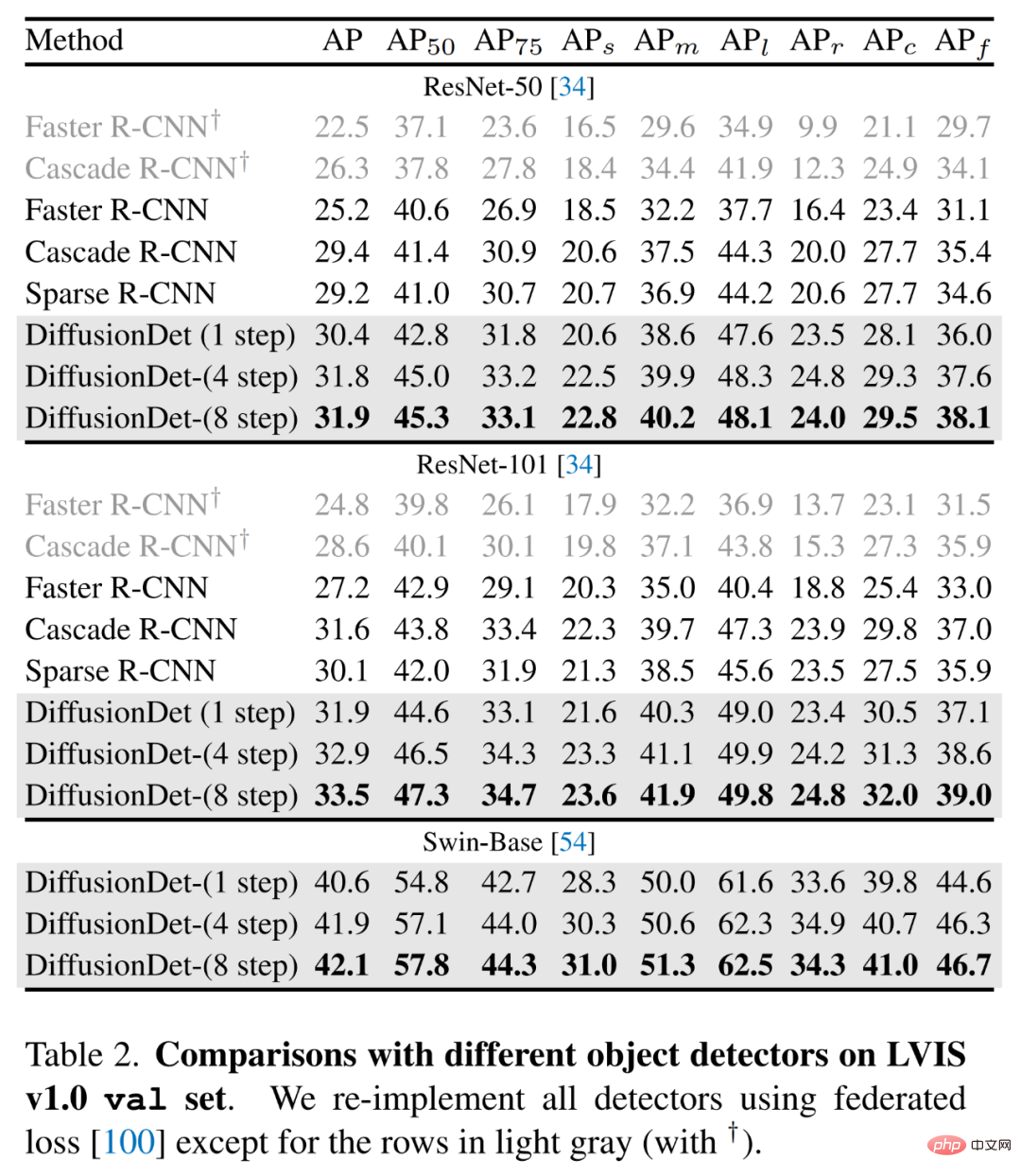

Comment sont les performances de DiffusionDet ? Évalué sur l'ensemble de données MS-COCO, en utilisant ResNet-50 comme épine dorsale, en une seule étape d'échantillonnage, DiffusionDet atteint 45,5 AP, nettement meilleur que Faster R-CNN (40,2 AP), DETR (42,0 AP) et comparable à Sparse. R-CNN (45,0 AP) est comparable. En augmentant le nombre d'étapes d'échantillonnage, les performances de DiffusionDet sont encore améliorées à 46,2 AP. De plus, DiffusionDet a également bien fonctionné sur l'ensemble de données LVIS, atteignant 42,1 AP en utilisant la base swing comme épine dorsale.

- Adresse papier : https://arxiv.org/pdf/2211.09788.pdf

- Adresse du projet https://github.com/ShoufaChen/DiffusionDet

L'étude a révélé qu'il existe un défaut dans la détection d'objets traditionnelle, c'est-à-dire qu'elle s'appuie sur un ensemble fixe de requêtes apprenables. Les chercheurs se sont alors demandé : existe-t-il un moyen simple de détecter des objets qui ne nécessite même pas de requêtes apprenables ?

Pour répondre à cette question, cet article propose DiffusionDet, un framework capable de détecter des cibles directement à partir d'un ensemble de boîtes aléatoires. Il formule la détection de cible comme un processus de diffusion débruitant de la boîte de bruit à la boîte cible. Cette approche noise-to-box ne nécessite pas de priorités heuristiques de cible ni de requêtes apprenables, ce qui simplifie encore davantage les cibles candidates et fait progresser les pipelines de détection.

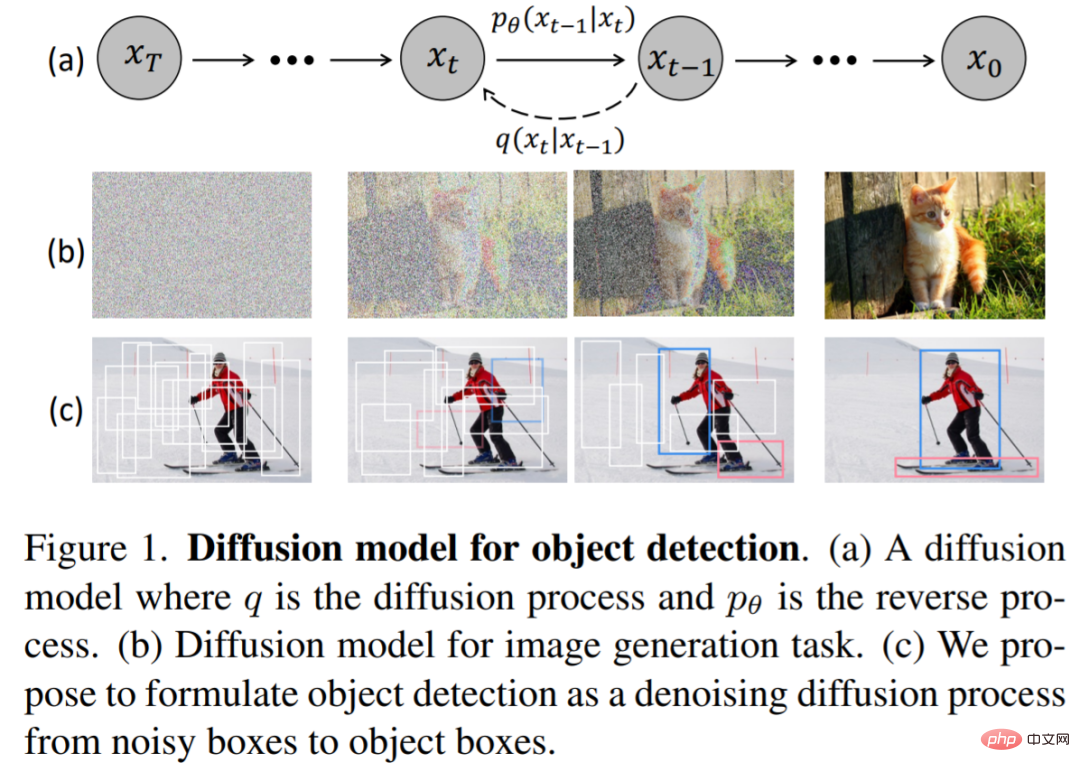

Comme le montre la figure 1 ci-dessous, cette étude estime que le paradigme du bruit en boîte est similaire au processus bruit en image dans le modèle de diffusion de débruitage. Ce dernier est un type de modèle basé sur la vraisemblance qui utilise. l'appris Le modèle de bruit supprime progressivement le bruit dans l'image pour générer l'image.

DiffusionDet résout la tâche de détection de cible via le modèle de diffusion, c'est-à-dire que la détection est considérée comme une tâche de génération dans la position (coordonnées centrales) et la taille (largeur et hauteur) du cadre de délimitation dans l'image . Dans la phase d'entraînement, du bruit gaussien contrôlé par la table de variance (échéancier) est ajouté à la boîte de vérité terrain pour obtenir la boîte à bruit. Ces boîtes bruyantes sont ensuite utilisées pour recadrer les régions d'intérêt (RoI) à partir des cartes de caractéristiques de sortie des encodeurs de base (tels que ResNet, Swin Transformer). Enfin, ces caractéristiques RoI sont envoyées au décodeur de détection, qui est formé pour prédire la boîte de vérité terrain sans bruit. Dans la phase d'inférence, DiffusionDet génère des boîtes englobantes en inversant le processus de diffusion appris, qui ajuste la distribution préalable du bruit à la distribution apprise sur la boîte englobante.

Présentation de la méthode

Étant donné que le modèle de diffusion génère de manière itérative des échantillons de données, le modèle f_θ doit être exécuté plusieurs fois pendant la phase d'inférence. Cependant, appliquer f_θ directement sur l’image originale à chaque étape d’itération est difficile à calculer. Par conséquent, les chercheurs ont proposé de diviser l'ensemble du modèle en deux parties, à savoir l'encodeur d'image et le décodeur de détection. Le premier n'est exécuté qu'une seule fois pour extraire la représentation des caractéristiques de profondeur de l'image d'entrée d'origine et affiner progressivement les prédictions de boîte dans z_t.

L'encodeur d'image prend l'image brute en entrée et extrait ses fonctionnalités de haut niveau pour le décodeur de détection. Les chercheurs utilisent des réseaux neuronaux convolutifs tels que ResNet et des modèles basés sur Transformer tels que Swin pour mettre en œuvre DiffusionDet. Pendant ce temps, les réseaux pyramidaux de fonctionnalités sont utilisés pour générer des cartes de fonctionnalités multi-échelles pour les réseaux fédérateurs ResNet et Swin.

Le décodeur de détection emprunte à Sparse R-CNN, prenant un ensemble de boîtes de proposition en entrée, recadrant les caractéristiques RoI de la carte de caractéristiques générée par l'encodeur d'image et les envoyant à la tête de détection pour obtenir les résultats de régression et de classification des boîtes. De plus, le décodeur de détection est constitué de 6 étages en cascade.

Formation

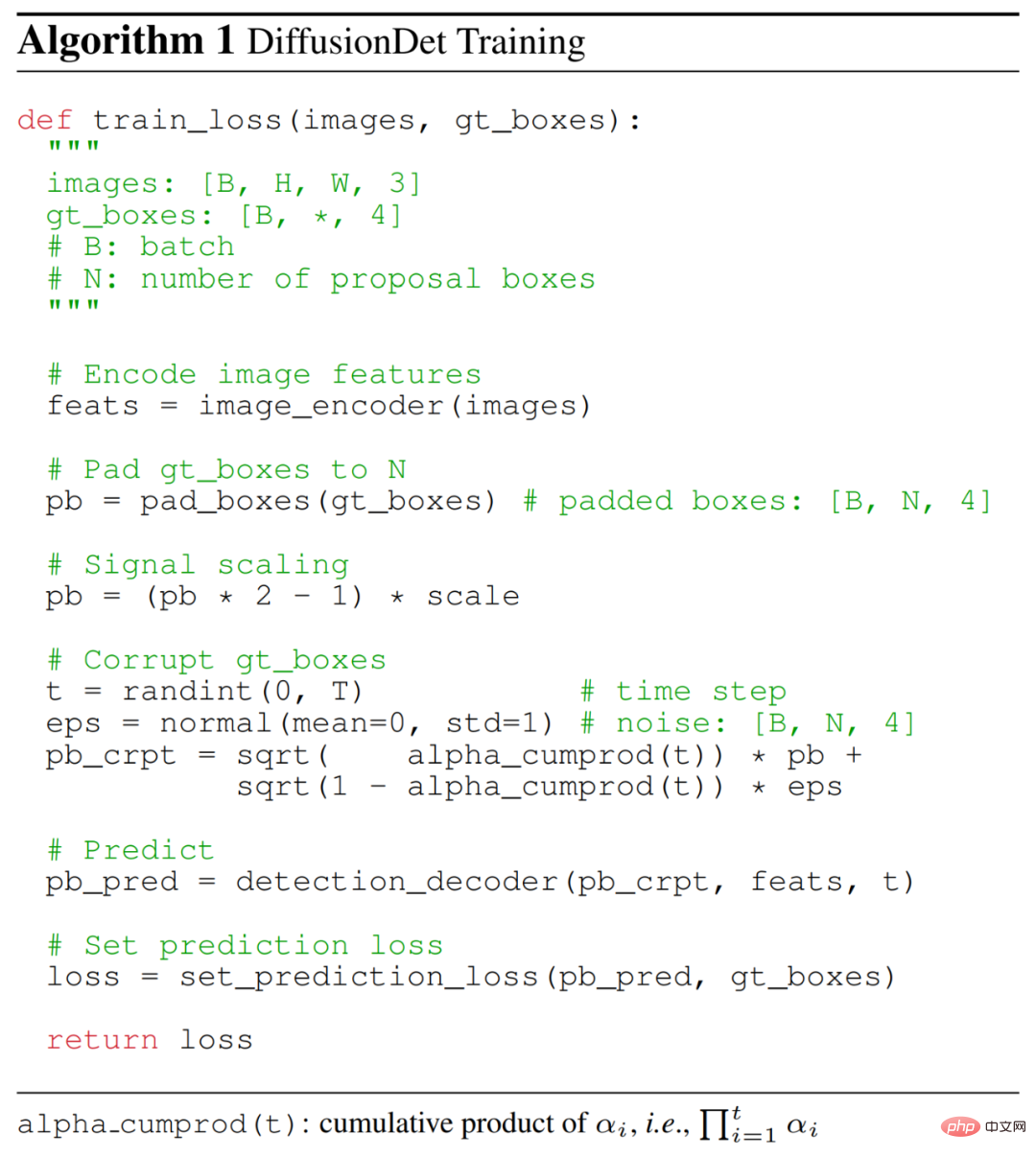

Au cours du processus de formation, les chercheurs ont d'abord construit le processus de diffusion de la véritable boîte de valeur à la boîte de bruit, puis ont entraîné le modèle pour inverser ce processus. L'algorithme 1 ci-dessous fournit le pseudocode du processus de formation DiffusionDet.

Remplissage de la boîte de vérité. Pour les benchmarks modernes de détection d'objets, le nombre d'instances d'intérêt varie souvent d'une image à l'autre. Par conséquent, nous remplissons d’abord quelques cases supplémentaires par rapport aux cases de vérité terrain d’origine afin que toutes les cases soient résumées en un nombre fixe N_train. Ils ont exploré plusieurs stratégies de remplissage, telles que la répétition de boîtes de vérité terrain existantes, la concaténation de boîtes aléatoires ou de boîtes de la taille d'une image.

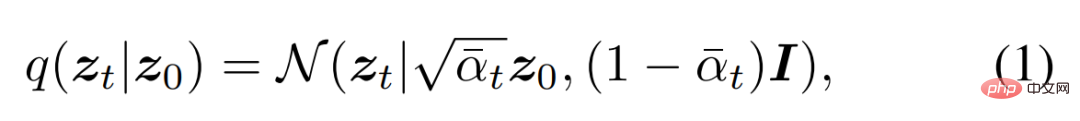

Cadre endommagé. Le chercheur ajoute du bruit gaussien à la boîte de vérité terrain remplie. L'échelle de bruit est contrôlée par α_t dans la formule suivante (1), qui adopte une planification en cosinus décroissante de manière monotone à différents pas de temps t.

Perte d'entraînement. Le décodeur de détection prend en entrée les boîtes corrompues N_train et prédit les prédictions N_train de la classification des classes et des coordonnées des boîtes. Appliquez également la perte de prédiction d'ensemble sur l'ensemble de prédictions N_train.

Inférence

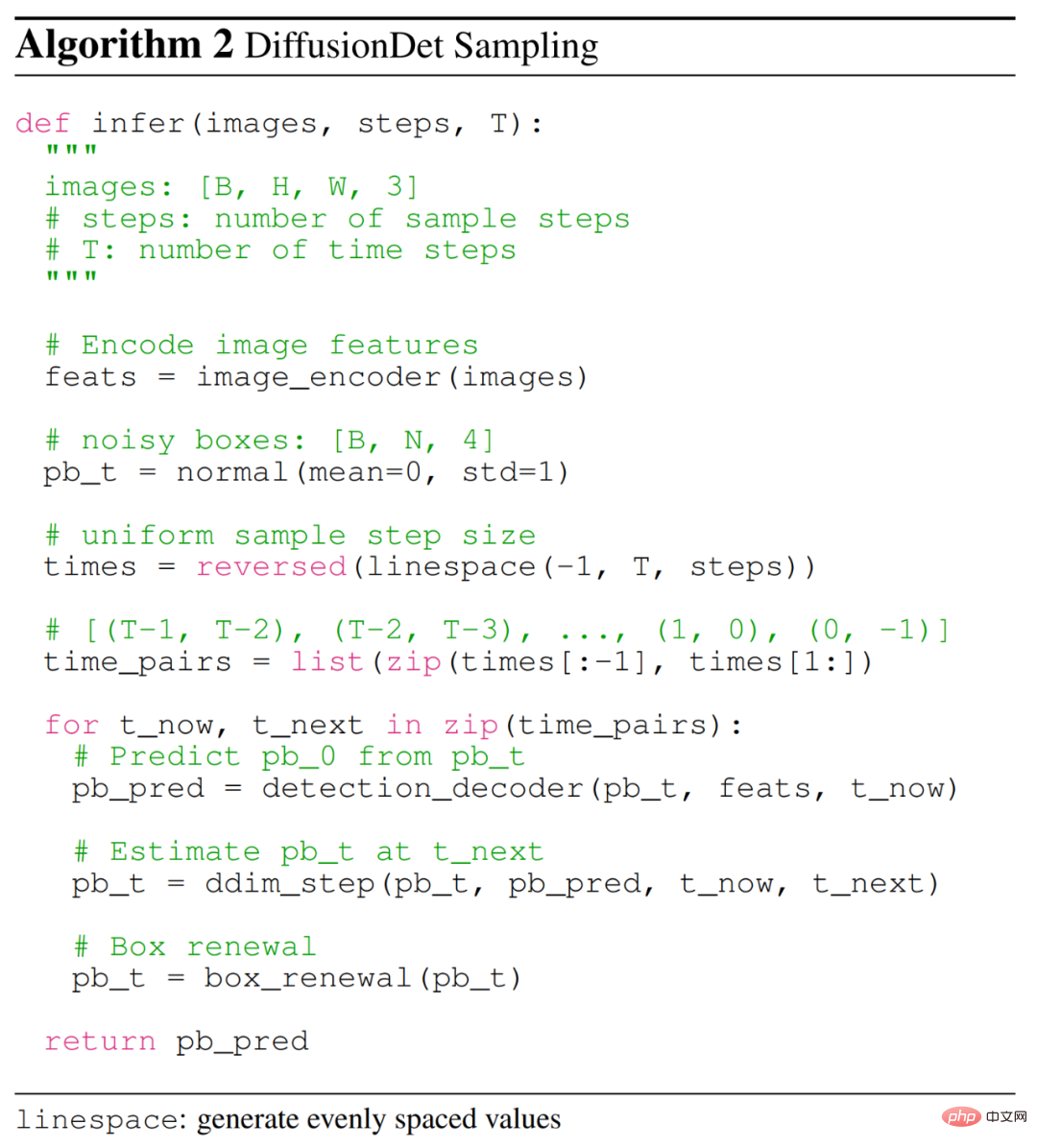

Le processus d'inférence de DiffusionDet est un processus d'échantillonnage débruitant du bruit à la trame cible. A partir d'une boîte échantillonnée à partir d'une distribution gaussienne, le modèle affine progressivement ses prédictions comme le montre l'algorithme 2 ci-dessous.

Étapes d'échantillonnage. À chaque étape d'échantillonnage, des boîtes aléatoires ou des boîtes estimées de l'étape d'échantillonnage précédente sont envoyées au décodeur de détection pour prédire la classification de classe et les coordonnées des boîtes. Après avoir obtenu la case de l'étape en cours, DDIM est utilisé pour estimer la case de l'étape suivante.

Mises à jour de la boîte. Pour rendre l'inférence plus cohérente avec l'entraînement, nous proposons une stratégie de mise à jour des boîtes pour récupérer les boîtes inattendues en les remplaçant par des boîtes aléatoires. Plus précisément, ils filtrent d’abord les cases inattendues avec des scores inférieurs à un certain seuil, puis concatènent les cases restantes avec de nouvelles cases aléatoires échantillonnées à partir d’une distribution gaussienne.

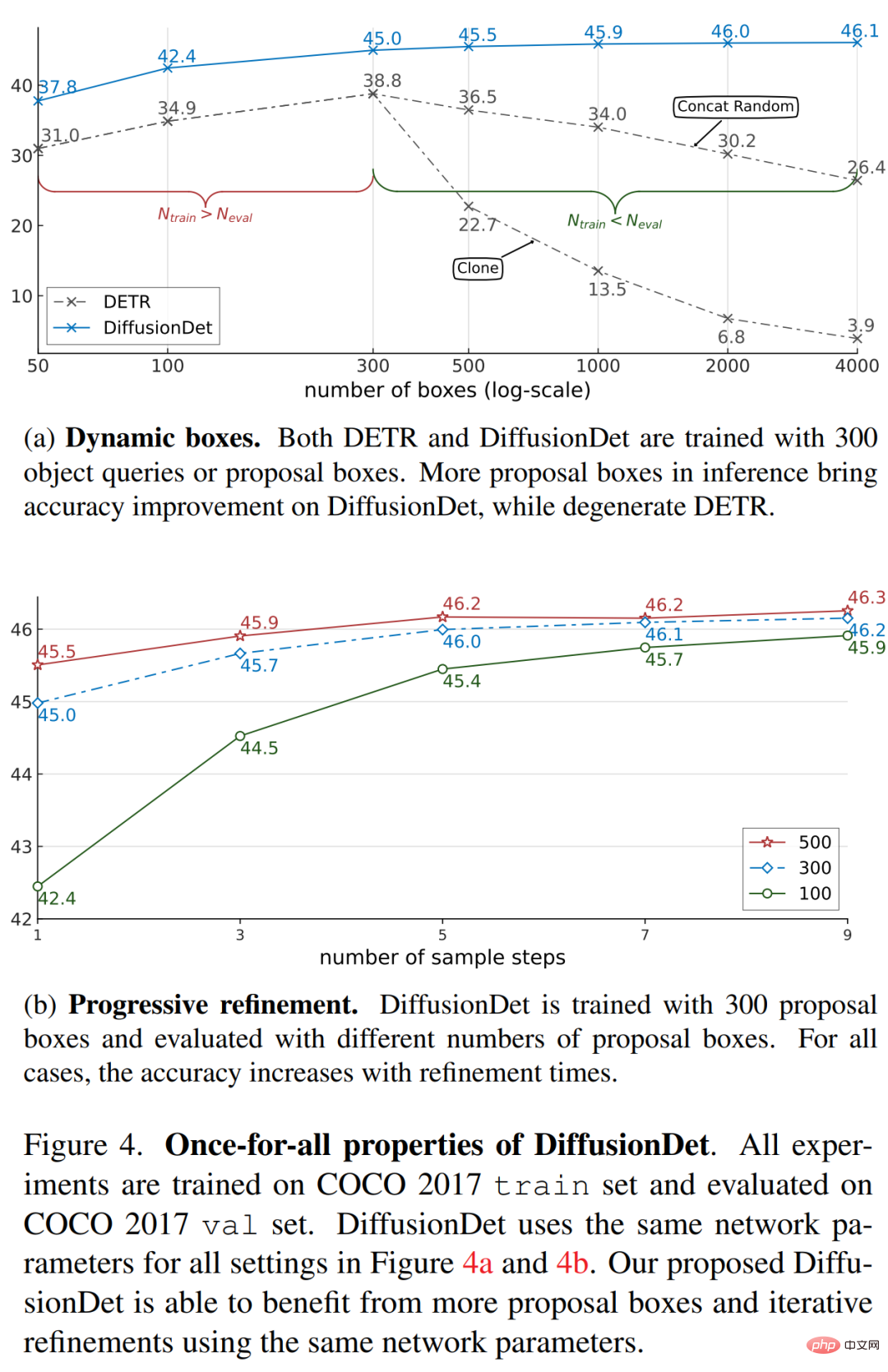

Une fois pour toutes. Grâce à la conception des boîtes aléatoires, les chercheurs peuvent évaluer DiffusionDet en utilisant n'importe quel nombre de boîtes aléatoires et d'étapes d'échantillonnage. À titre de comparaison, les méthodes précédentes reposent sur le même nombre de boîtes de traitement pendant la formation et l'évaluation, et le décodeur de détection n'est utilisé qu'une seule fois lors de la passe avant.

Résultats expérimentaux

Dans la partie expérimentale, les chercheurs ont d'abord démontré la propriété une fois pour toutes de DiffusionDet, puis ont comparé DiffusionDet avec des détecteurs matures précédents sur les ensembles de données MS-COCO et LVIS.

La fonctionnalité principale de DiffusionDet est d'entraîner toutes les instances d'inférence une fois. Une fois le modèle entraîné, il peut être utilisé pour modifier le nombre de cases et les exemples d'étapes d'inférence, comme le montre la figure 4 ci-dessous. DiffusionDet peut atteindre une plus grande précision en utilisant plus de cases ou/et plus d’étapes de raffinement, mais au prix d’une latence plus élevée. Par conséquent, nous avons déployé un seul DiffusionDet dans plusieurs scénarios et obtenu le compromis vitesse-précision souhaité sans recycler le réseau.

Les chercheurs ont comparé DiffusionDet aux détecteurs précédents sur les ensembles de données MS-COCO et LVIS, comme le montre le tableau 1 ci-dessous. Ils ont d’abord comparé les performances de détection d’objets de DiffusionDet avec les détecteurs précédents sur MS-COCO. Les résultats montrent que DiffusionDet sans l'étape de raffinement atteint 45,5 AP en utilisant le réseau fédérateur ResNet-50, surpassant de loin les méthodes matures précédentes telles que Faster R-CNN, RetinaNet, DETR et Sparse R-CNN. Et DiffusionDet montre une amélioration stable lorsque la taille du réseau fédérateur est agrandie.

Les résultats sur l'ensemble de données LVIS plus complexe sont présentés dans le tableau 2 ci-dessous, et on peut voir que DiffusionDet peut obtenir des gains significatifs en utilisant davantage d'étapes de raffinement.

Veuillez vous référer à l'article original pour plus de détails expérimentaux.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI