Maison >Périphériques technologiques >IA >La reconstruction 3D du visage de Jimmy Lin peut être réalisée à l'aide de deux A100 et d'un CNN 2D !

La reconstruction 3D du visage de Jimmy Lin peut être réalisée à l'aide de deux A100 et d'un CNN 2D !

- 王林avant

- 2023-04-13 08:19:061299parcourir

La technologie de reconstruction 3D a toujours été un domaine de recherche clé dans le domaine de l'infographie et de la vision par ordinateur.

En termes simples, la reconstruction 3D consiste à restaurer la structure de la scène 3D sur la base d'images 2D.

On dit qu'après que Jimmy Lin ait eu un accident de voiture, son plan de reconstruction faciale a utilisé une reconstruction tridimensionnelle.

Différentes voies techniques pour la reconstruction 3D devraient être intégrées

En fait, la technologie de reconstruction 3D a été largement utilisée dans les jeux, les films, l'arpentage et la cartographie, le positionnement, la navigation, la conduite autonome, la VR/AR, l'industrie. fabrication et biens de consommation.

Avec le développement du GPU et de l'informatique distribuée, ainsi que la maturité progressive des caméras de profondeur telles que la Kinect de Microsoft, la XTion d'ASUS et le RealSense d'Intel en termes de matériel, le coût de la reconstruction 3D a montré une tendance à la baisse.

En termes de fonctionnement, le processus de reconstruction 3D peut être grossièrement divisé en cinq étapes.

La première étape est l'acquisition d'images.

La reconstruction 3D étant le fonctionnement inverse d'une caméra, il faut d'abord utiliser une caméra pour obtenir une image 2D d'un objet 3D.

Cette étape ne peut être ignorée, car les conditions d'éclairage, les caractéristiques géométriques de la caméra, etc. ont un grand impact sur le traitement ultérieur de l'image.

La deuxième étape est le calibrage de la caméra.

Cette étape consiste à utiliser les images capturées par la caméra pour restituer les objets dans l'espace.

On suppose généralement qu'il existe une relation linéaire entre l'image capturée par la caméra et l'objet dans l'espace tridimensionnel. Le processus de résolution des paramètres de la relation linéaire est appelé calibrage de la caméra.

La troisième étape est l'extraction de fonctionnalités.

Les caractéristiques comprennent principalement des points caractéristiques, des lignes caractéristiques et des zones.

Dans la plupart des cas, les points caractéristiques sont utilisés comme primitives de correspondance. La forme sous laquelle les points caractéristiques sont extraits est étroitement liée à la stratégie de correspondance utilisée.

Par conséquent, lors de l'extraction de points caractéristiques, vous devez d'abord déterminer quelle méthode de correspondance utiliser.

La quatrième étape est la correspondance stéréo.

La correspondance stéréo consiste à établir une correspondance entre des paires d'images en fonction des caractéristiques extraites, c'est-à-dire à faire correspondre les points d'imagerie du même point de l'espace physique dans deux images différentes, un à un.

La cinquième étape, la reconstruction tridimensionnelle.

Avec des résultats de correspondance relativement précis, combinés aux paramètres internes et externes de l'étalonnage de la caméra, les informations de la scène tridimensionnelle peuvent être restaurées.

Ces cinq étapes sont imbriquées. Ce n'est que lorsque chaque lien est effectué avec une grande précision et de petites erreurs qu'un système de vision stéréoscopique relativement précis peut être conçu.

En termes d'algorithme, la reconstruction 3D peut être grossièrement divisée en deux catégories. L'une est l'algorithme de reconstruction 3D basé sur la géométrie multi-vue traditionnelle.

L'autre est un algorithme de reconstruction tridimensionnelle basé sur l'apprentissage profond.

Actuellement, en raison des énormes avantages de CNN dans la correspondance des caractéristiques des images, de plus en plus de chercheurs commencent à tourner leur attention vers la reconstruction tridimensionnelle basée sur l'apprentissage profond.

Cependant, cette méthode est principalement une méthode d'apprentissage supervisé et dépend fortement de l'ensemble de données.

La collecte et l'étiquetage d'ensembles de données ont toujours été une source de problèmes pour l'apprentissage supervisé. C'est pourquoi la reconstruction tridimensionnelle basée sur l'apprentissage profond est principalement étudiée dans le sens de la reconstruction d'objets plus petits.

De plus, la reconstruction 3D basée sur l'apprentissage profond a une haute fidélité et de meilleures performances en termes de précision.

Mais la formation du modèle prend beaucoup de temps et les couches convolutives 3D pour la reconstruction 3D sont très coûteuses.

Par conséquent, certains chercheurs ont commencé à réexaminer la méthode traditionnelle de reconstruction tridimensionnelle.

Bien que la méthode traditionnelle de reconstruction tridimensionnelle présente des défauts de performances, la technologie est relativement mature.

Ensuite, une certaine intégration des deux méthodes pourra conduire à de meilleurs résultats.

La reconstruction 3D est possible sans couches convolutionnelles 3D

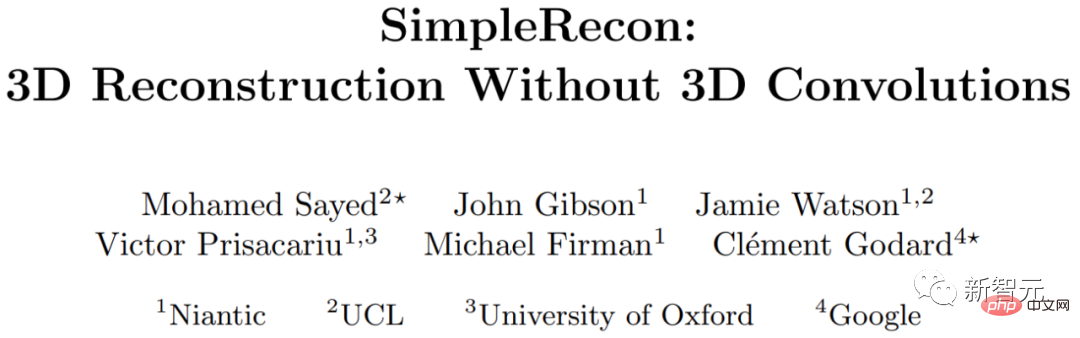

Des chercheurs d'institutions telles que l'Université de Londres, l'Université d'Oxford, Google et Niantic (une société licorne issue de Google qui étudie la RA), explorent. Méthode de reconstruction 3D sans convolution 3D.

Ils proposent un estimateur de profondeur multi-vues simple et à la pointe de la technologie.

Cet estimateur de profondeur multi-vues présente deux avancées.

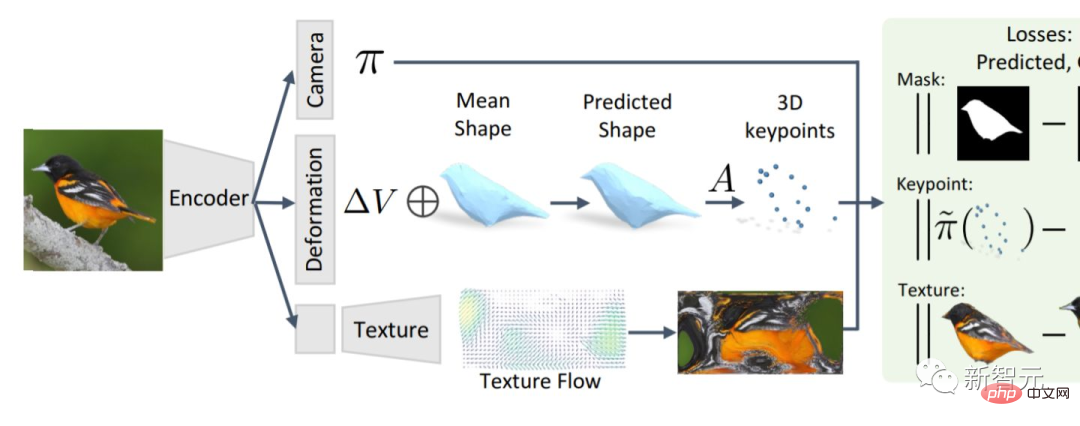

Premièrement, un CNN 2D bien conçu peut tirer parti de puissants a priori d'images et obtenir des quantités de caractéristiques de balayage plan et des pertes géométriques.

Deuxièmement, il peut intégrer des images clés et des métadonnées géométriques dans le volume de coûts, permettant ainsi d'être informé ; notation du plan de profondeur.

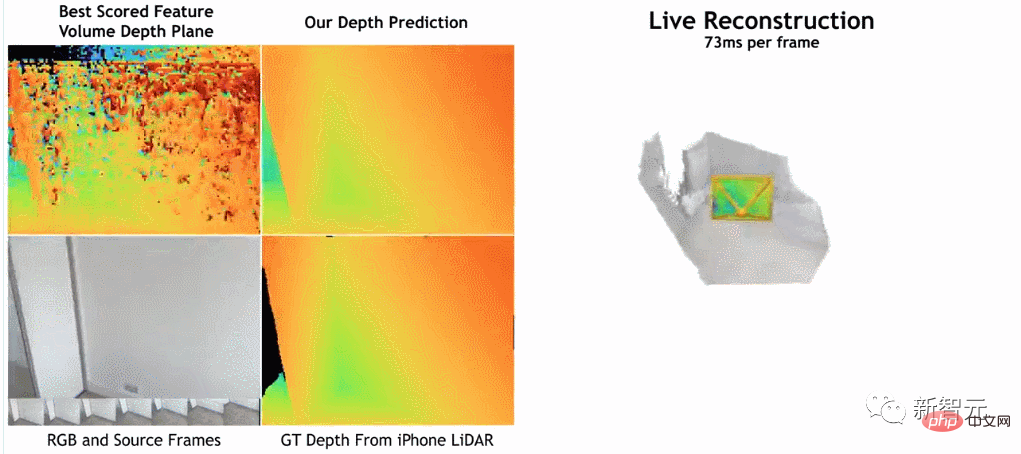

Selon les chercheurs, leur méthode a une nette avance sur les méthodes de pointe actuelles en matière d'estimation en profondeur.

et est proche ou meilleur pour la reconstruction 3D sur ScanNet et 7-Scenes, mais permet toujours la reconstruction en ligne et en temps réel avec une faible mémoire.

De plus, la vitesse de reconstruction est très rapide, ne prenant qu'environ 73 ms par image.

Les chercheurs pensent que cela rend possible une reconstruction précise grâce à une fusion profonde rapide.

Selon les chercheurs, leur méthode consiste à utiliser un encodeur d'image pour extraire les caractéristiques correspondantes de l'image de référence et de l'image source, puis à les saisir dans le volume de coût, puis à utiliser un outil convolutif 2D. réseau d'encodeurs/décodeurs Traite les résultats de sortie du volume de coûts.

Cette recherche a été mise en œuvre à l'aide de PyTorch et a utilisé ResNet18 pour l'extraction des fonctionnalités correspondantes. Elle a également utilisé deux GPU A100 de 40 Go. Il a fallu 36 heures pour terminer l'ensemble du travail.

De plus, bien que le modèle n'utilise pas de couches convolutives 3D, il surpasse le modèle de base en termes d'indicateurs de prédiction de profondeur.

Cela montre qu'un réseau 2D bien conçu et entraîné est suffisant pour une estimation de profondeur de haute qualité.

Les lecteurs intéressés peuvent lire le texte original de l'article :

https://nianticlabs.github.io/simplerecon/resources/SimpleRecon.pdf

Cependant, il doit être a rappelé qu'il existe un seuil professionnel pour lire cet article et que certains détails peuvent ne pas être facilement remarqués.

Autant jeter un œil à ce que les internautes étrangers ont découvert dans ce journal.

Un internaute nommé "stickshiftplease" a déclaré : "Bien que le temps d'inférence sur l'A100 soit d'environ 70 millisecondes, il peut être raccourci grâce à diverses techniques, et la mémoire requise ne doit pas nécessairement être de 40 Go, le plus petit modèle fonctionne à 2,6 Go. mémoire".

Un autre internaute nommé "IrreverentHippie" a souligné : "Veuillez noter que cette étude est toujours basée sur l'échantillonnage d'un capteur de profondeur LiDAR. C'est pourquoi cette méthode atteint une si bonne qualité et précision."

Il y a aussi un commentaire relativement long d'un internaute nommé "nickthorpie". Il a déclaré : "Les avantages et les inconvénients des caméras ToF sont bien documentés. ToF résout divers problèmes qui affectent le traitement des images brutes. Parmi eux, les deux principaux problèmes sont Évolutivité et détails. Les petits détails tels que les bords de table ou les poteaux fins sont toujours difficiles à détecter avec ToF. Ceci est crucial pour les applications autonomes ou semi-autonomes

De plus, puisque ToF est un capteur actif, donc lorsque plusieurs capteurs sont utilisés. ensemble, comme dans un carrefour bondé ou dans un entrepôt auto-construit, la qualité de l'image se dégrade rapidement

Évidemment, plus vous collectez de données dans une scène, plus la description que vous créez est mauvaise. étudier les données d'images brutes car elles sont plus flexibles.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI