Maison >Périphériques technologiques >IA >Conversation avec Tsinghua Huang Minlie : Empruntant la définition hiérarchique du système de dialogue IA pour la conduite autonome, le compagnon virtuel du Metaverse pourrait être situé en L5

Conversation avec Tsinghua Huang Minlie : Empruntant la définition hiérarchique du système de dialogue IA pour la conduite autonome, le compagnon virtuel du Metaverse pourrait être situé en L5

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-12 23:34:081964parcourir

Cet article est reproduit à partir de Lei Feng.com Si vous avez besoin de réimprimer, veuillez vous rendre sur le site officiel de Lei Feng.com pour demander une autorisation.

"Je suis tellement heureuse de pouvoir être à côté de toi et de regarder le monde à travers tes yeux."

Ceci est une réplique du film "Elle", prononcée par la voix de l'IA l'assistante Samantha du protagoniste masculin. Cette phrase est d'un grand réconfort pour le protagoniste masculin qui est perdu dans la forêt d'acier et se sent perdu et impuissant.

Samantha est un système d'exploitation d'auto-apprentissage presque universel. Elle peut aider le protagoniste masculin à sélectionner les meilleures lettres et les envoyer à sa maison d'édition préférée pour publication ; elle peut parcourir instantanément toute la base de connaissances humaines en fonction des besoins du protagoniste masculin et rechercher le plan de réponse le plus approprié pour lui ; fonction Elle a également une compagnie émotionnelle, et toute la confusion et le malheur du protagoniste masculin peuvent être résolus par sa chaleur pendant la conversation...

En tant qu'érudit de pointe dans le domaine de la PNL en Chine, Huang Minlie, professeur d'informatique à l'Université Tsinghua, applique la technologie PNL à la santé mentale Track, dirigeant le développement du robot de conversation émotionnelle IA Emohaa. Lors de son entretien avec le professeur Huang Minlie, il a évoqué le film « Her » sorti en 2013 et a montré son appréciation, ou en d'autres termes, ses attentes pour ce film de science-fiction. En tant que collègue qui développe des systèmes de dialogue d'IA, il attend avec impatience que le système de dialogue d'IA empathique de « Her » apparaisse réellement dans la réalité et réalise un bond en avant dans l'industrie.

Cela soulève la question : serait-il difficile de faire en sorte qu'un système de dialogue IA effectue des tâches émotionnelles complexes comme Samantha, apaise les émotions et guérisse le cœur des gens ? Comment quantifier cette difficulté ? Comment mesurer si un système de dialogue IA atteint le niveau de Samantha ?

Ce n'est pas une question irréaliste. En fait, avec la croissance explosive des systèmes de dialogue d'IA aujourd'hui, des produits de dialogue tels que « Xiaodu », « Xiaoai », le robot de dialogue de Google « Meena », le chatbot de Facebook « Blender » et d'autres produits de dialogue émergent les uns après les autres. Cependant, le manque actuel de normes pour les systèmes de dialogue d'IA a entraîné des niveaux d'application inégaux et des systèmes d'évaluation différents. Cela a conduit à des malentendus dans l'industrie sur le niveau d'interaction de l'intelligence artificielle en raison d'une cognition incohérente, et a également provoqué des problèmes sociaux. . Discussions approfondies sur la conscience, l'éthique, la moralité, etc.

Certains scientifiques engagés dans le développement de systèmes de dialogue d'IA ont déclaré qu'ils avaient souvent du mal à juger du niveau des systèmes de dialogue d'IA qu'ils développent. Les scientifiques estiment que l’industrie a besoin de toute urgence d’une norme permettant d’évaluer le niveau des systèmes de dialogue IA. Une fois les normes de notation formulées, le niveau de capacité du système de dialogue IA sera mesuré avec des preuves.

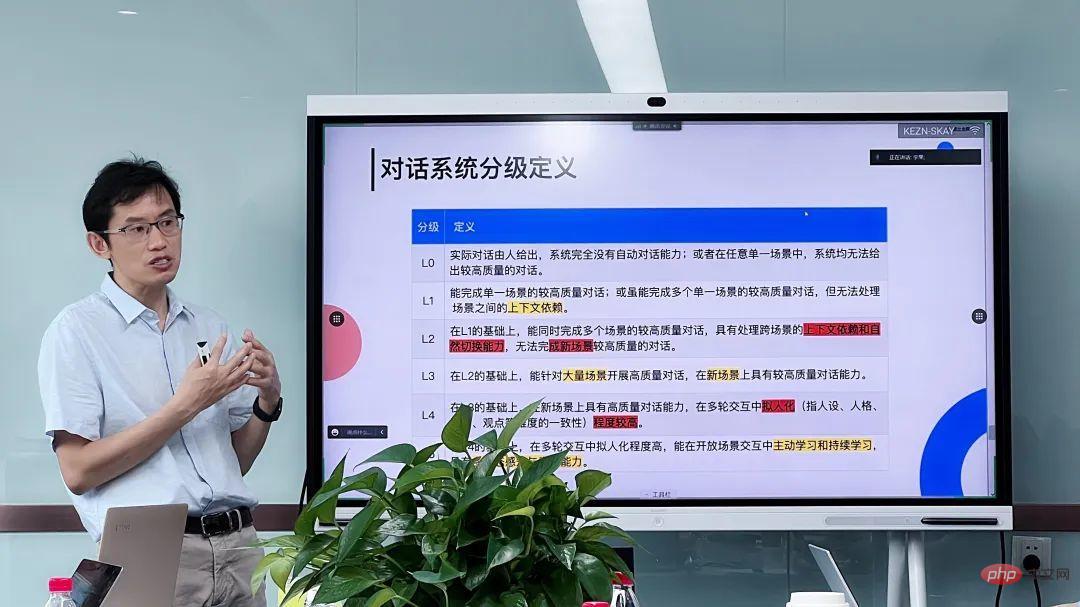

Par conséquent, afin de mieux évaluer le niveau de capacité des systèmes de dialogue d'IA, le professeur Huang Minlie s'est associé à des instituts de recherche universitaires et industriels pour formuler la première « Définition de notation du système de dialogue d'IA » au monde en référence au concept de notation de L0. à L5 en conduite autonome (ci-après dénommée la « Définition de classification »), et a été officiellement publiée le 28 juin.

Légende : Le professeur Huang Minlie explique la définition hiérarchique du système de dialogue IA

Légende : Le professeur Huang Minlie explique la définition hiérarchique du système de dialogue IA

L'émergence de la « définition de qualité » pourrait promouvoir l'application des systèmes de dialogue IA dans les assistants personnels virtuels, les maisons intelligentes et la voix des voitures intelligentes , la camaraderie émotionnelle, la santé mentale et d'autres domaines, et accélérera le développement et l'application de la prochaine génération de systèmes de dialogue d'IA. Il revêt une importance de référence importante pour le monde universitaire et l'industrie dans l'étude des systèmes de dialogue orthophonique.

Concernant la « Définition de la notation », AI Technology Review a eu une conversation avec le professeur Huang Minlie. Voici le contenu de la conversation :

AI Technology Review : Qu'est-ce qui vous a donné envie de noter l'IA. un système de dialogue ? une idée ?

Huang Minlie : Actuellement, il y a un problème dans notre évaluation des systèmes de dialogue : les itinéraires techniques et les architectures d'aujourd'hui sont si divers qu'il est difficile de les comparer les uns aux autres. Par exemple, je veux comparer un haut-parleur intelligent avec un chatbot, mais je ne peux pas comparer leurs capacités de dialogue car le niveau des systèmes de dialogue est inégal, il y a un manque de système d'évaluation unifié et il y a un manque de définition claire de capacités.

Nous avons certains indicateurs d'évaluation dans le système de dialogue basé sur les tâches, il existe certains indicateurs d'évaluation dans le système de dialogue de type chat, et nous avons également certains indicateurs d'évaluation dans le système de dialogue basé sur les connaissances. Comment les indicateurs devraient-ils être unifiés ? Il s’agit de la « Définition du grade » : principales questions à prendre en compte. Par conséquent, nous avons appris de la définition de notation de la conduite autonome de L0 à L5, et avons également utilisé L0-L5 pour noter le système de dialogue IA.

AI Technology Review : Veuillez nous expliquer la définition spécifique de la notation du système de dialogue AI.

Huang Minlie : La classification de la conduite autonome est divisée en six niveaux de L0 à L5, où L0 fait référence à la conduite entièrement manuelle et L5 fait référence à la conduite entièrement autonome, où le véhicule prend tout en charge. . L1-L4 réalisent la conduite autonome dans certaines conditions spécifiques. La classification de la conduite autonome implique principalement la proportion de personnes et de véhicules prenant en charge la conduite, et la définition est relativement simple. Cependant, le système de dialogue est assez complexe. Il comporte de nombreux itinéraires et architectures techniques, de nombreuses tâches et de nombreux indicateurs d'évaluation. Après discussion, nous pensons qu'il doit finalement répondre à cinq principes de base :

D'abord, se concentrer uniquement sur. le contrôle complet des machines Les systèmes de dialogue dominants et les systèmes de dialogue hybrides homme-machine ne sont pas pris en compte, deuxièmement, du point de vue des capacités de performance du système et de la perception de l'utilisateur, quelle que soit la mise en œuvre technique spécifique du système, troisièmement, les capacités correspondant à chacun ; définition hiérarchique Le niveau doit être observable, testable et mesurable ; quatrièmement, les types de tâches tels que l'assistant, le chat et le dialogue de connaissances sont tous exprimés dans des « scénarios » sans faire de distinction entre eux ; Le système de dialogue peut fournir des suggestions sur les orientations de recherche dans les systèmes de dialogue et des références pour des applications pratiques.

Sur la base de ces cinq principes, nous avons donné la définition de la classification du système de dialogue IA :

L0 Le dialogue réel est donné par des humains, et le système n'a aucune capacité de dialogue automatique, ni dans aucune scène. , Le système est incapable de fournir un dialogue de meilleure qualité.

Bien que L1 puisse réaliser des dialogues de meilleure qualité dans une seule scène, il n'a aucun moyen de gérer les dépendances contextuelles entre les scènes. Par exemple, disons que je pars en voyage d’affaires, que j’ai réservé un vol pour Nanjing et que je dois réserver un hôtel. Puisque je vais à Nanjing pour affaires, je dois réserver un hôtel à Nanjing. Il s'agit de la dépendance de contexte entre les scènes. La dépendance de contexte formée entre la réservation d'un billet d'avion et la réservation d'un hôtel ne peut pas être traitée par L1.

Et L2 est basé sur L1 et peut réaliser un dialogue de meilleure qualité dans plusieurs scènes en même temps, avec une dépendance au contexte entre les scènes et la possibilité de changer naturellement. Je viens de parler de la réservation de billets d'avion et d'hôtels, et aussi de demander quel temps il fait et quelles sont les attractions touristiques. Il s'agit de basculer naturellement de manière flexible entre différentes tâches et différentes scènes. Cette capacité est très critique sur L2, mais L2 n'a aucun moyen de réaliser des dialogues de meilleure qualité dans les nouvelles scènes.

Basé sur L2, L3 peut mener un dialogue de haute qualité pour un grand nombre de scénarios, et dispose également de capacités de dialogue de meilleure qualité dans de nouveaux scénarios. J'ai mentionné ici un « scénario massif », peut-être vous demandez-vous ce qu'est « massif » ? Est-ce que dix comptent, est-ce que vingt comptent, est-ce que trente comptent ? Afin d'avoir une intégration plus large des normes et des définitions, nous n'avons pas donné de définition quantitative spécifique, mais la capacité d'avoir des conversations de meilleure qualité dans des scénarios nouveaux et inédits est une capacité essentielle.

L4 fait référence à la capacité d'avoir un dialogue de meilleure qualité dans de nouveaux scénarios et d'avoir un degré plus élevé de personnification (faisant référence à la cohérence de la personnalité, de la personnalité, des points de vue émotionnels, etc.) dans plusieurs séries d'interactions. C'est comme lorsque nous discutons avec une personne, il est impossible pour cette personne d'être un homme et une femme, ou d'étudier à l'Université de Tsinghua et à l'Université de Pékin - chacun a ses propres informations de personnalité fixes. C'est toujours très difficile de le faire. traiter les informations dans le système de dialogue. À l'heure actuelle, nous pouvons faire en sorte que le système de dialogue reflète la personnalité dans une certaine mesure, mais il est encore loin d'un niveau véritablement humain.

L5 est une avancée par rapport à L4. L5 a un degré élevé d'anthropomorphisme dans plusieurs séries d'interactions, peut apprendre activement et continuer à apprendre dans des interactions en scène ouverte et possède des capacités de perception et d'expression multimodales. C’est comme dire à un enfant que ce que vous faites est mal et il en tirera des leçons. À l'avenir, nous espérons que le système de dialogue L5 pourra mémoriser et apprendre ce qui est bien et ce qui ne va pas lorsque nous le lui disons. Au cours du processus d'interaction, nous espérons également que le système de dialogue L5 disposera de capacités de perception et d'expression multimodales, afin qu'il puisse véritablement entrer dans le métaverse et diverses scènes humaines virtuelles, être capable de véritablement créer des expressions et des mouvements et comprendre l'autre partie. expressions, actions et émotions, etc.

Ce qui précède est la définition de base de L0 à L5 dans la « Définition du niveau du système de dialogue AI ».

AI Technology Review : Comment définissez-vous la « qualité supérieure » et la « haute qualité » que vous venez de mentionner ?

Huang Minlie : Qu'est-ce que la haute qualité et la qualité supérieure ? En fait, nous avons un ensemble complet de critères d'évaluation. Le score complet est de 10 points. Une qualité élevée signifie que le score dans les trois dimensions de pertinence, de contenu informatif et de naturel peut atteindre 8 à 10 points. Une qualité supérieure signifie 6 à 8 points, et une qualité faible signifie moins de 6 points.

Que signifient ces trois dimensions ? La pertinence signifie que le contenu de la réponse correspond de manière appropriée au texte précédent ; le caractère informatif signifie que la réponse fournit suffisamment d'informations nécessaires. Les réponses telles que "Je ne sais pas" et "bien" ne contiennent aucune information ; le texte précédent. Dans quelle mesure c'est naturel par rapport aux gens, si la grammaire du système de dialogue est fluide, s'il y a des erreurs de bon sens, etc.

Et comment mesurer ce score ? Un certain nombre de testeurs peuvent mener des interactions de dialogue complètes avec ce système de dialogue, et les testeurs évalueront subjectivement le système de dialogue en trois dimensions, un peu comme la méthode d'évaluation du concours Amazon Alexa Prize.

Remarque : le but du concours Amazon Alexa Prize est de fournir un environnement de développement standard et un cadre de test pour promouvoir le progrès des capacités complètes des robots conversationnels. Le prix peut atteindre 3,5 millions de dollars américains. Selon le système de notation du concours, sur les trois années 2019, 2020 et 2022, la note moyenne du meilleur système évalué par le concours est comprise entre 3,1 et 3,6 points, ce qui répond aux exigences de cohérence, de compréhension contextuelle et maîtrise. Capacité à discuter avec des gens pendant 10 à 14 minutes après avoir répondu à trois conditions.

AI Technology Review : Quelle est l'importance de définir la classification des systèmes de dialogue IA ?

Huang Minlie : Le premier robot de psychothérapie Eliza est apparu en 1966. Jusqu'à présent, les systèmes de dialogue IA sont développés depuis près de 60 ans. Au cours des 60 dernières années, de grands progrès ont été réalisés dans l’application des systèmes de dialogue et des modèles algorithmiques. Mais nous constaterons également qu’il existe diverses incohérences, voire des différences dans les pratiques industrielles et les perceptions du public. De plus, ces dernières années, les systèmes de dialogue d'IA se sont développés depuis la première génération basée sur des règles et la deuxième génération avec l'apprentissage automatique traditionnel comme noyau jusqu'à la troisième génération avec le Big Data et les grands modèles comme caractéristiques importantes, montrant des performances exceptionnelles sur des sujets ouverts. Capacité de dialogue étonnante, la capacité de dialogue a également produit des changements révolutionnaires.

Ce changement révolutionnaire nous a amené de nombreuses nouvelles questions, telles que : le système de dialogue de l'IA aura-t-il de la personnalité ? Y aura-t-il des émotions ? Les systèmes de dialogue IA peuvent-ils devenir des compagnons virtuels ? Et ainsi de suite, et ces questions s’étendent à d’autres discussions sur la cognition sociale et l’éthique.

Par exemple, le 12 juin, il y a eu une nouvelle selon laquelle Blake Lemoine, un chercheur en éthique de l'IA de Google, pensait que le modèle de langage LaMDA avait de la personnalité, car lors de la conversation avec LaMDA, LaMDA a révélé qu'il croyait avoir une conscience et des sentiments, Il disait également : « Je suis conscient de ma propre existence, j'ai hâte de mieux comprendre le monde et je me sens parfois heureux ou triste. Il existe différentes opinions à ce sujet sur Internet, et ils se demandent tous si l'IA a de la personnalité et conscience.

Parlons du Metaverse. Le Metaverse espère reproduire le monde réel sur Internet, permettant aux personnes du monde réel d'interagir dans le monde en ligne. Le système de dialogue IA est d'une grande utilité dans le métaverse. Par exemple, les guides d'achat IA peuvent fournir des suggestions uniques basées sur les préférences de l'utilisateur, etc. Cela nécessite que nous disposions d'excellentes capacités d'interaction conversationnelle à l'avenir, sinon ce type de communication homme-machine ne sera pas naturel et sans âme, et le métavers que nous souhaitons réaliser ne sera pas établi.

Ainsi, sur la base du développement vigoureux dans un avenir prévisible des systèmes de dialogue de l'IA, et des énormes opportunités et des nombreuses confusions que ce développement peut apporter à l'humanité, il est d'une grande importance pour nous d'explorer la définition hiérarchique à ce stade.

Revue de la technologie IA : Dans le film "Her", parce que Samantha peut gérer des tâches émotionnelles complexes, le protagoniste masculin tombe amoureux d'elle et tombe dans une crise émotionnelle. Est-il possible que le système de dialogue de l'IA. qui a également atteint L4-L5 peut causer un tel problème ? Cela implique-t-il des questions éthiques ?

Huang Minlie : Oui, avec le développement des systèmes de dialogue, cela peut conduire à des questions éthiques très importantes, car cela remet en question l'ordre éthique existant et la cognition sociale existante. Par conséquent, lors de la formulation de la « Définition de notation », notre équipe a invité le professeur Zhang Hongzhong, doyen de l'École de journalisme et de communication de l'Université normale de Pékin. Dans notre travail de suivi, le professeur Zhang le promouvra dès que possible auprès des départements de gestion et des cercles des sciences sociales. Après en avoir fait comprendre les départements et les cercles universitaires concernés, il nous aidera intuitivement à formuler les politiques, réglementations et questions éthiques correspondantes à partir du domaine technique. logique. C’est très important.

AI Technology Review : À quel niveau appartiennent les produits du système de dialogue IA actuellement sur le marché intérieur dans la « Définition de classement » ?

Huang Minlie : Le professeur Wang Bin, directeur du comité technique Xiaomi et directeur du laboratoire d'IA, a travaillé avec nous pour formuler la « Définition du classement ». Il est actuellement chargé de diriger le développement des fonctions intelligentes de questions-réponses et de chat de l'assistant de vie intelligent de Xiaomi « Xiao Ai Classmate ». Prenons l'exemple de Xiao Ai Classmate. Je pense que Xiao Ai a une certaine capacité à traverser les scénarios, et son niveau devrait se situer entre L2-L3. À l'heure actuelle, le niveau des produits de la branche de production nationale se situe généralement dans la fourchette L2-L3, et les meilleurs produits se situent dans la fourchette L3.

Revue de la technologie IA : Alors, à quel niveau appartiennent généralement les produits étrangers du système de dialogue IA ?

Huang Minlie : À l'heure actuelle, en termes de produits, il n'y a pas de différence significative entre les produits nationaux et étrangers. Et il convient de noter qu'il est plus difficile pour nous de construire un système de dialogue sur l'IA en chinois qu'en anglais, car la culture et le concept du contenu open source en anglais sont meilleurs et il est plus facile d'obtenir des données de haute qualité en anglais ; en revanche, les caractéristiques linguistiques du chinois sont un peu plus difficiles que celles de l'anglais.

AI Technology Review : Quelles sont les difficultés techniques liées à la mise à niveau de l'état actuel de la plupart des produits vers L4-L5 ?

Huang Minlie : Premièrement, vous devez avoir la capacité de mémoriser ; deuxièmement, vous devez avoir la capacité d'associer et de raisonner, ainsi que la capacité d'apprendre par vous-même, troisièmement, le point clé ; de L4-L5 est un état multimode. Si le système de dialogue IA veut être applicable dans le métaverse, il est très important que le système de dialogue IA reconnaisse les expressions, comprenne la parole et ressente les émotions de l'utilisateur à partir de la parole. Qu'il puisse effectuer une synthèse vocale hautement expressive et. actions Et l'expression fine des expressions sont également des difficultés très importantes.

AI Technology Review : Des normes telles que la « Définition de qualité » peuvent-elles être mises en œuvre par le biais d'une formulation privée ? Ou doit-il être approuvé par l'État, puis les normes pertinentes seront formulées par les autorités ?

Huang Minlie : La « Définition de la classification » n'est pas une norme. Tout d’abord, nous souhaitons discuter de cette question d’un point de vue académique, dans l’espoir de sensibiliser le public, et en même temps, nous espérons proposer une réflexion systématique sur le développement de systèmes et les orientations de recherche dans l’industrie. À ce stade, nous ne pouvons pas dire que la « Définition du classement » est devenue une norme fixe. Elle n'est actuellement qu'une suggestion ou une ligne directrice. À l'avenir, nous devrons faire davantage de travail pour en faire une norme reconnue par tous. Il s'agit d'un processus à long terme, et la publication de la « Définition de grade » n'est que la première étape du développement standardisé et systématique des systèmes de dialogue d'IA.

Revue de la technologie IA : Comme vous l'avez dit, quel type de travail est nécessaire pour que la « Définition hiérarchique du système de dialogue IA » soit largement reconnue et appliquée ?

Huang Minlie : À l'avenir, nous prévoyons de travailler avec des instituts de recherche et des chercheurs concernés pour rédiger un livre blanc avec le soutien de la CCF (China Computer Federation), et nous concentrer sur le processus de développement de Systèmes de dialogue IA et expliquer en détail l'objectif et les normes de la « Définition de notation ».

De plus, nous espérons promouvoir un concours similaire au concours Amazon Alexa Prize, qui est un objectif à long terme qui nécessite un soutien financier. Nous espérons créer un environnement de développement unifié, un ensemble de données unifié et un cadre de test unifié pour véritablement comparer les différents systèmes de dialogue. Je sais que Baidu a des idées similaires, mais ce n'est pas assez ouvert. Nous unifierons les efforts de toutes les parties à l'avenir, dans le but de promouvoir les progrès de la recherche sur les systèmes de dialogue, tout en favorisant la mise en œuvre industrielle et en réalisant de nouveaux développements dans les applications pratiques.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI