Maison >Périphériques technologiques >IA >2023 approche, les perspectives annuelles de Ng Enda, Bengio et autres grands ! Des modèles d'IA rationnels arrivent-ils ?

2023 approche, les perspectives annuelles de Ng Enda, Bengio et autres grands ! Des modèles d'IA rationnels arrivent-ils ?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-12 22:04:011144parcourir

Dans moins de 3 jours, 2022 passera.

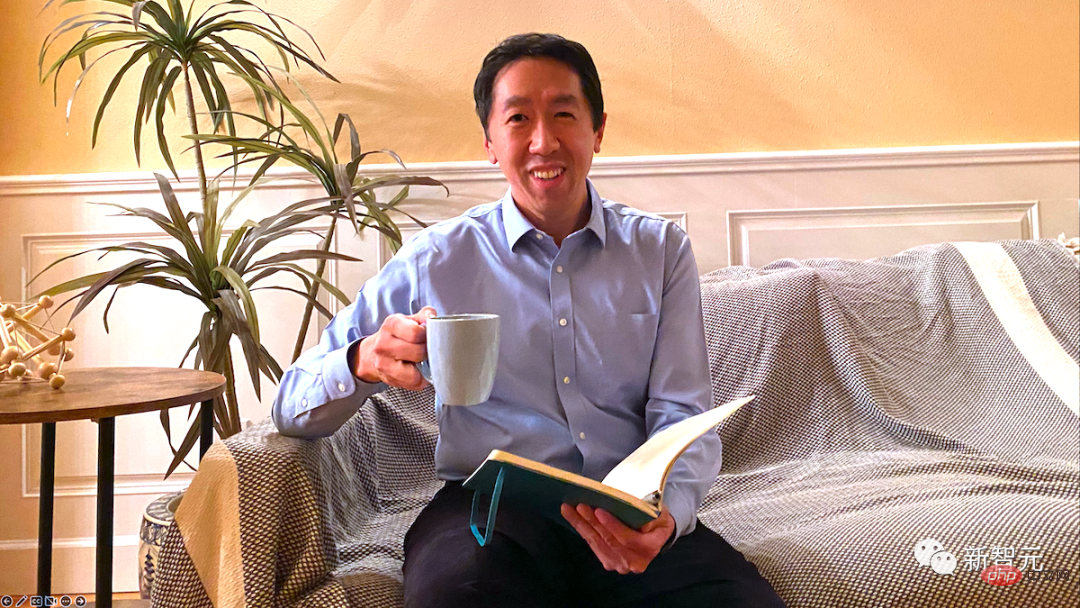

A l'occasion de faire ses adieux à l'ancien et d'accueillir le nouveau, Ng Enda, Bengio et d'autres magnats de l'IA se sont réunis sur DeepLearning.ai pour regarder 2023 dans leurs propres yeux.

En tant que fondateur de DeepLearning.ai, Andrew Ng a d'abord prononcé un discours de bienvenue et a rappelé les années où il a commencé à faire de la recherche, ce qui a constitué un bon début pour cette discussion impliquant de nombreux grands noms.

Chers amis :

Alors que nous entrons dans la nouvelle année, ne considérons pas 2023 comme une seule année isolée, mais comme l'année dans le futur où nous accomplirons nos objectifs à long terme en la première année. Certains résultats mettent du temps à être obtenus, mais nous pouvons y parvenir plus efficacement si nous envisageons un chemin plutôt que de simplement passer d’une étape à l’autre.

Quand j'étais jeune, je faisais à peine des liens concrets entre les actions à court terme et les résultats à long terme. Je me concentrais toujours sur le prochain objectif, projet ou document de recherche, en disant qu'il y avait un vague objectif sur 10 ans mais pas de chemin clair pour y arriver.

Il y a 10 ans, j'ai construit mon premier cours de machine learning en une semaine (souvent en tournage à 2h du matin). Cette année, j'ai mis à jour le contenu du cours pour la majeure Machine Learning et mieux planifié l'ensemble du cours (même si certaines photos sont encore prises à 2 heures du matin, mais le nombre est réduit !).

Dans les entreprises précédentes, j'avais tendance à créer un produit, puis à réfléchir à la manière de le proposer aux clients. Aujourd’hui, dès les premiers stades, je pense davantage aux besoins de mes clients.

Les commentaires d'amis et de mentors peuvent vous aider à façonner votre vision. Une étape importante dans ma croissance a été d’apprendre à faire confiance aux conseils de certains experts et mentors et d’essayer de les comprendre. Par exemple, j’ai des amis experts en géopolitique mondiale, et ils me conseillent parfois d’investir davantage dans des pays spécifiques.

Je ne peux pas arriver moi-même à cette conclusion car je ne connais pas grand chose sur ces pays. Mais j’ai appris à expliquer mes projets à long terme, à leur demander leur avis et à les écouter attentivement lorsqu’ils m’orientent dans des directions différentes.

À l'heure actuelle, l'un de mes principaux objectifs est de démocratiser l'innovation en matière d'IA. Permettez à davantage de personnes de créer des systèmes d’intelligence artificielle personnalisés et d’en bénéficier. Même si le chemin vers cet objectif a été long et difficile, je pouvais voir les étapes à suivre pour y parvenir, et les conseils d’amis et de mentors ont grandement façonné ma réflexion.

À l’approche de 2023, jusqu’où pouvez-vous planifier l’avenir ? Vous souhaitez acquérir une expertise sur un sujet, faire progresser votre carrière ou résoudre un problème technique ? Faire des hypothèses de chemin (même celles non testées) et solliciter des commentaires pour les tester et les affiner ?

Ayez des rêves pour 2023.

Bonne année !

Andrew Ng

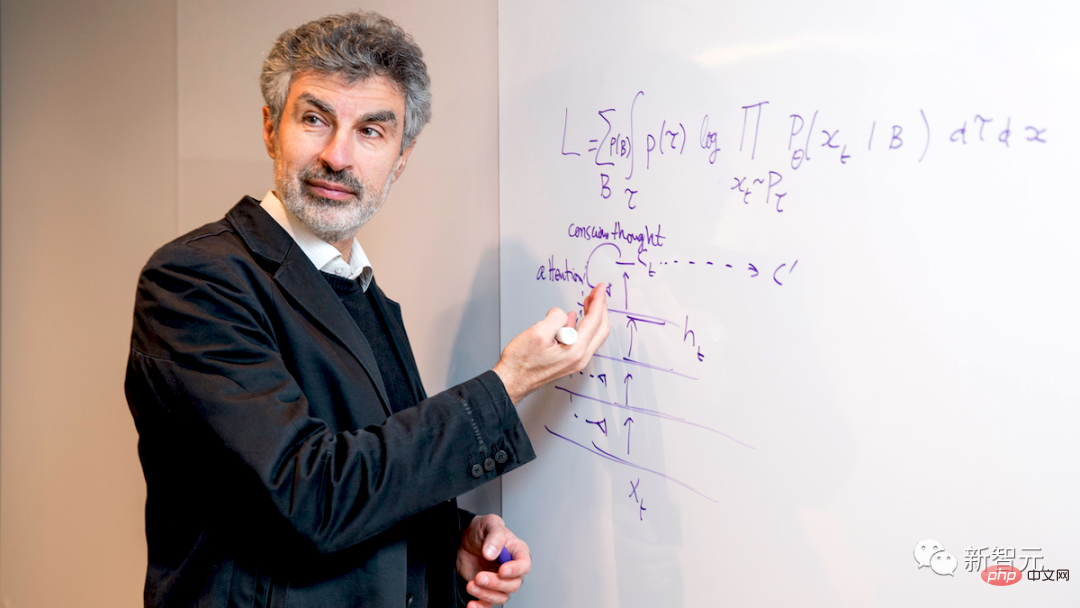

Yoshua Bengio : À la recherche de modèles d'IA rationnels

Dans le passé, les progrès de l'apprentissage profond consistaient principalement à « renforcer les miracles » : adopter la dernière architecture, améliorer le matériel et augmenter la puissance de calcul, les données et l'échelle. Avons-nous déjà l'architecture dont nous avons besoin et il ne nous reste plus qu'à développer un meilleur matériel et de meilleurs ensembles de données afin que nous puissions continuer à évoluer ? Est-ce qu'il manque quelque chose maintenant ?

Je pense qu'il manque quelque chose, et j'espère retrouver ces choses manquantes au cours de l'année à venir.

Je travaille avec des neuroscientifiques et des neuroscientifiques cognitifs pour étudier l'écart entre les systèmes de pointe et les humains. Augmenter simplement la taille du modèle ne comblera pas cette lacune. Au lieu de cela, intégrer dans les modèles actuels une capacité humaine à découvrir et à raisonner sur des concepts de haut niveau et leurs relations pourrait creuser encore plus l’écart.

Pensez au nombre d'exemples requis pour apprendre une nouvelle tâche, ce qu'on appelle la « complexité des échantillons ». Entraîner un modèle d’apprentissage profond pour jouer à un nouveau jeu vidéo nécessite une grande quantité de gameplay que les humains peuvent apprendre très rapidement. Mais les ordinateurs doivent considérer d’innombrables possibilités pour planifier un itinéraire efficace d’un point A à un point B. Les humains n'en ont pas besoin.

Les humains peuvent sélectionner les bons éléments de connaissances et assembler ces éléments pour former un ensemble pertinent d'explications, de réponses ou de plans. De plus, étant donné un ensemble de variables, les humains sont très doués pour déterminer quelles sont les causes et lesquels sont les effets. La technologie actuelle de l’intelligence artificielle n’est pas proche du niveau humain dans cette capacité.

Normalement, les systèmes d'IA ont une grande confiance dans l'exactitude des réponses et des solutions qu'ils génèrent, même si elles sont réellement fausses. Ce problème pourrait être une plaisanterie amusante dans une application comme un générateur de texte ou un chatbot, mais il pourrait mettre la vie en danger dans une voiture autonome ou un système de diagnostic médical.

Le comportement des systèmes d'IA actuels est en partie dû au fait qu'ils sont conçus pour le faire. Par exemple, un générateur de texte est formé uniquement pour prédire le mot suivant, plutôt que pour établir une structure de données interne ou pour expliquer les concepts sur lesquels il opère et les relations entre eux.

Mais je pense que nous pouvons concevoir des systèmes d'IA capables de suivre le sens des choses et de raisonner à leur sujet, tout en profitant des nombreux avantages des méthodes actuelles d'apprentissage en profondeur. Cela répond à des défis allant de la complexité excessive des échantillons aux inexactitudes excessives.

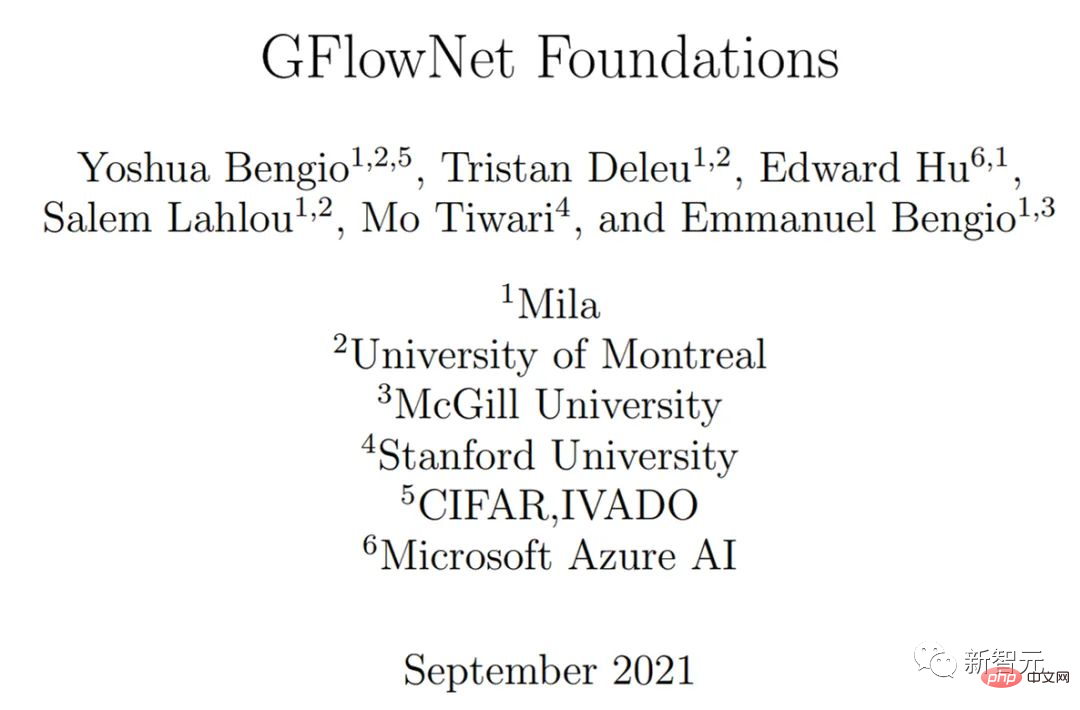

Lien papier : https://arxiv.org/pdf/2111.09266.pdf

Je suis très intéressé par les GFlowNets "Generative Flow Network", qui fait partie de notre équipe Une nouvelle méthode de formation des réseaux profonds a débuté il y a des années. L’idée a été inspirée par la façon dont les humains raisonnent à travers une série d’étapes, ajoutant de nouvelles informations pertinentes à chaque étape.

C'est comme un apprentissage par renforcement dans la mesure où le modèle apprend les politiques de manière séquentielle pour résoudre le problème. Cela s'apparente également à la modélisation générative dans la mesure où elle peut échantillonner des solutions qui correspondent à un raisonnement probabiliste.

Si vous pensez à une interprétation d'une image, votre pensée peut être convertie en phrase, mais ce n'est pas la phrase elle-même. Au lieu de cela, il contient des informations sémantiques et relationnelles sur les concepts de la phrase. Généralement, nous représentons ce contenu sémantique sous forme de graphe, où chaque nœud est un concept ou une variable.

Je ne pense pas que ce soit la seule solution et j'ai hâte de voir une variété d'approches. Grâce à une exploration diversifiée, nous aurons plus de chances de trouver ce qui manque actuellement dans le domaine de l’IA et de combler le fossé entre les humains actuels et l’IA au niveau humain.

Yoshua Bengio est professeur d'informatique à l'Université de Montréal et directeur scientifique de l'Institut Mila-Québec pour l'intelligence artificielle. Il a reçu le prix Turing 2018 aux côtés de Geoffrey Hinton et Yann LeCun pour ses contributions révolutionnaires à l'apprentissage profond.

Alon Halevy : Chronologie des données personnelles

Alon Halevy est un informaticien israélo-américain et un expert dans le domaine de l'intégration de données. Il a été chercheur scientifique chez Google de 2005 à 2015, où il était responsable des tables de fusion de données Google.

Il est membre de l'ACM et a reçu le prix présidentiel américain (PECASE) en 2000. Il est également le fondateur des sociétés technologiques Nimble Technology (maintenant Actuate Corporation) et Transformic Inc.

En prévision de 2023, Halevy se concentre sur la construction de la chronologie des données personnelles.

Comment les entreprises et organisations utilisent-elles les données des utilisateurs ? Cette question importante a reçu une large attention dans les cercles techniques et politiques.

En 2023, il y a une question tout aussi importante qui mérite plus d'attention : Comment pouvons-nous, en tant qu'individus, utiliser les données générées pour améliorer notre santé, augmenter notre vitalité et notre productivité ?

Nous générons chaque jour toutes sortes de données. Les photos capturent nos expériences de vie, les téléphones portables enregistrent nos entraînements et nos lieux, et les services Internet enregistrent ce que nous consommons et achetons.

Nous enregistrons également divers souhaits : les voyages que nous voulons faire et les restaurants que nous voulons essayer, les livres et les films que nous prévoyons de profiter et les activités sociales que nous voulons avoir.

Bientôt, des lunettes intelligentes enregistreront plus en détail nos différentes expériences. Cependant, ces données sont dispersées dans de nombreuses applications. Afin de mieux résumer les expériences passées, nous devons organiser chaque jour les souvenirs passés provenant de différentes applications.

Que diriez-vous de rassembler toutes les informations dans un calendrier personnel pour nous aider à avancer vers nos objectifs, nos espoirs et nos rêves ? En fait, quelqu’un a eu cette idée il y a longtemps.

Dès 1945, le scientifique américain Vannevar Bush conçoit un produit appelé Memex. Dans les années 1990, Gordon Bell et ses collègues de Microsoft Research ont créé MyLifeBits, capable de stocker toutes les informations sur la vie d'une personne.

Cependant, lorsque nous conservons toutes les données au même endroit, la protection de la vie privée et la prévention de l'utilisation abusive des informations sont évidemment une question clé.

Actuellement, aucune entreprise ne peut posséder toutes nos données, ni n'est autorisée à stocker toutes nos données. Par conséquent, un effort de collaboration est nécessaire pour développer la technologie nécessaire pour prendre en charge les délais personnels, y compris les protocoles d'échange de données, le stockage crypté et le traitement sécurisé.

Pour créer une chronologie personnelle, deux défis techniques doivent être résolus.

Le premier défi est une question et une réponse intelligente sur le système. Bien que nous ayons fait des progrès significatifs dans la réponse aux questions basée sur du texte et des données multimodales, dans de nombreux cas, la réponse intelligente aux questions nécessite que nous raisonnions explicitement sur l’ensemble des réponses.

C'est la base du système de base de données. Par exemple, pour répondre « Quels cafés ai-je visités à Tokyo ? » ou « Combien de semi-marathons ai-je couru en deux heures ? », il faut récupérer la collection comme réponse intermédiaire. À l’heure actuelle, cette tâche ne peut pas être réalisée en traitement du langage naturel.

Pour s'inspirer davantage de la base de données, le système doit également être capable d'expliquer la source de la réponse et de déterminer si la réponse est correcte et complète.

Le deuxième défi dans la construction d'une chronologie personnelle est de savoir comment développer une technologie d'analyse des axes de données personnelles pour améliorer la qualité de vie de l'utilisateur.

Selon la psychologie positive, les gens peuvent créer des expériences positives pour eux-mêmes et développer de meilleures habitudes pour un meilleur développement. Un agent IA qui a accès à notre vie quotidienne et à nos objectifs peut nous rappeler les choses que nous devons accomplir et éviter.

Bien sûr, ce que nous choisissons de faire dépend de nous, mais je crois qu'une IA capable de comprendre pleinement nos activités quotidiennes, d'avoir une meilleure mémoire et de meilleures capacités de planification profitera beaucoup à tout le monde.

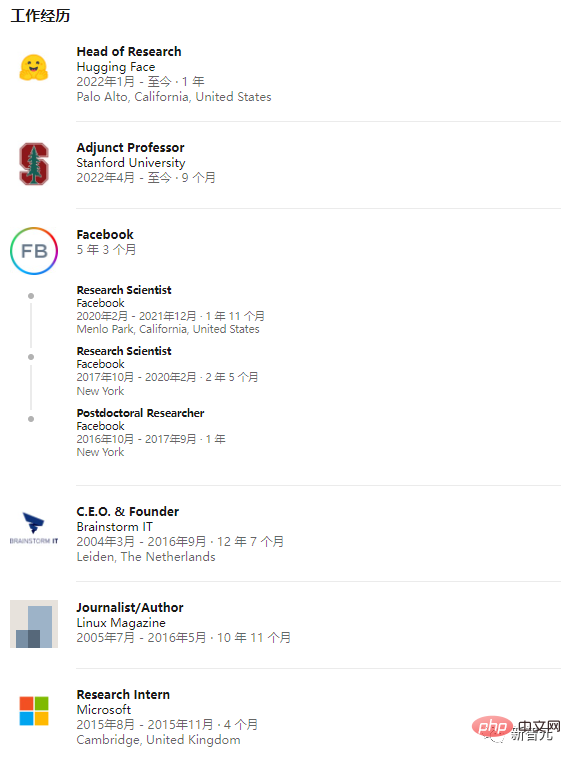

Douwe Kiela : Moins de battage médiatique, plus de prudence

Douwe Kiela est professeur adjoint de systèmes symboliques à l'Université de Stanford. Après avoir obtenu sa maîtrise et son doctorat à l'Université de Cambridge, Kiela a travaillé comme chercheur chez IBM, Microsoft et Facebook AI, et comme directeur de recherche chez Hugging Face.

Dans ses perspectives pour la nouvelle année, Kiela a exprimé ses vœux pour le développement des systèmes d'intelligence artificielle.

Cette année, nous voyons vraiment l'intelligence artificielle commencer à devenir courante. Des systèmes comme Stable Diffusion et ChatGPT ont complètement captivé l’imagination du public.

Nous vivons une époque passionnante et nous sommes à l’aube de quelque chose de grand : il n’est pas exagéré de dire que ce changement de capacités sera aussi perturbateur que la révolution industrielle.

Mais au milieu de cette excitation, nous devons nous méfier du battage médiatique, être extrêmement prudents et mener la recherche et le développement de manière responsable.

Que ces systèmes « aient réellement un sens » pour les grands modèles de langage, les profanes les anthropomorphiseront en raison de leur capacité à faire ce qui est le plus typiquement humain : produire du langage.

Cependant, nous devons éduquer le public sur les capacités et les limites de ces systèmes d'intelligence artificielle, car le public croit généralement que les ordinateurs sont toujours les mêmes vieux processeurs symboliques, par exemple, ils sont bons en mathématiques mais pas bons. à l'art, et la situation actuelle Bien au contraire.

L'IA moderne présente un sérieux défaut et ses systèmes peuvent facilement être accidentellement ou intentionnellement mal utilisés. Non seulement ils produisent de la désinformation, mais ils semblent si confiants que les gens les croient.

Ces systèmes d'IA ne comprennent pas suffisamment le monde humain multimodal complexe et n'ont pas ce que les philosophes appellent la « psychologie populaire », c'est-à-dire la capacité d'expliquer et de prédire le comportement et les états mentaux des autres.

Actuellement, les systèmes d'IA sont encore des produits gourmands en ressources et nous en savons très peu sur la relation entre les données d'entraînement d'entrée et le modèle de sortie.

Dans le même temps, même si la mise à l'échelle du modèle peut grandement améliorer l'efficacité - par exemple, certaines fonctionnalités n'apparaissent que lorsque le modèle atteint une certaine taille - il existe également des signes indiquant qu'à mesure que ce modèle évolue, il est plus susceptible d'être biaisé, et même si c'est un système encore plus injuste.

J'espère donc pour 2023 que nous pourrons améliorer ces problèmes. La recherche sur la multimodalité, la localisation et l’interaction peut permettre aux systèmes de mieux comprendre le monde réel et le comportement humain, et donc de mieux comprendre les humains.

L'étude de l'alignement, de l'attribution et de l'incertitude peut rendre les systèmes d'IA plus sûrs, moins sujets aux hallucinations et créer des modèles de récompense plus précis. L’IA centrée sur les données promet de démontrer des lois de mise à l’échelle plus efficaces qui transformeront plus efficacement les données en modèles robustes et équitables.

Lien papier : https://arxiv.org/pdf/2007.14435.pdf

Enfin, nous devrions accorder plus d'attention à la crise actuelle de l'évaluation de l'intelligence artificielle. Nous avons besoin de mesures plus granulaires et complètes de nos données et de nos modèles pour garantir que nous pouvons décrire nos progrès et nos limites et nous comprendre du point de vue de la validité écologique (par exemple, des cas d'utilisation réels des systèmes d'IA). développement de l’intelligence artificielle.

Been Kim : Utiliser la recherche scientifique pour expliquer le modèle

Been Kim est un scientifique de Google Brain et diplômé du MIT. Son domaine de recherche est l'apprentissage automatique interactif.

Tout en étant enthousiasmée par la créativité et les nombreuses réalisations dont l'IA a fait preuve au cours de la dernière année, elle a également présenté certains de ses points de vue sur la recherche future en IA.

C'est une période passionnante pour l'IA, avec des avancées fascinantes dans l'art génératif et de nombreuses autres applications,

Bien que ces orientations soient passionnantes, passionnantes, mais je pense que nous devons travailler sur des pistes moins difficiles des choses, pas seulement combien l'IA peut créer ou quelle taille de modèle elle peut concevoir :

Revenez à l'essentiel et étudiez les modèles d'IA comme objectif de recherche scientifique.

Pourquoi fais-tu ça ?

Le domaine de l'interprétabilité vise à créer des outils pour générer des explications pour la sortie de modèles complexes, nous aidant à explorer la relation entre l'IA et les humains.

Par exemple, un outil prend une image et un modèle de classification et génère une explication sous forme de pixels pondérés. Plus le poids d’un pixel est élevé, plus il est important. Par exemple, plus sa valeur a d’impact sur le résultat, plus elle peut être importante, mais la façon dont l’importance est définie varie d’un outil à l’autre.

Bien que l’IA générative ait connu un certain succès, de nombreux outils se sont avérés fonctionner d’une manière inattendue.

Par exemple, les interprétations d'un modèle non entraîné sont quantitativement et qualitativement impossibles à distinguer de celles d'un modèle entraîné, et bien qu'elles produisent le même résultat, les interprétations changent souvent avec de petits changements dans l'entrée.

De plus, il n'y a pas beaucoup de causalité entre le résultat du modèle et l'interprétation de l'outil. D'autres travaux ont montré qu'une bonne interprétation des résultats d'un modèle n'a pas nécessairement un impact positif sur la manière dont les gens utilisent le modèle.

Que signifie cette inadéquation entre les attentes et les résultats et que devons-nous faire pour y remédier ? Cela suggère que nous devons examiner la manière dont nous construisons ces outils.

Actuellement, nous adoptons une approche centrée sur l'ingénierie : essais et erreurs. Nous construisons l'outil sur la base de l'intuition (par exemple, nous générons des poids pour chaque bloc de pixels au lieu de pixels individuels, l'interprétation est plus intuitive).

Lien papier : https://arxiv.org/pdf/1811.12231.pdf

Une équipe de l'Université de Tübingen a découvert que les textures vues par les réseaux de neurones (comme les éléphants ) peau) plus que la forme (le contour de l'éléphant), même si nous avons vu en interprétant l'image que le contour de l'éléphant pouvait se présenter sous la forme de pixels mis en évidence collectivement.

Cette recherche nous apprend que les modèles peuvent voir non pas des formes mais des textures, ce que l'on appelle le biais inductif – une tendance d'une classe particulière de modèles à résulter de son architecture ou de la façon dont nous l'optimisons.

Révéler cette tendance peut nous aider à comprendre les modèles, tout comme révéler les tendances humaines peut être utilisé pour comprendre le comportement humain (comme les décisions injustes).

Cette méthode couramment utilisée pour comprendre les humains peut également nous aider à comprendre les modèles. Pour les modèles, du fait de la manière dont leurs structures internes sont construites, nous disposons d’un autre outil : l’analyse théorique.

Les travaux dans cette direction ont produit des résultats théoriques passionnants sur le comportement des modèles, des optimiseurs et des fonctions de perte. Certains utilisent des outils classiques issus des statistiques, de la physique, des systèmes dynamiques ou du traitement du signal, et de nombreux outils issus de différents domaines restent encore à explorer dans l’étude de l’intelligence artificielle.

Poursuivre la science ne signifie pas que nous devons arrêter de pratiquer : la science nous permet de construire des outils basés sur des principes et des connaissances, tandis que la pratique transforme les idées en réalité.

Lien papier : https://hal.inria.fr/inria-00112631/document

La pratique peut aussi inspirer la science : ce qui fonctionne dans la pratique peut être la structure de la science une référence pour les structures de modèles généralisées, tout comme les réseaux convolutionnels hautes performances ont inspiré en 2012 de nombreux articles théoriques analysant pourquoi la convolution facilite la généralisation.

Reza Zadeh : Laissez les modèles ML apprendre activement

Reza Zadeh est le fondateur et PDG de la société de vision par ordinateur Matroid. Il est diplômé de l'Université de Stanford. Ses domaines de recherche sont l'apprentissage automatique, l'informatique distribuée et les applications discrètes. . Mathématiques et l'un des premiers membres de Databricks.

Il estime que l'année 2023 à venir sera une année propice au décollage de l'apprentissage actif.

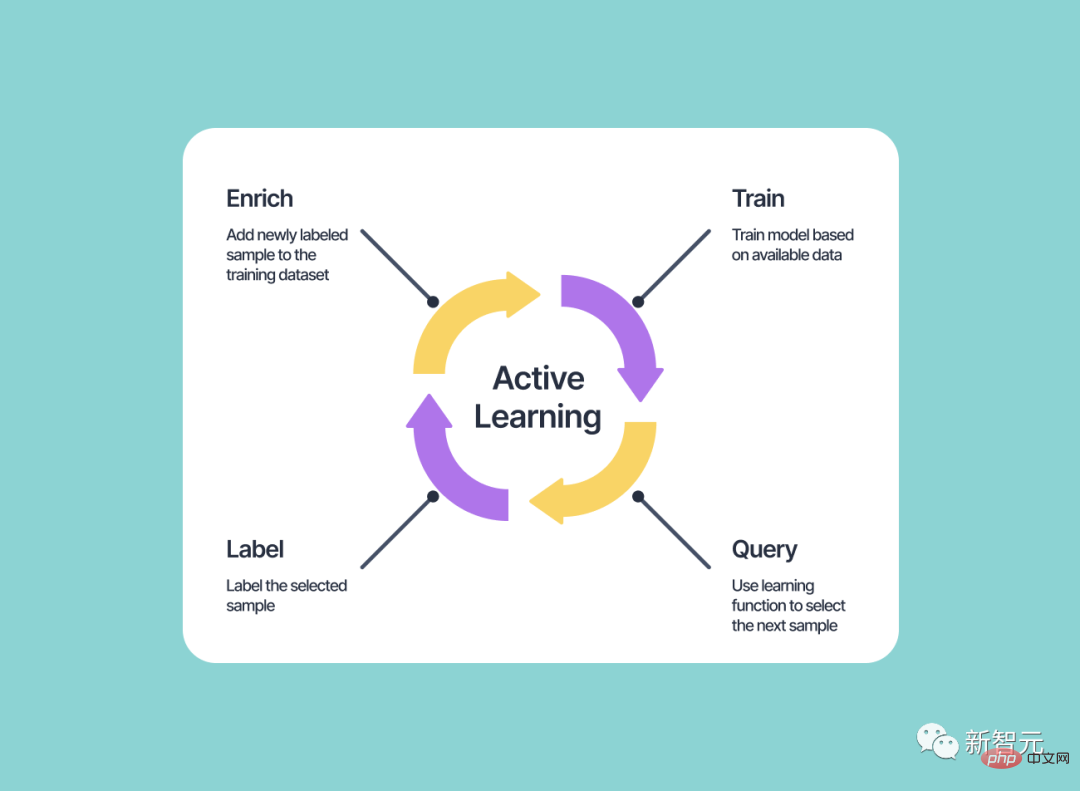

Alors que nous entrons dans la nouvelle année, on peut espérer que l'explosion de l'IA générative entraînera des progrès significatifs dans l'apprentissage actif.

Cette technique permet aux systèmes ML de générer leurs propres exemples de formation et de les étiqueter, alors que dans la plupart des autres formes d'apprentissage automatique, l'algorithme reçoit un ensemble fixe d'exemples et ne peut généralement apprendre qu'à partir de ces exemples.

Alors, que peut apporter l'apprentissage actif aux systèmes d'apprentissage automatique ?

- Adaptez-vous aux conditions changeantes

- Apprenez avec moins d'étiquettes

- Informez les gens des instances les plus précieuses/difficiles

- atteindre plus de Haute Performance

L'idée de l'apprentissage actif existe depuis des décennies mais n'a jamais vraiment fait son chemin. Auparavant, il était difficile pour les algorithmes de générer des images ou des phrases que les humains pouvaient évaluer et faire progresser les algorithmes d’apprentissage.

Mais avec la popularité de l'IA de génération d'images et de texte, l'apprentissage actif devrait réaliser des avancées majeures. Désormais, lorsqu'un algorithme d'apprentissage n'est pas sûr des étiquettes correctes pour une partie de son espace de codage, il peut générer de manière proactive des données à partir de cette partie pour les saisir.

L'apprentissage actif a le potentiel de révolutionner la façon dont l'apprentissage automatique est effectué car il permet aux systèmes de s'améliorer et de s'adapter continuellement au fil du temps.

Plutôt que de s'appuyer sur un ensemble fixe de données étiquetées, un système d'apprentissage actif peut rechercher de nouvelles informations et de nouveaux exemples pour l'aider à mieux comprendre le problème qu'il tente de résoudre.

Cela peut conduire à des modèles d'apprentissage automatique plus précis et efficaces et réduire le besoin de grandes quantités de données étiquetées.

J'attends avec impatience les dernières avancées en matière d'apprentissage actif en IA générative. À l’aube de la nouvelle année, nous verrons probablement davantage de systèmes d’apprentissage automatique mettre en œuvre des techniques d’apprentissage actif, et 2023 pourrait être l’année où l’apprentissage actif décollera réellement.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI