Maison >Périphériques technologiques >IA >Modèle open source, formation sur une seule carte, vous amène à comprendre la technologie populaire de génération audio guidée par texte AudioLDM

Modèle open source, formation sur une seule carte, vous amène à comprendre la technologie populaire de génération audio guidée par texte AudioLDM

- 王林avant

- 2023-04-12 19:04:121496parcourir

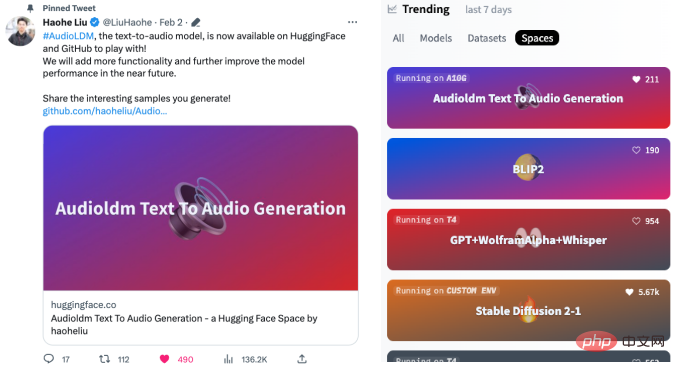

À partir d'un morceau de texte, l'intelligence artificielle peut générer de la musique, de la voix, divers effets sonores et même des sons imaginaires, tels que des trous noirs et des pistolets laser. AudioLDM, récemment lancé conjointement par l'Université de Surrey et l'Imperial College de Londres, est rapidement devenu populaire à l'étranger après sa sortie. Il a reçu près de 300 retweets et 1 500 likes sur Twitter en une semaine. Le deuxième jour après que le modèle ait été open source, AudioLDM s'est précipité en tête de la liste de recherche chaude de Hugging Face et, en une semaine, est entré dans la liste des 40 applications les plus populaires de Hugging Face (environ 25 000 au total), et est rapidement apparu dans de nombreux Travail dérivé basé sur AudioLDM.

Le modèle AudioLDM présente les points forts suivants :

- Le premier modèle open source capable de générer simultanément de la musique, de la parole et des effets sonores à partir de texte.

- Développé par le monde universitaire, il utilise moins de données, un seul GPU et des modèles plus petits pour obtenir les meilleurs résultats actuellement.

- Propose d'entraîner le modèle génératif de manière auto-supervisée, afin que la génération audio guidée par texte ne soit plus limitée par le problème des paires de données (texte-audio) manquantes.

- Le modèle peut réaliser un transfert de style audio, un remplissage audio manquant et une super-résolution audio sans formation supplémentaire (zéro-shot).

- Page d'accueil du projet : https://audioldm.github.io/

- Papier : https://arxiv.org/abs/2301.12503

- Code open source et modèle : https://github.com/haoheliu/AudioLDM

- Hugging Face Space : https://huggingface.co/spaces/haoheliu/audioldm-text-to-audio-generation

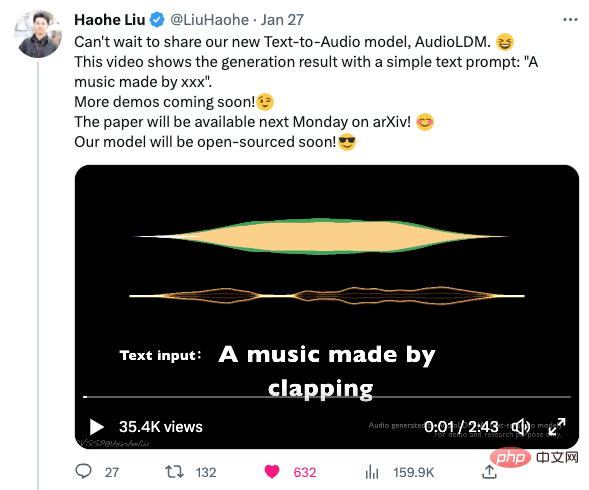

L'auteur a publié pour la première fois un aperçu du modèle le 27 janvier, montrant un texte très simple : "Une musique faite par []" (un morceau de musique généré par []) pour générer différents effets sonores. La vidéo, qui montre de la musique composée de différents instruments et même d'un moustique, a rapidement gagné du terrain sur Twitter, étant jouée plus de 35 400 fois et retweetée plus de 130 fois.

Ensuite, l'auteur a publié le document et une nouvelle vidéo. Dans cette vidéo, l'auteur démontre la plupart des capacités du modèle, ainsi que l'effet du travail avec ChatGPT pour générer des sons. AudioLDM peut même générer des sons provenant de l’espace.

Puis l'auteur a publié un article, un modèle pré-entraîné et une interface jouable, qui ont enflammé l'enthousiasme des internautes de Twitter et sont rapidement arrivés en tête de la liste de recherche chaude de Hugging Face le lendemain :

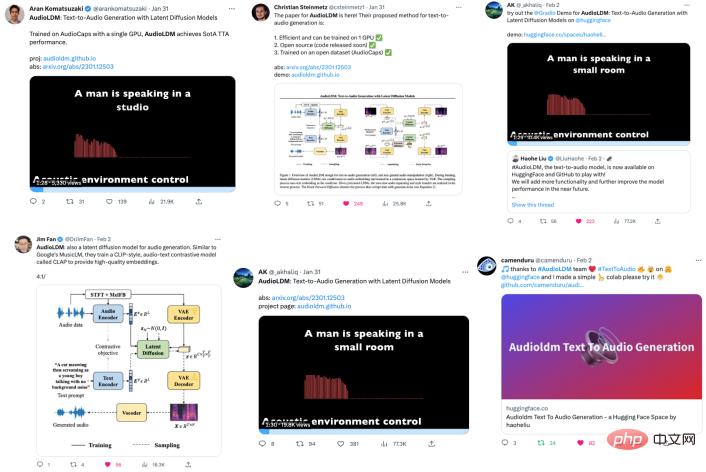

Ce travail a reçu une large attention sur Twitter, et des chercheurs du secteur ont transmis et commenté :

Les internautes ont utilisé AudioLDM pour générer une variété de sons .

Par exemple, il y a des sons générés de la fille chat en deux dimensions qui ronfle :

et des sons de fantômes :

Certains internautes l'ont synthétisé : "Voix de maman, basse fréquence, avec quelques gémissements douloureux".

Certains internautes ont même synthétisé : "melody pet sound".

Je dois admirer la riche imagination des internautes.

Certains internautes ont directement utilisé AudioLDM pour générer une série d'albums de musique dans divers styles, dont le jazz, le funk, l'électronique et le classique. Certaines musiques sont assez inventives.

Par exemple "Créer une musique d'ambiance sur le thème de l'univers et de la lune" :

et "Créer une musique utilisant des sons du futur" :

Les lecteurs intéressés peuvent visiter le site Web de cet album musical : https://www.latent.store/albums

Certains internautes ont également utilisé leur imagination pour créer une application de génération d'effets sonores guidée par l'image en combinant le texte généré par l'image. modèle et AudioLDM.

Par exemple, si vous donnez à AudioLDM ce texte : "Un chien qui court dans l'eau avec un frisbee" (un chien qui court dans l'eau avec un frisbee dans la gueule) :

peut être généré comme suit Le bruit des chiens clapotant l'eau.

Vous pouvez même restaurer les sons d'anciennes photos, comme l'image ci-dessous :

Après avoir obtenu "Un homme et une femme assis dans un bar" (Un homme et une femme assis dans une barre) ) texte, le modèle peut générer les sons suivants, où vous pouvez entendre des voix vagues et le bruit des verres à vin tinter en arrière-plan.

Certains internautes ont utilisé AudioLDM pour générer le son d'un chien enflammé, ce qui est très intéressant.

L'auteur a également produit une vidéo pour démontrer la capacité du modèle à générer des effets sonores, montrant comment les échantillons générés par AudioLDM sont proches de l'effet de la bibliothèque d'effets sonores.

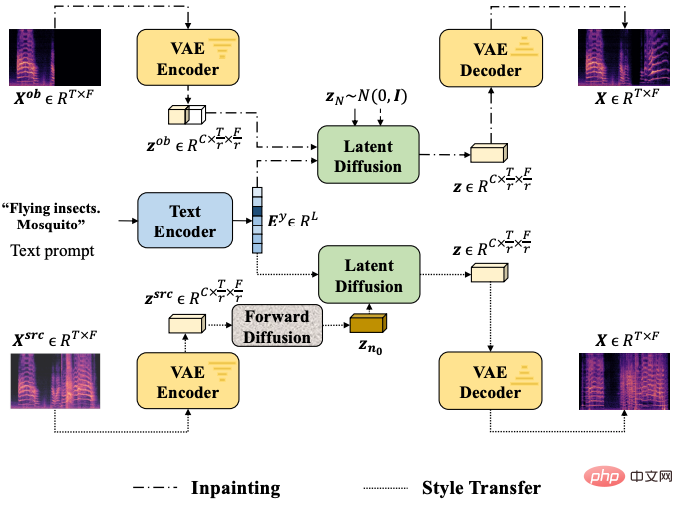

En fait, la génération audio de texte n'est qu'une partie des capacités d'AudioLDM peut également réaliser une conversion de timbre, un remplissage manquant et une super-résolution.

Les deux images ci-dessous montrent la conversion du timbre de (1) percussions à la musique d'ambiance et (2) de la trompette au chant des enfants ;

Ci-dessous l'effet des percussions sur la musique ambiante (intensité de conversion progressive).

L'effet de transformer le son de la trompette en le son d'un enfant chantant (intensité de conversion progressive).

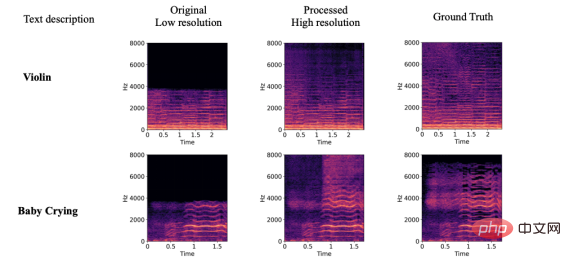

Ci-dessous, nous montrerons l'effet du modèle sur la super-résolution audio, le remplissage audio manquant et le contrôle du matériau sonore. En raison de la longueur limitée de l'article, l'audio est principalement affiché sous forme de spectrogrammes. Les lecteurs intéressés doivent se rendre sur la page d'accueil du projet AudioLDM : https://audioldm.github.io/

.En termes de super-résolution audio, l'effet d'AudioLDM est également très bon. Par rapport au modèle de super-résolution précédent, AudioLDM est un modèle de super-résolution universel et ne se limite pas au traitement de la musique et de la parole.

En termes de remplissage audio manquant, AudioLDM peut remplir différents contenus audio en fonction du texte donné, et la transition à la frontière est plus naturelle.

De plus, AudioLDM présente également de fortes capacités de contrôle, telles que la capacité de contrôler l'environnement acoustique, l'ambiance et la vitesse de la musique, les matériaux des objets, la hauteur et la séquence, etc. Les lecteurs intéressés peuvent consulter l'article AudioLDM ou page d'accueil du projet à afficher.

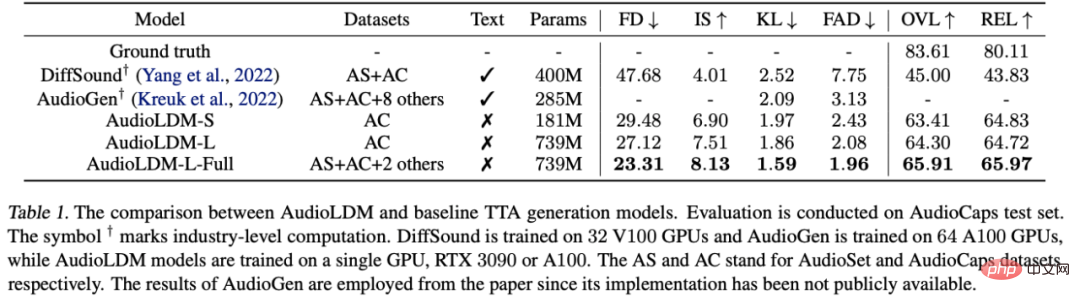

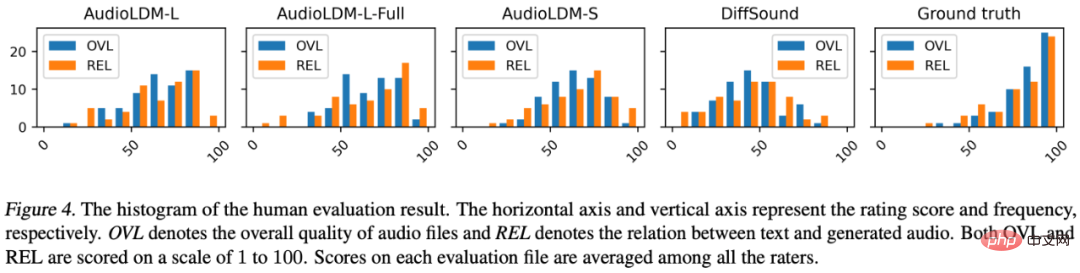

Dans l'article, l'auteur a fait une évaluation subjective et un indicateur objectif du modèle AudioLDM, et les résultats ont montré qu'il peut largement dépasser le modèle optimal précédent :

Parmi eux, AudioGen est celui d'octobre 2022 de Facebook. Le modèle proposé utilise dix ensembles de données, 64 GPU et 285 Mo de paramètres. En comparaison, AudioLDM-S peut obtenir de meilleurs résultats avec un seul ensemble de données, 1 GPU et 181 Mo de paramètres.

La notation subjective montre également qu'AudioLDM est nettement meilleur que la solution précédente DiffSound. Alors, quelles améliorations AudioLDM a-t-il apportées pour que le modèle ait d'aussi excellentes performances ?

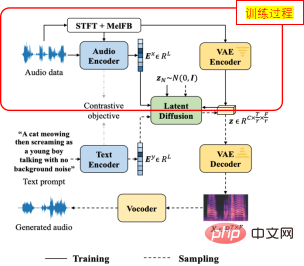

Tout d'abord, afin de résoudre le problème du trop petit nombre de paires de données texte-audio, l'auteur a proposé une méthode auto-supervisée pour entraîner AudioLDM.

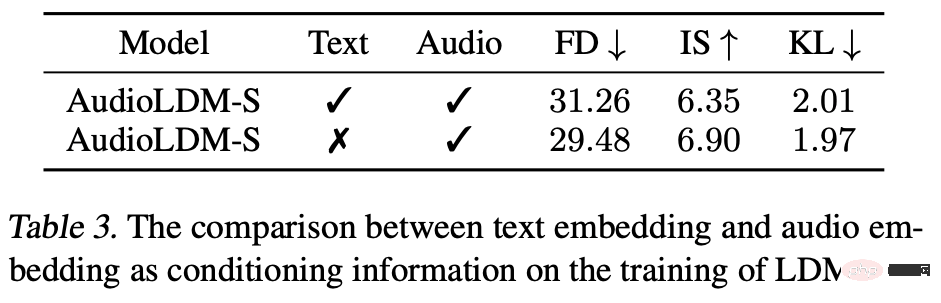

Plus précisément, lors de la formation des LDM du module de base, l'auteur utilise l'intégration de l'audio lui-même comme signal de condition des LDM. L'ensemble du processus n'implique pas l'utilisation de texte (comme indiqué dans le. figure ci-dessus). Ce schéma est basé sur une paire d'encodeurs d'apprentissage contrastif audio-texte (CLAP) pré-entraînés, qui ont démontré de bonnes capacités de généralisation dans le texte CLAP original. AudioLDM tire parti des excellentes capacités de généralisation de CLAP pour réaliser une formation de modèles sur des données audio à grande échelle sans avoir besoin d'étiquettes de texte.

En fait, l'auteur a découvert que l'utilisation de la formation audio seule est encore meilleure que l'utilisation de paires de données audio-texte :

L'auteur a analysé deux raisons : (1) L'annotation de texte elle-même est difficile à inclure l'audio Toutes les informations, telles que l'environnement acoustique, la distribution des fréquences, etc., ce qui fait que l'intégration du texte ne peut pas bien représenter l'audio (2) La qualité du texte lui-même n'est pas parfaite. annotation "Bateaux : Battleships-5.25 espace convoyeur", ce type d'annotation est difficile même pour les humains d'imaginer quel est le son spécifique, ce qui posera des problèmes dans la formation du modèle. En revanche, l’utilisation de l’audio lui-même comme condition du LDM peut garantir une forte corrélation entre l’audio cible et la condition, obtenant ainsi de meilleurs résultats de génération.

De plus, la solution de Diffusion Latente adoptée par l'auteur permet de calculer le modèle de Diffusion dans un espace plus petit, réduisant ainsi considérablement les besoins en puissance de calcul du modèle.

De nombreuses explorations détaillées dans la formation et la structure des modèles aident également AudioLDM à obtenir d'excellentes performances.

L'auteur a également dessiné un schéma de structure simple pour présenter les deux principales tâches en aval :

L'auteur a également mené des expériences détaillées sur différentes structures de modèles, tailles de modèles, étapes d'échantillonnage DDIM et différentes échelles de guidage sans classificateur.

Tout en rendant le modèle public, les auteurs ont également divulgué la base de code de leur système d'évaluation de modèle génératif afin d'unifier les méthodes d'évaluation de la communauté universitaire sur de telles questions à l'avenir, facilitant ainsi les comparaisons entre les articles. lien suivant Support : https://github.com/haoheliu/audioldm_eval

Bien que cette technologie soit devenue populaire, certains internautes ont également remis en question la sécurité de la technologie :

L'équipe de l'auteur a déclaré qu'elle limiterait l'utilisation du modèle, en particulier l'utilisation commerciale, pour garantir que le modèle n'est utilisé qu'à des fins de communication académique, et qu'elle utiliserait une LICENCE et une protection par filigrane appropriées pour éviter que des problèmes éthiques ne surviennent.

Informations sur l'auteur

L'article est composé de deux co-auteurs : Liu Haohe (Université du Surrey, Royaume-Uni) et Chen Zehua (Imperial College London, Royaume-Uni).

Liu Haohe étudie actuellement pour son doctorat à l'Université de Surrey, au Royaume-Uni, sous la direction du professeur Mark D. Plumbley. Ses projets open source ont reçu des milliers d'étoiles sur GitHub. Il a publié plus de 20 articles lors de conférences universitaires majeures et a remporté les trois premiers classements de plusieurs concours mondiaux d'acoustique des machines. Dans le monde de l'entreprise, il coopère étroitement avec Microsoft, ByteDance, la British Broadcasting Corporation, etc. Page d'accueil personnelle : https://www.surrey.ac.uk/people/haohe-liu

Chen Zehua est doctorant à l'Imperial College de Londres, auprès du professeur Danilo Mandic. Il a effectué un stage au Microsoft Speech Synthesis Research Group et au JD Artificial Intelligence Laboratory. Ses intérêts de recherche incluent les modèles génératifs, la synthèse vocale et la génération de signaux bioélectriques.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI