Maison >Périphériques technologiques >IA >Une autre révolution dans l'apprentissage par renforcement ! DeepMind propose une « distillation d'algorithmes » : un transformateur d'apprentissage par renforcement pré-entraîné explorable

Une autre révolution dans l'apprentissage par renforcement ! DeepMind propose une « distillation d'algorithmes » : un transformateur d'apprentissage par renforcement pré-entraîné explorable

- 王林avant

- 2023-04-12 18:58:152057parcourir

Dans les tâches actuelles de modélisation de séquences, Transformer peut être considéré comme l'architecture de réseau neuronal la plus puissante, et le modèle Transformer pré-entraîné peut utiliser des invites comme conditions ou un apprentissage en contexte pour s'adapter à différentes tâches en aval.

La capacité de généralisation du modèle Transformer pré-entraîné à grande échelle a été vérifiée dans plusieurs domaines, tels que la complétion de texte, la compréhension du langage, la génération d'images, etc.

Depuis l'année dernière, des travaux pertinents ont été réalisés prouvant qu'en traitant l'apprentissage par renforcement hors ligne (RL hors ligne) comme un problème de prédiction de séquence, le modèle peut apprendre des politiques à partir de données hors ligne.

Mais les méthodes actuelles soit apprennent la politique à partir de données qui ne contiennent pas d'apprentissage (comme une politique experte fixée par distillation), soit apprennent à partir de données qui contiennent de l'apprentissage (comme le tampon de relecture de l'agent), mais parce que son contexte est trop petit, il ne peut pas prendre en compte les améliorations politiques.

Les chercheurs de DeepMind ont découvert par observation qu'en principela nature séquentielle de l'apprentissage dans la formation des algorithmes d'apprentissage par renforcement peut modéliser le processus d'apprentissage par renforcement lui-même comme un « problème de prédiction de séquence causale ».

Plus précisément, si le contexte d'un Transformer est suffisamment long pour inclure des améliorations de politique dues aux mises à jour d'apprentissage, alors il devrait être capable de représenter non seulement une politique fixe, mais également l'état, les actions et les récompenses des épisodes précédents en se concentrer sur lui Représenté comme un opérateur d’amélioration des politiques.

Cela fournit également une faisabilité technique selon laquelle tout algorithme RL peut être distillé en un modèle de séquence suffisamment puissant grâce à l'apprentissage par imitation et transformé en un algorithme RL en contexte.

Sur cette base, DeepMind a proposé l'algorithme de distillation (AD), qui extrait les algorithmes d'apprentissage par renforcement dans les réseaux neuronaux en établissant un modèle de séquence causale.

Lien papier :https://arxiv.org/pdf/2210.14215.pdf

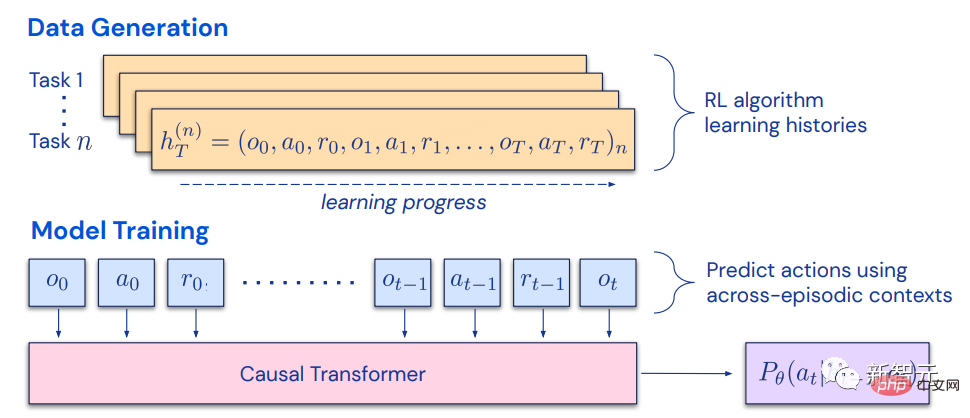

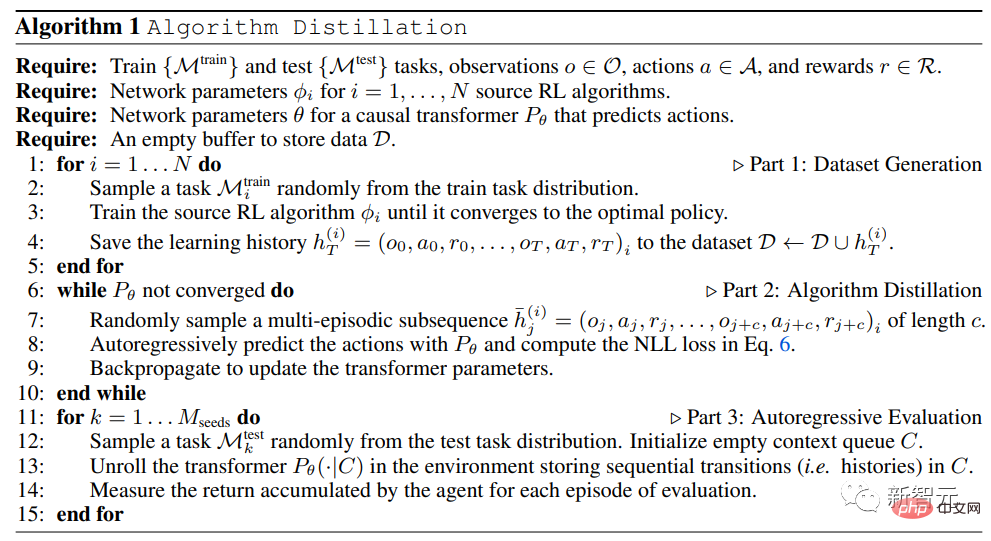

La distillation algorithmique traite l'apprentissage par renforcement comme un problème de prédiction de séquence entre épisodes, via la source RL L'algorithme génère un ensemble de données d'historique d'apprentissage, puis entraîne le transformateur causal en prédisant le comportement par autorégression basée sur l'historique d'apprentissage comme contexte.

Contrairement aux structures de post-apprentissage ou de prédiction de politique de séquence de séquences expertes, AD est capable d'améliorer sa politique entièrement en contexte sans mettre à jour ses paramètres réseau.

- Transfomer collecte ses propres données et maximise les récompenses sur les nouvelles tâches ;

- Aucune invite ou réglage précis n'est requis

- Avec les poids gelés, Transformer explore, exploite et maximise le retour du contexte ! Les méthodes de distillation expertes telles que Gato ne peuvent pas explorer et ne peuvent pas maximiser les rendements.

Les résultats expérimentaux prouvent qu'AD peut effectuer un apprentissage par renforcement dans divers environnements avec des récompenses clairsemées, des structures de tâches combinées et des observations basées sur les pixels, et que l'apprentissage AD est plus efficace en matière de données que l'algorithme RL qui génère des données sources élevées. .

AD est également le premier à démontrer des méthodes d'apprentissage par renforcement en contexte par modélisation séquentielle de données hors ligne avec perte d'imitation.

Distillation d'algorithmes

En 2021, certains chercheurs ont découvert pour la première fois que Transformer pouvait apprendre des politiques à tâche unique à partir de données RL hors ligne grâce à l'apprentissage par imitation, et a ensuite été étendu pour extraire des politiques multitâches à la fois dans le même domaine et dans plusieurs domaines. paramètres.

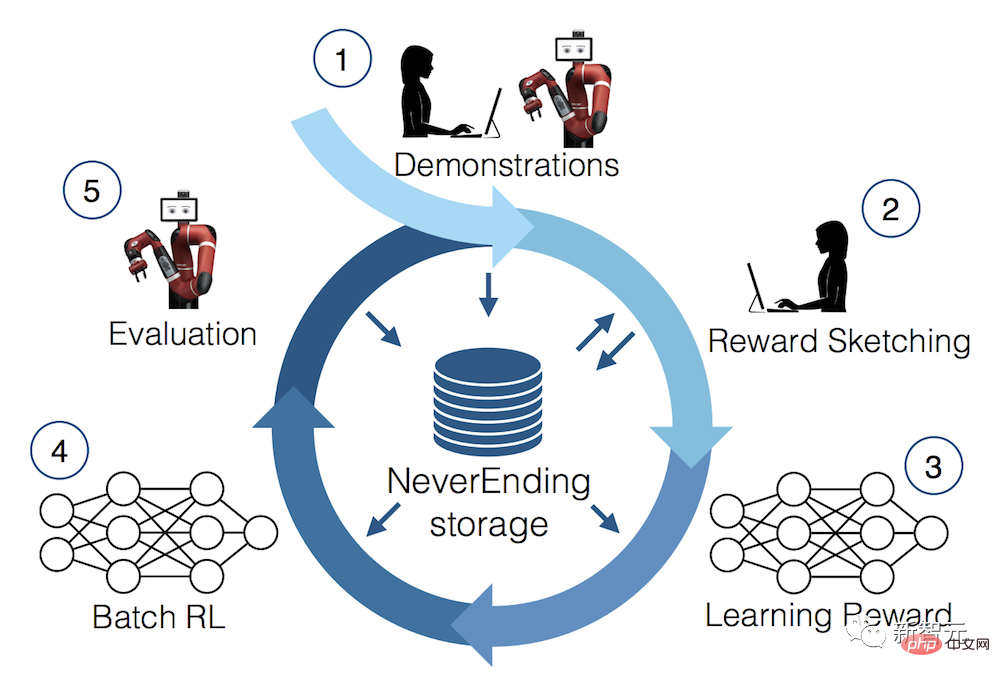

Ces travaux proposent un paradigme prometteur pour extraire des politiques générales multitâches : collecter d'abord un ensemble de données vaste et diversifié sur les interactions environnementales, puis extraire une politique à partir des données via une modélisation séquentielle.

La méthode d'apprentissage des politiques à partir de données RL hors ligne via l'apprentissage par imitation est également appelée distillation des politiques hors ligne, ou simplement Policy Distillation (PD).

Bien que l'idée du PD soit très simple et facile à étendre, le PD présente un défaut majeur : la stratégie générée ne s'améliore pas grâce aux interactions supplémentaires avec l'environnement.

Par exemple, MultiGame Decision Transformer (MGDT) a appris une politique de retour conditionnelle qui peut jouer à un grand nombre de jeux Atari, tandis que Gato a appris une politique pour résoudre des tâches dans différents environnements via des tâches d'inférence contextuelle, mais aucune des deux méthodes améliore sa stratégie par essais et erreurs.

MGDT adapte le transformateur aux nouvelles tâches en ajustant les poids du modèle, tandis que Gato nécessite des conseils de démonstration d'experts pour s'adapter aux nouvelles tâches.

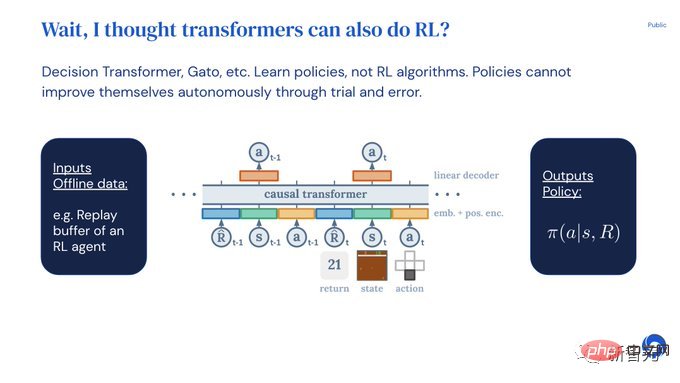

En bref, la méthode Policy Distillation apprend les politiques plutôt que les algorithmes d'apprentissage par renforcement.

La raison pour laquelle les chercheurs ont émis l'hypothèse que la distillation politique ne peut pas s'améliorer par essais et erreurs est qu'elle est formée sur des données qui ne montrent pas de progrès d'apprentissage.

La distillation algorithmique (AD) est une méthode d'apprentissage des opérateurs intrinsèques d'amélioration des politiques en optimisant la perte de prédiction de la séquence causale dans l'historique d'apprentissage d'un algorithme RL.

AD comprend deux composants :

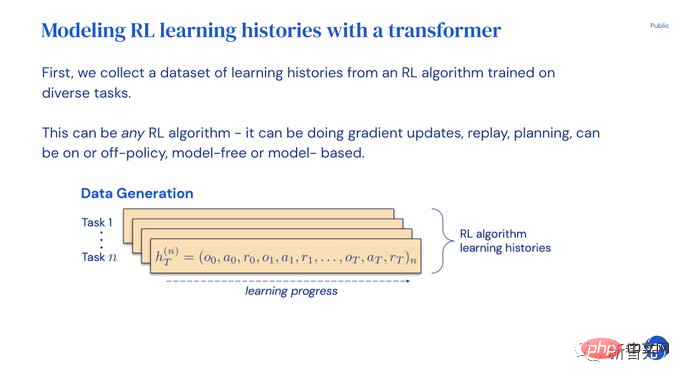

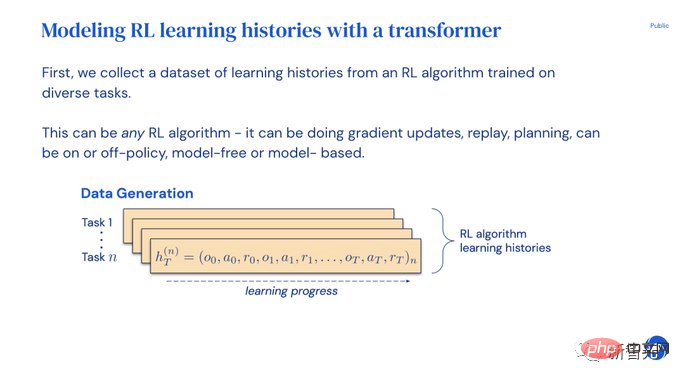

1 : Générer un grand ensemble de données multitâches en enregistrant l'historique d'entraînement d'un algorithme RL sur de nombreuses tâches individuelles

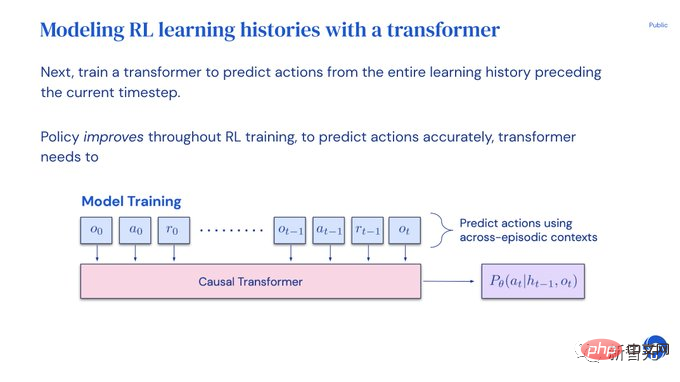

2. utilise l’historique d’apprentissage précédent comme arrière-plan pour modéliser causalement les actions.

Étant donné que la politique continue de s'améliorer tout au long du processus de formation de l'algorithme source RL, AD doit apprendre à améliorer l'opérateur afin de simuler avec précision les actions à tout moment donné de l'historique de formation.

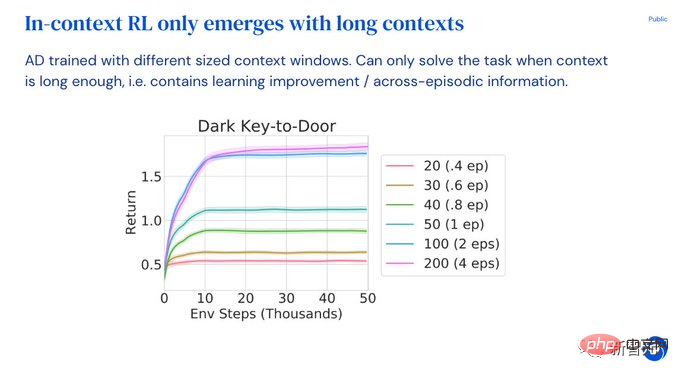

Plus important encore, la taille du contexte du Transformer doit être suffisamment grande (c'est-à-dire à travers les époques) pour capturer les améliorations des données d'entraînement.

Dans la partie expérimentale, afin d'explorer les avantages de l'AD dans les capacités RL en contexte, les chercheurs se sont concentrés sur les environnements qui ne peuvent pas être résolus par la généralisation sans tir après la pré-entraînement, c'est-à-dire chaque environnement est requis. Une variété de tâches sont prises en charge et la solution à la tâche ne peut pas être facilement déduite par le modèle à partir des observations. Dans le même temps, les épisodes doivent être suffisamment courts pour que les transformateurs causals puissent être formés à travers les épisodes.

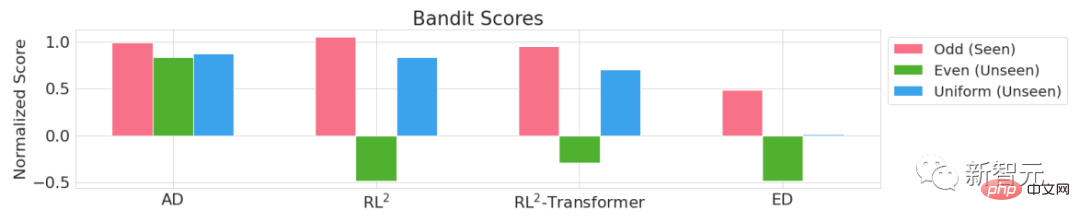

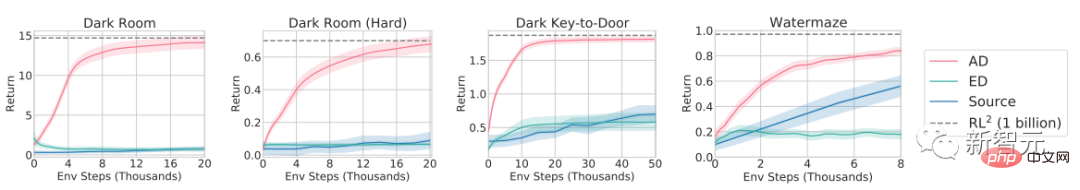

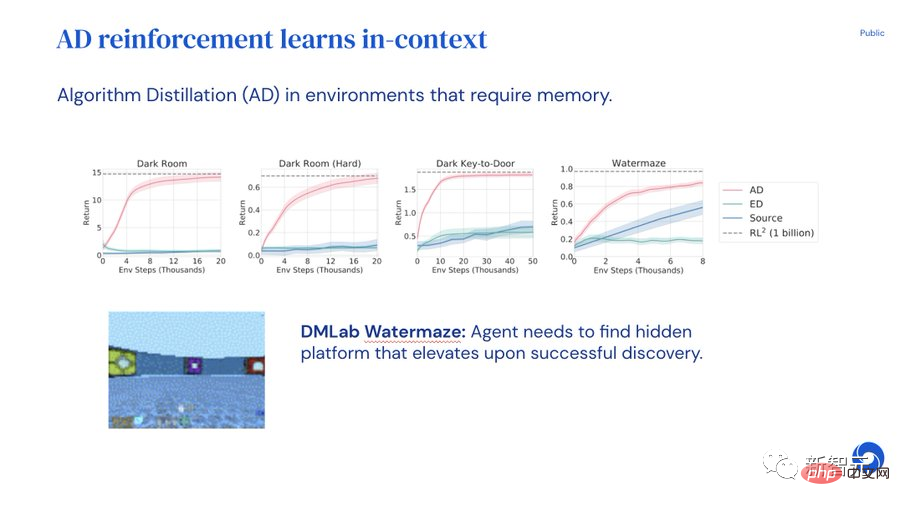

Comme le montrent les résultats expérimentaux de quatre environnements Adversarial Bandit, Dark Room, Dark Key-to-Door, DMLab Watermaze, en imitant l'algorithme RL basé sur le gradient, en utilisant un transformateur causal avec un grand suffisamment de contexte, AD peut renforcer pleinement l'apprentissage de nouvelles tâches en contexte.

AD est capable d'effectuer une exploration en contexte, une allocation temporelle de crédits et une généralisation. L'algorithme appris par AD est plus efficace en matière de données que l'algorithme qui génère les données sources pour la formation Transformer.

Explication PPT

Afin de faciliter la compréhension de l'article, Michael Laskin, l'un des auteurs de l'article, a publié une explication ppt sur Twitter.

Les expériences sur la distillation d'algorithmes montrent que Transformer peut améliorer le modèle de manière autonome par essais et erreurs sans mettre à jour les poids, les invites ou les réglages fins. Un seul Transformer peut collecter ses propres données et maximiser les récompenses sur les nouvelles tâches.

Bien qu'il existe de nombreux modèles réussis montrant comment Transformer apprend en contexte, il n'a pas été prouvé que Transformer renforce l'apprentissage en contexte.

Pour s'adapter aux nouvelles tâches, les développeurs doivent soit spécifier manuellement une invite, soit ajuster le modèle.

Ne serait-il pas bien si Transformer pouvait s'adapter à l'apprentissage par renforcement et être utilisable dès le départ ?

Mais Decision Transformers ou Gato ne peuvent apprendre des stratégies qu'à partir de données hors ligne et ne peuvent pas s'améliorer automatiquement grâce à des expériences répétées.

Le Transformateur généré à l'aide de la méthode de pré-entraînement de distillation algorithmique (AD) peut effectuer un apprentissage par renforcement en contexte.

Entraînez d'abord plusieurs copies d'un algorithme d'apprentissage par renforcement pour résoudre différentes tâches et enregistrer l'historique d'apprentissage.

Une fois l'ensemble de données de l'historique d'apprentissage collecté, un transformateur peut être entraîné pour prédire les actions de l'historique d'apprentissage précédent.

Étant donné que les politiques se sont améliorées au fil du temps, prédire avec précision les actions obligera le Transformateur à modéliser les améliorations politiques.

L'ensemble du processus est si simple. Transformer est formé uniquement en imitant des actions. Il n'y a pas de valeur Q comme les modèles d'apprentissage par renforcement courants, pas de longue séquence opération-action-récompense et pas de retour comme les conditions DT.

Dans le contexte, l'apprentissage par renforcement n'entraîne aucune surcharge supplémentaire, et le modèle est ensuite évalué en observant si AD peut maximiser la récompense pour la nouvelle tâche.

Transformer explore, exploite et maximise les rendements alors que dans le contexte, ses poids sont figés !

D'un autre côté, Expert Distillation (le plus similaire à Gato) ne peut pas explorer ni maximiser les rendements.

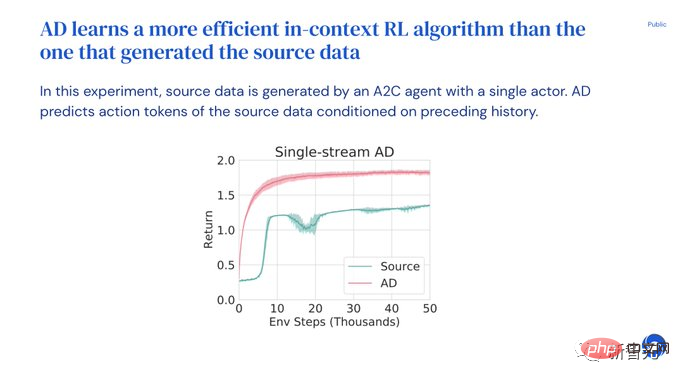

AD peut extraire n'importe quel algorithme RL. Les chercheurs ont essayé UCB et DQNA2C. Une découverte intéressante est qu'AD est plus efficace en matière de données dans l'apprentissage contextuel des algorithmes RL.

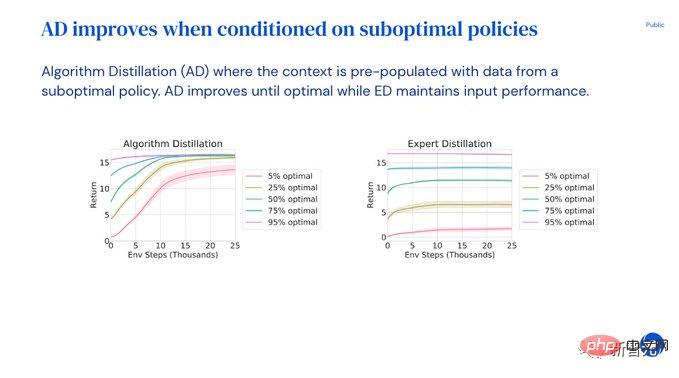

Les utilisateurs peuvent également saisir des invites et des démos sous-optimales, et le modèle améliorera automatiquement la stratégie jusqu'à ce que la solution optimale soit obtenue !

Et l'ED distillé par un expert ne peut maintenir que des performances de démonstration sous-optimales.

Context RL n'apparaîtra que lorsque le contexte du Transformer est suffisamment long et s'étend sur plusieurs épisodes.

AD nécessite un historique suffisamment long pour des tâches efficaces d'amélioration et d'identification du modèle.

Grâce à des expériences, les chercheurs sont arrivés aux conclusions suivantes :

- Le transformateur peut effectuer une RL en contexte

- L'algorithme RL contextuel avec AD est plus efficace que l'algorithme RL source basé sur un gradient

- AD améliore les stratégies sous-optimales

- l'apprentissage par renforcement en contexte découle de l'apprentissage par imitation en contexte long

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI