Maison >Périphériques technologiques >IA >Du papier chaud crée le prototype de 'Westworld' : 25 agents IA grandissent librement dans la ville virtuelle

Du papier chaud crée le prototype de 'Westworld' : 25 agents IA grandissent librement dans la ville virtuelle

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-12 09:04:14870parcourir

Pouvons-nous créer un monde ? Dans ce monde, les robots peuvent vivre, travailler et socialiser comme les humains, reproduisant ainsi tous les aspects de la société humaine.

Ce type d'imagination a été parfaitement restitué dans le cadre de l'œuvre cinématographique et télévisuelle "Westworld" : de nombreux robots avec des intrigues préinstallées sont placés dans un parc à thème, et ils peuvent agir comme des humains. vu, les gens que j'ai rencontrés et les mots que j'ai prononcés. Chaque jour, les robots sont réinitialisés et renvoyés à leur scénario principal.

Toujours de "Westworld", le personnage de gauche est un robot pré-installé avec le scénario.

Développez encore votre imagination : aujourd'hui, que ferions-nous si nous voulions faire d'un grand modèle de langage comme ChatGPT le maître du monde occidental ?

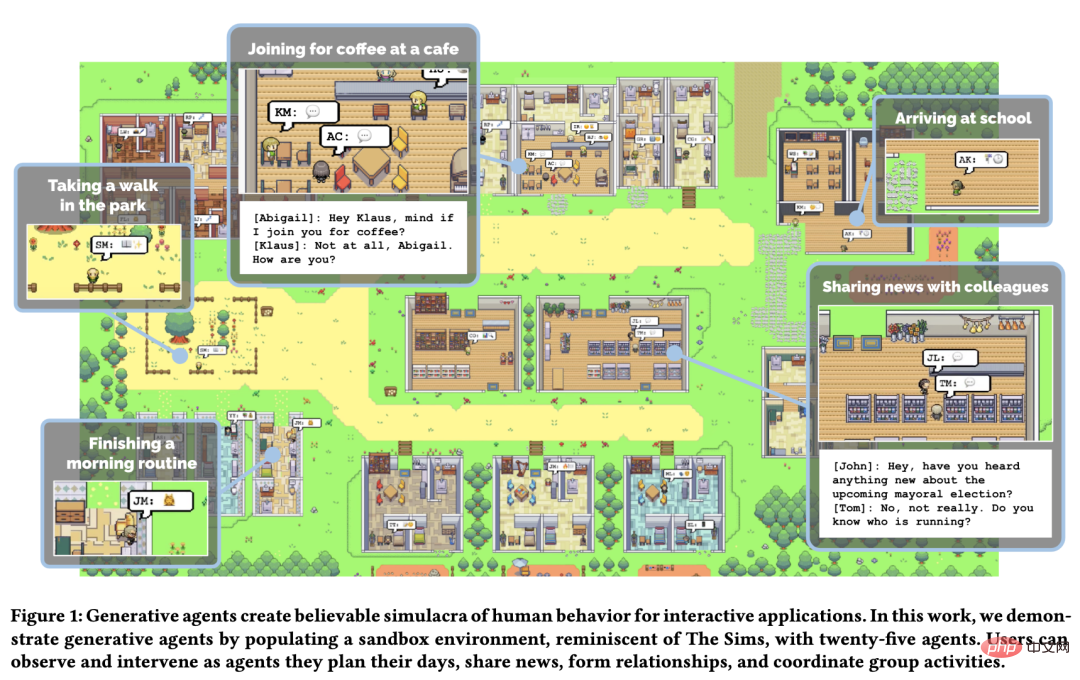

Dans un récent article populaire, des chercheurs ont réussi à construire une « ville virtuelle » où vivent 25 agents d'IA. Ils sont non seulement capables d'adopter des comportements complexes (comme organiser une fête pour la Saint-Valentin), mais aussi de tels comportements. sont plus réalistes que les jeux de rôle humains.

- Lien papier : https://arxiv.org/pdf/2304.03442v1.pdf

- Adresse de démonstration : https://reverie.herokuapp.com/arXiv_Demo/

Des jeux sandbox comme Les Sims aux applications telles que les modèles cognitifs et les environnements virtuels, les chercheurs envisagent depuis plus de quatre décennies la création d’agents capables d’adopter un comportement humain crédible. Dans ces scénarios, les agents informatiques se comportent de manière cohérente avec leurs expériences passées et réagissent de manière crédible à leur environnement. Cette simulation du comportement humain peut remplir les espaces virtuels et les communautés de phénomènes sociaux réels, former des « personnes » à gérer des relations interpersonnelles rares mais difficiles, tester les théories des sciences sociales, produire des modèles de processeurs humains pour les tests théoriques et d'utilisabilité, et fournir des applications informatiques omniprésentes et la dynamique des robots sociaux peut également jeter les bases permettant aux personnages PNJ de naviguer dans des relations humaines complexes dans le monde ouvert.

Mais l'espace du comportement humain est immense et complexe. Bien que de grands modèles de langage puissent simuler un comportement humain crédible à un moment donné, pour garantir une cohérence à long terme, un agent à usage général a besoin d'une architecture pour gérer des souvenirs croissants à mesure que de nouvelles interactions, conflits et événements se produisent et émergent au fil du temps. s’estompent, tout en traitant des dynamiques sociales en cascade qui se déroulent entre plusieurs agents.

Si une méthode peut récupérer des événements et des interactions pertinents sur une longue période de temps, réfléchir à ces souvenirs, généraliser et tirer des inférences de niveau supérieur, et appliquer ce raisonnement pour créer une meilleure compréhension du présent et du long terme. l'agent intelligent se comporte de manière significative avec ses plans et ses réactions, alors la réalisation du rêve n'est pas loin.

Ce nouvel article présente les "agents génératifs" (agents générateurs), un type d'agents qui utilisent des modèles génératifs pour simuler un comportement humain crédible, et prouve qu'ils peuvent produire des comportements individuels et de groupe émergents crédibles. Simulation de :

- Capacité à faire des déductions générales sur lui-même, sur les autres agents et sur l'environnement ;

- Capacité à créer des plans quotidiens qui reflètent ses propres caractéristiques et expériences, à exécuter ces plans, à réagir et à réagir le cas échéant ;

- Capacité ; pour réagir lorsque les utilisateurs finaux modifient leur environnement ou les commandent avec un langage naturel.

Derrière les « agents génératifs » se cache une nouvelle architecture d'agents qui peut stocker, synthétiser et appliquer des mémoires pertinentes, et utiliser de grands modèles de langage pour générer des comportements crédibles.

Par exemple, les « Agents Génératifs » éteindront la cuisinière s'ils voient leur petit-déjeuner brûler ; s'il y a quelqu'un dans la salle de bain, ils attendront dehors s'ils rencontrent un autre agent à qui ils veulent parler, ils s'arrêteront et discuteront ; . Une société pleine d'« agents générateurs » est marquée par des dynamiques sociales émergentes, dans lesquelles de nouvelles relations se forment, l'information est diffusée et une coordination se produit entre les agents.

Plus précisément, les chercheurs ont annoncé plusieurs détails importants dans cet article :

- Les agents générateurs sont une simulation crédible du comportement humain, basée sur l'expérience et l'environnement changeants de l'agent ;

- Une nouvelle architecture qui permet aux agents génératifs de se souvenir, de récupérer, de réfléchir, d'interagir avec d'autres agents et de planifier à travers des environnements en évolution dynamique. L'architecture exploite les puissantes capacités d'invite des grands modèles de langage et complète ces capacités pour prendre en charge la cohérence à long terme de l'agent, les capacités de mémoire pour gérer l'évolution dynamique et générer de manière récursive plus de générations

- Deux évaluations (contrôle et de bout en bout) ; -fin), déterminant les relations de cause à effet de l'importance des divers composants de l'architecture et identifiant les échecs dus à une mauvaise récupération de la mémoire, etc.

- discute des opportunités pour les agents génératifs dans les systèmes interactifs et éthiques et sociaux risques. Les chercheurs estiment que ces agents devraient être adaptés pour atténuer le risque que les utilisateurs établissent des relations sociales parasites, documentés pour atténuer les risques posés par les deepfakes et la persuasion personnalisée, et conçus pour compléter plutôt que remplacer les intérêts humains et être appliqués d'une manière différente.

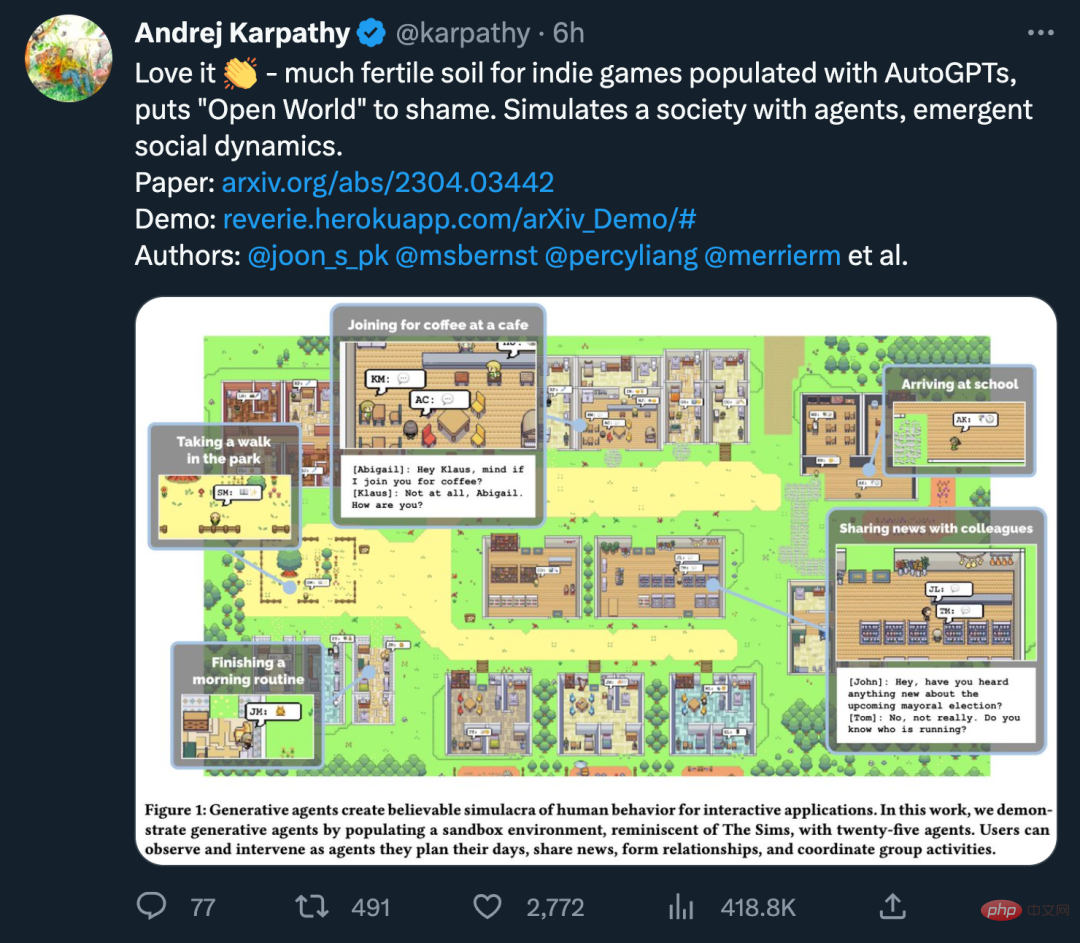

Dès que l'article a été publié, il a suscité de vives discussions sur Internet. Karpathy, qui était déjà optimiste quant à l'orientation de "AutoGPT", a fait l'éloge à plusieurs reprises, estimant que "Generative Agents" n'est pas un peu meilleur que le "Open World" avec lequel il a joué avec le concept auparavant :

Certains chercheurs ont même affirmé que la sortie de cette recherche signifie que « les grands modèles de langage ont franchi une nouvelle étape » :

Le comportement des « Agents Génératifs » et leurs interactions

Afin de rendre les « Agents Génératifs » plus concrets, cette recherche les instancie dans un rôle mondial de bac à sable.

25 agents vivent dans une ville appelée Smallville, chacun représenté par un simple avatar. Tous les personnages peuvent :

- communiquer avec les autres et l'environnement ;

- se souvenir des choses qu'ils ont faites et observées

- réfléchir à ces observations ;

Les chercheurs ont utilisé le langage naturel pour décrire l'identité de chaque agent, y compris sa profession et ses relations avec d'autres agents, et ont stocké ces informations comme une mémoire germée. Par exemple, l'agent John Lin a la description suivante (un extrait de cet article) :

"John Lin est un propriétaire de pharmacie qui aime aider les autres. Il est toujours à la recherche de moyens pour faciliter la tâche des clients. obtenir des médicaments. John Lin Sa femme est le professeur d'université Mei Lin, et ils vivent avec leur fils Eddy Lin, qui étudie le solfège. John Lin aime beaucoup sa famille. John Lin a connu le vieux couple d'à côté, Sam Moore et Jennifer ; Moore, depuis plusieurs années..."

Une fois l'identité définie, la prochaine étape est de savoir comment l'agent interagit avec le monde.

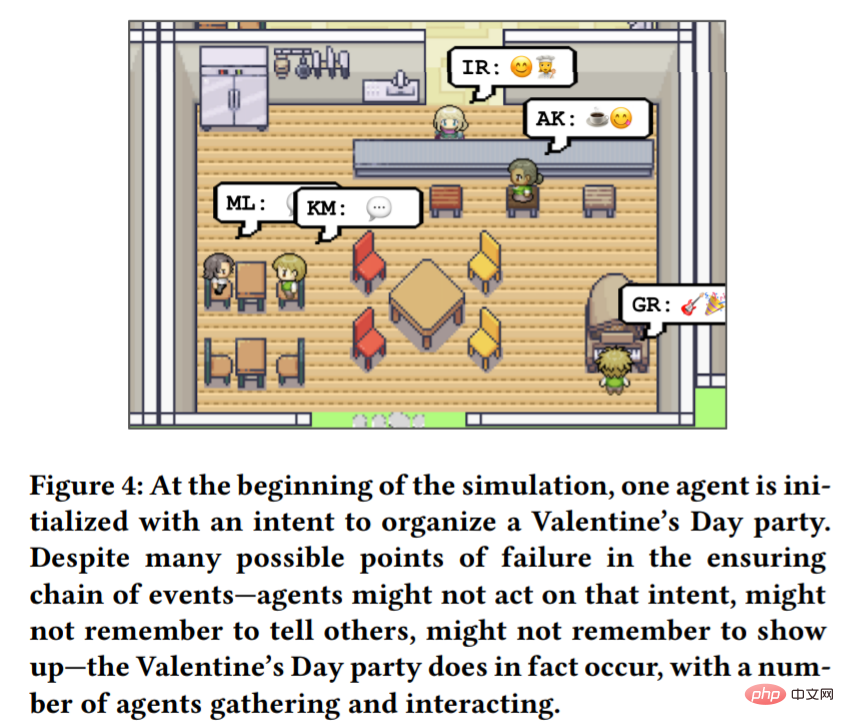

À chaque étape du bac à sable, les agents génèrent une déclaration en langage naturel pour décrire leurs actions en cours, telles que les déclarations "Isabella Rodriguez écrit un journal", "Isabella Rodriguez vérifie ses e-mails", etc. Ces langages naturels sont ensuite traduits en actions concrètes qui affectent le monde du bac à sable. Les actions sont affichées sur l'interface sandbox sous la forme d'un ensemble d'émoticônes qui fournissent une représentation abstraite de l'action.

Pour y parvenir, la recherche utilise un modèle de langage qui convertit les actions en un ensemble d'émojis qui apparaissent dans une boîte de dialogue au-dessus de l'avatar de chaque agent. Par exemple, « Isabella Rodriguez écrit dans son journal » apparaît sous la forme , et « Isabella Rodriguez vérifie ses e-mails » apparaît sous la forme . De plus, une description complète en langage naturel est accessible en cliquant sur l'avatar de l'agent.

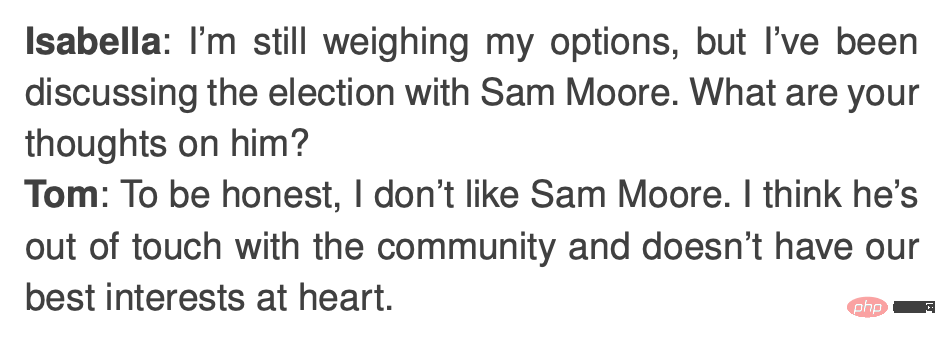

Les agents communiquent entre eux en utilisant le langage naturel. Si les agents se rendent compte qu'il y a d'autres agents autour d'eux, ils réfléchiront s'ils doivent aller discuter. Par exemple, Isabella Rodriguez et Tom Moreno ont eu une conversation sur les prochaines élections :

De plus, les utilisateurs peuvent également préciser le rôle que jouent les agents. Par exemple, si vous désignez l'un des agents comme journaliste, vous pouvez demander à l'agent de consulter du contenu d'actualité.

Interaction entre l'agent et l'environnement

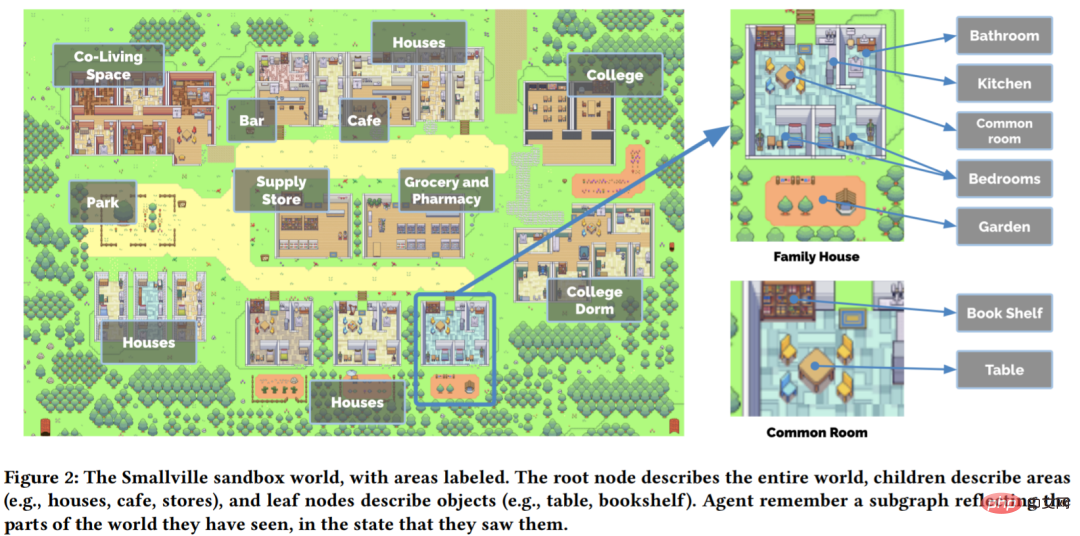

Smallville La ville compte de nombreuses scènes publiques, notamment des cafés, des bars, des parcs, des écoles, des dortoirs, des maisons et des magasins. De plus, chaque scène publique comprend également ses propres fonctions et objets, comme une cuisine dans une maison et une cuisinière dans la cuisine (Figure 2). Il y a aussi des lits, des tables, des armoires, des étagères, des salles de bains et des cuisines dans l'espace de vie de l'agent intelligent.

Les agents peuvent se déplacer dans Smallville, entrer ou sortir d'un bâtiment, avancer et même approcher un autre agent. Le mouvement de l'agent est contrôlé par l'architecture et le moteur de jeu sandbox de Generative Agents : lorsque le modèle demande à l'agent de se déplacer vers un certain emplacement, l'étude calcule son chemin de marche jusqu'à sa destination dans l'environnement Smallville, et l'agent commence à se déplacer.

De plus, les utilisateurs et les agents peuvent également affecter l'état d'autres objets dans l'environnement. Par exemple, le lit est occupé lorsque l'agent dort et le réfrigérateur peut être vide lorsque l'agent a fini de petit-déjeuner. Les utilisateurs finaux peuvent également réécrire l'environnement de l'agent via le langage naturel. Par exemple, l'utilisateur définit l'état de la douche sur fuite lorsqu'Isabella entre dans la salle de bain, puis Isabella trouvera des outils dans le salon et tentera de résoudre le problème de fuite.

Une journée dans la vie d'un agent

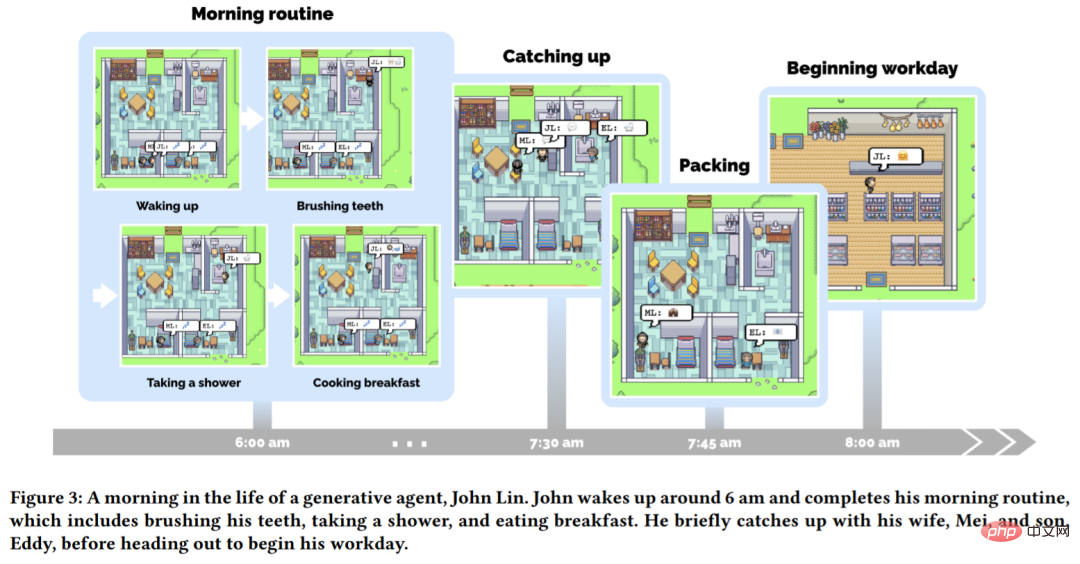

À partir d'une description, l'agent commence à planifier sa journée de vie. Au fil du temps dans le monde sandbox, le comportement des agents change progressivement à mesure qu'ils interagissent les uns avec les autres, avec le monde et avec les souvenirs qu'ils construisent. La photo ci-dessous montre une journée dans la vie du propriétaire de pharmacie John Lin.

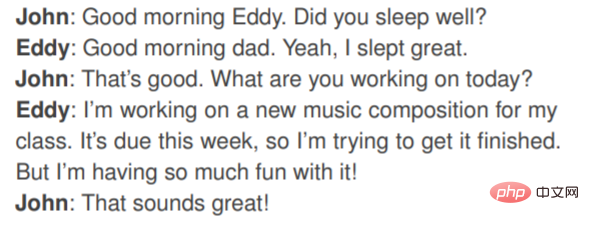

Dans cette famille, John Lin est le premier à se lever à sept heures du matin, puis se brosse les dents, prend une douche, s'habille, prend son petit-déjeuner, puis parcourt l'actualité à table à manger le salon. À 8 heures du matin, Eddy, le fils de John Lin, s'est également levé et s'est préparé pour le cours. Avant de partir, il a eu une conversation avec John. Le contenu était le suivant :

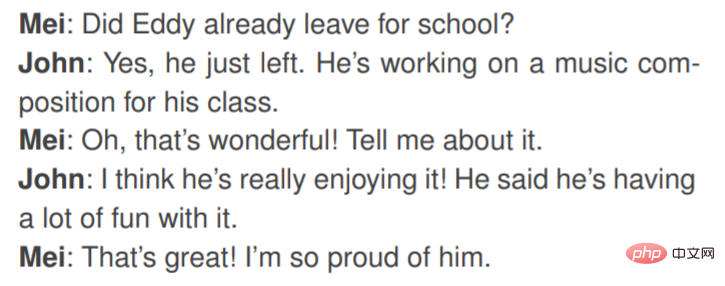

Peu de temps après le départ d'Eddy, sa mère Mei s'est également réveillée. Mei a posé des questions sur son fils John. puis a eu le dialogue suivant

Compétences sociales

De plus, les « agents générateurs » montrent également l'émergence de comportements sociaux. En interagissant les uns avec les autres, les « agents générateurs » échangent des informations et nouent de nouvelles relations dans l'environnement de Smallville. Ces comportements sociaux sont naturels et non prédéterminés. Par exemple, lorsqu'un agent remarque la présence de l'autre partie, une conversation peut avoir lieu et les informations de la conversation peuvent être diffusées entre les agents.

Regardons quelques exemples :

Diffusion de l'information. Lorsque les agents se remarquent, ils peuvent engager une conversation. Ce faisant, les informations peuvent être propagées d’un agent à un autre. Par exemple, lors de la conversation de Sam et Tom à l'épicerie, Sam parle à Tom de sa candidature aux élections locales :

Plus tard dans la journée, après le départ de Sam, d'une autre source a entendu le news, Tom et John discutent des chances de Sam de remporter l'élection :

Peu à peu, la candidature de Sam est devenue le sujet de toutes les conversations, certains le soutenant et d'autres indécis.

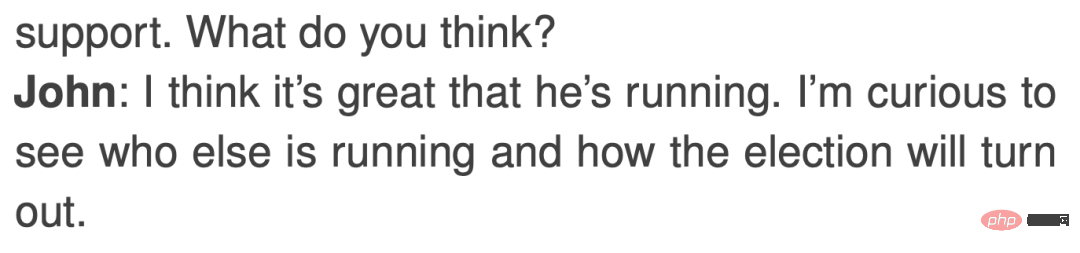

Mémoire relationnelle. Au fil du temps, les agents de la ville nouent de nouvelles relations et se souviennent de leurs interactions avec d'autres agents. Par exemple, Sam ne connaissait pas Latoya Williams au début. En se promenant dans Johnson Park, Sam a rencontré Latoya et s'est présenté. Latoya a mentionné qu'il travaillait sur un projet de photographie : "Je suis ici pour prendre des photos pour un projet sur lequel je travaille." et Latoya L'interaction a montré le souvenir de cet événement, Sam demandant : "Latoya, comment se passe ton projet ?" Latoya a répondu : "Ça se passe très bien !" Isabella Rodriguez, propriétaire du Hobbs Cafe, organise une fête pour la Saint-Valentin le 14 février de 17h à 19h. À partir de cette graine, Isabella Rodriguez envoyait des invitations lorsqu'elle rencontrait des amis et des clients au Hobbs Café ou ailleurs. Dans l'après-midi du 13, Isabella commença à décorer le café. Maria, cliente régulière et amie proche d'Isabella, vient au café. Isabella demande à Maria d'aider à décorer la fête, et Maria accepte. La description du personnage de Maria est qu'elle aime Klaus. Cette nuit-là, Maria invite son béguin, Klaus, à une fête avec elle, et Klaus accepte avec joie.

Le jour de la Saint-Valentin, cinq agents, dont Klaus et Maria, se sont présentés au Hobbs Café à 17 heures et ont apprécié les célébrations (Figure 4). Dans ce scénario, l'utilisateur final définit uniquement l'intention initiale d'Isabella d'organiser une fête et l'engouement de Maria pour Klaus : les comportements sociaux consistant à diffuser des informations, à décorer, à inviter les autres à sortir, à arriver à la fête et à interagir à la fête sont initiés par l'architecture des agents.

Architecture

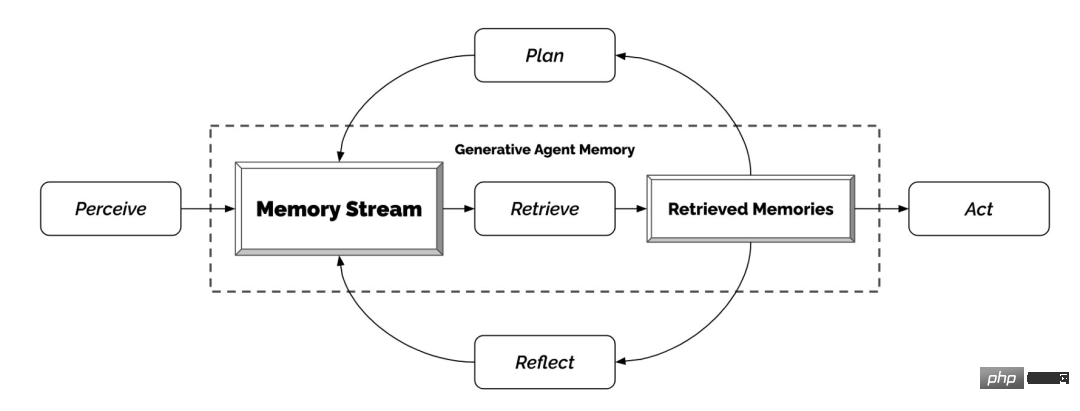

Les agents générateurs prennent leur environnement actuel et leurs expériences passées en entrée et génèrent des comportements en sortie. L'architecture des agents génératifs combine de grands modèles de langage avec des mécanismes pour synthétiser et récupérer des informations pertinentes afin de réguler la sortie du modèle de langage.

S'il n'y a pas de mécanisme de synthèse et de récupération, les grands modèles de langage peuvent générer des comportements, mais les agents génératifs peuvent ne pas répondre en fonction de l'expérience passée de l'agent, ce qui rend impossible toute déduction importante et peut ne pas être en mesure de maintenir des comportements à long terme. cohérence du terme sexe. Même avec les modèles actuels les plus performants (par exemple GPT-4), des problèmes de planification et de cohérence à long terme subsistent.

Étant donné que les agents génératifs génèrent de grandes quantités d'événements et de flux de mémoire qui doivent être conservés, l'un des principaux défis de leur architecture est de garantir que les parties les plus pertinentes de la mémoire de l'agent sont récupérées et synthétisées en cas de besoin.

Le centre architectural des agents génératifs est le flux de mémoire - une base de données qui enregistre de manière exhaustive l'expérience de l'agent. L'agent récupère des enregistrements pertinents du flux de mémoire pour planifier le comportement d'action de l'agent et répondre de manière appropriée à l'environnement, et chaque comportement est enregistré pour synthétiser de manière récursive des conseils comportementaux de niveau supérieur. Tout dans l'architecture des agents génératifs est enregistré et raisonné sous la forme de descriptions en langage naturel, permettant aux agents de tirer parti des capacités de raisonnement des grands modèles de langage.

Actuellement, cette recherche implémente la version gpt3.5-turbo en utilisant ChatGPT. L’équipe de recherche prévoit que les fondements architecturaux des agents générateurs (mémoire, planification et réflexion) resteront probablement inchangés. Les modèles de langage les plus récents (tels que GPT-4) ont une meilleure expressivité et de meilleures performances, ce qui permettra d'étendre davantage les agents génératifs. L'architecture des agents génératifs implémente une fonction de récupération qui prend la situation actuelle de l'agent en entrée et renvoie un sous-ensemble du flux de mémoire à transmettre au modèle de langage. Il existe de nombreuses implémentations possibles de la fonction de récupération, en fonction des facteurs importants pour l'agent lorsqu'il décide comment agir.

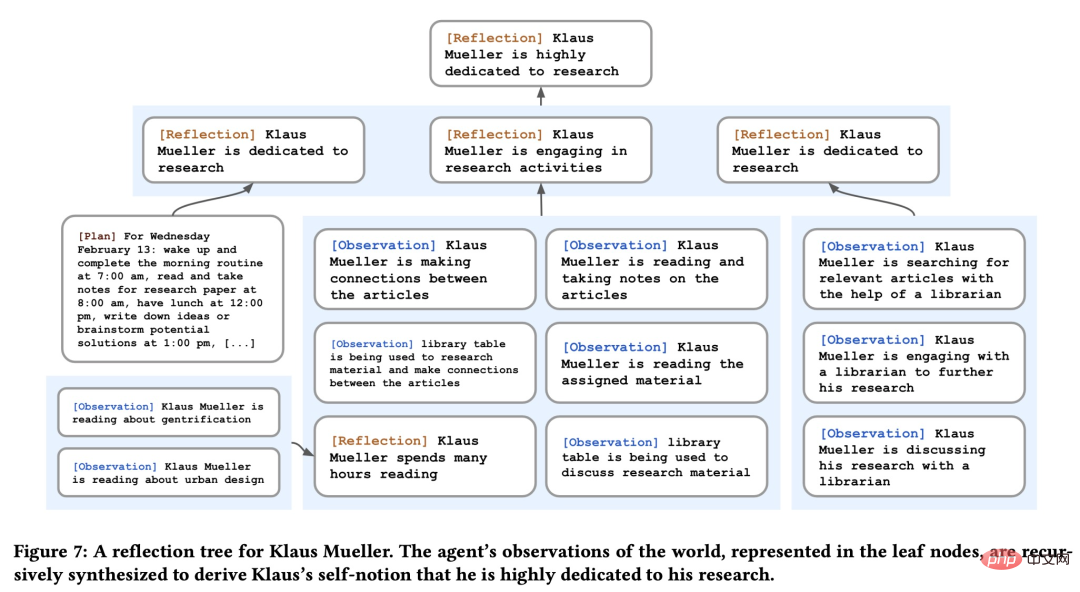

Réflexion

L'étude a également introduit un deuxième type de mémoire, appelé « réflexion ». Les réflexions sont des pensées plus abstraites de niveau supérieur générées par un agent. La réflexion se produit périodiquement. Dans cette étude, l'agent ne commencera à réfléchir que lorsque la somme de ses scores d'importance pour les événements récents dépasse un certain seuil.

En fait, les Agents Génératifs proposés dans l'étude réfléchissaient environ deux à trois fois par jour. La première étape de la réflexion consiste pour l'agent à déterminer les sujets de réflexion en identifiant les questions qui peuvent être posées sur la base de ses expériences récentes.

Planification et réaction

Pour créer un plan raisonnable, les agents génératifs généreront récursivement plus de détails de haut en bas. La première étape consiste à créer un plan qui décrit grossièrement votre « emploi du temps » pour la journée. Pour créer un plan initial, l'étude invite le modèle de langage avec une description générale de l'agent (par exemple, nom, caractéristiques, résumé de ses expériences récentes, etc.).

Dans le processus d'exécution de la planification, les agents générateurs détecteront l'environnement environnant et les observations perçues seront stockées dans leurs flux de mémoire. La recherche utilise ces observations pour inciter les modèles de langage à décider si les agents doivent poursuivre leurs plans actuels ou réagir différemment.

Expérimentation et évaluation

L'étude a mené deux évaluations d'agents génératifs : l'une est une évaluation de contrôle pour tester si l'agent peut générer de manière indépendante des comportements individuels crédibles, l'autre est une évaluation de bout en bout, plusieurs agents génératifs interagissent ; ouvertement pendant la période de jeu de deux jours afin de comprendre la stabilité et le comportement social émergent de l'agent.

Par exemple, Isabella organise une fête pour la Saint-Valentin. Elle diffuse l'information et à la fin de la simulation, 12 personnages sont au courant. Sept d'entre eux étaient "indécis" - trois avaient d'autres projets et quatre n'avaient pas exprimé leurs pensées, tout comme la façon dont les humains s'entendent.

Au niveau de l'évaluation technique, cette recherche a évalué la capacité de l'agent à maintenir sa « personnalité », sa mémoire, sa planification, sa réaction et sa réflexion précise en « interrogeant » l'agent avec un langage naturel, et a mené des expériences d'ablation. Les résultats expérimentaux montrent que chacun de ces composants est essentiel pour que l’agent puisse accomplir correctement sa tâche.

Dans les évaluations expérimentales, les erreurs les plus courantes commises par les agents incluent :

- Son incapacité à récupérer des souvenirs pertinents ;

- falsification de la mémoire de l'agent ; ou des actions.

- Les lecteurs intéressés peuvent lire le texte original de l'article pour en savoir plus sur les détails de la recherche.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI