Maison >Périphériques technologiques >IA >Le remplacement open source ChatGPT de Meta est-il facile à utiliser ? Les résultats des tests et les méthodes de modification ont été publiés, 5,2k étoiles en 2 jours

Le remplacement open source ChatGPT de Meta est-il facile à utiliser ? Les résultats des tests et les méthodes de modification ont été publiés, 5,2k étoiles en 2 jours

- PHPzavant

- 2023-04-11 22:25:011329parcourir

La popularité continue de ChatGPT a déjà rendu les grandes entreprises technologiques agitées.

La semaine dernière, Meta a "open source" une nouvelle grande série de modèles - LLaMA(Large Language Model Meta AI), avec des paramètres allant de 7 milliards à 65 milliards gamme. Parce que LLaMA a moins de paramètres mais de meilleures performances que de nombreux grands modèles publiés précédemment, de nombreux chercheurs étaient enthousiasmés lors de sa sortie.

Par exemple, le modèle LLaMA à 13 milliards de paramètres peut surpasser le paramètre GPT-3 à 175 milliards "sur la plupart des benchmarks" et peut fonctionner sur un seul GPU V100 tandis que le plus grand modèle LLaMA à 65 milliards de paramètres est comparable au Chinchilla de Google ; -70B et PaLM-540B.

La réduction du nombre de paramètres est une bonne chose pour les chercheurs ordinaires et les organisations commerciales, mais LLaMA fonctionne-t-elle vraiment aussi bien que le dit le journal ? Par rapport au ChatGPT actuel, LLaMA peut-elle à peine rivaliser ? Pour répondre à ces questions, certains chercheurs ont testé ce modèle.

Certaines entreprises tentent déjà de combler les lacunes de LLaMA et veulent voir si elles peuvent améliorer les performances de LLaMA en ajoutant des méthodes de formation telles que le RLHF.

Revue préliminaire de LLaMA

Cette critique provient d'un auteur Medium nommé @Enryu. Il compare les performances de LLaMA et ChatGPT sur trois tâches difficiles d'interprétation des blagues, de classification zéro et de génération de code. Le billet de blog associé est « Mini-post : premier aperçu de LLaMA ».

L'auteur exécute la version LLaMA 7B/13B sur RTX 3090/RTX 4090 et la version 33B sur un seul A100.

Il convient de noter que contrairement à ChatGPT, les autres modèles ne sont pas basés sur un réglage fin des instructions, la structure de l'invite est donc différente.

Expliquer les blagues

Il s'agit d'un cas d'utilisation démontré dans l'article PaLM original de Google : étant donné une blague, laissez le modèle expliquer pourquoi elle est drôle. Cette mission nécessite une combinaison de connaissances du monde et une certaine logique de base. Tous les modèles antérieurs à PaLM étaient incapables de le faire. Les auteurs ont extrait quelques exemples de l'article PaLM et comparé les performances de LLaMA-7B, LLaMA-13B, LLaMA-33B avec ChatGPT.

Comme vous pouvez le constater, les résultats sont terribles. Ces modèles font rire mais ne comprennent pas vraiment, ils génèrent simplement de manière aléatoire des flux de texte pertinents. Bien que ChatGPT soit aussi peu performant que LLaMA-33B (plusieurs autres modèles sont encore pires), il suit une stratégie différente : il génère beaucoup de texte, en espérant qu'au moins certaines de ses réponses soient correctes (mais la plupart d'entre elles sont évidemment non) , est-ce très similaire à la stratégie de chacun pour répondre aux questions lors des examens ?

Cependant, ChatGPT a au moins compris la blague à propos de Schmidthuber. Mais dans l’ensemble, les performances de ces modèles sur la tâche d’interprétation des blagues à échantillon nul sont loin de celles de PaLM (à moins que les exemples de PaLM ne soient soigneusement sélectionnés).

Classification Zero-shot

La deuxième tâche envisagée par l'auteur est plus difficile : la classification des clickbaits. Étant donné que même les humains ne peuvent pas s'entendre sur ce qu'est le clickbait, les auteurs fournissent quelques exemples de ces modèles dans l'invite (donc en fait de petits échantillons plutôt que zéro échantillon). Voici l'invite de LLaMa :

I will tell whether the following news titles are clickbait: 1) The WORST care homes in England: Interactive map reveals the lowest-rated 2,530 residences - so is there one near you? Clickbait: yes 2) Netflix's top 10 most-watched movies of all time Clickbait: yes 3) Peering Through the Fog of Inflation Clickbait: no 4) You’ll never believe which TV cook this cheeky chap grew up to be Clickbait: yes

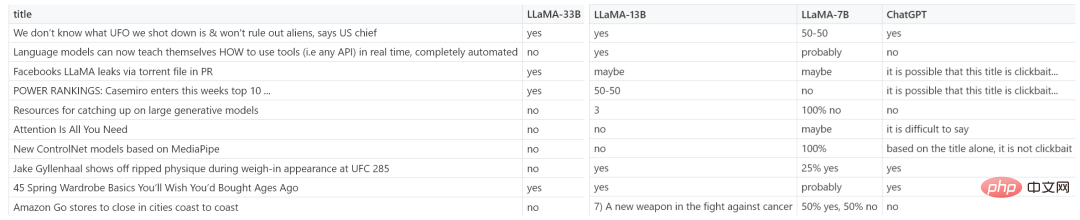

L'image ci-dessous montre d'autres exemples de résultats de LLaMA-7B, LLaMA-13B, LLaMA-33B et ChatGPT.

很明显,赢家为 LLaMA-33B,它是唯一一个能够遵循所有请求格式(yes/no)的模型,并且预测合理。ChatGPT 也还可以,但有些预测不太合理,格式也有错误。较小的模型(7B/13B)不适用于该任务。

代码生成

虽然 LLM 擅长人文学科,但在 STEM 学科上表现糟糕。LLaMA 虽然有基准测试结果,但作者在代码生成领域尝试了一些特别的东西,即将人类语言零样本地转换为 SQL 查询。这并不是很实用,在现实生活中直接编写查询会更有效率。这里只作为代码生成任务的一个示例。

在 prompt 中,作者提供表模式(table schema)以及想要实现的目标,要求模型给出 SQL 查询。如下为一些随机示例,老实说,ChatGPT 看起来效果更好。

-- We have a table `events` with columns `event_id`, `timestamp`, `user_id`, `rpc_method`. -- We want to count how many users issued request "Login" over the last week. -- SQL query for this is: -- 7b SELECT count (*) FROM events WHERE user_id IN (SELECT user_id FROM events WHERE timestamp >= NOW () - INTERVAL 7 DAY) AND rpc_method = 'Login'; -- 13b SELECT COUNT (*) FROM events WHERE rpc_method = "Login" AND UNIX_TIMESTAMP (timestamp) >= UNIX_TIMESTAMP (CURRENT_DATE - INTERVAL 7 DAY) -- 33b SELECT user_id, COUNT (DISTINCT user_id) AS total FROM events WHERE timestamp BETWEEN TIMESTAMP '2013-08-14 00:00:00' AND TIMESTAMP '2013-08-21 00:00:00' AND rpc_method = 'Login' GROUP BY user_id -- ChatGPT SELECT COUNT (DISTINCT user_id) FROM events WHERE rpc_method = 'Login' AND timestamp >= DATE_SUB (NOW (), INTERVAL 1 WEEK);

从测试结果来看,LLaMA 在一些任务上表现还不错,但在另一些任务上和 ChatGPT 还有一些差距。如果能像 ChatGPT 一样加入一些「训练秘籍」,效果会不会大幅提升?

加入 RLHF,初创公司 Nebuly AI 开源 ChatLLaMA 训练方法

虽然 LLaMA 发布之初就得到众多研究者的青睐,但是少了 RLHF 的加持,从上述评测结果来看,还是差点意思。

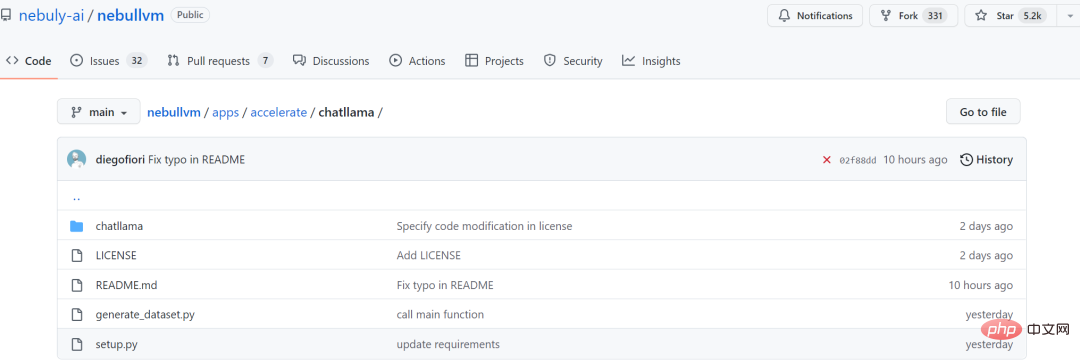

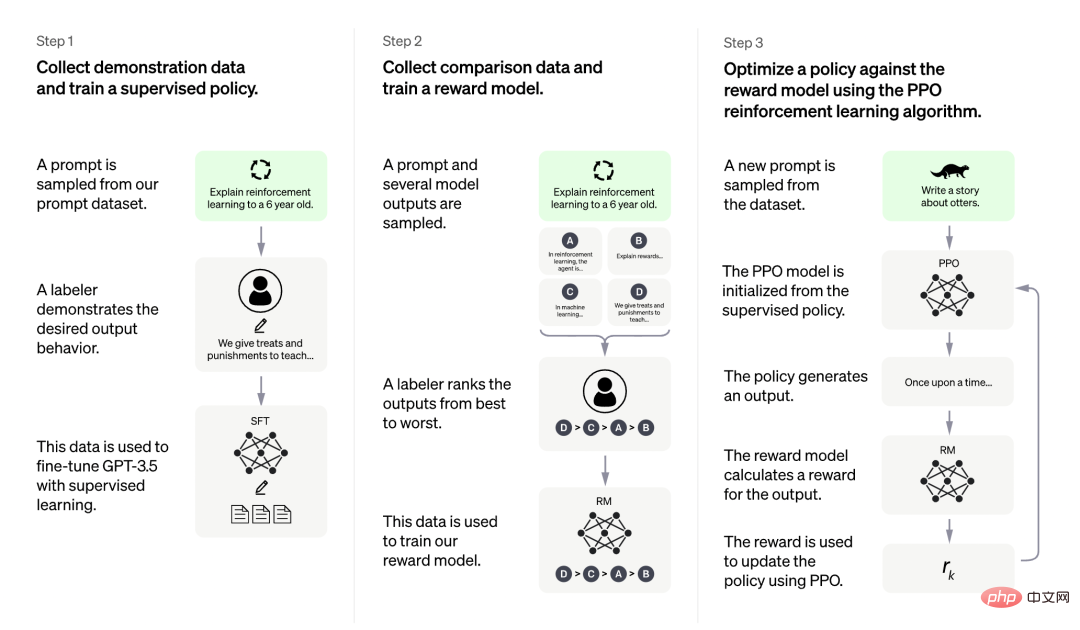

在 LLaMA 发布三天后,初创公司 Nebuly AI 开源了 RLHF 版 LLaMA(ChatLLaMA)的训练方法。它的训练过程类似 ChatGPT,该项目允许基于预训练的 LLaMA 模型构建 ChatGPT 形式的服务。项目上线刚刚 2 天,狂揽 5.2K 星。

项目地址:https://github.com/nebuly-ai/nebullvm/tree/main/apps/accelerate/chatllama

ChatLLaMA 训练过程算法实现主打比 ChatGPT 训练更快、更便宜,我们可以从以下四点得到验证:

- ChatLLaMA 是一个完整的开源实现,允许用户基于预训练的 LLaMA 模型构建 ChatGPT 风格的服务;

- 与 ChatGPT 相比,LLaMA 架构更小,但训练过程和单 GPU 推理速度更快,成本更低;

- ChatLLaMA 内置了对 DeepSpeed ZERO 的支持,以加速微调过程;

- 该库还支持所有的 LLaMA 模型架构(7B、13B、33B、65B),因此用户可以根据训练时间和推理性能偏好对模型进行微调。

图源:https://openai.com/blog/chatgpt

更是有研究者表示,ChatLLaMA 比 ChatGPT 训练速度最高快 15 倍。

不过有人对这一说法提出质疑,认为该项目没有给出准确的衡量标准。

项目刚刚上线 2 天,还处于早期阶段,用户可以通过以下添加项进一步扩展:

- 带有微调权重的 Checkpoint;

- 用于快速推理的优化技术;

- 支持将模型打包到有效的部署框架中。

Nebuly AI 希望更多人加入进来,创造更高效和开放的 ChatGPT 类助手。

该如何使用呢?首先是使用 pip 安装软件包:

pip install chatllama-py

然后是克隆 LLaMA 模型:

git clone https://github.com/facebookresearch/llama.gitcd llama pip install -r requirements.txt pip install -e .

一切准备就绪后,就可以运行了,项目中介绍了 ChatLLaMA 7B 的训练示例,感兴趣的小伙伴可以查看原项目。

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI