Maison >Périphériques technologiques >IA >Dix questions d'entretien courantes pour les mesures d'évaluation de l'apprentissage automatique

Dix questions d'entretien courantes pour les mesures d'évaluation de l'apprentissage automatique

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-11 20:58:021710parcourir

Les métriques d'évaluation sont des métriques quantitatives utilisées pour évaluer les performances des modèles d'apprentissage automatique. Ils fournissent un moyen systématique et objectif de comparer différents modèles et de mesurer leur réussite dans la résolution d'un problème spécifique. En comparant les résultats de différents modèles et en évaluant leurs performances, vous pouvez prendre les bonnes décisions concernant les modèles à utiliser, comment améliorer les modèles existants et comment optimiser les performances d'une tâche donnée. Les mesures d'évaluation jouent donc un rôle essentiel dans le développement et déploiement de modèles d’apprentissage automatique. Par conséquent, les indicateurs d’évaluation sont des questions fondamentales qui sont souvent posées lors des entretiens. Cet article a compilé 10 questions courantes.

1. Pouvez-vous expliquer la différence entre la précision et le rappel dans le contexte de l'apprentissage automatique

Dans les modèles d'apprentissage automatique, la précision et le rappel sont deux mesures d'évaluation couramment utilisées ? La précision est une mesure du nombre de prédictions vraies positives faites par un modèle parmi toutes les prédictions positives, indiquant la capacité du modèle à éviter les prédictions faussement positives.

Precision = TP/TP+FP

Recall est une mesure du nombre de vraies prédictions faites par un modèle sur toutes les instances positives réelles de l'ensemble de données. Le rappel représente la capacité du modèle à identifier correctement toutes les instances positives.

Recall = TP/TP+FN

La précision et le rappel sont deux mesures d'évaluation importantes, mais le compromis entre les deux dépend des exigences du problème spécifique à résoudre. Par exemple, dans le diagnostic médical, le rappel peut être plus important car il est crucial d’identifier tous les cas d’une maladie, même si cela entraîne un taux de faux positifs plus élevé. Mais dans la détection des fraudes, la précision peut être plus importante, car il est crucial d’éviter les fausses accusations, même si cela entraîne un taux de faux négatifs plus élevé.

2. Comment choisir une métrique d'évaluation appropriée pour un problème donné ?

Choisir une évaluation appropriée pour un problème donné est un aspect clé du processus de développement du modèle. Lors de la sélection des indicateurs, il est important de considérer la nature du problème et les objectifs de l’analyse. Certains facteurs courants à prendre en compte incluent :

Type de problème : s'agit-il d'un problème de classification binaire, d'un problème de classification multi-classes, d'un problème de régression ou autre chose

Objectif commercial : quel est l'objectif final de l'analyse et quel type de performance est-il ? Par exemple, si l’objectif est de minimiser les faux négatifs, le rappel sera une mesure plus importante que la précision.

Caractéristiques de l'ensemble de données : les classes sont-elles équilibrées ou déséquilibrées ? L'ensemble de données est-il grand ou petit ?

Qualité des données : quelle est la qualité des données, quelle est la quantité de bruit présente dans l'ensemble de données ? la métrique peut être sélectionnée, telle que la précision, le score F1, l'AUC-ROC, le rappel de précision, l'erreur quadratique moyenne, etc. Mais il est courant d’utiliser plusieurs mesures d’évaluation pour obtenir une compréhension complète des performances du modèle.

3. Pouvez-vous présenter l'utilisation du score F1 ?

Le score F1 est un indicateur d'évaluation couramment utilisé dans l'apprentissage automatique, utilisé pour équilibrer la précision et le rappel. La précision mesure la proportion d'observations positives parmi toutes les prédictions positives faites par le modèle, tandis que le rappel mesure la proportion de prédictions positives parmi toutes les observations positives réelles. Le score F1 est la moyenne harmonique de précision et de rappel et est souvent utilisé comme mesure unique pour résumer les performances d'un classificateur binaire.

F1 = 2 * (Précision * Rappel) / (Précision + Rappel)

Dans les situations où un modèle doit faire un compromis entre précision et rappel, le score F1 fournit une image plus granulaire que l'utilisation de la précision ou du rappel seuls. Évaluation des performances. Par exemple, dans les cas où les prédictions faussement positives sont plus coûteuses que les prédictions faussement négatives, l’optimisation de la précision peut être plus importante, tandis que dans les cas où les prédictions faussement négatives sont plus coûteuses, le rappel peut être prioritaire. Le score F1 peut être utilisé pour évaluer les performances du modèle dans ces scénarios et fournir un support de données correspondant sur la manière d'ajuster son seuil ou d'autres paramètres pour optimiser les performances.

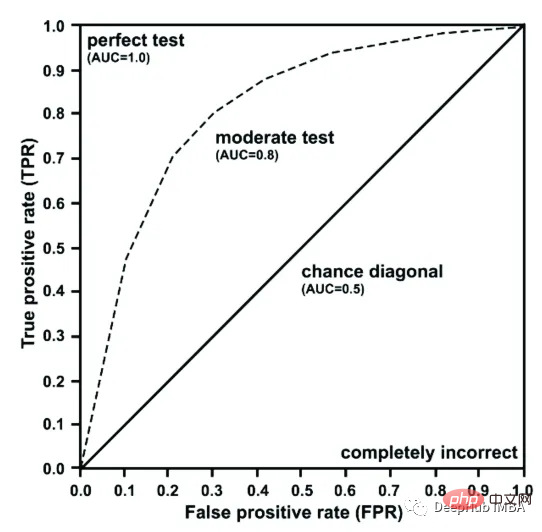

4. Pouvez-vous expliquer la raison de l'utilisation de la courbe ROC dans l'évaluation du modèle ?

La courbe ROC est une représentation graphique des performances d'un modèle de classification binaire qui représente le taux de vrais positifs (TPR) par rapport au taux de faux positifs ( FPR). Il permet d'évaluer le compromis entre la sensibilité (vrais positifs) et la spécificité (vrais négatifs) d'un modèle et est largement utilisé pour évaluer des modèles qui font des prédictions basées sur des résultats de classification binaire (tels que oui ou non, réussite ou échec, etc. ).

La courbe ROC mesure les performances d'un modèle en comparant ses résultats prédits avec les résultats réels. Un bon modèle possède une grande aire sous la courbe ROC, ce qui signifie qu’il est capable de distinguer avec précision les classes positives et négatives. ROC AUC (Area Under the Curve, zone sous la courbe) est utilisé pour comparer les performances de différents modèles, en particulier un bon moyen d'évaluer les performances du modèle lorsque les classes sont déséquilibrées.

La courbe ROC mesure les performances d'un modèle en comparant ses résultats prédits avec les résultats réels. Un bon modèle possède une grande aire sous la courbe ROC, ce qui signifie qu’il est capable de distinguer avec précision les classes positives et négatives. ROC AUC (Area Under the Curve, zone sous la courbe) est utilisé pour comparer les performances de différents modèles, en particulier un bon moyen d'évaluer les performances du modèle lorsque les classes sont déséquilibrées.

5. Comment déterminer le seuil optimal pour un modèle de classification binaire ?

Le seuil optimal pour un modèle de classification binaire est déterminé en trouvant un seuil qui équilibre précision et rappel. Ceci peut être réalisé en utilisant des mesures d'évaluation telles que le score F1, qui équilibre précision et rappel, ou en utilisant des courbes ROC, qui tracent les taux de vrais positifs et de faux positifs pour différents seuils. Le seuil optimal est généralement choisi comme le point de la courbe ROC le plus proche du coin supérieur gauche, car cela maximise le taux de vrais positifs tout en minimisant le taux de faux positifs. En pratique, le seuil optimal peut également dépendre des objectifs spécifiques du problème et des coûts associés aux faux positifs et aux faux négatifs.

6. Pouvez-vous introduire le compromis entre précision et rappel dans l'évaluation du modèle suivante ?

Le compromis entre précision et rappel dans l'évaluation du modèle fait référence à l'identification correcte des instances positives (rappel) et à l'identification correcte uniquement des instances positives ( rappel) compromis. Une haute précision signifie un faible nombre de faux positifs, tandis qu'un rappel élevé signifie un faible nombre de faux négatifs. Pour un modèle donné, il est souvent impossible de maximiser simultanément la précision et le rappel. Pour faire ce compromis, il faut considérer les objectifs et les besoins spécifiques du problème et choisir une mesure d'évaluation qui leur correspond.

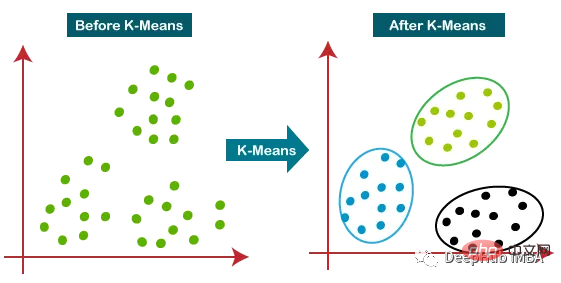

7. Comment évaluer les performances du modèle de clustering ?

Les performances du modèle de clustering peuvent être évaluées à l'aide de nombreux indicateurs. Certaines mesures courantes incluent :

- Silhouette Score : il mesure la similarité observée de son propre cluster par rapport à d’autres clusters. Les scores vont de -1 à 1, les valeurs plus proches de 1 indiquant une structure de regroupement plus forte.

- Indice de Calinski-Harabasz : il mesure le rapport entre la variance entre les clusters et la variance au sein des clusters. Des valeurs plus élevées indiquent de meilleures solutions de clustering.

- Indice Davies-Bouldin : Il mesure la similarité moyenne entre chaque cluster et son cluster le plus similaire. Des valeurs plus petites indiquent de meilleures solutions de clustering.

- Indice Rand ajusté : il mesure la similarité entre les véritables étiquettes de classe et les étiquettes de cluster prédites, ajustées en fonction de la probabilité. Des valeurs plus élevées indiquent de meilleures solutions de clustering.

- Matrice de confusion : elle peut évaluer la précision du modèle de clustering en comparant les clusters prédits avec les vraies classes.

Mais le choix d'une métrique d'évaluation appropriée dépend également du problème spécifique et des objectifs de l'analyse groupée.

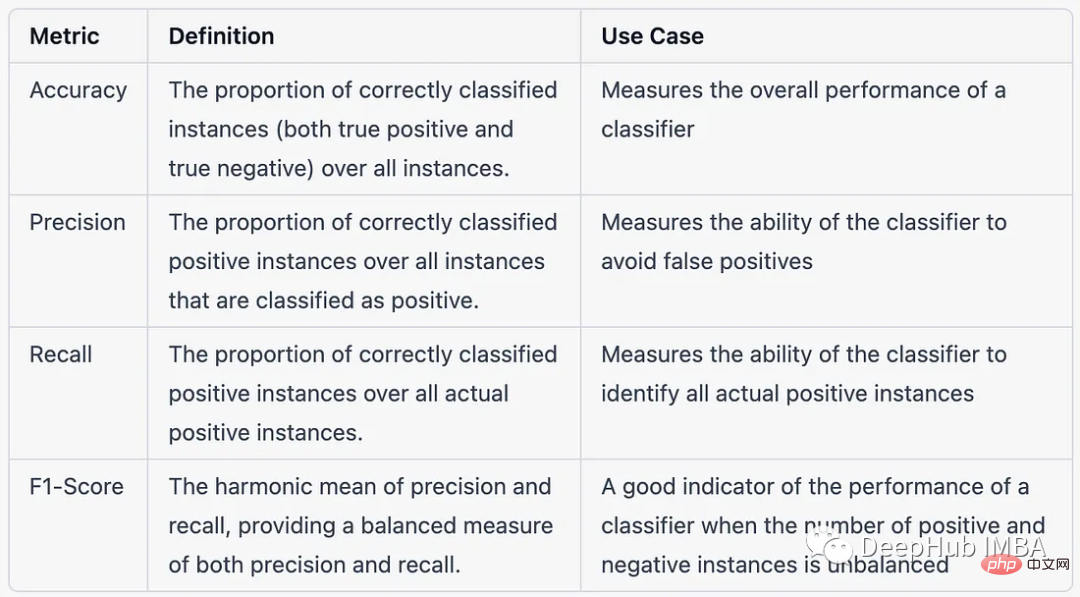

8. La différence entre l'exactitude, la précision, le rappel et le score F1 dans le contexte de problèmes de classification multi-classes

Ce qui suit est un tableau comparatif de l'exactitude, de la précision, du rappel et du score F1 dans le contexte de plusieurs -problèmes de classification de classe. F1-score :

9. Comment évaluer les performances d'un système de recommandation ?

L'évaluation des performances d'un système de recommandation comprend la mesure de l'efficacité et de l'efficience du système dans la recommandation d'éléments pertinents aux utilisateurs. . Certaines mesures couramment utilisées pour évaluer les performances du système de recommandation incluent :

- Précision : la proportion d'éléments recommandés qui sont pertinents pour l'utilisateur.

- Rappel : la proportion d'éléments associés recommandés par le système.

- F1-Score : la moyenne harmonique de précision et de rappel.

- Mean Average Precision (MAP) : mesure de la précision moyenne de l'ensemble des utilisateurs d'un système de recommandation.

- Gain cumulatif actualisé normalisé (NDCG) : mesure la pertinence pondérée par le classement des éléments recommandés.

- Erreur quadratique moyenne (RMSE) : mesure de la différence entre les notes prédites et réelles pour un ensemble d'éléments.

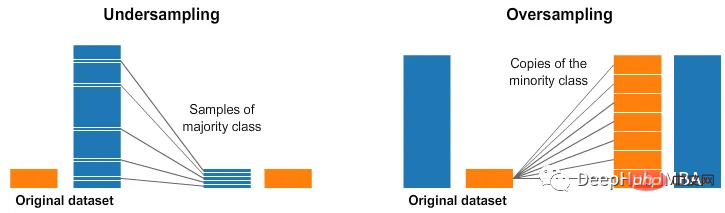

- 10. Comment gérer les ensembles de données déséquilibrés lors de l'évaluation des performances du modèle ?

Afin de traiter les ensembles de données déséquilibrés lors de l'évaluation du modèle, les techniques suivantes peuvent être utilisées :

- Rééchantillonnage de l'ensemble de données : suréchantillonnage la classe minoritaire ou suréchantillonner la classe majoritaire pour équilibrer la répartition des classes.

- Utilisez différentes métriques d'évaluation : des métriques telles que la précision, le rappel, le score F1 et l'aire sous la courbe ROC (AUC-ROC) sont sensibles au déséquilibre de classe et peuvent mieux comprendre les performances du modèle sur des ensembles de données déséquilibrés.

- Utilisez un apprentissage sensible aux coûts : attribuez des coûts à différents types d'erreurs de classification, par exemple en attribuant un coût plus élevé aux faux négatifs qu'aux faux positifs pour rendre le modèle plus sensible aux classes minoritaires.

- Utilisez des méthodes d'ensemble : en combinant les résultats de plusieurs modèles, des techniques telles que le bagging, le boosting et l'empilement peuvent être utilisées pour améliorer les performances du modèle sur des ensembles de données déséquilibrés.

- Méthodes hybrides : une combinaison des techniques ci-dessus peut être utilisée pour gérer des ensembles de données déséquilibrés dans l'évaluation du modèle.

Résumé

Les métriques d'évaluation jouent un rôle clé dans l'apprentissage automatique. Choisir la bonne métrique d'évaluation et l'utiliser de manière appropriée sont essentiels pour garantir la qualité et la fiabilité des modèles d'apprentissage automatique et des informations qu'ils génèrent. Parce qu'elle sera certainement utilisée, c'est une question qui est souvent posée lors des entretiens. J'espère que les questions compilées dans cet article vous seront utiles.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI