Maison >Périphériques technologiques >IA >L'intelligence artificielle doit-elle être comme les humains ?

L'intelligence artificielle doit-elle être comme les humains ?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-11 20:29:251623parcourir

Les machines peuvent-elles penser ? L’intelligence artificielle peut-elle être aussi intelligente que les humains ?

Une dernière étude montre que l’intelligence artificielle pourrait y parvenir.

Dans un test de Turing non linguistique, une équipe de recherche dirigée par le professeur Agnieszka Wykowska de l'Institut italien de technologie a découvert que la variabilité comportementale de type humain (variabilité comportementale) peut brouiller la différence entre les humains et les machines, c'est-à-dire qu'elle peut aider les robots ressemblent davantage à des humains.

Plus précisément, leur programme d'IA a réussi le test non verbal de Turing en simulant la variabilité comportementale des temps de réaction humains tout en jouant à un jeu sur la correspondance des formes et des couleurs avec des coéquipiers humains.

Le document de recherche pertinent s'intitule « La variabilité comportementale de type humain brouille la distinction entre un humain et une machine dans un test de Turing non verbal » et a été publié dans la revue scientifique Science Robotics.

L'équipe de recherche a déclaré que ces travaux peuvent fournir des orientations pour la conception future de robots, en donnant aux robots des comportements semblables à ceux des humains que les humains peuvent percevoir.

À propos de cette recherche, Tom Ziemke, professeur de systèmes cognitifs à l'Université de Linköping, et le chercheur postdoctoral Sam Thellman estiment que les résultats de la recherche « brouillent la distinction entre les humains et les machines » et contribuent à la compréhension scientifique de la cognition sociale humaine. contribution.

Cependant, « la ressemblance humaine n'est pas nécessairement un objectif souhaitable pour le développement de l'intelligence artificielle et de la robotique, et rendre l'IA moins humaine peut être une approche plus sage.

J'ai réussi le test de Turing

1950", Alan Turing, le père de l'informatique et de l'intelligence artificielle, a proposé une méthode de test pour déterminer si une machine est intelligente, le test de Turing.

L'idée clé du test de Turing est que des questions complexes sur la possibilité de la pensée machine et de l'intelligence peuvent être vérifiées en testant si les humains peuvent dire s'ils interagissent avec un autre humain ou avec une machine.

Aujourd'hui, le test de Turing est utilisé par les scientifiques pour évaluer quelles caractéristiques comportementales devraient être mises en œuvre sur des agents artificiels pour empêcher les humains de distinguer les programmes informatiques du comportement humain.

Herbert Simon, le pionnier de l'intelligence artificielle, a dit un jour : « Si le comportement affiché par le programme est similaire à celui affiché par les humains, alors nous les appelons intelligents. » De même, Elaine Rich a défini l'intelligence artificielle comme « Rechercher comment faire les ordinateurs font des choses que les humains font mieux actuellement. »

Le test de Turing non linguistique est une forme de test de Turing. Réussir le test non verbal de Turing n'est pas facile pour l'intelligence artificielle, car elle n'est pas aussi habile que les humains à détecter et à distinguer les caractéristiques comportementales subtiles d'autres personnes (objets).

Alors, un robot humanoïde peut-il réussir le test non verbal de Turing et incarner des caractéristiques humaines dans son comportement physique ? Dans le test non verbal de Turing, l’équipe de recherche a cherché à voir si une IA pouvait être programmée pour faire varier ses temps de réaction dans une plage similaire à la variation comportementale humaine, et ainsi être considérée comme humaine.

Pour ce faire, ils ont disposé des humains et des robots dans une pièce avec différentes couleurs et formes sur l'écran.

Image|Les robots et les humains effectuent des tâches ensemble. (Source : The paper)

Image|Les robots et les humains effectuent des tâches ensemble. (Source : The paper)

Lorsque la forme ou la couleur change, le participant appuie sur un bouton, et le robot répond à ce signal en cliquant sur la couleur ou la forme opposée affichée à l'écran.

Figure | Répondre en appuyant sur un bouton (Source : le journal)

Figure | Répondre en appuyant sur un bouton (Source : le journal)

Lors des tests, le robot était tantôt contrôlé à distance par un humain et tantôt par une intelligence artificielle entraînée à imiter la variabilité comportementale.

Photo|Les participants ont été invités à juger si le comportement du robot était préprogrammé ou contrôlé par un humain. (Source : Le journal)

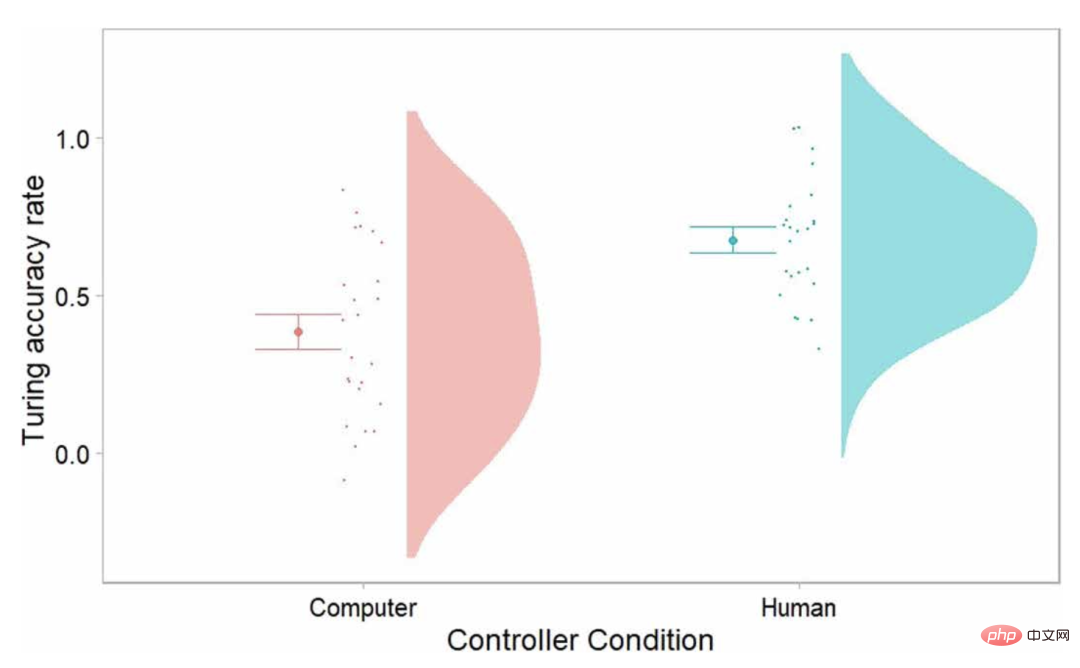

Les résultats ont montré que les participants pouvaient facilement savoir quand le robot était utilisé par une autre personne.

Cependant, lorsque le robot était piloté par l'intelligence artificielle, la probabilité que les participants se trompent était de plus de 50 %.

Figure|Précision moyenne du test de Turing. (Source : Le journal)

Cela signifie que leur intelligence artificielle a réussi le test non verbal de Turing.

Cependant, les chercheurs suggèrent également que la variabilité du comportement humain pourrait n'être qu'une condition nécessaire et insuffisante pour réussir le test non verbal de Turing pour l'intelligence artificielle des entités, car elle peut également se manifester dans des environnements humains.

Est-il nécessaire que l’intelligence artificielle soit comme les humains ?

La recherche sur l'intelligence artificielle utilise depuis longtemps la similarité humaine comme objectif et mesure, et les recherches de l'équipe de Wykowska démontrent que la variabilité comportementale peut être utilisée pour rendre les robots plus semblables aux humains.

Ziemke et d'autres pensent que rendre l'intelligence artificielle moins semblable aux humains pourrait être une approche plus sage, et ont développé les deux cas des voitures autonomes et des robots de discussion.

Par exemple, lorsque vous êtes sur le point de traverser un passage pour piétons sur la route et que vous voyez une voiture s'approcher de vous, de loin, vous ne pourrez peut-être pas dire s'il s'agit d'une voiture autonome, vous ne pouvez donc juger qu'en fonction de le comportement de la voiture pour juger.

(Source : Pixabay)

Cependant, même si vous voyez quelqu'un assis devant le volant, vous ne pouvez pas être sûr si cette personne contrôle activement le véhicule ou surveille simplement les opérations de conduite du véhicule.

"Cela a un impact très important sur la sécurité routière. Si une voiture autonome ne peut pas indiquer aux autres si elle est en mode de conduite autonome, cela peut conduire à des interactions homme-machine dangereuses."

Certaines personnes diraient peut-être. , idéal Dans ce cas, vous n'avez pas besoin de savoir si une voiture est autonome, car à long terme, les voitures autonomes peuvent conduire mieux que les humains. Cependant, pour l’instant, la confiance des gens dans les voitures autonomes est loin d’être suffisante.

Le chatbot est plus proche du scénario réel du test original de Turing. De nombreuses entreprises utilisent des chatbots dans leur service client en ligne, où les sujets de conversation et les options d'interaction sont relativement limités. Dans ce contexte, les chatbots sont souvent plus ou moins impossibles à distinguer des humains.

(Source : Pixabay)

La question est donc : les entreprises devraient-elles informer leurs clients du statut non humain des chatbots ? Une fois dit, cela entraîne souvent des réactions négatives de la part des consommateurs, comme une perte de confiance.

Comme l'illustrent les cas ci-dessus, même si un comportement semblable à celui des humains peut constituer une réussite impressionnante d'un point de vue technique, l'indiscernabilité des humains et des machines entraîne des problèmes psychologiques, éthiques et juridiques évidents.

D'une part, les personnes qui interagissent avec ces systèmes doivent connaître la nature de ce avec quoi elles interagissent pour éviter l'usurpation d'identité. En prenant les chatbots comme exemple, la Californie aux États-Unis a promulgué une loi sur la divulgation des informations sur les chatbots depuis 2018, précisant clairement que la divulgation est une exigence stricte.

D’un autre côté, il existe des exemples encore plus indiscernables que les chatbots et le service client humain. Par exemple, lorsqu'il s'agit de conduite autonome, les interactions entre les voitures autonomes et les autres usagers de la route n'ont pas les mêmes points de départ et d'arrivée clairs, elles ne sont souvent pas individuelles et elles ont certaines réalités. contraintes de temps.

La question est donc de savoir quand et comment communiquer l’identité et les capacités des voitures autonomes.

De plus, les voitures entièrement automatisées pourraient être dans des décennies. Par conséquent, un trafic mixte et des degrés divers d’automatisation partielle seront probablement une réalité dans un avenir proche.

De nombreuses recherches ont été menées sur le type d'interface externe dont les voitures autonomes peuvent avoir besoin pour communiquer avec les gens. Cependant, on sait peu de choses sur les complexités auxquelles les usagers de la route vulnérables, tels que les enfants et les personnes handicapées, sont réellement capables et désireux de faire face.

Ainsi, la règle générale ci-dessus selon laquelle « les personnes interagissant avec un tel système doivent être informées de la nature des objets avec lesquels ils interagissent » ne peut être suivie que dans des circonstances plus explicites.

De même, cette ambivalence se reflète dans les discussions sur la recherche en robotique sociale : étant donné la tendance des humains à anthropomorphiser leurs états mentaux et à leur attribuer des attributs humains, de nombreux chercheurs visent à faire en sorte que les robots ressemblent et se comportent davantage comme des humains, afin qu'ils puissent interagir dans d'une manière plus ou moins humaine.

Cependant, il y a aussi ceux qui pensent que les robots devraient être facilement identifiables comme des machines afin d'éviter des attributs trop anthropomorphes et des attentes irréalistes.

« Il serait peut-être plus sage d’utiliser ces découvertes pour rendre les robots moins humains. » Au début de l’intelligence artificielle, imiter les humains était peut-être un objectif commun dans l’industrie, « mais après que l’intelligence artificielle soit devenue un fait partie de la vie quotidienne des gens "Une partie d'aujourd'hui, nous devons au moins réfléchir à la direction dans laquelle il est vraiment logique de s'efforcer de parvenir à une intelligence artificielle de type humain."

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI