Maison >Périphériques technologiques >IA >Google a dépensé 400 millions de dollars pour Anthropic : les calculs d'entraînement des modèles d'IA ont été multipliés par 1 000 en 5 ans !

Google a dépensé 400 millions de dollars pour Anthropic : les calculs d'entraînement des modèles d'IA ont été multipliés par 1 000 en 5 ans !

- PHPzavant

- 2023-04-11 19:27:401181parcourir

Depuis la découverte de la loi de mise à l'échelle, les gens pensaient que le développement de l'intelligence artificielle serait aussi rapide qu'une fusée.

En 2019, la multimodalité, le raisonnement logique, la vitesse d'apprentissage, l'apprentissage par transfert de tâches croisées et la mémoire à long terme auront encore des « murs » qui ralentissent ou arrêtent les progrès de l'intelligence artificielle. Au fil des années, le « mur » du raisonnement multimodal et logique est tombé.

Compte tenu de cela, la plupart des gens sont de plus en plus convaincus que les progrès rapides de l’intelligence artificielle vont se poursuivre plutôt que de stagner ou de se stabiliser.

Maintenant, les performances des systèmes d'intelligence artificielle sur un grand nombre de tâches sont proches du niveau humain, et le coût de formation de ces systèmes est bien inférieur à celui des « grands projets scientifiques » tels que le télescope spatial Hubble et le Grand collisionneur de hadrons, il a donc déclaré que l'IA avait un énorme potentiel pour le développement futur.

Cependant, les risques de sécurité induits par le développement deviennent de plus en plus importants.

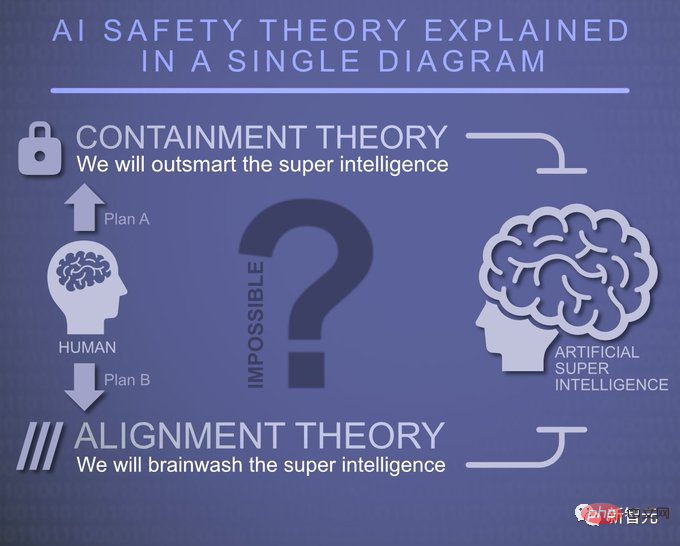

Concernant les problèmes de sécurité de l'intelligence artificielle, Anthropic a analysé trois possibilités :

Dans des circonstances optimistes, la possibilité qu'une intelligence artificielle avancée entraîne des risques catastrophiques en raison de failles de sécurité est très faible. Les technologies de sécurité déjà développées, telles que l’apprentissage par renforcement à partir du feedback humain (RLHF) et l’intelligence artificielle constitutionnelle (CAI), sont largement suffisantes pour faire face aux risques.

Les principaux risques sont une utilisation abusive intentionnelle et des dommages potentiels causés par l'automatisation généralisée et l'évolution de la dynamique du pouvoir international, etc., qui nécessiteront des recherches approfondies de la part des laboratoires d'IA et de tiers, tels que les universités et les institutions de la société civile, pour aider les décideurs politiques. gérer certains des risques structurels potentiels induits par l’intelligence artificielle avancée.

Ni bons ni mauvais scénarios, les risques catastrophiques sont une issue possible, voire raisonnable, du développement de l'intelligence artificielle avancée, et nous aurons besoin d'efforts scientifiques et techniques substantiels pour éviter ces risques, comme ceux fournis par Anthropic. « boxe combinée », on peut éviter les risques.

Les recherches actuelles d'Anthropic en matière de sécurité

Anthropic travaille actuellement dans diverses directions, principalement divisées en trois domaines : les capacités de l'IA en matière d'écriture, de traitement ou de génération d'images, de jeux, etc. ; Développement de nouveaux algorithmes pour entraîner les les capacités d'alignement des systèmes d'intelligence artificielle ; évaluer et comprendre si le système d'intelligence artificielle est réellement aligné, quelle est son efficacité et ses capacités d'application.

Anthropic a lancé les projets suivants pour étudier comment former une intelligence artificielle sûre.

Interprétabilité des mécanismes

L'interprétabilité des mécanismes, c'est-à-dire essayer de procéder à l'ingénierie inverse d'un réseau neuronal en un algorithme que les humains peuvent comprendre, est similaire à l'ingénierie inverse d'un programme informatique inconnu et potentiellement dangereux.

Anthropic espère que cela pourra nous permettre de faire quelque chose de similaire à la « révision du code », qui peut examiner le modèle et identifier les aspects dangereux pour fournir de solides garanties de sécurité.

C'est une question très difficile, mais pas aussi impossible qu'il y paraît.

D'une part, les modèles de langage sont des programmes informatiques volumineux et complexes (le phénomène de « superposition » rend les choses plus difficiles). D’un autre côté, certains signes indiquent que cette approche est plus facile à résoudre qu’on pourrait le penser à première vue. Anthropic a étendu avec succès cette approche aux petits modèles de langage, a même découvert un mécanisme qui semble piloter l'apprentissage contextuel et a une meilleure compréhension des mécanismes responsables de la mémoire.

La recherche sur l’interprétabilité d’Antropic veut combler les lacunes laissées par d’autres types de science de la permutation. Par exemple, ils soutiennent que l’une des choses les plus précieuses que la recherche sur l’interprétabilité peut produire est la capacité d’identifier si un modèle est faussement aligné.

À bien des égards, le problème de la cohérence technique est inextricablement lié au problème de la détection des mauvais comportements dans les modèles d'IA.

Si un mauvais comportement peut être détecté de manière robuste dans de nouvelles situations (par exemple en « lisant dans les pensées du modèle »), alors nous pouvons trouver de meilleures façons de former des modèles qui ne présentent pas ces modes de défaillance.

Anthropic estime qu'en comprenant mieux le fonctionnement détaillé des réseaux neuronaux et l'apprentissage, une plus large gamme d'outils peut être développée dans la recherche de la sécurité.

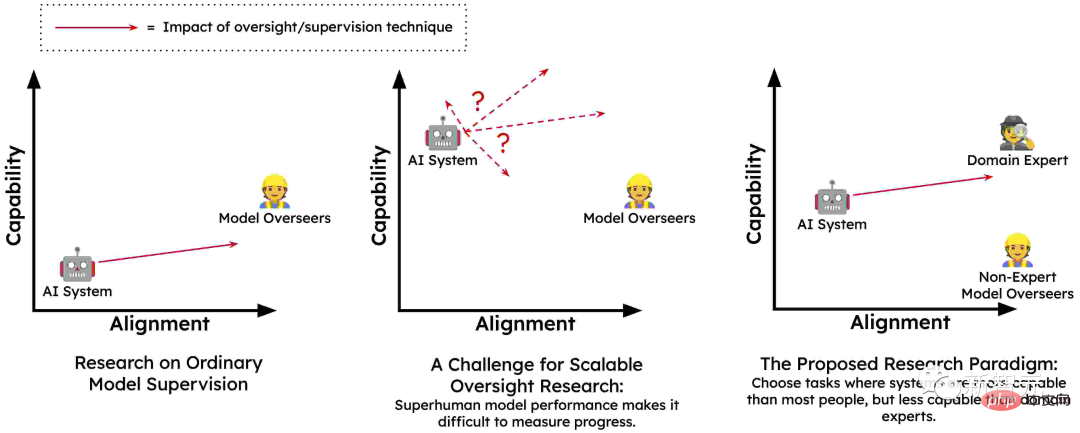

Supervision évolutive

La transformation de modèles de langage en systèmes d'intelligence artificielle unifiés nécessite de grandes quantités de retours de haute qualité pour guider leur comportement. La raison principale est que les humains ne sont peut-être pas en mesure de fournir les informations précises nécessaires pour entraîner correctement le modèle afin d'éviter les comportements nuisibles dans un large éventail d'environnements.

Il se pourrait que les humains soient trompés par les systèmes d'IA et qu'ils fournissent des commentaires qui reflètent leurs besoins réels (par exemple, en fournissant accidentellement des commentaires positifs pour des suggestions trompeuses). Et les humains ne peuvent pas le faire à grande échelle, ce qui pose le problème d’une supervision évolutive et est au cœur de la formation de systèmes d’IA sûrs et cohérents.

Par conséquent, Anthropic estime que la seule façon d'assurer la supervision nécessaire est de laisser le système d'intelligence artificielle se superviser partiellement ou d'aider les humains à se superviser. D’une certaine manière, une petite quantité de supervision humaine de haute qualité est amplifiée en une grande quantité de supervision de haute qualité par l’intelligence artificielle.

Cette idée s'est révélée prometteuse grâce à des techniques telles que le RLHF et l'IA constitutionnelle, les modèles de langage ont beaucoup appris sur les valeurs humaines lors de la pré-formation, et on peut s'attendre à ce que des modèles plus grands en apprennent davantage sur l'humain. valeurs Avoir une compréhension plus précise.

Une autre caractéristique clé de la supervision évolutive, en particulier des techniques comme la CAI, est qu'elle permet une équipe rouge automatisée (c'est-à-dire une formation contradictoire). Autrement dit, ils pourraient automatiquement générer des entrées potentiellement problématiques dans les systèmes d’IA, voir comment ils réagissent, puis les entraîner automatiquement à se comporter de manière plus honnête et plus inoffensive.

En plus du CAI, il existe une variété de méthodes de supervision évolutives telles que la supervision assistée par l'homme, le débat IA-IA, l'équipe rouge RL multi-agents et l'évaluation de la génération de modèles de création. Grâce à ces méthodes, les modèles peuvent mieux comprendre les valeurs humaines et se comporter de manière plus conforme aux valeurs humaines. De cette façon, Anthropic peut former des systèmes de sécurité plus puissants.

Apprenez le processus, pas obtenez le résultat

Une façon d'apprendre une nouvelle tâche consiste à faire des essais et des erreurs. Si vous savez quel est le résultat final souhaité, vous pouvez continuer à essayer de nouvelles stratégies jusqu’à ce que vous réussissiez. Anthropic appelle cela « l'apprentissage axé sur les résultats ».

Dans ce processus, la stratégie de l'agent est entièrement déterminée par le résultat souhaité, et aura tendance à choisir des stratégies à faible coût pour lui permettre d'atteindre cet objectif.

Une meilleure façon d'apprendre est généralement de laisser les experts vous guider et comprendre leur processus de réussite. Pendant les séances d’entraînement, votre réussite n’a peut-être pas tellement d’importance, car vous pouvez vous concentrer sur l’amélioration de votre approche.

Au fur et à mesure que vous progressez, vous pouvez consulter votre coach pour poursuivre de nouvelles stratégies et voir si cela fonctionne mieux pour vous. C'est ce qu'on appelle « l'apprentissage orienté processus ». Dans l’apprentissage orienté processus, le résultat final n’est pas le but, mais la maîtrise du processus est la clé.

De nombreuses préoccupations concernant la sécurité des systèmes avancés d'intelligence artificielle, au moins au niveau conceptuel, peuvent être résolues en formant ces systèmes de manière orientée processus.

Les experts humains continueront à comprendre les étapes individuelles suivies par les systèmes d'IA, et pour que ces processus soient encouragés, ils doivent expliquer leurs raisons aux humains.

Les systèmes d'IA ne seront pas récompensés pour leur réussite de manière imprévisible ou nuisible, car ils ne seront récompensés qu'en fonction de l'efficacité et de la compréhensibilité de leurs processus.

De cette façon, ils ne sont pas récompensés pour la poursuite de sous-objectifs problématiques tels que l'acquisition de ressources ou la tromperie, car les humains ou leurs agents fourniraient des commentaires négatifs sur son processus d'acquisition pendant la formation.

Anthropic estime que « l'apprentissage orienté processus » peut être le moyen le plus prometteur de former des systèmes sûrs et transparents, et c'est aussi la méthode la plus simple.

Comprendre la généralisation

Le travail d'interprétabilité mécanique procède à l'ingénierie inverse des calculs effectués par les réseaux de neurones. Anthropic a également cherché à acquérir une compréhension plus détaillée des procédures de formation pour les grands modèles de langage (LLM).

Les LLM ont démontré une variété de nouveaux comportements surprenants, allant d'une créativité incroyable à l'autoprotection en passant par la tromperie. Tous ces comportements proviennent de données d'entraînement, mais le processus est compliqué : le modèle est d'abord « pré-entraîné » sur une grande quantité de texte original, apprenant un large éventail de représentations et simulant les capacités de différents agents. Ils sont ensuite affinés de différentes manières, dont certaines peuvent avoir des conséquences surprenantes.

En raison d'un surparamétrage lors de la phase de mise au point, le modèle appris dépend fortement du biais implicite de la pré-formation, et ce biais implicite provient du réseau complexe construit en pré-formation de la plupart des connaissances mondiales. . Réseau de représentation.

Lorsqu'un modèle se comporte de manière inquiétante, par exemple lorsqu'il agit comme une IA trompeuse, est-il simplement en train de ruminer de manière inoffensive une séquence d'entraînement presque identique ? Ou est-ce que ce comportement (et même les croyances et les valeurs qui y conduisent) est devenu tellement partie intégrante de la conception du modèle d’un assistant IA qu’il l’applique dans différents contextes ?

Anthropic travaille sur une technique qui tente de retracer la sortie du modèle jusqu'aux données d'entraînement afin d'identifier des indices importants qui peuvent aider à comprendre ce comportement.

Test des modes de défaillance dangereux

Un problème clé est que l'IA avancée peut développer des comportements émergents nuisibles, tels que des capacités de tromperie ou de planification stratégique, qui ne seraient pas possibles dans des systèmes plus petits et moins performants.Avant que ce problème ne devienne une menace immédiate, Anthropic estime que la façon de le prédire est de construire un environnement. Ils ont donc délibérément intégré ces propriétés dans des modèles à petite échelle. Parce que ces modèles ne sont pas assez puissants pour constituer un danger, ils peuvent être isolés et étudiés.

Anthropic s'intéresse particulièrement au comportement des systèmes d'IA dotés d'une « conscience de la situation » - par exemple, lorsqu'ils réalisent qu'ils sont une IA parlant à un humain dans l'environnement d'entraînement, comment cela affecte leur comportement d'entraînement pendant la période ? Les systèmes d’IA pourraient-ils devenir trompeurs ou développer des objectifs étonnamment sous-optimaux ?

Idéalement, ils aimeraient construire des modèles quantitatifs détaillés de la façon dont ces tendances évoluent à grande échelle, afin que les modes de défaillance soudaines et dangereuses puissent être prédits à l'avance.

Dans le même temps, Anthropic s'inquiète également des risques associés à la recherche elle-même :

Si la recherche est menée sur un modèle plus petit, il est peu probable qu'il y ait des risques sérieux si elle est menée sur un modèle plus petit ; modèle plus grand avec de plus grandes capacités, il n'y a pas de risques sérieux. Il y a des risques évidents. Anthropic n’a donc pas l’intention de mener ce type de recherche sur des modèles susceptibles de causer de graves dommages.

Impact social et évaluation

Un pilier clé de la recherche anthropique est d'évaluer et de comprendre de manière critique les capacités, les limites et les impacts sociaux potentiels des systèmes d'intelligence artificielle en établissant des outils, des mesures et leur impact social potentiel.Par exemple, Anthropic a publié des recherches analysant la prévisibilité des grands modèles de langage. Ils examinent la prévisibilité et l'imprévisibilité de haut niveau de ces modèles et analysent comment cette propriété peut conduire à des comportements nuisibles.

Dans ce travail, ils étudient les approches des modèles de langage d'équipe rouge pour trouver et réduire les dangers en sondant la sortie du modèle à différentes échelles de modèle. Récemment, ils ont découvert que les modèles linguistiques actuels peuvent suivre des instructions et réduire les préjugés et les stéréotypes.

Anthropic est très préoccupé par l'impact de l'application rapide des systèmes d'intelligence artificielle sur la société à court, moyen et long terme.

En menant aujourd’hui des recherches rigoureuses sur l’impact de l’IA, ils visent à fournir aux décideurs politiques et aux chercheurs les arguments et les outils dont ils ont besoin pour contribuer à atténuer les crises sociales potentiellement majeures et garantir que les bénéfices de l’IA parviennent aux populations.

Conclusion

L'intelligence artificielle aura un impact sans précédent sur le monde dans les dix prochaines années. La croissance exponentielle de la puissance de calcul et les améliorations prévisibles des capacités de l'intelligence artificielle indiquent que la technologie du futur sera bien plus avancée que celle d'aujourd'hui.

Cependant, nous ne comprenons pas encore clairement comment garantir que ces systèmes puissants sont étroitement intégrés aux valeurs humaines et ne pouvons donc pas garantir que le risque de défaillance catastrophique sera minimisé. Nous devons donc toujours nous préparer à des situations moins optimistes.

Grâce à des recherches empiriques sous de multiples angles, le « punch combiné » des travaux de sécurité fournis par Anthropic semble pouvoir nous aider à résoudre les problèmes de sécurité de l'intelligence artificielle.

Ces recommandations de sécurité d'Anthropic nous disent :

« Pour améliorer notre compréhension de la façon dont les systèmes d'IA apprennent et se généralisent au monde réel, développer des techniques de supervision et de révision des systèmes d'IA évolutives, créer des systèmes d'IA transparents et explicables, former Les systèmes d'IA doivent suivre les processus de sécurité plutôt que de courir après les résultats, analyser les modes de défaillance potentiellement dangereux de l'IA et comment les prévenir, évaluer l'impact social de l'IA pour guider les politiques et la recherche, et plus encore. scène pour une défense parfaite contre l’intelligence artificielle, mais Anthropic a montré la voie à suivre pour tout le monde.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI