Maison >Périphériques technologiques >IA >Microsoft lance l'outil d'IA Security pour aider le personnel de cybersécurité à répondre aux menaces

Microsoft lance l'outil d'IA Security pour aider le personnel de cybersécurité à répondre aux menaces

- WBOYavant

- 2023-04-04 14:50:021733parcourir

Récemment, Microsoft a lancé Security Copilot, un nouvel outil conçu pour simplifier le travail du personnel de sécurité des réseaux grâce à des assistants IA et les aider à répondre aux menaces de sécurité.

Le personnel de cybersécurité doit souvent gérer de nombreux outils et des quantités massives de données provenant de sources multiples. Microsoft a récemment annoncé le lancement de Security Copilot, un nouvel outil conçu pour simplifier le travail du personnel de sécurité des réseaux grâce à des assistants IA et les aider à répondre aux menaces de sécurité.

Copilot exploite la dernière technologie GPT-4 basée sur OpenAI pour permettre au personnel de cybersécurité de poser et d'obtenir des réponses aux problèmes de sécurité actuels affectant l'environnement, et même d'intégrer directement les connaissances au sein de l'entreprise pour fournir aux équipes des informations utiles, depuis Learn à partir des informations existantes et corréler l’activité actuelle des menaces avec les données d’autres outils pour fournir les informations les plus récentes.

Microsoft a combiné la puissance du modèle linguistique à grande échelle d'OpenAI dans cet outil, lui permettant de comprendre les questions posées et de résumer les rapports sur les menaces générés par l'équipe de cybersécurité de l'entreprise et les données externes, ainsi que la propre analyse des menaces de Microsoft. Microsoft affirme que le modèle s'appuie sur plus de 100 sources de données différentes et reçoit chaque jour plus de 65 000 milliards de signaux de menace.

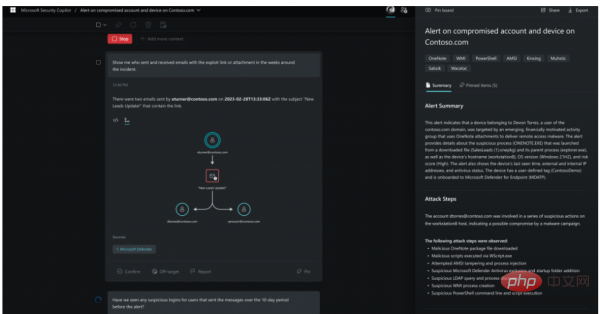

Avec Security Copilot, les professionnels peuvent enquêter rapidement sur les incidents critiques en tirant parti des assistants IA pour explorer les données en langage naturel. L'outil peut utiliser sa capacité à comprendre le langage conversationnel pour résumer les processus et les événements, fournissant ainsi des rapports rapides permettant aux membres de l'équipe d'être plus rapidement informés.

Par exemple, Prompt Assistant fournit des rapports de réponse aux incidents pour une enquête spécifique et en cours, basée sur un ensemble d'outils et d'événements. Les assistants IA peuvent extraire des données et des informations de ces outils et fournir aux utilisateurs des résumés, des rapports et d'autres informations basés sur une requête donnée et les afficher. Les utilisateurs peuvent ensuite affiner leurs questions pour demander à l'IA de fournir plus d'informations, modifier la façon dont le rapport est affiché ou résumé, les outils utilisés et les informations sur les événements qui en sont extraites.

Jakkal a déclaré que l'assistant peut également identifier les anomalies en utilisant les propres informations mondiales sur les menaces de Microsoft pour prédire et repérer les menaces potentielles que les professionnels pourraient manquer. Les professionnels peuvent également utiliser l'outil pour élargir leurs compétences, telles que l'ingénierie inverse de scripts potentiellement malveillants et envoyer les informations à un autre collègue, qui voit si elles doivent être signalées pour des recherches plus approfondies.

Bien qu'il s'agisse d'un outil très utile pour les professionnels de la sécurité, il n'est pas sans défauts. Étant donné que tous les outils Copilot intègrent GPT-4, Microsoft prévient que l'outil ne « fait pas toujours tout correctement », et il en va de même pour Security Copilot. Pour résoudre ce problème, Microsoft a ajouté une fonctionnalité qui permet aux utilisateurs de créer des rapports sur les réponses générées par l'IA afin qu'ils puissent mieux effectuer les ajustements.

Avivah Litan, vice-président et analyste bien connu chez Gartner, a déclaré : « Security Copilot exige que les utilisateurs vérifient l'exactitude des résultats sans leur donner de score sur la probabilité que les résultats soient corrects. Les utilisateurs s'appuient sur les résultats et supposent que le contenu de ces résultats est correct, étant donné que nous parlons de sécurité d'entreprise, nous pensons qu'il s'agit d'une approche dangereuse. "

Dans la démo de Microsoft, les erreurs de l'IA étaient bénignes, mais dans une enquête réelle, l'IA pourrait commettre une erreur de sécurité. Les erreurs sont plus difficiles à détecter et passent inaperçues pour les experts. Litan a déclaré : « Il reste encore un long chemin à parcourir avant que les entreprises puissent se sentir à l'aise avec ces services. »

Microsoft a réalisé des acquisitions pour améliorer ses capacités de détection des menaces, notamment la société de gestion des menaces RiskIQ et la société d'analyse des menaces Miburo.

Cet assistant IA est intégré nativement à de nombreux produits de sécurité Microsoft, notamment Sentinel, la solution de gestion des cybermenaces basée sur le cloud, et Defender, la solution anti-malware. Le logiciel est actuellement disponible en avant-première privée.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI