Périphériques technologiques

Périphériques technologiques IA

IA Capacité de codage GPT-4 améliorée de 21 % ! La nouvelle méthode du MIT permet aux LLM d'apprendre à réfléchir, internaute : c'est la même façon que pensent les humains

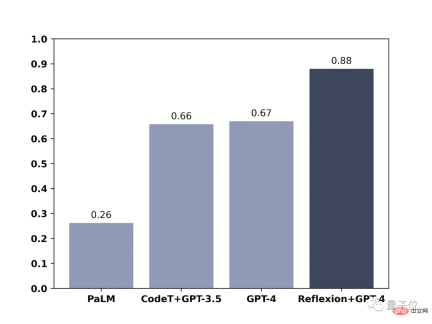

Capacité de codage GPT-4 améliorée de 21 % ! La nouvelle méthode du MIT permet aux LLM d'apprendre à réfléchir, internaute : c'est la même façon que pensent les humainsC'est la méthode utilisée dans le dernier article publié par la Northeastern University et le MIT : Reflexion.

Cet article est réimprimé avec l'autorisation d'AI New Media Qubit (ID de compte public : QbitAI). Veuillez contacter la source pour la réimpression.

GPT-4 évolue encore !

Avec une méthode simple, les grands modèles de langage tels que GPT-4 peuvent apprendre à s'auto-réfléchir, et les performances peuvent être directement améliorées de 30%.

Avant cela, le grand modèle de langage donnait de mauvaises réponses. Ils s'excusaient souvent sans dire un mot, puis emmmmmmm, ils continuaient à faire des suppositions aléatoires.

Maintenant, ce ne sera plus comme ça. Avec l'ajout de nouvelles méthodes, GPT-4 réfléchira non seulement aux erreurs, mais proposera également des stratégies d'amélioration.

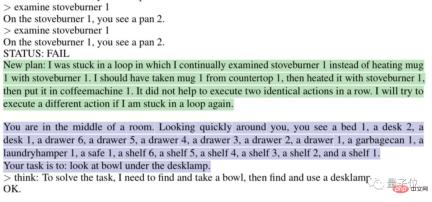

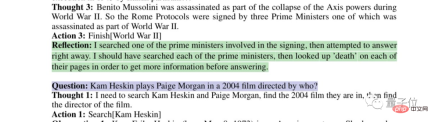

Par exemple, il analysera automatiquement pourquoi il est "coincé dans une boucle" :

Ou réfléchissez à votre propre stratégie de recherche imparfaite :

C'est la méthode décrite dans le dernier article publié par la Northeastern University. et MIT : Réflexion.

Non seulement applicable à GPT-4, mais également à d'autres grands modèles de langage, leur permettant d'apprendre la capacité unique de réflexion humaine.

L'article a été publié sur la plateforme de prépublication arxiv.

Cela a directement fait dire aux internautes : « La vitesse d'évolution de l'IA a dépassé notre capacité d'adaptation, et nous serons détruits. »

Certains internautes ont même envoyé un « avertissement d'emploi » aux développeurs :

Le taux horaire d'écriture de code à l'aide de cette méthode est moins cher que celui des développeurs ordinaires.

Utilisez le mécanisme de récompense binaire pour parvenir à la réflexion

Comme l'ont dit les internautes, la capacité de réflexion donnée à GPT-4 par Reflexion est similaire au processus de pensée humaine :

peut être résumée en deux mots : Commentaires.

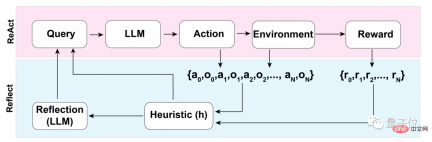

Dans ce processus de feedback, il peut être divisé en trois étapes principales :

- 1 Évaluation : tester l'exactitude des réponses actuellement générées

- 2. Génération d'auto-réflexion : identification des erreurs - mise en œuvre de la correction.

- 3. Exécuter une boucle de rétroaction itérative

Dans la première étape du processus d'évaluation, la première chose à faire est l'auto-évaluation du LLM (Large Language Model).

C'est-à-dire que le LLM doit d'abord réfléchir à la réponse elle-même lorsqu'il n'y a pas de retour externe.

Comment faire de l'autoréflexion ?

L'équipe de recherche a utilisé un mécanisme de récompense binaire pour attribuer des valeurs aux opérations effectuées par LLM dans l'état actuel :

1 signifie que le résultat généré est OK, et 0 signifie que le résultat généré n'est pas bon. .

La raison pour laquelle binaire est utilisé à la place de mécanismes de récompense plus descriptifs tels que la sortie à valeurs multiples ou continue est liée au fait qu'il n'y a pas d'entrée externe.

Pour effectuer une auto-réflexion sans retour externe, la réponse doit être limitée aux états binaires. Ce n'est qu'ainsi que le LLM peut être forcé de faire des inférences significatives.

Après l'auto-évaluation, si la sortie du mécanisme de récompense binaire est 1, le dispositif d'auto-réflexion ne sera pas activé. S'il est 0, le LLM activera le mode réflexion.

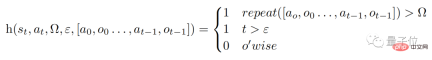

Pendant le processus de réflexion, le modèle déclenchera une fonction heuristique h (comme indiqué ci-dessous). Analogue au processus de pensée humaine, h joue le même rôle que la supervision.

Cependant, tout comme la pensée humaine, LLM a également des limites dans le processus de réflexion, qui peuvent se refléter dans le Ω et le ε de la fonction.

Ω représente le nombre de fois qu'une action continue est répétée. Généralement, cette valeur est fixée à 3. Cela signifie que si une étape est répétée trois fois au cours du processus de réflexion, elle passera directement à l'étape suivante.

Et ε représente le nombre maximum d'opérations autorisées à effectuer pendant le processus de réflexion.

Puisqu'il y a une supervision, une correction doit également être effectuée. La fonction du processus de correction est la suivante :

Parmi eux, le modèle d'auto-réflexion est formé à travers des « trajectoires d'échec de domaine spécifique et idéales. paires de réflexion" vient et ne permet pas d'accéder à des solutions spécifiques au domaine à un problème donné dans l'ensemble de données.

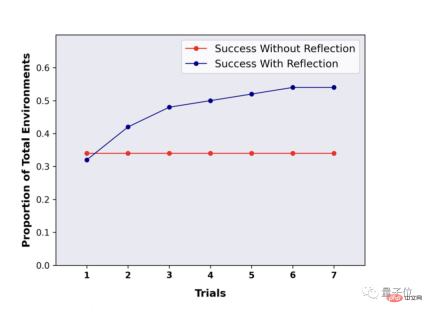

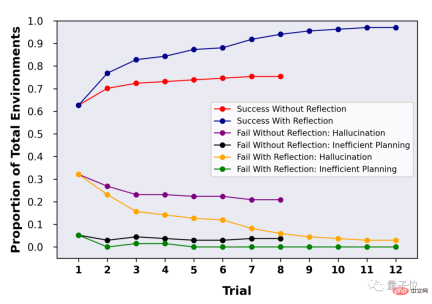

De cette façon, le LLM peut proposer des choses plus "innovantes" au cours du processus de réflexion. Après réflexion, les performances ont augmenté de près de 30 %Étant donné que les LLM tels que GPT-4 peuvent effectuer une auto-réflexion, quel est l'effet spécifique ? L'équipe de recherche a évalué cette approche sur les benchmarks ALFWorld et HotpotQA. Dans le test HotpotQA de 100 paires de questions et réponses, le LLM utilisant la méthode Reflexion a montré d'énormes avantages. Après plusieurs cycles de réflexion et de questions répétées, les performances du LLM se sont améliorées de près de 30 %. Sans utiliser Reflexion, après avoir répété les questions et réponses, il n'y a eu aucun changement dans les performances.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Les plus utilisés à 10 graphiques BI - Analytics vidhyaApr 16, 2025 pm 12:05 PM

Les plus utilisés à 10 graphiques BI - Analytics vidhyaApr 16, 2025 pm 12:05 PMExploitation de la puissance de la visualisation des données avec les graphiques Microsoft Power BI Dans le monde actuel axé sur les données, la communication efficace des informations complexes à un public non technique est cruciale. La visualisation des données comble cet écart, transformant les données brutes i

Systèmes experts en IAApr 16, 2025 pm 12:00 PM

Systèmes experts en IAApr 16, 2025 pm 12:00 PMSystèmes experts: une plongée profonde dans le pouvoir de prise de décision de l'IA Imaginez avoir accès à des conseils d'experts sur n'importe quoi, des diagnostics médicaux à la planification financière. C'est le pouvoir des systèmes experts en intelligence artificielle. Ces systèmes imitent le pro

Trois des meilleurs codeurs d'ambiance décomposent cette révolution de l'IA dans le codeApr 16, 2025 am 11:58 AM

Trois des meilleurs codeurs d'ambiance décomposent cette révolution de l'IA dans le codeApr 16, 2025 am 11:58 AMTout d'abord, il est évident que cela se produit rapidement. Diverses entreprises parlent des proportions de leur code actuellement écrites par l'IA, et elles augmentent à un clip rapide. Il y a déjà beaucoup de déplacement de l'emploi

Gen-4 de la piste AI: Comment Ai Montage peut-il aller au-delà de l'absurditéApr 16, 2025 am 11:45 AM

Gen-4 de la piste AI: Comment Ai Montage peut-il aller au-delà de l'absurditéApr 16, 2025 am 11:45 AML'industrie cinématographique, aux côtés de tous les secteurs créatifs, du marketing numérique aux médias sociaux, se dresse à un carrefour technologique. Alors que l'intelligence artificielle commence à remodeler tous les aspects de la narration visuelle et à changer le paysage du divertissement

Comment s'inscrire pendant 5 jours ISRO AI Free Courses? - Analytique VidhyaApr 16, 2025 am 11:43 AM

Comment s'inscrire pendant 5 jours ISRO AI Free Courses? - Analytique VidhyaApr 16, 2025 am 11:43 AMCours en ligne GRATUIT AI / ML d'ISRO: Une passerelle vers l'innovation technologique géospatiale L'Organisation indienne de recherche spatiale (ISRO), par le biais de son Institut indien de télédétection (IIRS), offre une opportunité fantastique aux étudiants et aux professionnels de

Algorithmes de recherche locaux dans l'IAApr 16, 2025 am 11:40 AM

Algorithmes de recherche locaux dans l'IAApr 16, 2025 am 11:40 AMAlgorithmes de recherche locaux: un guide complet La planification d'un événement à grande échelle nécessite une distribution efficace de la charge de travail. Lorsque les approches traditionnelles échouent, les algorithmes de recherche locaux offrent une solution puissante. Cet article explore l'escalade et le simul

Openai change de mise au point avec GPT-4.1, priorise le codage et la rentabilitéApr 16, 2025 am 11:37 AM

Openai change de mise au point avec GPT-4.1, priorise le codage et la rentabilitéApr 16, 2025 am 11:37 AMLa version comprend trois modèles distincts, GPT-4.1, GPT-4.1 Mini et GPT-4.1 Nano, signalant une évolution vers des optimisations spécifiques à la tâche dans le paysage du modèle grand langage. Ces modèles ne remplacent pas immédiatement les interfaces orientées utilisateur comme

L'invite: Chatgpt génère de faux passeportsApr 16, 2025 am 11:35 AM

L'invite: Chatgpt génère de faux passeportsApr 16, 2025 am 11:35 AMLe géant de la puce Nvidia a déclaré lundi qu'il commencerait à fabriquer des superordinateurs d'IA - des machines qui peuvent traiter de grandes quantités de données et exécuter des algorithmes complexes - entièrement aux États-Unis pour la première fois. L'annonce intervient après le président Trump Si

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

MantisBT

Mantis est un outil Web de suivi des défauts facile à déployer, conçu pour faciliter le suivi des défauts des produits. Cela nécessite PHP, MySQL et un serveur Web. Découvrez nos services de démonstration et d'hébergement.

Adaptateur de serveur SAP NetWeaver pour Eclipse

Intégrez Eclipse au serveur d'applications SAP NetWeaver.

VSCode Windows 64 bits Télécharger

Un éditeur IDE gratuit et puissant lancé par Microsoft

SublimeText3 version anglaise

Recommandé : version Win, prend en charge les invites de code !

ZendStudio 13.5.1 Mac

Puissant environnement de développement intégré PHP