12306 saisie de tickets, pensées provoquées par une concurrence extrême !

- 藏色散人original

- 2022-05-13 10:05:314451parcourir

12306 Récupération de billets, réflexions provoquées par une concurrence extrême ?

À chaque jour de vacances, les personnes qui rentrent chez elles ou sortent pour s'amuser dans les villes de premier et de deuxième rang sont presque toujours confrontées à un problème : récupérer des billets de train, bien que dans la plupart des cas ! maintenant, vous pouvez, je crois que tout le monde a vécu la situation de réserver un billet, mais de le perdre dès que le billet est libéré. Surtout pendant la Fête du Printemps, les gens utilisent non seulement le 12306, mais considèrent également « Zhixing » et d'autres logiciels de saisie de billets. Des centaines de millions de personnes à travers le pays se procurent des billets pendant cette période. Le « service 12306 » a un QPS qui ne peut être surpassé par aucun système de vente flash au monde. Des millions de concurrence, ce n'est que normal ! L'auteur a spécialement étudié l'architecture du serveur "12306" et a appris de nombreux points forts de la conception de son système. Ici, je vais partager avec vous et simuler un exemple : comment fournir un service normal lorsqu'un million de personnes récupèrent 10 000 billets de train en même temps. ., service stable. Adresse du code github

Recommandations associées : "Des millions de solutions de simultanéité de données (théorie + pratique)"

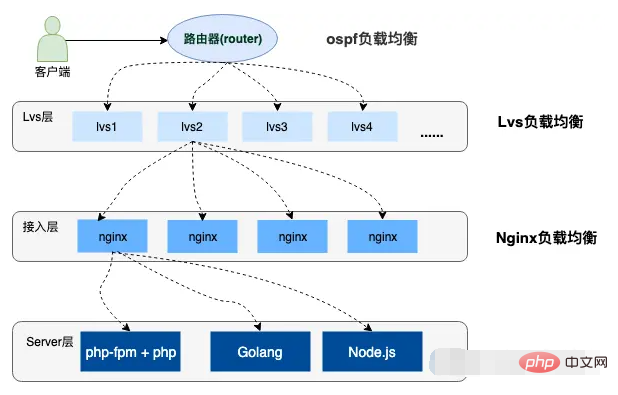

1. Déploiement du cluster de distribution, la couche supérieure du service dispose d'un équilibrage de charge couche par couche et fournit divers moyens de reprise après sinistre (salle informatique double incendie, tolérance aux pannes des nœuds, reprise après sinistre du serveur, etc.) pour assurer la haute disponibilité du système , et le trafic sera équilibré en fonction de différentes capacités de charge et stratégies de configuration sur un serveur différent. Ce qui suit est un diagramme schématique simple :

1.1 Introduction à l'équilibrage de charge

1.1 Introduction à l'équilibrage de charge

La figure ci-dessus décrit que les demandes des utilisateurs au serveur ont subi trois couches d'équilibrage de charge. Ce qui suit est une brève introduction à ces trois types. d'équilibrage de charge :

OSPF (Open Shortest Link First) est un protocole de passerelle intérieure (IGP en abrégé). OSPF établit une base de données d'état des liens en annonçant l'état des interfaces réseau entre les routeurs et génère une arborescence de chemin le plus court. OSPF calculera automatiquement la valeur du coût sur l'interface de routage, mais vous pouvez également spécifier manuellement la valeur du coût de l'interface. l’une est prioritaire. Valeur calculée automatiquement. Le coût calculé par OSPF est également inversement proportionnel à la bande passante de l'interface. Plus la bande passante est élevée, plus la valeur du coût est faible. Les chemins ayant la même valeur de coût vers la cible peuvent effectuer un équilibrage de charge, et jusqu'à 6 liens peuvent effectuer un équilibrage de charge en même temps.- LVS (Linux VirtualServer), c'est une technologie de cluster (Cluster) qui utilise la technologie d'équilibrage de charge IP et la technologie de distribution de requêtes basée sur le contenu. Le planificateur a un très bon débit et transfère uniformément les requêtes vers différents serveurs pour exécution, et le planificateur protège automatiquement les pannes de serveur, formant ainsi un groupe de serveurs en un serveur virtuel hautes performances et hautement disponible.

- Tout le monde doit être familier avec Nginx. Il s'agit d'un serveur proxy http/proxy inverse de très hautes performances. Il est également souvent utilisé pour l'équilibrage de charge dans le développement de services. Il existe trois manières principales pour Nginx d'équilibrer la charge : l'interrogation, l'interrogation pondérée et l'interrogation de hachage IP. Ci-dessous, nous effectuerons une configuration et des tests spéciaux de l'interrogation pondérée de Nginx

- 1.2 Démonstration de l'interrogation pondérée de Nginx

Implémentations de Nginx. équilibrage de charge via le module en amont. La configuration d'interrogation pondérée peut ajouter une valeur de poids aux services concernés. Lors de la configuration, la charge correspondante peut être définie en fonction des performances et de la capacité de charge du serveur. Ce qui suit est une configuration d'une charge d'interrogation pondérée. Je vais écouter les ports 3001-3004 localement et configurer les poids de 1, 2, 3 et 4 respectivement :

#配置负载均衡

upstream load_rule {

server 127.0.0.1:3001 weight=1;

server 127.0.0.1:3002 weight=2;

server 127.0.0.1:3003 weight=3;

server 127.0.0.1:3004 weight=4;

}

...

server {

listen 80;

server_name load_balance.com www.load_balance.com;

location / {

proxy_pass http://load_rule;

}

}Copiez le code que j'ai configuré www dans le /etc/ local. répertoire d'hôtes adresse du nom de domaine virtuel .load_balance.com, puis utilisez le langage Go pour ouvrir quatre services d'écoute de port http Voici le programme Go écoutant sur le port 3001. Les autres ports n'ont qu'à être modifiés : package main

import (

"net/http"

"os"

"strings"

)

func main() {

http.HandleFunc("/buy/ticket", handleReq)

http.ListenAndServe(":3001", nil)

}

//处理请求函数,根据请求将响应结果信息写入日志

func handleReq(w http.ResponseWriter, r *http.Request) {

failedMsg := "handle in port:"

writeLog(failedMsg, "./stat.log")

}

//写入日志

func writeLog(msg string, logPath string) {

fd, _ := os.OpenFile(logPath, os.O_RDWR|os.O_CREATE|os.O_APPEND, 0644)

defer fd.Close()

content := strings.Join([]string{msg, "\r\n"}, "3001")

buf := []byte(content)

fd.Write(buf)

}Le port que je vais. request Les informations du journal sont écrites dans le fichier ./stat.log, puis l'outil de test de stress ab est utilisé pour les tests de stress : ab -n 1000 -c 100 http://www.load_balance.com/buy/ticketLes résultats dans le journal statistique montrent que les ports 3001-3004 ont reçu 100, 200, 300, et 400 requêtes respectivement. Cela correspond bien au rapport de poids que j'ai configuré dans nginx, et le trafic après chargement est très uniforme et aléatoire. Pour une implémentation spécifique, vous pouvez vous référer au code source d'implémentation du module upsteam de nginx. Voici un article recommandé : Équilibrage de charge du mécanisme en amont dans Nginx

2 Sélection du système de vente Flash

Retour aux questions que nous avons mentionnées à l'origine : Comment. Le système de vente flash de billets de train fournit-il des services normaux et stables dans des conditions de concurrence élevée ?

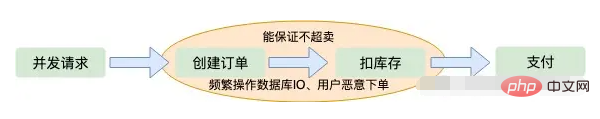

D'après l'introduction ci-dessus, nous savons que le trafic des ventes flash des utilisateurs est réparti uniformément sur différents serveurs via des couches d'équilibrage de charge. Néanmoins, le QPS supporté par une seule machine du cluster est également très élevé. Comment optimiser à l’extrême les performances autonomes ? Pour résoudre ce problème, nous devons comprendre une chose :Habituellement, le système de réservation de billets doit traiter trois étapes de base : la génération des commandes, la réduction des stocks et le paiement des utilisateurs. Ce que notre système doit faire, c'est garantir que les commandes de billets de train ne sont pas survendues ou sous-vendues. Chaque billet vendu doit être payé. Pour être efficace, le système doit résister à une concurrence extrêmement élevée. Comment modifier l'ordre de ces trois étapes pour être plus raisonnable ? Analysons-le :

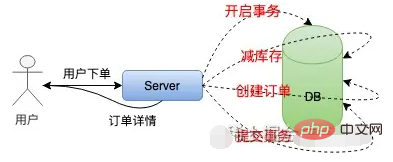

2.1 Passer une commande pour réduire l'inventaire

Lorsque la demande simultanée de l'utilisateur atteint le serveur, la commande est d'abord créée, puis l'inventaire est déduit et attend que l'utilisateur paie. Cette commande est la première solution à laquelle la plupart d'entre nous penseront. Dans ce cas, elle peut également garantir que la commande ne sera pas survendue, car les stocks seront réduits après la création de la commande, ce qui est une opération atomique. Cependant, cela posera également certains problèmes. Le premier est que dans des conditions de concurrence extrêmes, les détails de toute opération de mémoire affecteront considérablement les performances, en particulier la logique telle que la création de commandes, qui doivent généralement être stockées dans une base de données sur disque, ce qui exerce une pression. sur la base de données. Il est concevable ; la seconde est que si l'utilisateur passe une commande de manière malveillante et ne passe la commande que sans payer, l'inventaire sera réduit et de nombreuses commandes seront moins vendues, même si le serveur peut limiter l'IP et le nombre. des bons de commande des utilisateurs, ce n'est pas non plus une bonne approche.

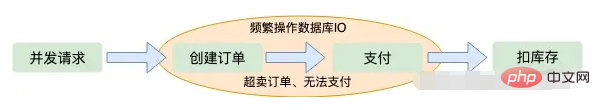

2.2 Réduisez les stocks en payant

Si vous attendez que l'utilisateur paie la commande et réduisez l'inventaire, le premier sentiment est qu'il n'y aura pas moins de ventes. Mais c'est un tabou de l'architecture concurrente, car dans des conditions de concurrence extrêmes, les utilisateurs peuvent créer beaucoup de commandes. Lorsque l'inventaire est réduit à zéro, de nombreux utilisateurs découvrent qu'ils ne peuvent pas payer les commandes qu'ils ont saisies. "survendu" . Le fonctionnement simultané des IO du disque de base de données ne peut être évité

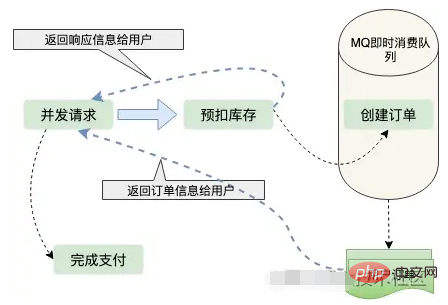

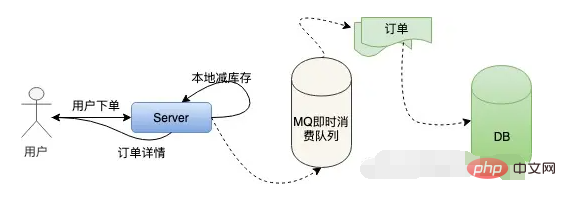

2.3 Retenue d'inventaire

Des considérations des deux solutions ci-dessus, nous pouvons conclure que tant qu'une commande est créée, les IO de base de données doivent être utilisées fréquemment. Existe-t-il donc une solution qui ne nécessite pas le fonctionnement direct des entrées/sorties de la base de données ? Il s'agit de la rétention d'inventaire ? Tout d'abord, l'inventaire est déduit pour garantir qu'il n'est pas survendu, puis les commandes des utilisateurs sont générées de manière asynchrone, de sorte que la réponse aux utilisateurs soit beaucoup plus rapide, alors comment s'assurer qu'il y a beaucoup de ventes ? Que doit faire l’utilisateur s’il ne paie pas après avoir reçu la commande ? Nous savons tous que les commandes ont désormais une période de validité. Par exemple, si l'utilisateur ne paie pas dans les cinq minutes, la commande expirera, un nouvel inventaire sera ajouté. C'est également la solution adoptée par de nombreux détaillants en ligne. entreprises pour s’assurer qu’elles vendent beaucoup de marchandises. Les commandes sont générées de manière asynchrone et sont généralement traitées dans des files d'attente de consommation instantanées telles que MQ et Kafka. Lorsque le volume de commandes est relativement faible, les commandes sont générées très rapidement et les utilisateurs n'ont pratiquement pas à faire la queue.

3. L'art de retenir l'inventaire

D'après l'analyse ci-dessus, il est évident que la solution de la retenue d'inventaire est la plus raisonnable. Analysons plus en détail les détails de la déduction des stocks. Il y a encore beaucoup de place à l'optimisation. Comment garantir une déduction correcte des stocks dans un contexte de concurrence élevée et de réponse rapide aux demandes des utilisateurs ?

En cas de faible concurrence sur une seule machine, notre mise en œuvre de la déduction des stocks est généralement la suivante :

Afin d'assurer l'atomicité de la déduction des stocks et de la génération des commandes, le traitement des transactions doit être utilisé, puis l'inventaire est jugé, l'inventaire est réduit et finalement la transaction est soumise, l'ensemble du processus comporte beaucoup d'E/S et le fonctionnement de la base de données est bloqué. Cette méthode ne convient pas du tout aux systèmes de vente flash à forte concurrence.

Ensuite, nous optimiserons le plan de déduction des stocks d'une seule machine : Déduction des stocks locaux. Nous allouons une certaine quantité d'inventaire à la machine locale, réduisons l'inventaire directement dans la mémoire, puis créons une commande de manière asynchrone selon la logique précédente. Le système autonome amélioré ressemble à ceci :

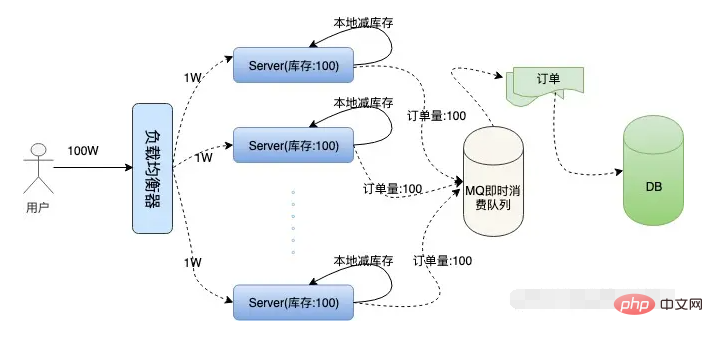

这样就避免了对数据库频繁的IO操作,只在内存中做运算,极大的提高了单机抗并发的能力。但是百万的用户请求量单机是无论如何也抗不住的,虽然nginx处理网络请求使用epoll模型,c10k的问题在业界早已得到了解决。但是linux系统下,一切资源皆文件,网络请求也是这样,大量的文件描述符会使操作系统瞬间失去响应。上面我们提到了nginx的加权均衡策略,我们不妨假设将100W的用户请求量平均均衡到100台服务器上,这样单机所承受的并发量就小了很多。然后我们每台机器本地库存100张火车票,100台服务器上的总库存还是1万,这样保证了库存订单不超卖,下面是我们描述的集群架构:

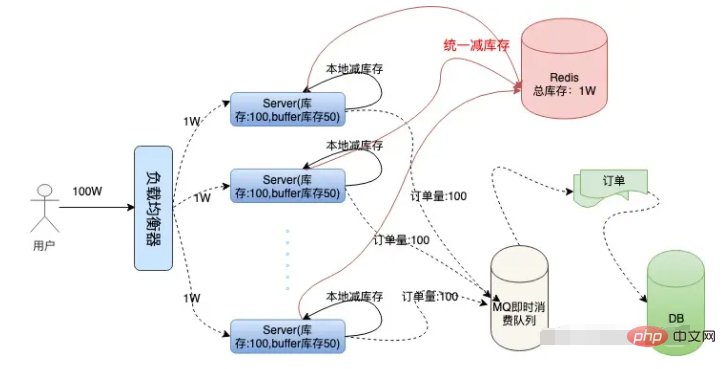

问题接踵而至,在高并发情况下,现在我们还无法保证系统的高可用,假如这100台服务器上有两三台机器因为扛不住并发的流量或者其他的原因宕机了。那么这些服务器上的订单就卖不出去了,这就造成了订单的少卖。要解决这个问题,我们需要对总订单量做统一的管理,这就是接下来的容错方案。服务器不仅要在本地减库存,另外要远程统一减库存。有了远程统一减库存的操作,我们就可以根据机器负载情况,为每台机器分配一些多余的“buffer库存”用来防止机器中有机器宕机的情况。我们结合下面架构图具体分析一下:

我们采用Redis存储统一库存,因为Redis的性能非常高,号称单机QPS能抗10W的并发。在本地减库存以后,如果本地有订单,我们再去请求redis远程减库存,本地减库存和远程减库存都成功了,才返回给用户抢票成功的提示,这样也能有效的保证订单不会超卖。当机器中有机器宕机时,因为每个机器上有预留的buffer余票,所以宕机机器上的余票依然能够在其他机器上得到弥补,保证了不少卖。buffer余票设置多少合适呢,理论上buffer设置的越多,系统容忍宕机的机器数量就越多,但是buffer设置的太大也会对redis造成一定的影响。虽然redis内存数据库抗并发能力非常高,请求依然会走一次网络IO,其实抢票过程中对redis的请求次数是本地库存和buffer库存的总量,因为当本地库存不足时,系统直接返回用户“已售罄”的信息提示,就不会再走统一扣库存的逻辑,这在一定程度上也避免了巨大的网络请求量把redis压跨,所以buffer值设置多少,需要架构师对系统的负载能力做认真的考量。

4. 代码演示

Go语言原生为并发设计,我采用go语言给大家演示一下单机抢票的具体流程。

4.1 初始化工作

go包中的init函数先于main函数执行,在这个阶段主要做一些准备性工作。我们系统需要做的准备工作有:初始化本地库存、初始化远程redis存储统一库存的hash键值、初始化redis连接池;另外还需要初始化一个大小为1的int类型chan,目的是实现分布式锁的功能,也可以直接使用读写锁或者使用redis等其他的方式避免资源竞争,但使用channel更加高效,这就是go语言的哲学:不要通过共享内存来通信,而要通过通信来共享内存。redis库使用的是redigo,下面是代码实现:

...

//localSpike包结构体定义

package localSpike

type LocalSpike struct {

LocalInStock int64

LocalSalesVolume int64

}

...

//remoteSpike对hash结构的定义和redis连接池

package remoteSpike

//远程订单存储健值

type RemoteSpikeKeys struct {

SpikeOrderHashKey string //redis中秒杀订单hash结构key

TotalInventoryKey string //hash结构中总订单库存key

QuantityOfOrderKey string //hash结构中已有订单数量key

}

//初始化redis连接池

func NewPool() *redis.Pool {

return &redis.Pool{

MaxIdle: 10000,

MaxActive: 12000, // max number of connections

Dial: func() (redis.Conn, error) {

c, err := redis.Dial("tcp", ":6379")

if err != nil {

panic(err.Error())

}

return c, err

},

}

}

...

func init() {

localSpike = localSpike2.LocalSpike{

LocalInStock: 150,

LocalSalesVolume: 0,

}

remoteSpike = remoteSpike2.RemoteSpikeKeys{

SpikeOrderHashKey: "ticket_hash_key",

TotalInventoryKey: "ticket_total_nums",

QuantityOfOrderKey: "ticket_sold_nums",

}

redisPool = remoteSpike2.NewPool()

done = make(chan int, 1)

done <- 1

}4.2 本地扣库存和统一扣库存

本地扣库存逻辑非常简单,用户请求过来,添加销量,然后对比销量是否大于本地库存,返回bool值:

package localSpike

//本地扣库存,返回bool值

func (spike *LocalSpike) LocalDeductionStock() bool{

spike.LocalSalesVolume = spike.LocalSalesVolume + 1

return spike.LocalSalesVolume < spike.LocalInStock

}注意这里对共享数据LocalSalesVolume的操作是要使用锁来实现的,但是因为本地扣库存和统一扣库存是一个原子性操作,所以在最上层使用channel来实现,这块后边会讲。统一扣库存操作redis,因为redis是单线程的,而我们要实现从中取数据,写数据并计算一些列步骤,我们要配合lua脚本打包命令,保证操作的原子性:

package remoteSpike

......

const LuaScript = `

local ticket_key = KEYS[1]

local ticket_total_key = ARGV[1]

local ticket_sold_key = ARGV[2]

local ticket_total_nums = tonumber(redis.call('HGET', ticket_key, ticket_total_key))

local ticket_sold_nums = tonumber(redis.call('HGET', ticket_key, ticket_sold_key))

-- 查看是否还有余票,增加订单数量,返回结果值

if(ticket_total_nums >= ticket_sold_nums) then

return redis.call('HINCRBY', ticket_key, ticket_sold_key, 1)

end

return 0

`

//远端统一扣库存

func (RemoteSpikeKeys *RemoteSpikeKeys) RemoteDeductionStock(conn redis.Conn) bool {

lua := redis.NewScript(1, LuaScript)

result, err := redis.Int(lua.Do(conn, RemoteSpikeKeys.SpikeOrderHashKey, RemoteSpikeKeys.TotalInventoryKey, RemoteSpikeKeys.QuantityOfOrderKey))

if err != nil {

return false

}

return result != 0

}我们使用hash结构存储总库存和总销量的信息,用户请求过来时,判断总销量是否大于库存,然后返回相关的bool值。在启动服务之前,我们需要初始化redis的初始库存信息:

hmset ticket_hash_key "ticket_total_nums" 10000 "ticket_sold_nums" 0

4.3 响应用户信息

我们开启一个http服务,监听在一个端口上:

package main

...

func main() {

http.HandleFunc("/buy/ticket", handleReq)

http.ListenAndServe(":3005", nil)

}上面我们做完了所有的初始化工作,接下来handleReq的逻辑非常清晰,判断是否抢票成功,返回给用户信息就可以了。

package main

//处理请求函数,根据请求将响应结果信息写入日志

func handleReq(w http.ResponseWriter, r *http.Request) {

redisConn := redisPool.Get()

LogMsg := ""

<-done

//全局读写锁

if localSpike.LocalDeductionStock() && remoteSpike.RemoteDeductionStock(redisConn) {

util.RespJson(w, 1, "抢票成功", nil)

LogMsg = LogMsg + "result:1,localSales:" + strconv.FormatInt(localSpike.LocalSalesVolume, 10)

} else {

util.RespJson(w, -1, "已售罄", nil)

LogMsg = LogMsg + "result:0,localSales:" + strconv.FormatInt(localSpike.LocalSalesVolume, 10)

}

done <- 1

//将抢票状态写入到log中

writeLog(LogMsg, "./stat.log")

}

func writeLog(msg string, logPath string) {

fd, _ := os.OpenFile(logPath, os.O_RDWR|os.O_CREATE|os.O_APPEND, 0644)

defer fd.Close()

content := strings.Join([]string{msg, "\r\n"}, "")

buf := []byte(content)

fd.Write(buf)

}前边提到我们扣库存时要考虑竞态条件,我们这里是使用channel避免并发的读写,保证了请求的高效顺序执行。我们将接口的返回信息写入到了./stat.log文件方便做压测统计。

4.4 单机服务压测

开启服务,我们使用ab压测工具进行测试:

ab -n 10000 -c 100 http://127.0.0.1:3005/buy/ticket

下面是我本地低配mac的压测信息

This is ApacheBench, Version 2.3 <$Revision: 1826891 $>

Copyright 1996 Adam Twiss, Zeus Technology Ltd, http://www.zeustech.net/

Licensed to The Apache Software Foundation, http://www.apache.org/

Benchmarking 127.0.0.1 (be patient)

Completed 1000 requests

Completed 2000 requests

Completed 3000 requests

Completed 4000 requests

Completed 5000 requests

Completed 6000 requests

Completed 7000 requests

Completed 8000 requests

Completed 9000 requests

Completed 10000 requests

Finished 10000 requests

Server Software:

Server Hostname: 127.0.0.1

Server Port: 3005

Document Path: /buy/ticket

Document Length: 29 bytes

Concurrency Level: 100

Time taken for tests: 2.339 seconds

Complete requests: 10000

Failed requests: 0

Total transferred: 1370000 bytes

HTML transferred: 290000 bytes

Requests per second: 4275.96 [#/sec] (mean)

Time per request: 23.387 [ms] (mean)

Time per request: 0.234 [ms] (mean, across all concurrent requests)

Transfer rate: 572.08 [Kbytes/sec] received

Connection Times (ms)

min mean[+/-sd] median max

Connect: 0 8 14.7 6 223

Processing: 2 15 17.6 11 232

Waiting: 1 11 13.5 8 225

Total: 7 23 22.8 18 239

Percentage of the requests served within a certain time (ms)

50% 18

66% 24

75% 26

80% 28

90% 33

95% 39

98% 45

99% 54

100% 239 (longest request)根据指标显示,我单机每秒就能处理4000+的请求,正常服务器都是多核配置,处理1W+的请求根本没有问题。而且查看日志发现整个服务过程中,请求都很正常,流量均匀,redis也很正常:

//stat.log ... result:1,localSales:145 result:1,localSales:146 result:1,localSales:147 result:1,localSales:148 result:1,localSales:149 result:1,localSales:150 result:0,localSales:151 result:0,localSales:152 result:0,localSales:153 result:0,localSales:154 result:0,localSales:156 ...

5.总结回顾

总体来说,秒杀系统是非常复杂的。我们这里只是简单介绍模拟了一下单机如何优化到高性能,集群如何避免单点故障,保证订单不超卖、不少卖的一些策略,完整的订单系统还有订单进度的查看,每台服务器上都有一个任务,定时的从总库存同步余票和库存信息展示给用户,还有用户在订单有效期内不支付,释放订单,补充到库存等等。

我们实现了高并发抢票的核心逻辑,可以说系统设计的非常的巧妙,巧妙的避开了对DB数据库IO的操作,对Redis网络IO的高并发请求,几乎所有的计算都是在内存中完成的,而且有效的保证了不超卖、不少卖,还能够容忍部分机器的宕机。我觉得其中有两点特别值得学习总结:

负载均衡,分而治之。通过负载均衡,将不同的流量划分到不同的机器上,每台机器处理好自己的请求,将自己的性能发挥到极致,这样系统的整体也就能承受极高的并发了,就像工作的的一个团队,每个人都将自己的价值发挥到了极致,团队成长自然是很大的。

合理的使用并发和异步。自epoll网络架构模型解决了c10k问题以来,异步越来被服务端开发人员所接受,能够用异步来做的工作,就用异步来做,在功能拆解上能达到意想不到的效果,这点在nginx、node.js、redis上都能体现,他们处理网络请求使用的epoll模型,用实践告诉了我们单线程依然可以发挥强大的威力。服务器已经进入了多核时代,go语言这种天生为并发而生的语言,完美的发挥了服务器多核优势,很多可以并发处理的任务都可以使用并发来解决,比如go处理http请求时每个请求都会在一个goroutine中执行,总之:怎样合理的压榨CPU,让其发挥出应有的价值,是我们一直需要探索学习的方向。

原文链接:https://juejin.cn/post/6844903949632274445

Articles Liés

Voir plus- Comment résoudre le problème de la haute simultanéité (ventes flash de produits) en PHP ? Deux solutions partagées

- Comment empêcher la survente de l'inventaire de produits dans des conditions de concurrence élevée en PHP

- Tests PHP à haute concurrence : étude de cas sur la prévention de la survente des stocks

- Discussion approfondie sur les solutions et solutions pour l'accès « à haute concurrence et à trafic important »