Maison >Problème commun >Introduction aux bases des algorithmes de réseaux neuronaux

Introduction aux bases des algorithmes de réseaux neuronaux

- 王林original

- 2019-09-23 18:00:402073parcourir

La technologie la plus en vogue à l’heure actuelle est sans aucun doute l’intelligence artificielle.

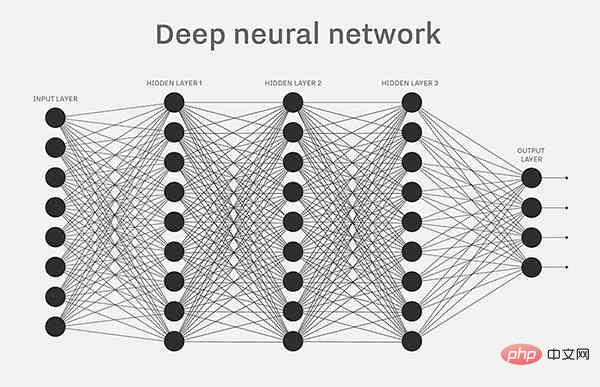

Le modèle sous-jacent de l’intelligence artificielle est le « réseau neuronal ». De nombreuses applications complexes (telles que la reconnaissance de formes, le contrôle automatique) et des modèles avancés (tels que le deep learning) sont basés sur ce modèle. L’apprentissage de l’intelligence artificielle doit commencer par cela.

1. Perceptron

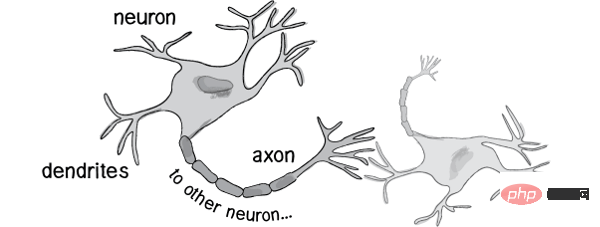

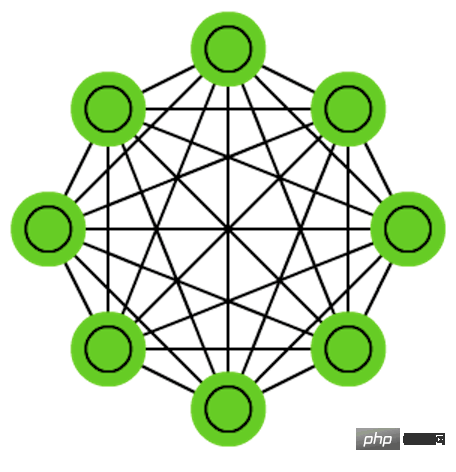

Historiquement, les scientifiques ont toujours espéré simuler le cerveau humain et créer quelque chose qui puisse penser. . machine. Pourquoi les gens peuvent-ils penser ? Les scientifiques ont découvert que la raison réside dans le réseau neuronal du corps.

1. La stimulation externe est convertie en signaux électriques via les terminaisons nerveuses et transduite vers les cellules nerveuses (également appelées neurones).

2. D'innombrables neurones constituent le centre nerveux.

3. Le centre nerveux synthétise divers signaux et émet des jugements.

4. Le corps humain répond aux stimuli externes selon les instructions du centre nerveux.

2. Poids et seuils

En voyant cela, vous vous demanderez certainement : si certains facteurs sont établis et d'autres ne sont pas établis, quel est le résultat ? Par exemple, il fait beau le week-end et les billets ne sont pas chers, mais Xiao Ming ne trouve pas de compagnon. Doit-il quand même aller lui rendre visite ?

En réalité, les facteurs ont rarement la même importance : certains sont déterminants, d'autres secondaires. Par conséquent, ces facteurs peuvent se voir attribuer des pondérations, représentant leur importance différente.

Météo : le poids est de 8

Compagnon : le poids est de 4

Prix : le poids est de 4

Le poids ci-dessus indique que la météo est le facteur décisif, le compagnon et le prix sont des facteurs secondaires.

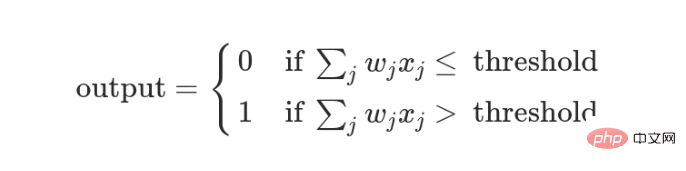

Si les trois facteurs valent 1, leur somme multipliée par les poids est 8 + 4 + 4 = 16. Si les facteurs météo et prix sont 1 et que le facteur compagnon est 0, le total devient 8 + 0 + 4 = 12. A ce stade, vous devez également spécifier un seuil (seuil). Si la somme est supérieure au seuil, le perceptron renvoie 1, sinon il renvoie 0. Supposons que le seuil soit 8, puis 12 > 8, Xiao Ming décide de lui rendre visite. Le niveau du seuil représente la force de la volonté. Plus le seuil est bas, plus vous avez envie d’y aller. Plus le seuil est élevé, moins vous avez envie d’y aller.

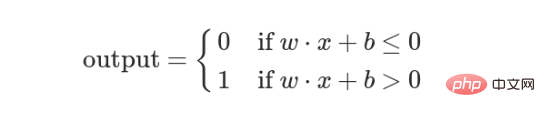

Le processus décisionnel ci-dessus s’exprime mathématiquement comme suit.

3. Modèle de prise de décision

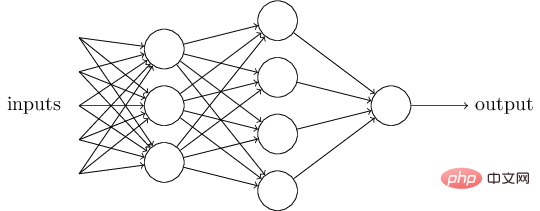

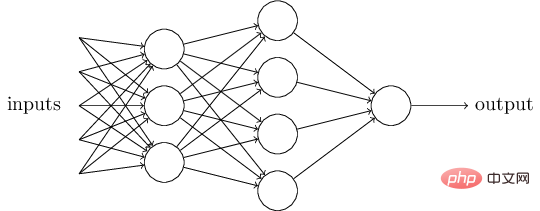

Un seul perceptron constitue un modèle de prise de décision simple, prêt à l'emploi. Dans le monde réel, le modèle de prise de décision réel est beaucoup plus complexe et constitue un réseau multicouche composé de plusieurs perceptrons.

Dans la figure ci-dessus, le perceptron de la couche inférieure reçoit une entrée externe, émet un jugement, puis envoie un signal comme entrée du perceptron de la couche supérieure jusqu'à ce que le résultat final soit obtenu. (Remarque : il n'y a toujours qu'une seule sortie du perceptron, mais elle peut être envoyée à plusieurs cibles.)

Dans cette image, les signaux sont unidirectionnels, c'est-à-dire la sortie du perceptron de la couche inférieure. est toujours la sortie du perceptron de la couche supérieure. En réalité, une transmission cyclique peut se produire, c'est-à-dire que A est transmis à B, B est transmis à C et C est transmis à A. C'est ce qu'on appelle un « réseau neuronal récurrent »

4. Vectorisation

Afin de faciliter la discussion ultérieure, certains traitements mathématiques doivent être effectués sur le modèle ci-dessus.

Les facteurs externes x1, x2, x3 s'écrivent sous forme de vecteurs

Les poids w1, w2, w3 s'écrivent également sous forme de vecteurs (w1, w2 , w3), L'abréviation est w

Définir l'opération w⋅x = ∑ wx, c'est-à-dire l'opération ponctuelle de w et x, qui est égale à la somme des produits de facteurs et de poids

Définir b égal au seuil négatif b = -seuil

Le modèle perceptron devient le suivant.

5. Le processus de fonctionnement du réseau neuronal

Pour construire un réseau neuronal, trois conditions doivent être remplies.

1. Entrée et sortie

2. Poids (w) et seuil (b)

3 La structure du perceptron multicouche

Cela. c'est dire, vous devez dessiner à l'avance l'image qui apparaît ci-dessus

Parmi eux, le plus difficile est de déterminer le poids (w) et le seuil (b). Jusqu'à présent, ces deux valeurs ont été données subjectivement, mais en réalité il est difficile d'estimer leurs valeurs, et il doit y avoir un moyen de trouver la réponse.

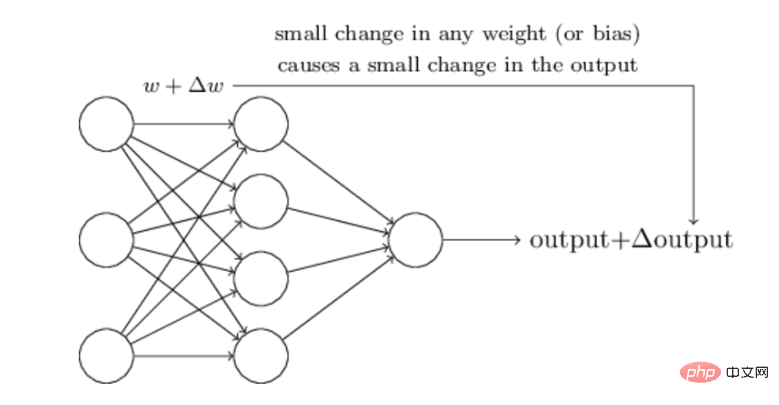

Cette méthode est un essai et une erreur. En gardant les autres paramètres inchangés, de petites modifications de w (ou b) sont enregistrées sous la forme Δw (ou Δb), puis observez les modifications dans la sortie. Répétez ce processus jusqu'à ce que nous obtenions l'ensemble de w et b qui correspond à la sortie la plus précise, qui est la valeur souhaitée. Ce processus est appelé formation de modèle.

Ainsi, le réseau neuronal fonctionne comme suit.

1. Déterminez l'entrée et la sortie

2. Trouvez un ou plusieurs algorithmes qui peuvent obtenir la sortie de l'entrée

3. réponses L'ensemble de données est utilisé pour entraîner le modèle et estimer w et b

4 Une fois les nouvelles données générées et entrées dans le modèle, les résultats peuvent être obtenus, et w et b sont corrigés en même temps. temps

6. Continuité de sortie

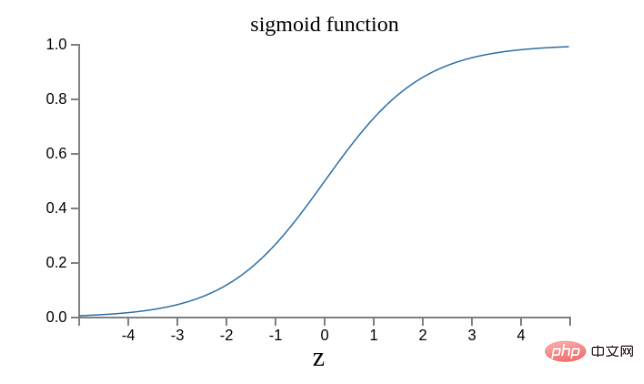

Le modèle ci-dessus a un problème non résolu Selon l'hypothèse, la sortie n'a que deux résultats : 0 et 1. Cependant, le modèle nécessite de petits changements dans w ou b, ce qui entraînera des changements dans la sortie. Si vous ne produisez que 0 et 1, cela serait trop insensible et la précision de l'entraînement ne peut être garantie. Par conséquent, la "sortie" doit être transformée en fonction continue. Cela nécessite une petite modification mathématique simple.

Tout d’abord, enregistrez le résultat du calcul du perceptron wx + b sous la forme z.

z = wx + b

Ensuite, calculez la formule suivante et enregistrez le résultat sous la forme σ(z).

σ(z) = 1 / (1 + e^(-z))

C'est parce que si z va vers l'infini positif z → +∞ (indiquant une forte correspondance de perceptron ), alors σ(z) → 1 ; si z tend vers l'infini négatif z → -∞ (indiquant une forte disparité de perceptron), alors σ(z) → 0. En d’autres termes, tant que σ(z) est utilisé comme résultat de sortie, la sortie deviendra une fonction de continuité.

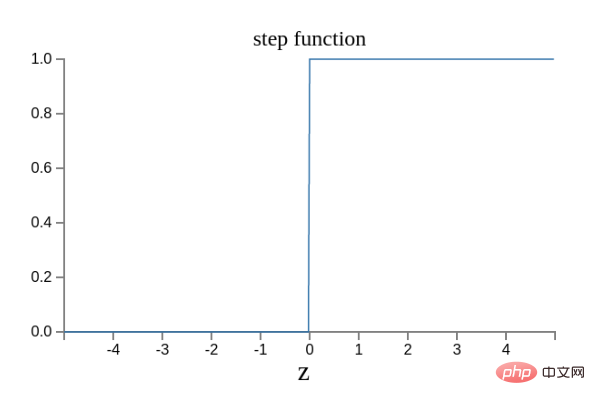

La courbe de sortie originale est la suivante.

Voici maintenant :

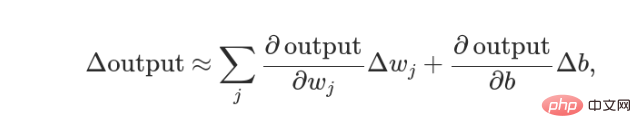

En fait, on peut aussi prouver que Δσ satisfait la formule suivante.

C'est-à-dire qu'il existe une relation linéaire entre Δσ, Δw et Δb, et le taux de changement est une dérivée partielle. Ceci est utile pour calculer avec précision les valeurs de w et b.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!