Le contrôle de flux asynchrone Node.js expliqué en détail

Quand on n'a pas une expérience approfondie de l'utilisation des rappels de fonctions, il est quand même un peu difficile de lire ces contenus. En raison des caractéristiques asynchrones uniques de Node.js, le problème de « l'enfer des rappels » est apparu. Dans cet article, j'ai enregistré plus en détail comment résoudre le problème du flux asynchrone. Cet article présente principalement une brève discussion sur le contrôle de flux asynchrone dans Node.js. L'éditeur pense que c'est assez bon, je vais donc le partager avec vous maintenant et le donner comme référence. Suivons l'éditeur et jetons un œil. J'espère que cela pourra aider tout le monde.

L'article sera long, et cet article est une explication du mode streaming asynchrone. Cet article utilisera un exemple simple d'araignée Web. Sa fonction est d'explorer le contenu de la page Web de l'URL spécifiée et de l'enregistrer dans le projet. À la fin de l'article, vous pouvez trouver la démo du code source de l'article entier.

1. Mode JavaScript natif

Cet article n'est pas destiné aux débutants, la plupart du contenu de base sera donc omis :

(spider_v1 .js )

const request = require("request");

const fs = require("fs");

const mkdirp = require("mkdirp");

const path = require("path");

const utilities = require("./utilities");

function spider(url, callback) {

const filename = utilities.urlToFilename(url);

console.log(`filename: ${filename}`);

fs.exists(filename, exists => {

if (!exists) {

console.log(`Downloading ${url}`);

request(url, (err, response, body) => {

if (err) {

callback(err);

} else {

mkdirp(path.dirname(filename), err => {

if (err) {

callback(err);

} else {

fs.writeFile(filename, body, err => {

if (err) {

callback(err);

} else {

callback(null, filename, true);

}

});

}

});

}

});

} else {

callback(null, filename, false);

}

});

}

spider(process.argv[2], (err, filename, downloaded) => {

if (err) {

console.log(err);

} else if (downloaded) {

console.log(`Completed the download of ${filename}`);

} else {

console.log(`${filename} was already downloaded`);

}

});Le processus du code ci-dessus ressemble à ceci :

Convertir l'URL en nom de fichier

Déterminez si le nom du fichier existe, et revenez directement s'il existe, sinon passez à l'étape suivante

-

Envoyez une demande et récupérez le corps

Écrivez le corps dans le fichier

Il s'agit d'une version très simple de l'araignée. Elle ne peut explorer que le contenu d'une URL. le rappel ci-dessus est. Les gens ont des maux de tête. Ensuite, nous commençons à optimiser.

Tout d'abord, la méthode if else peut être optimisée. C'est très simple. Inutile de dire que voici un effet de comparaison :

/// before

if (err) {

callback(err);

} else {

callback(null, filename, true);

}

/// after

if (err) {

return callback(err);

}

callback(null, filename, true);Le code est le suivant En écriture, il y aura une couche d'imbrication en moins, mais les programmeurs expérimentés penseront qu'écrire de cette façon met trop l'accent sur les erreurs. Notre programmation devrait se concentrer sur le traitement des données correctes, et il existe également une telle méthode. exigence de lisibilité. Une autre optimisation est le fractionnement des fonctions. Dans la fonction araignée du code ci-dessus, le fichier téléchargé et le fichier enregistré peuvent être divisés. (spider_v2.js)

const request = require("request");

const fs = require("fs");

const mkdirp = require("mkdirp");

const path = require("path");

const utilities = require("./utilities");

function saveFile(filename, contents, callback) {

mkdirp(path.dirname(filename), err => {

if (err) {

return callback(err);

}

fs.writeFile(filename, contents, callback);

});

}

function download(url, filename, callback) {

console.log(`Downloading ${url}`);

request(url, (err, response, body) => {

if (err) {

return callback(err);

}

saveFile(filename, body, err => {

if (err) {

return callback(err);

}

console.log(`Downloaded and saved: ${url}`);

callback(null, body);

});

})

}

function spider(url, callback) {

const filename = utilities.urlToFilename(url);

console.log(`filename: ${filename}`);

fs.exists(filename, exists => {

if (exists) {

return callback(null, filename, false);

}

download(url, filename, err => {

if (err) {

return callback(err);

}

callback(null, filename, true);

})

});

}

spider(process.argv[2], (err, filename, downloaded) => {

if (err) {

console.log(err);

} else if (downloaded) {

console.log(`Completed the download of ${filename}`);

} else {

console.log(`${filename} was already downloaded`);

}

});Le code ci-dessus est essentiellement le résultat d'une optimisation native, mais la fonction de cette araignée est trop simple, nous devons maintenant explorer toutes les URL d'une certaine page Web, ce qui entraînera des problèmes en série et en parallèle. (spider_v3.js)

const request = require("request");

const fs = require("fs");

const mkdirp = require("mkdirp");

const path = require("path");

const utilities = require("./utilities");

function saveFile(filename, contents, callback) {

mkdirp(path.dirname(filename), err => {

if (err) {

return callback(err);

}

fs.writeFile(filename, contents, callback);

});

}

function download(url, filename, callback) {

console.log(`Downloading ${url}`);

request(url, (err, response, body) => {

if (err) {

return callback(err);

}

saveFile(filename, body, err => {

if (err) {

return callback(err);

}

console.log(`Downloaded and saved: ${url}`);

callback(null, body);

});

})

}

/// 最大的启发是实现了如何异步循环遍历数组

function spiderLinks(currentUrl, body, nesting, callback) {

if (nesting === 0) {

return process.nextTick(callback);

}

const links = utilities.getPageLinks(currentUrl, body);

function iterate(index) {

if (index === links.length) {

return callback();

}

spider(links[index], nesting - 1, err => {

if (err) {

return callback(err);

}

iterate((index + 1));

})

}

iterate(0);

}

function spider(url, nesting, callback) {

const filename = utilities.urlToFilename(url);

fs.readFile(filename, "utf8", (err, body) => {

if (err) {

if (err.code !== 'ENOENT') {

return callback(err);

}

return download(url, filename, (err, body) => {

if (err) {

return callback(err);

}

spiderLinks(url, body, nesting, callback);

});

}

spiderLinks(url, body, nesting, callback);

});

}

spider(process.argv[2], 2, (err, filename, downloaded) => {

if (err) {

console.log(err);

} else if (downloaded) {

console.log(`Completed the download of ${filename}`);

} else {

console.log(`${filename} was already downloaded`);

}

});Le code ci-dessus a deux fonctions principales de plus que le code précédent. La première est de l'obtenir via le. classe auxiliaire Lorsqu'il s'agit de liens dans un certain corps :

const links = utilities.getPageLinks(currentUrl, body);L'implémentation interne ne sera pas expliquée. L'autre code de base est : .

/// 最大的启发是实现了如何异步循环遍历数组

function spiderLinks(currentUrl, body, nesting, callback) {

if (nesting === 0) {

return process.nextTick(callback);

}

const links = utilities.getPageLinks(currentUrl, body);

function iterate(index) {

if (index === links.length) {

return callback();

}

spider(links[index], nesting - 1, err => {

if (err) {

return callback(err);

}

iterate((index + 1));

})

}

iterate(0);

}On peut dire que le petit morceau de code ci-dessus est un modèle natif pour implémenter la sérialisation asynchrone. En plus de cela, le concept d'imbrication est également introduit. Grâce à cet attribut, le niveau d'exploration peut être contrôlé. À ce stade, nous avons complètement implémenté la fonction série. Compte tenu des performances, nous devons développer la fonction d'exploration parallèle. (spider_v4.js)

const request = require("request");

const fs = require("fs");

const mkdirp = require("mkdirp");

const path = require("path");

const utilities = require("./utilities");

function saveFile(filename, contents, callback) {

mkdirp(path.dirname(filename), err => {

if (err) {

return callback(err);

}

fs.writeFile(filename, contents, callback);

});

}

function download(url, filename, callback) {

console.log(`Downloading ${url}`);

request(url, (err, response, body) => {

if (err) {

return callback(err);

}

saveFile(filename, body, err => {

if (err) {

return callback(err);

}

console.log(`Downloaded and saved: ${url}`);

callback(null, body);

});

})

}

/// 最大的启发是实现了如何异步循环遍历数组

function spiderLinks(currentUrl, body, nesting, callback) {

if (nesting === 0) {

return process.nextTick(callback);

}

const links = utilities.getPageLinks(currentUrl, body);

if (links.length === 0) {

return process.nextTick(callback);

}

let completed = 0, hasErrors = false;

function done(err) {

if (err) {

hasErrors = true;

return callback(err);

}

if (++completed === links.length && !hasErrors) {

return callback();

}

}

links.forEach(link => {

spider(link, nesting - 1, done);

});

}

const spidering = new Map();

function spider(url, nesting, callback) {

if (spidering.has(url)) {

return process.nextTick(callback);

}

spidering.set(url, true);

const filename = utilities.urlToFilename(url);

/// In this pattern, there will be some issues.

/// Possible problems to download the same url again and again。

fs.readFile(filename, "utf8", (err, body) => {

if (err) {

if (err.code !== 'ENOENT') {

return callback(err);

}

return download(url, filename, (err, body) => {

if (err) {

return callback(err);

}

spiderLinks(url, body, nesting, callback);

});

}

spiderLinks(url, body, nesting, callback);

});

}

spider(process.argv[2], 2, (err, filename, downloaded) => {

if (err) {

console.log(err);

} else if (downloaded) {

console.log(`Completed the download of ${filename}`);

} else {

console.log(`${filename} was already downloaded`);

}

});Ce code est également très simple et a deux contenus principaux. La première est de savoir comment implémenter la concurrence :

/// 最大的启发是实现了如何异步循环遍历数组

function spiderLinks(currentUrl, body, nesting, callback) {

if (nesting === 0) {

return process.nextTick(callback);

}

const links = utilities.getPageLinks(currentUrl, body);

if (links.length === 0) {

return process.nextTick(callback);

}

let completed = 0, hasErrors = false;

function done(err) {

if (err) {

hasErrors = true;

return callback(err);

}

if (++completed === links.length && !hasErrors) {

return callback();

}

}

links.forEach(link => {

spider(link, nesting - 1, done);

});

}Le code ci-dessus peut être considéré comme un modèle pour atteindre la concurrence. Ceci est réalisé en utilisant le parcours de boucle. Un autre élément essentiel est que, comme il est simultané, il y aura des problèmes lors de l'utilisation de fs.exists et le même fichier peut être téléchargé à plusieurs reprises. La solution ici est : - Utiliser Map To. mettre en cache une certaine URL, l'URL doit être utilisée comme clé

class TaskQueue {

constructor(concurrency) {

this.concurrency = concurrency;

this.running = 0;

this.queue = [];

}

pushTask(task) {

this.queue.push(task);

this.next();

}

next() {

while (this.running < this.concurrency && this.queue.length) {

const task = this.queue.shift();

task(() => {

this.running--;

this.next();

});

this.running++;

}

}

}

module.exports = TaskQueue;Le code ci-dessus est le code d'implémentation de la file d'attente. Le noyau est la méthode next(). , comme vous pouvez le voir, lorsque la tâche est ajoutée à la file d'attente, elle sera exécutée immédiatement. Cela ne signifie pas que la tâche doit être exécutée immédiatement, mais cela signifie que next sera appelé immédiatement. (spider_v5.js)

const request = require("request");

const fs = require("fs");

const mkdirp = require("mkdirp");

const path = require("path");

const utilities = require("./utilities");

const TaskQueue = require("./task-Queue");

const downloadQueue = new TaskQueue(2);

function saveFile(filename, contents, callback) {

mkdirp(path.dirname(filename), err => {

if (err) {

return callback(err);

}

fs.writeFile(filename, contents, callback);

});

}

function download(url, filename, callback) {

console.log(`Downloading ${url}`);

request(url, (err, response, body) => {

if (err) {

return callback(err);

}

saveFile(filename, body, err => {

if (err) {

return callback(err);

}

console.log(`Downloaded and saved: ${url}`);

callback(null, body);

});

})

}

/// 最大的启发是实现了如何异步循环遍历数组

function spiderLinks(currentUrl, body, nesting, callback) {

if (nesting === 0) {

return process.nextTick(callback);

}

const links = utilities.getPageLinks(currentUrl, body);

if (links.length === 0) {

return process.nextTick(callback);

}

let completed = 0, hasErrors = false;

links.forEach(link => {

/// 给队列出传递一个任务,这个任务首先是一个函数,其次该函数接受一个参数

/// 当调用任务时,触发该函数,然后给函数传递一个参数,告诉该函数在任务结束时干什么

downloadQueue.pushTask(done => {

spider(link, nesting - 1, err => {

/// 这里表示,只要发生错误,队列就会退出

if (err) {

hasErrors = true;

return callback(err);

}

if (++completed === links.length && !hasErrors) {

callback();

}

done();

});

});

});

}

const spidering = new Map();

function spider(url, nesting, callback) {

if (spidering.has(url)) {

return process.nextTick(callback);

}

spidering.set(url, true);

const filename = utilities.urlToFilename(url);

/// In this pattern, there will be some issues.

/// Possible problems to download the same url again and again。

fs.readFile(filename, "utf8", (err, body) => {

if (err) {

if (err.code !== 'ENOENT') {

return callback(err);

}

return download(url, filename, (err, body) => {

if (err) {

return callback(err);

}

spiderLinks(url, body, nesting, callback);

});

}

spiderLinks(url, body, nesting, callback);

});

}

spider(process.argv[2], 2, (err, filename, downloaded) => {

if (err) {

console.log(`error: ${err}`);

} else if (downloaded) {

console.log(`Completed the download of ${filename}`);

} else {

console.log(`${filename} was already downloaded`);

}

}); Par conséquent, afin de limiter le nombre de concurrence, mettez simplement le parcours des tâches dans la méthode spiderLinks La file d'attente fera l'affaire. C'est relativement simple. Jusqu'à présent, nous avons utilisé JavaScript natif pour implémenter un web spider avec des fonctions relativement complètes, qui peuvent être à la fois série et simultanées, et peuvent également contrôler le nombre de concurrences.

2. Utilisez la bibliothèque asynchrone

Mettre différentes fonctions dans différentes fonctions nous apportera d'énormes avantages La bibliothèque asynchrone est très populaire et ses performances sont également bonnes, il est basé sur le rappel en interne. (spider_v6.js)const request = require("request");

const fs = require("fs");

const mkdirp = require("mkdirp");

const path = require("path");

const utilities = require("./utilities");

const series = require("async/series");

const eachSeries = require("async/eachSeries");

function download(url, filename, callback) {

console.log(`Downloading ${url}`);

let body;

series([

callback => {

request(url, (err, response, resBody) => {

if (err) {

return callback(err);

}

body = resBody;

callback();

});

},

mkdirp.bind(null, path.dirname(filename)),

callback => {

fs.writeFile(filename, body, callback);

}

], err => {

if (err) {

return callback(err);

}

console.log(`Downloaded and saved: ${url}`);

callback(null, body);

});

}

/// 最大的启发是实现了如何异步循环遍历数组

function spiderLinks(currentUrl, body, nesting, callback) {

if (nesting === 0) {

return process.nextTick(callback);

}

const links = utilities.getPageLinks(currentUrl, body);

if (links.length === 0) {

return process.nextTick(callback);

}

eachSeries(links, (link, cb) => {

"use strict";

spider(link, nesting - 1, cb);

}, callback);

}

const spidering = new Map();

function spider(url, nesting, callback) {

if (spidering.has(url)) {

return process.nextTick(callback);

}

spidering.set(url, true);

const filename = utilities.urlToFilename(url);

fs.readFile(filename, "utf8", (err, body) => {

if (err) {

if (err.code !== 'ENOENT') {

return callback(err);

}

return download(url, filename, (err, body) => {

if (err) {

return callback(err);

}

spiderLinks(url, body, nesting, callback);

});

}

spiderLinks(url, body, nesting, callback);

});

}

spider(process.argv[2], 1, (err, filename, downloaded) => {

if (err) {

console.log(err);

} else if (downloaded) {

console.log(`Completed the download of ${filename}`);

} else {

console.log(`${filename} was already downloaded`);

}

});Dans le code ci-dessus, nous n'utilisons que trois fonctions async :

const series = require("async/series"); // 串行

const eachSeries = require("async/eachSeries"); // 并行

const queue = require("async/queue"); // 队列Comme c'est relativement simple, je ne l'expliquerai pas. Le code de la file d'attente en asynchrone se trouve dans (spider_v7.js), qui est très similaire à notre file d'attente personnalisée ci-dessus, et je ne l'expliquerai pas davantage.

3.Promise

Promise est un protocole Il existe de nombreuses bibliothèques qui implémentent ce protocole. Nous utilisons l'implémentation ES6. En termes simples, une promesse est un accord. Si elle est terminée, sa méthode de résolution est appelée. Si elle échoue, sa méthode de rejet est appelée. Il implémente la méthode then, puis renvoie la promesse elle-même, formant ainsi une chaîne d'appels.其实Promise的内容有很多,在实际应用中是如何把普通的函数promise化。这方面的内容在这里也不讲了,我自己也不够格

(spider_v8.js)

const utilities = require("./utilities");

const request = utilities.promisify(require("request"));

const fs = require("fs");

const readFile = utilities.promisify(fs.readFile);

const writeFile = utilities.promisify(fs.writeFile);

const mkdirp = utilities.promisify(require("mkdirp"));

const path = require("path");

function saveFile(filename, contents, callback) {

mkdirp(path.dirname(filename), err => {

if (err) {

return callback(err);

}

fs.writeFile(filename, contents, callback);

});

}

function download(url, filename) {

console.log(`Downloading ${url}`);

let body;

return request(url)

.then(response => {

"use strict";

body = response.body;

return mkdirp(path.dirname(filename));

})

.then(() => writeFile(filename, body))

.then(() => {

"use strict";

console.log(`Downloaded adn saved: ${url}`);

return body;

});

}

/// promise编程的本质就是为了解决在函数中设置回调函数的问题

/// 通过中间层promise来实现异步函数同步化

function spiderLinks(currentUrl, body, nesting) {

let promise = Promise.resolve();

if (nesting === 0) {

return promise;

}

const links = utilities.getPageLinks(currentUrl, body);

links.forEach(link => {

"use strict";

promise = promise.then(() => spider(link, nesting - 1));

});

return promise;

}

function spider(url, nesting) {

const filename = utilities.urlToFilename(url);

return readFile(filename, "utf8")

.then(

body => spiderLinks(url, body, nesting),

err => {

"use strict";

if (err.code !== 'ENOENT') {

/// 抛出错误,这个方便与在整个异步链的最后通过呢catch来捕获这个链中的错误

throw err;

}

return download(url, filename)

.then(body => spiderLinks(url, body, nesting));

}

);

}

spider(process.argv[2], 1)

.then(() => {

"use strict";

console.log('Download complete');

})

.catch(err => {

"use strict";

console.log(err);

});可以看到上边的代码中的函数都是没有callback的,只需要在最后catch就可以了。

在设计api的时候,应该支持两种方式,及支持callback,又支持promise

function asyncpision(pidend, pisor, cb) {

return new Promise((resolve, reject) => {

"use strict";

process.nextTick(() => {

const result = pidend / pisor;

if (isNaN(result) || !Number.isFinite(result)) {

const error = new Error("Invalid operands");

if (cb) {

cb(error);

}

return reject(error);

}

if (cb) {

cb(null, result);

}

resolve(result);

});

});

}

asyncpision(10, 2, (err, result) => {

"use strict";

if (err) {

return console.log(err);

}

console.log(result);

});

asyncpision(22, 11)

.then((result) => console.log(result))

.catch((err) => console.log(err));4.Generator

Generator很有意思,他可以让暂停函数和恢复函数,利用thunkify和co这两个库,我们下边的代码实现起来非常酷。

(spider_v9.js)

const thunkify = require("thunkify");

const co = require("co");

const path = require("path");

const utilities = require("./utilities");

const request = thunkify(require("request"));

const fs = require("fs");

const mkdirp = thunkify(require("mkdirp"));

const readFile = thunkify(fs.readFile);

const writeFile = thunkify(fs.writeFile);

const nextTick = thunkify(process.nextTick);

function* download(url, filename) {

console.log(`Downloading ${url}`);

const response = yield request(url);

console.log(response);

const body = response[1];

yield mkdirp(path.dirname(filename));

yield writeFile(filename, body);

console.log(`Downloaded and saved ${url}`);

return body;

}

function* spider(url, nesting) {

const filename = utilities.urlToFilename(url);

let body;

try {

body = yield readFile(filename, "utf8");

} catch (err) {

if (err.code !== 'ENOENT') {

throw err;

}

body = yield download(url, filename);

}

yield spiderLinks(url, body, nesting);

}

function* spiderLinks(currentUrl, body, nesting) {

if (nesting === 0) {

return nextTick();

}

const links = utilities.getPageLinks(currentUrl, body);

for (let i = 0; i < links.length; i++) {

yield spider(links[i], nesting - 1);

}

}

/// 通过co就自动处理了回调函数,直接返回了回调函数中的参数,把这些参数放到一个数组中,但是去掉了err信息

co(function* () {

try {

yield spider(process.argv[2], 1);

console.log('Download complete');

} catch (err) {

console.log(err);

}

});总结

我并没有写promise和generator并发的代码。以上这些内容来自于这本书nodejs-design-patterns 。

相关推荐:

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

De C / C à JavaScript: comment tout cela fonctionneApr 14, 2025 am 12:05 AM

De C / C à JavaScript: comment tout cela fonctionneApr 14, 2025 am 12:05 AMLe passage de C / C à JavaScript nécessite de s'adapter à la frappe dynamique, à la collecte des ordures et à la programmation asynchrone. 1) C / C est un langage dactylographié statiquement qui nécessite une gestion manuelle de la mémoire, tandis que JavaScript est dynamiquement typé et que la collecte des déchets est automatiquement traitée. 2) C / C doit être compilé en code machine, tandis que JavaScript est une langue interprétée. 3) JavaScript introduit des concepts tels que les fermetures, les chaînes de prototypes et la promesse, ce qui améliore la flexibilité et les capacités de programmation asynchrones.

Moteurs JavaScript: comparaison des implémentationsApr 13, 2025 am 12:05 AM

Moteurs JavaScript: comparaison des implémentationsApr 13, 2025 am 12:05 AMDifférents moteurs JavaScript ont des effets différents lors de l'analyse et de l'exécution du code JavaScript, car les principes d'implémentation et les stratégies d'optimisation de chaque moteur diffèrent. 1. Analyse lexicale: convertir le code source en unité lexicale. 2. Analyse de la grammaire: générer un arbre de syntaxe abstrait. 3. Optimisation et compilation: générer du code machine via le compilateur JIT. 4. Exécuter: Exécutez le code machine. Le moteur V8 optimise grâce à une compilation instantanée et à une classe cachée, SpiderMonkey utilise un système d'inférence de type, résultant en différentes performances de performances sur le même code.

Au-delà du navigateur: Javascript dans le monde réelApr 12, 2025 am 12:06 AM

Au-delà du navigateur: Javascript dans le monde réelApr 12, 2025 am 12:06 AMLes applications de JavaScript dans le monde réel incluent la programmation côté serveur, le développement des applications mobiles et le contrôle de l'Internet des objets: 1. La programmation côté serveur est réalisée via Node.js, adaptée au traitement de demande élevé simultané. 2. Le développement d'applications mobiles est effectué par le reactnatif et prend en charge le déploiement multiplateforme. 3. Utilisé pour le contrôle des périphériques IoT via la bibliothèque Johnny-Five, adapté à l'interaction matérielle.

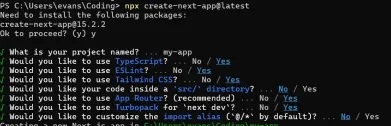

Construire une application SaaS multi-locataire avec next.js (intégration backend)Apr 11, 2025 am 08:23 AM

Construire une application SaaS multi-locataire avec next.js (intégration backend)Apr 11, 2025 am 08:23 AMJ'ai construit une application SAAS multi-locataire fonctionnelle (une application EdTech) avec votre outil technologique quotidien et vous pouvez faire de même. Premièrement, qu'est-ce qu'une application SaaS multi-locataire? Les applications saas multi-locataires vous permettent de servir plusieurs clients à partir d'un chant

Comment construire une application SaaS multi-locataire avec Next.js (Frontend Integration)Apr 11, 2025 am 08:22 AM

Comment construire une application SaaS multi-locataire avec Next.js (Frontend Integration)Apr 11, 2025 am 08:22 AMCet article démontre l'intégration frontale avec un backend sécurisé par permis, construisant une application fonctionnelle EdTech SaaS en utilisant Next.js. Le frontend récupère les autorisations des utilisateurs pour contrôler la visibilité de l'interface utilisateur et garantit que les demandes d'API adhèrent à la base de rôles

JavaScript: Explorer la polyvalence d'un langage WebApr 11, 2025 am 12:01 AM

JavaScript: Explorer la polyvalence d'un langage WebApr 11, 2025 am 12:01 AMJavaScript est le langage central du développement Web moderne et est largement utilisé pour sa diversité et sa flexibilité. 1) Développement frontal: construire des pages Web dynamiques et des applications à une seule page via les opérations DOM et les cadres modernes (tels que React, Vue.js, Angular). 2) Développement côté serveur: Node.js utilise un modèle d'E / S non bloquant pour gérer une concurrence élevée et des applications en temps réel. 3) Développement des applications mobiles et de bureau: le développement de la plate-forme multiplateuse est réalisé par réact noral et électron pour améliorer l'efficacité du développement.

L'évolution de JavaScript: tendances actuelles et perspectives d'avenirApr 10, 2025 am 09:33 AM

L'évolution de JavaScript: tendances actuelles et perspectives d'avenirApr 10, 2025 am 09:33 AMLes dernières tendances de JavaScript incluent la montée en puissance de TypeScript, la popularité des frameworks et bibliothèques modernes et l'application de WebAssembly. Les prospects futurs couvrent des systèmes de type plus puissants, le développement du JavaScript côté serveur, l'expansion de l'intelligence artificielle et de l'apprentissage automatique, et le potentiel de l'informatique IoT et Edge.

Démystifier javascript: ce qu'il fait et pourquoi c'est importantApr 09, 2025 am 12:07 AM

Démystifier javascript: ce qu'il fait et pourquoi c'est importantApr 09, 2025 am 12:07 AMJavaScript est la pierre angulaire du développement Web moderne, et ses principales fonctions incluent la programmation axée sur les événements, la génération de contenu dynamique et la programmation asynchrone. 1) La programmation axée sur les événements permet aux pages Web de changer dynamiquement en fonction des opérations utilisateur. 2) La génération de contenu dynamique permet d'ajuster le contenu de la page en fonction des conditions. 3) La programmation asynchrone garantit que l'interface utilisateur n'est pas bloquée. JavaScript est largement utilisé dans l'interaction Web, les applications à une page et le développement côté serveur, améliorant considérablement la flexibilité de l'expérience utilisateur et du développement multiplateforme.

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Dreamweaver CS6

Outils de développement Web visuel

MantisBT

Mantis est un outil Web de suivi des défauts facile à déployer, conçu pour faciliter le suivi des défauts des produits. Cela nécessite PHP, MySQL et un serveur Web. Découvrez nos services de démonstration et d'hébergement.

DVWA

Damn Vulnerable Web App (DVWA) est une application Web PHP/MySQL très vulnérable. Ses principaux objectifs sont d'aider les professionnels de la sécurité à tester leurs compétences et leurs outils dans un environnement juridique, d'aider les développeurs Web à mieux comprendre le processus de sécurisation des applications Web et d'aider les enseignants/étudiants à enseigner/apprendre dans un environnement de classe. Application Web sécurité. L'objectif de DVWA est de mettre en pratique certaines des vulnérabilités Web les plus courantes via une interface simple et directe, avec différents degrés de difficulté. Veuillez noter que ce logiciel

MinGW - GNU minimaliste pour Windows

Ce projet est en cours de migration vers osdn.net/projects/mingw, vous pouvez continuer à nous suivre là-bas. MinGW : un port Windows natif de GNU Compiler Collection (GCC), des bibliothèques d'importation et des fichiers d'en-tête librement distribuables pour la création d'applications Windows natives ; inclut des extensions du runtime MSVC pour prendre en charge la fonctionnalité C99. Tous les logiciels MinGW peuvent fonctionner sur les plates-formes Windows 64 bits.

Listes Sec

SecLists est le compagnon ultime du testeur de sécurité. Il s'agit d'une collection de différents types de listes fréquemment utilisées lors des évaluations de sécurité, le tout en un seul endroit. SecLists contribue à rendre les tests de sécurité plus efficaces et productifs en fournissant facilement toutes les listes dont un testeur de sécurité pourrait avoir besoin. Les types de listes incluent les noms d'utilisateur, les mots de passe, les URL, les charges utiles floues, les modèles de données sensibles, les shells Web, etc. Le testeur peut simplement extraire ce référentiel sur une nouvelle machine de test et il aura accès à tous les types de listes dont il a besoin.