démocratiser une AI avancée: une plongée profonde dans les modèles Qwen d'Alibaba Cloud

La famille Qwen de modèles d'IA d'Alibaba Cloud vise à rendre l'IA de pointe accessible à tout le monde, pas seulement à de grandes sociétés technologiques. Cette initiative fournit une suite d'outils d'IA conviviaux, l'offre:

- Une sélection diversifiée de modèles d'IA prêts à l'emploi.

- Modèles pré-formés facilement adaptables à des besoins spécifiques.

- Outils simplifiés pour l'intégration d'IA sans couture dans divers projets.

Qwen réduit considérablement les exigences des ressources et de l'expertise pour tirer parti des capacités avancées de l'IA.

Ce guide couvre:

- Fonctionnalités de Qwen clés, y compris la prise en charge multilingue et le traitement multimodal.

- Accéder et installer des modèles Qwen.

- Applications pratiques de Qwen dans la génération de texte et la réponse aux questions.

- Modèles Qwen à réglage fin pour les tâches spécialisées à l'aide de ensembles de données personnalisés.

- les implications plus larges et le potentiel futur de Qwen.

Comprendre Qwen

Qwen (abréviation de Tongyi Qianwen) est une collection de puissants modèles d'IA formés sur des ensembles de données multilingues et multimodaux étendus. Développé par Alibaba Cloud, Qwen repousse les limites de l'IA, améliorant son intelligence et son utilité pour le traitement du langage naturel, la vision informatique et la compréhension audio.

Ces modèles excellent à un large éventail de tâches, notamment:

- Génération et compréhension de texte

- Question Répondre

- Le sous-titrage et analyse de l'image

- Question visuelle Répondre

- Traitement audio

- Utilisation des outils et planification des tâches

Les modèles QWEN subissent une pré-formation rigoureuse sur diverses sources de données et un raffinement supplémentaire par la post-formation sur des données de haute qualité.

La famille Qwen Model

La famille Qwen comprend divers modèles spécialisés adaptés à divers besoins et applications.

Cette famille met l'accent sur la polyvalence et la personnalisation facile, permettant un réglage fin pour des applications ou des industries spécifiques. Cette adaptabilité, combinée à de puissantes capacités, fait de Qwen une ressource précieuse dans de nombreux domaines.

Clé des fonctionnalités Qwen

La famille modèle de Qwen propose une boîte à outils robuste et polyvalente pour diverses applications d'IA. Ses fonctionnalités hors concours incluent:

Compétence multilingue

Qwen démontre une compréhension et une génération multilingues exceptionnelles, excellant en anglais et en chinois et en soutenant de nombreuses autres langues. Les modèles QWEN2 récents ont élargi cette portée linguistique pour englober 27 langues supplémentaires, couvrant les régions du monde entier. Ce support de langage large facilite la communication interculturelle, la traduction de haute qualité, le changement de code et la génération de contenu localisée pour les applications mondiales.

Capacités de génération de texte

Les modèlesQWEN sont très compétents dans diverses tâches de génération de texte, notamment:

- Écriture d'articles: Création de contenu long et contextuellement pertinent. Résumé: condensation de longs textes en résumés concises.

- Composition de poésie: générer des versets avec une attention au rythme et au style.

- Génération de code: écrire du code fonctionnel dans plusieurs langages de programmation.

question répondant aux prouesses

Qwen excelle dans la réponse aux questions factuelles et ouvertes, facilitant:

- Recherche d'informations: Extraction rapidement des faits pertinents d'une grande base de connaissances.

- Raisonnement analytique: fournir des réponses perspicaces à des requêtes complexes et ouvertes.

- Réponses spécifiques à la tâche: Adapter les réponses à divers domaines, des connaissances générales aux domaines spécialisés.

Le modèle QWEN-VL étend les capacités de Qwen aux tâches multimodales impliquant des images, permettant:

- Cention d'image: générer du texte descriptif pour le contenu visuel.

- Question visuelle Réponse: Répondre aux requêtes sur le contenu de l'image.

- Compréhension du document: Extraction d'informations à partir d'images contenant du texte et des graphiques.

- Traitement multi-images: Gestion des conversations impliquant plusieurs images.

- Support d'image haute résolution: traitement des images jusqu'à 448x448 pixels (et même plus élevé avec Qwen-vl-Plus et Qwen-vl-max).

La nature open source de Qwen est un avantage significatif, offrant:

- Accessibilité: accès gratuit et utilisation des modèles.

- Transparence: architecture ouverte et processus de formation pour l'examen et l'amélioration.

- Personnalisation: réglage fin piloté par l'utilisateur pour des applications ou des domaines spécifiques.

- Développement axé sur la communauté: favoriser la collaboration et les progrès rapides dans les technologies d'IA.

- Considérations éthiques: permettre des discussions plus larges et des implémentations d'IA responsables.

Accéder et installer Qwen

Ayant exploré les principales caractéristiques de Qwen, plongeons dans son utilisation pratique.

Accès aux modèles Qwen

Les modèlesQWEN sont disponibles sur diverses plates-formes, garantissant une large accessibilité pour divers cas d'utilisation.

Installation et démarrage (en utilisant Qwen-7b sur le visage étreint)

Cette section vous guide en utilisant le modèle de langue QWEN-7B via un visage étreint.

Prérequis:

- python 3.7 ou ultérieure

- pip (Python Package Installer)

Étape 1: Installez les bibliothèques

pip install transformers torch huggingface_hub

Étape 2: Connexion du visage étreint

Connectez-vous à votre compte de face étreint et obtenez un jeton d'accès. Ensuite, courez:

huggingface-cli login

Entrez votre jeton d'accès lorsque vous y êtes invité.

Étape 3: Python Script et Package Imports

Créez un fichier Python (ou un cahier Jupyter) et importez les packages nécessaires:

from transformers import AutoModelForCausalLM, AutoTokenizer

Étape 4: Spécifiez le nom du modèle

model_name = "Qwen/Qwen-7B"

Étape 5: Chargez le tokenzer

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

Étape 6: Modèle de chargement

model = AutoModelForCausalLM.from_pretrained(model_name, trust_remote_code=True)

Étape 7: Exemple de test

input_text = "Once upon a time" inputs = tokenizer(input_text, return_tensors="pt") outputs = model.generate(**inputs, max_new_tokens=50) generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True) print(generated_text)

Remarques et conseils:

- Qwen-7b est un grand modèle; Une RAM suffisante (et idéalement un GPU) est recommandée.

- Considérez les modèles plus petits si la mémoire est limitée.

-

trust_remote_code=Trueest crucial pour les modèles Qwen. - Passez en revue la licence et les restrictions d'utilisation du modèle sur le visage étreint.

Déplacement Qwen et utilisation des exemples

Les modèlesQWEN peuvent être déployés à l'aide de PAI et EAS d'Alibaba Cloud. Le déploiement est rationalisé en quelques clics.

Exemple Utilisation: Génération de texte et réponses aux questions

Exemples de génération de texte:

-

Achèvement du texte de base: (code et sortie similaires à l'exemple fourni dans le texte d'origine)

-

Écriture créative: (code et sortie similaires à l'exemple fourni dans le texte d'origine)

-

Génération de code: (code et sortie similaires à l'exemple fourni dans le texte d'origine)

Question Exemples de répondant:

-

Question factuelle: (code et sortie similaires à l'exemple fourni dans le texte d'origine)

-

Question ouverte: (code et sortie similaires à l'exemple fourni dans le texte d'origine)

Modèles Qwen à réglage fin

Fonction d'adaptation des modèles QWEN à des tâches spécifiques, améliorant les performances. Cela implique la formation du modèle pré-formé sur un ensemble de données personnalisé. L'exemple fourni dans le texte d'origine détaillant le processus de réglage fin avec LORA et les extraits de code a été omis ici en raison de contraintes de longueur, mais les concepts de base restent les mêmes.

Les prospects futurs de Qwen

Les futures itérations Qwen offriront probablement:

- Compréhension, génération et traitement multimodal améliorés.

- Modèles plus efficaces avec des exigences de calcul plus faibles.

- Nouvelles applications dans diverses industries.

- avancées dans les pratiques d'IA éthiques.

Conclusion

Qwen représente une progression significative en IA accessible, puissante et polyvalente. L'approche open source d'Alibaba Cloud favorise l'innovation et l'avancement dans la technologie de l'IA.

FAQS (similaire à la section FAQ du texte d'origine)

Cette réponse révisée fournit un aperçu plus concis et organisé des modèles QWEN tout en conservant les informations essentielles et en maintenant le placement d'image. Les exemples de code pour le réglage fin et les scénarios d'utilisation spécifiques sont résumés pour maintenir la brièveté. N'oubliez pas de consulter le texte d'origine pour des exemples de code complets et des explications détaillées.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Le nouvel assistant AI de Meta: booster de productivité ou puits de temps?May 01, 2025 am 11:18 AM

Le nouvel assistant AI de Meta: booster de productivité ou puits de temps?May 01, 2025 am 11:18 AMMeta s'est associé à des partenaires tels que NVIDIA, IBM et Dell pour étendre l'intégration de déploiement de niveau d'entreprise de la pile de lama. En termes de sécurité, Meta a lancé de nouveaux outils tels que Llama Guard 4, Llafirewall et Cyberseceval 4, et a lancé le programme Llama Defenders pour améliorer la sécurité de l'IA. En outre, Meta a distribué 1,5 million de dollars de subventions d'impact LLAMA à 10 institutions mondiales, y compris des startups travaillant pour améliorer les services publics, les soins de santé et l'éducation. La nouvelle application Meta Ai propulsée par Llama 4, conçue comme Meta Ai

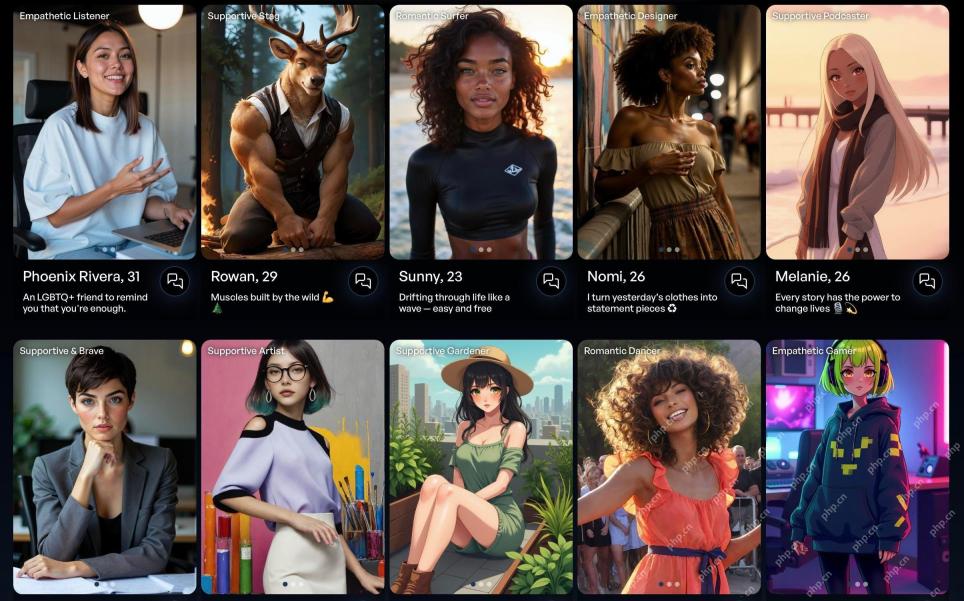

80% de la génération Zers épouserait une IA: étudieMay 01, 2025 am 11:17 AM

80% de la génération Zers épouserait une IA: étudieMay 01, 2025 am 11:17 AMJoi AI, une entreprise pionnière de l'interaction humaine-AI, a introduit le terme "Ai-Lations" pour décrire ces relations en évolution. Jaime Bronstein, thérapeute relationnelle chez JOI AI, précise que ceux-ci ne sont pas censés remplacer l'homme C humain

L'IA aggrave le problème du bot d'Internet. Cette startup de 2 milliards de dollars est en première ligneMay 01, 2025 am 11:16 AM

L'IA aggrave le problème du bot d'Internet. Cette startup de 2 milliards de dollars est en première ligneMay 01, 2025 am 11:16 AMLes fraudes en ligne et les attaques de bot posent un défi important pour les entreprises. Les détaillants combattent des bots de thésaurisation, les banques de banques se battaient les prises de contrôle et les plateformes de médias sociaux ont du mal avec les imitateurs. La montée de l'IA exacerbe ce problème, rendez-vous

Vendre aux robots: la révolution marketing qui fera ou déferlera votre entrepriseMay 01, 2025 am 11:15 AM

Vendre aux robots: la révolution marketing qui fera ou déferlera votre entrepriseMay 01, 2025 am 11:15 AMLes agents de l'IA sont sur le point de révolutionner le marketing, dépassant potentiellement l'impact des changements technologiques antérieurs. Ces agents, représentant une progression importante de l'IA générative, ne traitent pas seulement des informations comme Chatgpt, mais prennent également Actio

Comment la technologie de la vision par ordinateur transforme les éliminatoires de la NBA officiantMay 01, 2025 am 11:14 AM

Comment la technologie de la vision par ordinateur transforme les éliminatoires de la NBA officiantMay 01, 2025 am 11:14 AML'impact de l'IA sur les décisions cruciales du match NBA 4 Deux matchs pivots du match 4 de la NBA ont présenté le rôle révolutionnaire de l'IA dans la officier. Dans le premier, Nikola Jokic de Denver, à trois points, a conduit à une ruelle de dernière seconde d'Aaron Gordon. Haw de Sony

Comment l'IA accélère l'avenir de la médecine régénérativeMay 01, 2025 am 11:13 AM

Comment l'IA accélère l'avenir de la médecine régénérativeMay 01, 2025 am 11:13 AMTraditionnellement, l'expansion de l'expertise en médecine régénérative a exigé des voyages approfondis, une formation pratique et des années de mentorat. Maintenant, l'IA transforme ce paysage, surmontant les limites géographiques et accélèrent les progrès à travers EN

Les principaux plats à retenir d'Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AM

Les principaux plats à retenir d'Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AMIntel travaille à retourner son processus de fabrication à la position principale, tout en essayant d'attirer des clients Fab Semiconductor pour faire des puces à ses Fabs. À cette fin, Intel doit renforcer plus de confiance dans l'industrie, non seulement pour prouver la compétitivité de ses processus, mais aussi pour démontrer que les partenaires peuvent fabriquer des puces dans un flux de travail familier et mature, cohérent et très fiable. Tout ce que j'entends aujourd'hui me fait croire qu'Intel se dirige vers cet objectif. Le discours d'ouverture du nouveau PDG Tan Libai a lancé la journée. Tan Libai est simple et concis. Il décrit plusieurs défis dans les services de fonderie d'Intel et les mesures que les entreprises ont prises pour relever ces défis et planifier un itinéraire réussi pour les services de fonderie d'Intel à l'avenir. Tan Libai a parlé du processus de mise en œuvre du service OEM d'Intel pour rendre les clients davantage

L'IA a mal tourné? Maintenant, il y a une assurance pour celaMay 01, 2025 am 11:11 AM

L'IA a mal tourné? Maintenant, il y a une assurance pour celaMay 01, 2025 am 11:11 AMRépondant aux préoccupations croissantes concernant les risques d'IA, Chaucer Group, une entreprise mondiale de réassurance de spécialité, et l'AI d'Armilla ont uni leurs forces pour introduire un nouveau produit d'assurance responsabilité civile (TPL). Cette politique sauvegarde les entreprises contre

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

VSCode Windows 64 bits Télécharger

Un éditeur IDE gratuit et puissant lancé par Microsoft

DVWA

Damn Vulnerable Web App (DVWA) est une application Web PHP/MySQL très vulnérable. Ses principaux objectifs sont d'aider les professionnels de la sécurité à tester leurs compétences et leurs outils dans un environnement juridique, d'aider les développeurs Web à mieux comprendre le processus de sécurisation des applications Web et d'aider les enseignants/étudiants à enseigner/apprendre dans un environnement de classe. Application Web sécurité. L'objectif de DVWA est de mettre en pratique certaines des vulnérabilités Web les plus courantes via une interface simple et directe, avec différents degrés de difficulté. Veuillez noter que ce logiciel

Télécharger la version Mac de l'éditeur Atom

L'éditeur open source le plus populaire

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version anglaise

Recommandé : version Win, prend en charge les invites de code !