Chainlit : un cadre d'IA conversationnelle évolutif

Chainlit est un framework Python asynchrone open source conçu pour créer des applications d'IA conversationnelles robustes et évolutives. Il offre une base flexible, permettant aux développeurs d'intégrer de manière transparente des API externes, une logique personnalisée et des modèles locaux.

Ce tutoriel présente deux implémentations de Retrieval Augmented Generation (RAG) dans Chainlit :

- Exploiter les assistants OpenAI avec les documents téléchargés.

- Utilisation de llama_index avec un dossier de documents local.

Configuration locale de Chainlit

Environnement virtuel

Créez un environnement virtuel :

mkdir chainlit && cd chainlit python3 -m venv venv source venv/bin/activate

Installer les dépendances

Installez les packages requis et enregistrez les dépendances :

pip install chainlit pip install llama_index # For implementation #2 pip install openai pip freeze > requirements.txt

Tester Chainlit

Démarrer Chainlit :

chainlit hello

Accédez à l'espace réservé sur https://www.php.cn/link/2674cea93e3214abce13e072a2dc2ca5

Déploiement Upsun

Initialisation de Git

Initialiser un dépôt Git :

git init .

Créer un fichier .gitignore :

<code>.env database/** data/** storage/** .chainlit venv __pycache__</code>

Création du projet Upsun

Créez un projet Upsun à l'aide de la CLI (suivez les invites). Upsun configurera automatiquement le référentiel distant.

Configuration

Exemple de configuration Upsun pour Chainlit :

applications:

chainlit:

source:

root: "/"

type: "python:3.11"

mounts:

"/database":

source: "storage"

source_path: "database"

".files":

source: "storage"

source_path: "files"

"__pycache__":

source: "storage"

source_path: "pycache"

".chainlit":

source: "storage"

source_path: ".chainlit"

web:

commands:

start: "chainlit run app.py --port $PORT --host 0.0.0.0"

upstream:

socket_family: tcp

locations:

"/":

passthru: true

"/public":

passthru: true

build:

flavor: none

hooks:

build: |

set -eux

pip install -r requirements.txt

deploy: |

set -eux

# post_deploy: |

routes:

"https://{default}/":

type: upstream

upstream: "chainlit:http"

"https://www.{default}":

type: redirect

to: "https://{default}/"

Définissez la variable d'environnement OPENAI_API_KEY via Upsun CLI :

upsun variable:create env:OPENAI_API_KEY --value=sk-proj[...]

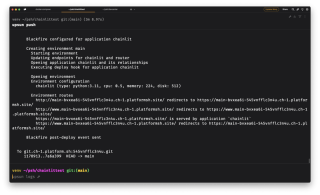

Déploiement

Commettre et déployer :

git add . git commit -m "First chainlit example" upsun push

Examinez l'état du déploiement. Un déploiement réussi montrera que Chainlit s'exécute sur votre environnement principal.

Implémentation 1 : Assistant OpenAI et fichiers téléchargés

Cette implémentation utilise un assistant OpenAI pour traiter les documents téléchargés.

Assistant Création

Créez un nouvel assistant OpenAI sur la plateforme OpenAI. Définissez les instructions du système, choisissez un modèle (avec format de réponse texte) et maintenez la température basse (par exemple, 0,10). Copiez l'ID de l'assistant (asst_[xxx]) et définissez-le comme variable d'environnement :

upsun variable:create env:OPENAI_ASSISTANT_ID --value=asst_[...]

Téléchargement de contenu

Téléchargez vos documents (Markdown de préférence) vers l'assistant. OpenAI créera un magasin de vecteurs.

Assistant Logique (app.py)

Remplacez le contenu app.py par le code fourni. Éléments clés : @cl.on_chat_start crée un nouveau fil de discussion OpenAI et @cl.on_message envoie les messages de l'utilisateur au fil de discussion et diffuse la réponse.

Commit et déployez les modifications. Testez l'assistant.

Implémentation 2 : OpenAI llama_index

Cette implémentation utilise llama_index pour la gestion des connaissances locales et OpenAI pour la génération de réponses.

Création de succursale

Créer une nouvelle branche :

mkdir chainlit && cd chainlit python3 -m venv venv source venv/bin/activate

Création de dossiers et montages

Créez des dossiers data et storage. Ajoutez des montures à la configuration Upsun.

Mise à jour app.py

Mettez à jour app.py avec le code llama_index fourni. Ce code charge des documents, crée un VectorStoreIndex et l'utilise pour répondre aux requêtes via OpenAI.

Déployez le nouvel environnement et téléchargez le dossier data. Testez l'application.

Bonus : Authentification

Ajoutez une authentification à l'aide d'une base de données SQLite.

Configuration de la base de données

Créez un dossier database et ajoutez un support à la configuration Upsun. Créez une variable d'environnement pour le chemin de la base de données :

pip install chainlit pip install llama_index # For implementation #2 pip install openai pip freeze > requirements.txt

Logique d'authentification (app.py)

Ajoutez une logique d'authentification à app.py en utilisant @cl.password_auth_callback. Cela ajoute un formulaire de connexion.

Créez un script pour générer des mots de passe hachés. Ajoutez des utilisateurs à la base de données (à l'aide de mots de passe hachés). Déployez l'authentification et testez la connexion.

Conclusion

Ce tutoriel a démontré le déploiement d'une application Chainlit sur Upsun avec deux implémentations RAG et une authentification. L'architecture flexible permet diverses adaptations et intégrations.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Le but principal de Python: flexibilité et facilité d'utilisationApr 17, 2025 am 12:14 AM

Le but principal de Python: flexibilité et facilité d'utilisationApr 17, 2025 am 12:14 AMLa flexibilité de Python se reflète dans les systèmes de prise en charge et de type dynamique multi-paradigmes, tandis que la facilité d'utilisation provient d'une syntaxe simple et d'une bibliothèque standard riche. 1. Flexibilité: prend en charge la programmation orientée objet, fonctionnelle et procédurale, et les systèmes de type dynamique améliorent l'efficacité de développement. 2. Facilité d'utilisation: La grammaire est proche du langage naturel, la bibliothèque standard couvre un large éventail de fonctions et simplifie le processus de développement.

Python: la puissance de la programmation polyvalenteApr 17, 2025 am 12:09 AM

Python: la puissance de la programmation polyvalenteApr 17, 2025 am 12:09 AMPython est très favorisé pour sa simplicité et son pouvoir, adaptés à tous les besoins des débutants aux développeurs avancés. Sa polyvalence se reflète dans: 1) Facile à apprendre et à utiliser, syntaxe simple; 2) Bibliothèques et cadres riches, tels que Numpy, Pandas, etc.; 3) Support multiplateforme, qui peut être exécuté sur une variété de systèmes d'exploitation; 4) Convient aux tâches de script et d'automatisation pour améliorer l'efficacité du travail.

Apprendre le python en 2 heures par jour: un guide pratiqueApr 17, 2025 am 12:05 AM

Apprendre le python en 2 heures par jour: un guide pratiqueApr 17, 2025 am 12:05 AMOui, apprenez Python en deux heures par jour. 1. Élaborer un plan d'étude raisonnable, 2. Sélectionnez les bonnes ressources d'apprentissage, 3. Consolider les connaissances apprises par la pratique. Ces étapes peuvent vous aider à maîtriser Python en peu de temps.

Python vs C: avant et inconvénients pour les développeursApr 17, 2025 am 12:04 AM

Python vs C: avant et inconvénients pour les développeursApr 17, 2025 am 12:04 AMPython convient au développement rapide et au traitement des données, tandis que C convient à des performances élevées et à un contrôle sous-jacent. 1) Python est facile à utiliser, avec syntaxe concise, et convient à la science des données et au développement Web. 2) C a des performances élevées et un contrôle précis, et est souvent utilisé dans les jeux et la programmation système.

Python: engagement du temps et rythme d'apprentissageApr 17, 2025 am 12:03 AM

Python: engagement du temps et rythme d'apprentissageApr 17, 2025 am 12:03 AMLe temps nécessaire pour apprendre le python varie d'une personne à l'autre, principalement influencé par l'expérience de programmation précédente, la motivation d'apprentissage, les ressources et les méthodes d'apprentissage et le rythme d'apprentissage. Fixez des objectifs d'apprentissage réalistes et apprenez mieux à travers des projets pratiques.

Python: automatisation, script et gestion des tâchesApr 16, 2025 am 12:14 AM

Python: automatisation, script et gestion des tâchesApr 16, 2025 am 12:14 AMPython excelle dans l'automatisation, les scripts et la gestion des tâches. 1) Automatisation: La sauvegarde du fichier est réalisée via des bibliothèques standard telles que le système d'exploitation et la fermeture. 2) Écriture de script: utilisez la bibliothèque PSUTIL pour surveiller les ressources système. 3) Gestion des tâches: utilisez la bibliothèque de planification pour planifier les tâches. La facilité d'utilisation de Python et la prise en charge de la bibliothèque riche en font l'outil préféré dans ces domaines.

Python et temps: tirer le meilleur parti de votre temps d'étudeApr 14, 2025 am 12:02 AM

Python et temps: tirer le meilleur parti de votre temps d'étudeApr 14, 2025 am 12:02 AMPour maximiser l'efficacité de l'apprentissage de Python dans un temps limité, vous pouvez utiliser les modules DateTime, Time et Schedule de Python. 1. Le module DateTime est utilisé pour enregistrer et planifier le temps d'apprentissage. 2. Le module de temps aide à définir l'étude et le temps de repos. 3. Le module de planification organise automatiquement des tâches d'apprentissage hebdomadaires.

Python: jeux, GUIS, et plusApr 13, 2025 am 12:14 AM

Python: jeux, GUIS, et plusApr 13, 2025 am 12:14 AMPython excelle dans les jeux et le développement de l'interface graphique. 1) Le développement de jeux utilise Pygame, fournissant des fonctions de dessin, audio et d'autres fonctions, qui conviennent à la création de jeux 2D. 2) Le développement de l'interface graphique peut choisir Tkinter ou Pyqt. Tkinter est simple et facile à utiliser, PYQT a des fonctions riches et convient au développement professionnel.

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

SublimeText3 version anglaise

Recommandé : version Win, prend en charge les invites de code !

Dreamweaver CS6

Outils de développement Web visuel

MantisBT

Mantis est un outil Web de suivi des défauts facile à déployer, conçu pour faciliter le suivi des défauts des produits. Cela nécessite PHP, MySQL et un serveur Web. Découvrez nos services de démonstration et d'hébergement.

VSCode Windows 64 bits Télécharger

Un éditeur IDE gratuit et puissant lancé par Microsoft