Maison >développement back-end >Golang >Une plongée approfondie dans le livre blanc sur l'IA cloud-native de la CNCF

Une plongée approfondie dans le livre blanc sur l'IA cloud-native de la CNCF

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBoriginal

- 2024-07-17 15:26:57631parcourir

Lors de la KubeCon EU 2024, la CNCF a lancé son premier livre blanc sur l'IA cloud-native. Cet article fournit une analyse approfondie du contenu de ce livre blanc.

En mars 2024, lors de la KubeCon EU, la Cloud-Native Computing Foundation (CNCF) a publié son premier livre blanc détaillé sur l'intelligence artificielle cloud-native (CNAI) 1. Ce rapport explore en profondeur l'état actuel, les défis et les orientations de développement futures de l'intégration des technologies cloud natives avec l'intelligence artificielle. Cet article approfondira le contenu principal de ce livre blanc.

Cet article est publié pour la première fois dans le plan moyen MPP. Si vous êtes un utilisateur moyen, suivez-moi en moyen. Merci beaucoup.

Qu’est-ce que l’IA cloud native ?

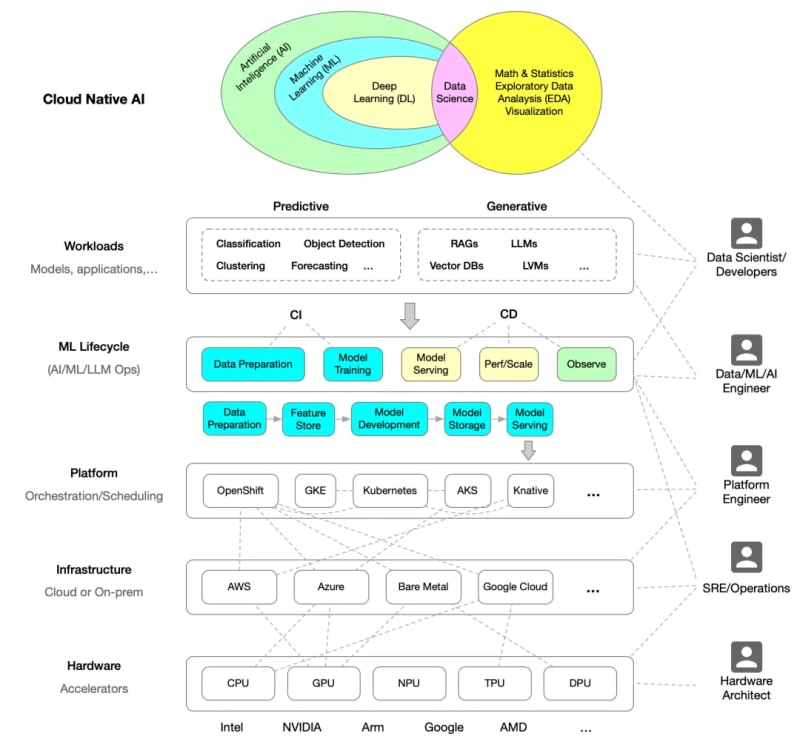

L'IA cloud native fait référence à la création et au déploiement d'applications et de charges de travail d'intelligence artificielle à l'aide des principes technologiques cloud natifs. Cela inclut l’exploitation des microservices, de la conteneurisation, des API déclaratives et de l’intégration continue/déploiement continu (CI/CD), entre autres technologies cloud natives, pour améliorer l’évolutivité, la réutilisabilité et l’opérabilité des applications d’IA.

Le schéma suivant illustre l'architecture de Cloud-Native AI, redessinée sur la base du livre blanc.

Relation entre l'IA cloud native et les technologies cloud natives

Les technologies cloud natives fournissent une plate-forme flexible et évolutive qui rend le développement et l'exploitation des applications d'IA plus efficaces. Grâce à la conteneurisation et à l'architecture de microservices, les développeurs peuvent itérer et déployer rapidement des modèles d'IA tout en garantissant la haute disponibilité et l'évolutivité du système. Kuuch comme la planification des ressources, la mise à l'échelle automatique et la découverte de services.

Le livre blanc fournit deux exemples pour illustrer la relation entre l'IA cloud native et les technologies cloud natives, à savoir l'exécution de l'IA sur une infrastructure cloud native :

- Hugging Face collabore avec Microsoft pour lancer le catalogue de modèles Hugging Face sur Azure2

- OpenAI évolutif de Kubernetes jusqu'à 7 500 nœuds3

Les défis de l'IA cloud native

Bien qu'il fournisse une base solide pour les applications d'IA, des défis subsistent lors de l'intégration des charges de travail d'IA avec des plates-formes cloud natives. Ces défis incluent la complexité de la préparation des données, les besoins en ressources de formation des modèles et le maintien de la sécurité et de l'isolation des modèles dans des environnements multi-locataires. De plus, la gestion et la planification des ressources dans les environnements cloud natifs sont cruciales pour les applications d'IA à grande échelle et nécessitent une optimisation supplémentaire pour prendre en charge une formation et une inférence efficaces des modèles.

Parcours de développement de l'IA cloud native

Le livre blanc propose plusieurs voies de développement pour l'IA Cloud-Native, notamment l'amélioration des algorithmes de planification des ressources pour mieux prendre en charge les charges de travail de l'IA, le développement de nouvelles technologies de maillage de services pour améliorer les performances et la sécurité des applications d'IA, et la promotion de l'innovation et de la standardisation du Cloud-Native. Technologie d'IA grâce à des projets open source et à la collaboration communautaire.

Paysage technologique de l’IA cloud-native

L'IA Cloud-Native implique diverses technologies, allant des conteneurs et microservices au maillage de services et à l'informatique sans serveur. Kubernetes joue un rôle central dans le déploiement et la gestion des applications d'IA, tandis que les technologies de maillage de services telles qu'Istio et Envoy offrent des fonctionnalités robustes de gestion du trafic et de sécurité. De plus, les outils de surveillance comme Prometheus et Grafana sont essentiels pour maintenir les performances et la fiabilité des applications d'IA.

Vous trouverez ci-dessous le diagramme paysager de l'IA Cloud-Native fourni dans le livre blanc.

- Kubernetes

- Volcan

- Armada

- Kuberay

- Nvidia NeMo

- Younikorn

- Kueue

- Flamme

Formation distribuée

- Opérateur de formation Kubeflow

- Pytorch DDP

- TensorFlow distribué

- Ouvrir MPI

- DeepSpeed

- Mégatron

- Horovod

- Apla

- …

Service ML

- Kserve

- Seldon

- VLLM

- TGT

- Skypilot

- …

CI/CD — Livraison

- Pipelines Kubeflow

- Mlflow

- TFX

- BentoML

- MLRun

- …

Science des données

- Jupyter

- Cahiers Kubeflow

- PyTorch

- TensorFlow

- Apache Zeppelin

Observabilité de la charge de travail

- Prométhée

- Influxdb

- Grafana

- Poids et biais (wandb)

- OpenTelemetry

- …

ML automatique

- Hyperopt

- Optuna

- Kubeflow Katib

- NNI

- …

Gouvernance et politique

- Kyverno

- Kyverno-JSON

- OPA/Gatekeeper

- StackRox Minder

- …

Architecture des données

- Cliquez sur Maison

- Apache Pinot

- Druide Apache

- Cassandre

- ScyllaDB

- Hadoop HDFS

- Apache HBase

- Presto

- Trino

- Apache Spark

- Apache Flink

- Kafka

- Pulsar

- Fluide

- Memcached

- Redis

- Alluxio

- Superset Apache

- …

Bases de données vectorielles

- Chrome

- Tisser

- Quadrant

- Pomme de Pin

- Extensions

- Redis

- Postgres SQL

- ElasticSearch

- …

Observabilité du modèle/LLM

- • Trulens

- Langfuse

- Vérifications approfondies

- OpenLLMetry

- …

Conclusion

Enfin, les points clés suivants sont résumés :

- Rôle de la communauté Open Source : Le livre blanc indique le rôle de la communauté open source dans l'avancement de l'IA cloud native, notamment en accélérant l'innovation et en réduisant les coûts grâce à des projets open source et une collaboration approfondie.

- Importance des technologies Cloud-Native : L'IA Cloud-Native, construite selon les principes cloud-native, souligne l'importance de la répétabilité et de l'évolutivité. Les technologies cloud natives fournissent un environnement de développement et d'exploitation efficace pour les applications d'IA, notamment en matière de planification des ressources et d'évolutivité des services.

- Défis existants : malgré ses nombreux avantages, l'IA cloud-native est toujours confrontée à des défis en matière de préparation des données, d'exigences en ressources de formation des modèles, ainsi que de sécurité et d'isolation des modèles.

- Orientations futures du développement : le livre blanc propose des voies de développement, notamment l'optimisation des algorithmes de planification des ressources pour prendre en charge les charges de travail d'IA, le développement de nouvelles technologies de maillage de services pour améliorer les performances et la sécurité, et la promotion de l'innovation et de la normalisation technologiques via des projets open source et la collaboration communautaire. .

- Composants technologiques clés : les technologies clés impliquées dans l'IA cloud-native incluent, entre autres, les conteneurs, les microservices, le maillage de services et l'informatique sans serveur. Kubernetes joue un rôle central dans le déploiement et la gestion des applications d'IA, tandis que les technologies de maillage de services comme Istio et Envoy assurent la gestion du trafic et la sécurité nécessaires.

Pour plus de détails, veuillez télécharger le livre blanc sur l'IA Cloud-Native 4.

Liens de référence

Livre blanc : ↩︎

Hugging Face collabore avec Microsoft pour lancer le catalogue de modèles Hugging Face sur Azure ↩︎

OpenAI évolutif de Kubernetes jusqu'à 7 500 nœuds : ↩︎

Livre blanc sur l'IA cloud native : ↩︎

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Pourquoi fmt.Printf génère-t-il « -101 » pour un entier signé représenté en complément à deux ?

- Comment décoder facilement les jetons JWT dans Go à l'aide de la bibliothèque « jwt-go » ?

- Comparaison des similitudes et des différences entre la surcharge de fonctions et la surcharge de méthodes des fonctions Golang

- Golang Cobra plusieurs drapeaux sans valeur

- Comment interroger un modèle où la valeur intrinsèque d'une relation est égale à une valeur spécifique ?