Maison >Périphériques technologiques >IA >OpenAI, Microsoft, Zhipu AI et 16 autres sociétés à travers le monde ont signé l'engagement de sécurité Frontier Artificial Intelligence

OpenAI, Microsoft, Zhipu AI et 16 autres sociétés à travers le monde ont signé l'engagement de sécurité Frontier Artificial Intelligence

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBoriginal

- 2024-06-03 22:24:44492parcourir

Les questions de sécurité liées à l’intelligence artificielle (IA) font l’objet de débats mondiaux avec une attention sans précédent.

Avant que le fondateur et scientifique en chef d'OpenAI, Ilya Sutskever, et le co-responsable de l'équipe OpenAI Super Alignment, Jan Leike, ne quittent OpenAI l'un après l'autre, Leike a même publié une série d'articles sur X, affirmant qu'OpenAI et ses dirigeants ignoraient la sécurité au profit du glamour. . Produit brillant. Cela a attiré une large attention dans l’industrie, soulignant dans une certaine mesure la gravité des problèmes actuels de sécurité de l’IA.

Le 21 mai, un article publié dans le magazine Science appelait les dirigeants mondiaux à agir plus fermement contre les risques de l'intelligence artificielle (IA). L'article souligne que des scientifiques et des universitaires faisant autorité, notamment les lauréats du prix Turing Yoshua Bengio, Geoffrey Hinton et Yao Qizhi, estiment que les progrès réalisés ces derniers mois ne sont pas suffisants. Leur point de vue est que la technologie de l’intelligence artificielle se développe rapidement, mais que le développement et l’application de l’IA comportent de nombreux risques potentiels, notamment la confidentialité des données, l’abus des armes de l’intelligence artificielle et l’impact de l’intelligence artificielle sur le marché du travail. Par conséquent, les gouvernements doivent renforcer la surveillance et la législation et formuler des politiques appropriées pour gérer et guider le développement de l’intelligence artificielle. En outre, l'article

Nous pensons que le développement incontrôlé de l'IA est susceptible de conduire à terme à des pertes de vies humaines et de biosphère à grande échelle, ainsi qu'à la marginalisation ou à l'extinction des êtres humains.

Selon eux, les problèmes de sécurité des modèles d’IA ont atteint un niveau suffisant pour menacer la survie future de l’humanité.

De même, la question de la sécurité des modèles d'IA est devenue un sujet qui peut toucher tout le monde et dont tout le monde doit se préoccuper.

Le 22 mai est destiné à être un moment majeur dans l'histoire de l'intelligence artificielle : OpenAI, Google, Microsoft et Zhipu AI et d'autres entreprises de différents pays et régions ont signé conjointement les engagements de sécurité Frontier AI ; a approuvé la loi sur l'intelligence artificielle (loi sur l'IA), et les premières réglementations complètes au monde sur l'IA sont sur le point d'entrer en vigueur.

Une fois de plus, la question de sécurité de l’IA est évoquée au niveau politique.

Déclaration du Sommet de Séoul sur l'intelligence artificielle

Lors du "Sommet de l'intelligence artificielle de Séoul" sur le thème "sécurité, innovation et inclusion", des personnes d'Amérique du Nord, d'Asie, d'Europe et du Moyen-Orient 16 les entreprises de la région ont convenu d'engagements de sécurité pour le développement de l'IA et ont signé conjointement l'Engagement de sécurité de l'intelligence artificielle Frontier, comprenant les points suivants :

- Garantir une structure de gouvernance responsable et la transparence pour une sécurité de pointe de l'IA ; Cadre pour expliquer de manière responsable comment les risques des modèles d'IA de pointe seront mesurés ;

- Établir un processus clair pour les mécanismes d'atténuation des risques pour les modèles de sécurité d'IA de pointe ;

Yoshua Bengio, lauréat du prix Turing, estime que la signature du Frontier Artificial Intelligence Safety Pledge "marque une étape importante dans l'établissement d'un système de gouvernance international visant à promouvoir la sécurité de l'intelligence artificielle".

En tant que grande entreprise modèle chinoise, Zhipu AI a également signé ce nouvel engagement de pointe en matière de sécurité de l'intelligence artificielle. La liste complète des signataires est la suivante :

À cet égard, OpenAI. "Les engagements de sécurité de Frontier AI constituent une étape importante dans la promotion d'une mise en œuvre plus large de pratiques avancées de sécurité des systèmes d'IA", a déclaré la présidente Anna Makanju. "Ces engagements aideront les principaux développeurs à établir d'importantes meilleures pratiques de pointe en matière de sécurité de l'IA." Zhang Peng, PDG de Zhipu AI, a déclaré : « La technologie avancée implique une responsabilité importante pour assurer la sécurité de l'IA. Récemment, Zhipu AI a également été invité à comparaître à l'ICLR 2024, la plus grande conférence sur l'IA, et a partagé ses approches spécifiques en matière d'IA. » sécurité dans un discours d'ouverture intitulé "La route de ChatGLM vers l'AGI".

Ils pensent que la technologie Superalignment contribuera à améliorer la sécurité des grands modèles et ont lancé un plan Superalignment similaire à OpenAI, dans l'espoir de permettre aux machines d'apprendre et de juger par elles-mêmes, afin d'apprendre du contenu sûr.

Ils ont révélé que GLM-4V intègre ces mesures de sécurité pour empêcher les comportements nuisibles ou contraires à l'éthique tout en protégeant la confidentialité des utilisateurs et la sécurité des données et que la version mise à niveau ultérieure de GLM-4 est GLM -4.5 et son ; les modèles améliorés devraient également être basés sur la superintelligence et la technologie de super-alignement.

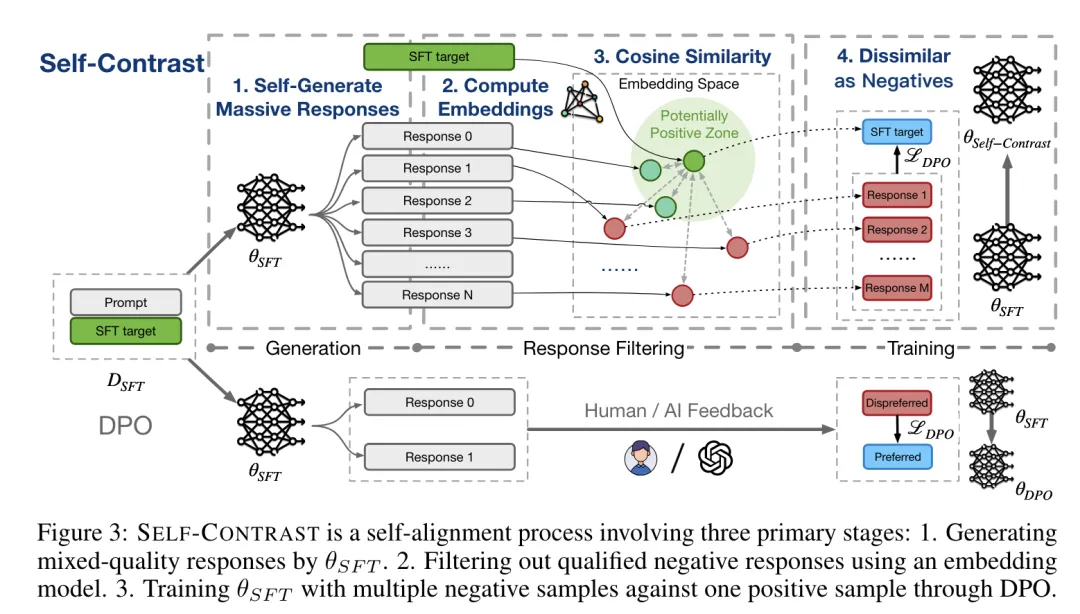

Nous avons également découvert que dans un article récemment publié, les équipes de Zhipu AI et Tsinghua ont introduit une méthode d'alignement de grands modèles de langage sans retour qui utilise un grand nombre de mots négatifs auto-générés ——Self-Contrast.

Selon la description de l'article, avec uniquement la cible de réglage fin supervisé (SFT), Self-Contrast peut utiliser LLM lui-même pour générer un grand nombre de mots candidats différents et utiliser le modèle d'intégration pré-entraîné pour filtrer plusieurs mots négatifs. mots basés sur la similitude du texte.

Lien papier : https://arxiv.org/abs/2404.00604

Des expériences d'optimisation directe des préférences (DPO) sur trois ensembles de données montrent que Self-Contrast peut durablement aller au-delà du SFT et du DPO standard entraînement. De plus, les performances de Self-Contrast continuent de s’améliorer à mesure que le nombre d’échantillons négatifs auto-générés augmente.

Dans l'ensemble, cette étude propose une nouvelle méthode d'alignement (telle que la méthode RLHF) en cas de données de préférence manquantes. Lorsque l'annotation des données de préférence est coûteuse et difficile à obtenir, les données SFT non étiquetées peuvent être utilisées pour construire des données de préférence grammaticale afin de compenser la perte de performances causée par un nombre insuffisant d'échantillons positifs en augmentant le nombre d'échantillons négatifs.

Le Conseil de l'Union européenne a officiellement approuvé la loi sur l'intelligence artificielle

Le même jour, le Conseil de l'Union européenne a également officiellement approuvé la loi sur l'intelligence artificielle (loi sur l'IA), qui est la première réglementation complète au monde. sur l’IA. Des réglementations historiques sur l’intelligence artificielle, qui entreront en vigueur le mois prochain et ne s’appliquent actuellement qu’aux domaines relevant du droit de l’UE, pourraient constituer une référence mondiale potentielle pour la technologie utilisée dans les affaires et dans la vie quotidienne.

"Cette réglementation historique, la première du genre au monde, relève un défi technologique mondial tout en créant des opportunités pour notre société et notre économie", a déclaré Mathieu Michel, ministre belge de la Digitalisation, dans un communiqué.

Cette législation globale sur l’IA adopte une approche « basée sur le risque », ce qui signifie que plus le risque de préjudice pour la société est élevé, plus les règles sont strictes. Par exemple, les modèles d’IA à usage général qui ne posent pas de risques systémiques seront soumis à certaines exigences limitées, mais ceux qui en posent sont soumis à des réglementations plus strictes.

Les amendes pour violation de la loi sur l'intelligence artificielle, qui sont fixées en pourcentage du chiffre d'affaires annuel mondial de l'entreprise contrevenante au cours de l'exercice précédent ou en un montant prédéterminé, selon le montant le plus élevé.

De nos jours, qu'il s'agisse d'une petite entreprise technologique ou d'une grande agence gouvernementale, prévenir et résoudre les problèmes de sécurité de l'IA est mis à l'ordre du jour. Comme l'a déclaré Philip Torr, professeur de sciences de l'ingénierie à l'Université d'Oxford :

"Lors du dernier sommet sur l'IA, le monde a convenu que nous devions agir, mais il est maintenant temps de passer de vagues recommandations à des engagements concrets. ."

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!