承接上节课,现在说说导出教程 检查连接 先看看有没有可用的connection 连接,如果没有就要根据上节课的方法创建一个 sqoop:000 show connector --all1 connector(s) to show: Connector with id 1: Name: generic-jdbc-connector Class: org.apache.sqoop.c

承接上节课,现在说说导出教程

检查连接

先看看有没有可用的connection 连接,如果没有就要根据上节课的方法创建一个

sqoop:000> show connector --all

1 connector(s) to show:

Connector with id 1:

Name: generic-jdbc-connector

Class: org.apache.sqoop.connector.jdbc.GenericJdbcConnector

Version: 1.99.3-cdh5.0.1

Supported job types: [EXPORT, IMPORT]

Connection form 1:后面还有很长的输出我就不贴了,如果有就继续往下做

准备数据

mysql数据表准备

先在mysql 里面建立一个表 employeeCREATE TABLE `employee` ( `id` int(11) NOT NULL, `name` varchar(20) NOT NULL, PRIMARY KEY (`id`) ) ENGINE=MyISAM DEFAULT CHARSET=utf8;

hadoop文件准备

在hadoop里面建立数据文件 先建立一个文件 part-m-00000 内容是1,'michael'

把他们放到hadoop里面

# hdfs dfs -mkdir /user/alex # hdfs dfs -put part-m-00000 /user/alex/ # hdfs dfs -ls /user/alex Found 1 items -rw-r--r-- 2 root supergroup 20 2014-11-27 18:26 /user/alex/part-m-00000

导出

create job --xid 1 --type export

接下来按照提示输入

sqoop:000> create job --xid 1 --type export Creating job for connection with id 1 Please fill following values to create new job object Name: export to employee Database configuration Schema name: Table name: employee Table SQL statement: Table column names: Stage table name: Clear stage table: Input configuration Input directory: /user/alex Throttling resources Extractors: Loaders: New job was successfully created with validation status FINE and persistent id 3执行这个任务

sqoop:000> start job --jid 3 Submission details Job ID: 3 Server URL: http://localhost:12000/sqoop/ Created by: root Creation date: 2014-11-27 18:29:27 CST Lastly updated by: root External ID: job_1406097234796_0008 http://xmseapp01:8088/proxy/application_1406097234796_0008/ 2014-11-27 18:29:27 CST: BOOTING - Progress is not available

然后等一会儿,再去看mysql的employee表就有一条michael 的记录了

下节课说下sqoop跟Hbase之间的通讯

Java错误:Hadoop错误,如何处理和避免Jun 24, 2023 pm 01:06 PM

Java错误:Hadoop错误,如何处理和避免Jun 24, 2023 pm 01:06 PMJava错误:Hadoop错误,如何处理和避免当使用Hadoop处理大数据时,常常会遇到一些Java异常错误,这些错误可能会影响任务的执行,导致数据处理失败。本文将介绍一些常见的Hadoop错误,并提供处理和避免这些错误的方法。Java.lang.OutOfMemoryErrorOutOfMemoryError是Java虚拟机内存不足的错误。当Hadoop任

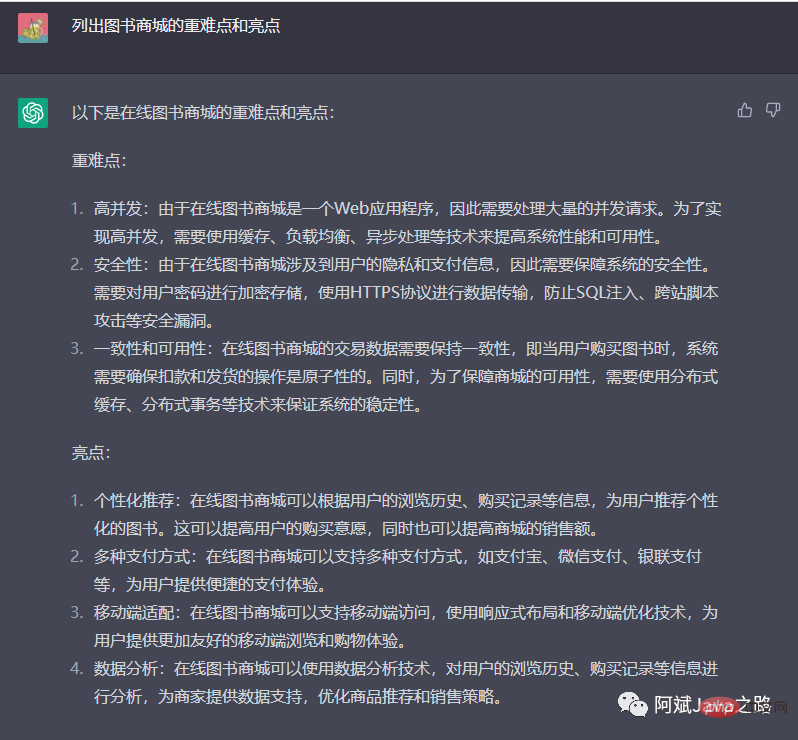

3分钟快速使用ChatGPT教程,用它帮我写简历,太牛了Apr 11, 2023 pm 07:40 PM

3分钟快速使用ChatGPT教程,用它帮我写简历,太牛了Apr 11, 2023 pm 07:40 PM已经火了很久了,身边的同事也用它来进行一些调研,资源检索,工作汇报等方面都有很大的的效率提升。很多人问ChatGPT会不会取代程序员?我的回答是:不会!ChatGPT并不是我们的敌人,相反的是,它是我们的好帮手。未来人和人的竞争,可能就会从原先的我懂得更多,我实操经验更丰富,变成了我比你更会用工具,我比你更懂得提问,我比你更会发挥机器人的最大特性,所以,为了不掉队,你还不准备体验下ChatGPT吗?快速体验面试官经常会问你的项目有啥重难点?很多人不会回答,直接看看ChatGPT怎么说,真的太牛了

菜鸟如何开启派送通知Feb 29, 2024 pm 07:40 PM

菜鸟如何开启派送通知Feb 29, 2024 pm 07:40 PM很多朋友会在菜鸟裹裹软件里查看自己的快递状态,有些朋友表示想知道怎样去设置开启派送通知。下面为大家介绍一下操作方法,还不了解的朋友一起来看看。1.打开手机中的菜鸟裹裹APP进入后,在页面的右下角位置点击“我的”切换进入。2.在我的页面里右上方位置点击“设置”图标打开。3.接下来,在设置页面里有一个“消息通知”,找到后在它的上面点击进入。4.在包裹通知设置页面里找到“派送中”这一项,在它的后面点击对应的开关按钮去进行设置,按钮为蓝色时代表开启该功能。当快递状态变更为派送中时会对我们进行通知提醒。

PHP基础教程:从入门到精通Jun 18, 2023 am 09:43 AM

PHP基础教程:从入门到精通Jun 18, 2023 am 09:43 AMPHP是一种广泛使用的开源服务器端脚本语言,它可以处理Web开发中所有的任务。PHP在网页开发中的应用广泛,尤其是在动态数据处理上表现优异,因此被众多开发者喜爱和使用。在本篇文章中,我们将一步步地讲解PHP基础知识,帮助初学者从入门到精通。一、基本语法PHP是一种解释性语言,其代码类似于HTML、CSS和JavaScript。每个PHP语句都以分号;结束,注

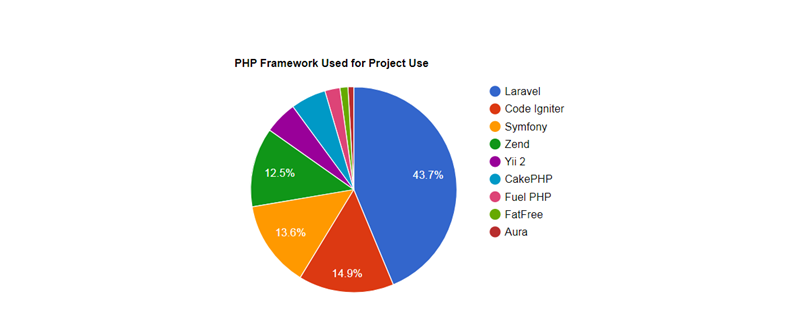

2023年最流行的5个php开发框架视频教程推荐May 08, 2017 pm 04:26 PM

2023年最流行的5个php开发框架视频教程推荐May 08, 2017 pm 04:26 PM如果想快速进行php web开发,选择一个好用的php开发框架至关重要,一个好的php开发框架可以让开发工作变得更加快捷、安全和有效。那2023年最流行的php开发框架有哪些呢?这些php开发框架排名如何?

什么是OCO订单?Apr 25, 2023 am 11:26 AM

什么是OCO订单?Apr 25, 2023 am 11:26 AM二选一订单(OneCancelstheOther,简称OCO)可让您同时下达两个订单。它结合了限价单和限价止损单,但只能执行其中一个。换句话说,只要其中的限价单被部分或全部成交、止盈止损单被触发,另一个订单将自动取消。请注意,取消其中一个订单也会同时取消另一个订单。在币安交易平台进行交易时,您可以将二选一订单作为交易自动化的基本形式。这个功能可让您选择同时下达两个限价单,从而有助于止盈和最大程度减少潜在损失。如何使用二选一订单?登录您的币安帐户之后,请前往基本交易界面,找到下图所示的交易区域。点

在Beego中使用Hadoop和HBase进行大数据存储和查询Jun 22, 2023 am 10:21 AM

在Beego中使用Hadoop和HBase进行大数据存储和查询Jun 22, 2023 am 10:21 AM随着大数据时代的到来,数据处理和存储变得越来越重要,如何高效地管理和分析大量的数据也成为企业面临的挑战。Hadoop和HBase作为Apache基金会的两个项目,为大数据存储和分析提供了一种解决方案。本文将介绍如何在Beego中使用Hadoop和HBase进行大数据存储和查询。一、Hadoop和HBase简介Hadoop是一个开源的分布式存储和计算系统,它可

如何使用PHP和Hadoop进行大数据处理Jun 19, 2023 pm 02:24 PM

如何使用PHP和Hadoop进行大数据处理Jun 19, 2023 pm 02:24 PM随着数据量的不断增大,传统的数据处理方式已经无法处理大数据时代带来的挑战。Hadoop是开源的分布式计算框架,它通过分布式存储和处理大量的数据,解决了单节点服务器在大数据处理中带来的性能瓶颈问题。PHP是一种脚本语言,广泛应用于Web开发,而且具有快速开发、易于维护等优点。本文将介绍如何使用PHP和Hadoop进行大数据处理。什么是HadoopHadoop是

Hot AI Tools

Undresser.AI Undress

AI-powered app for creating realistic nude photos

AI Clothes Remover

Online AI tool for removing clothes from photos.

Undress AI Tool

Undress images for free

Clothoff.io

AI clothes remover

AI Hentai Generator

Generate AI Hentai for free.

Hot Article

Hot Tools

SAP NetWeaver Server Adapter for Eclipse

Integrate Eclipse with SAP NetWeaver application server.

Dreamweaver Mac version

Visual web development tools

ZendStudio 13.5.1 Mac

Powerful PHP integrated development environment

Atom editor mac version download

The most popular open source editor

SublimeText3 Linux new version

SublimeText3 Linux latest version