Heim >Technologie-Peripheriegeräte >KI >Das multimodale AI-Agent-Modell von Stanford mit 2 Milliarden Parametern und Endtests wurde erheblich verbessert und kann von Mobiltelefonen, Autos und Robotern verwendet werden

Das multimodale AI-Agent-Modell von Stanford mit 2 Milliarden Parametern und Endtests wurde erheblich verbessert und kann von Mobiltelefonen, Autos und Robotern verwendet werden

- 王林nach vorne

- 2024-05-07 16:25:291235Durchsuche

Das weltweit erste ultrakleine multimodale KI-AgentenmodellOctopus V3 vom NEXA AI-Team der Stanford University macht Agent intelligenter, schneller und senkt den Energieverbrauch und die Kosten.

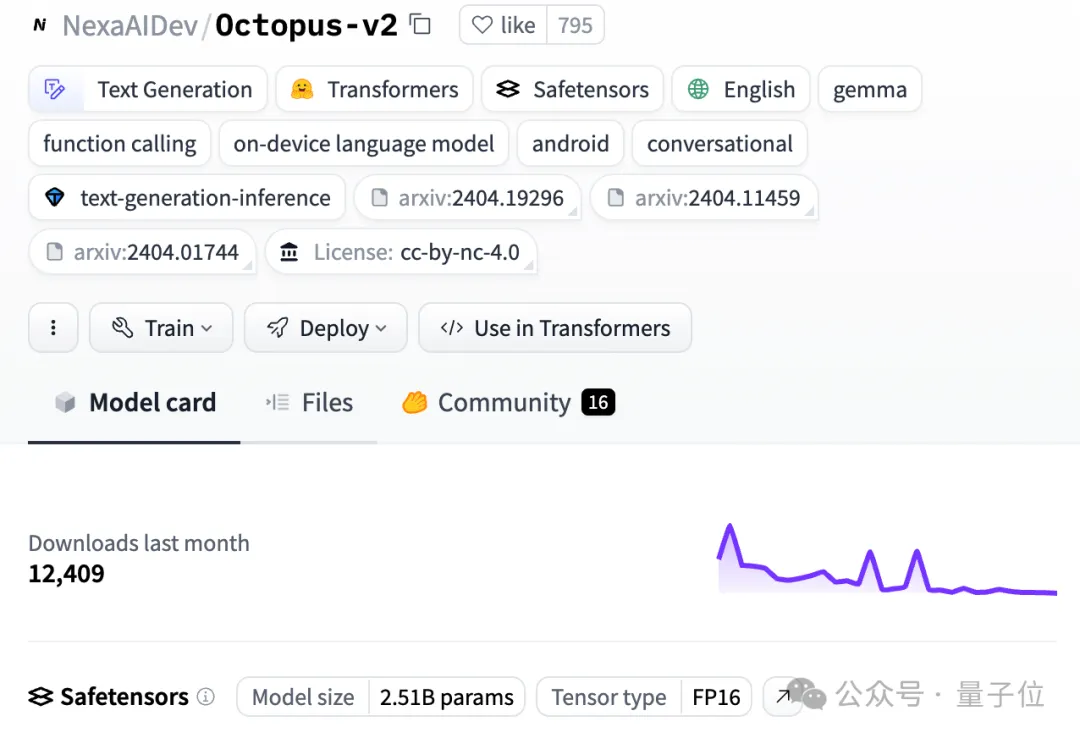

Anfang April dieses Jahres brachte NEXA AI das mit Spannung erwartete Octopus V2 auf den Markt in der Funktionsaufrufleistung und reduzierte das für die Inferenz erforderliche Textvolumen neue Möglichkeiten für endseitige KI-Anwendungen. Seine patentierte Kerntechnologie „Functional Token“ reduziert die für die Argumentation erforderliche Textlänge durch innovative Funktionsaufrufmethoden erheblich. Diese Methode ermöglicht es dem Modell, ein effizientes Training mit nur

2 Milliarden Parametern zu erreichen und GPT-4 in Bezug auf Genauigkeit und Latenz zu übertreffen und sich an die Bereitstellungsanforderungen verschiedener Endgeräte anzupassen. Seit Octopus V2 in der LLM-Community veröffentlicht wurde, hat es große Aufmerksamkeit und Lob von einer großen Anzahl von Experten und Forschern auf dem Gebiet der künstlichen Intelligenz erhalten, wie zum Beispiel Julien Chaumond, CTO von Hugging Face, Rowan Cheung, Gründer von der bekannte AI-Newsletter AI und Figure AI Brett Adcock, Gründer von OPPO, Manoj Kumar, Leiter des Edge-Teams für künstliche Intelligenz von OPPO usw. Sie werden als „Schaffung einer neuen Ära der geräteseitigen KI-Technologie“ gefeiert.

Auf der bekannten Open-Source-KI-Plattform Hugging Face wurde Octopus V2 mehr als 12.000 Mal heruntergeladen.

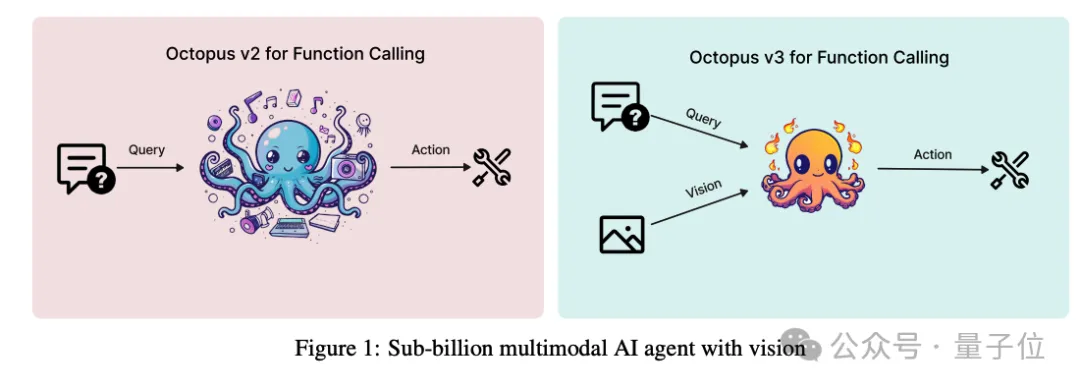

In weniger als einem Monat veröffentlichte das NEXA AI-Team das multimodale AI

In weniger als einem Monat veröffentlichte das NEXA AI-Team das multimodale AI

Modell Octopus V3 der nächsten Generation und demonstrierte weitere Durchbrüche: mit Bildverarbeitungs- und mehrsprachigen Textverarbeitungsfunktionen für Smartphones und andere Geräte Es ebnet den Weg für Nebengeräte, wirklich in die KI-Ära einzutreten.

Octopus+V3 verfügt nicht nur über multimodale Fähigkeiten, sondern übertrifft auch ähnliche Modelle bei der Funktionsaufrufleistung bei weitem, vergleichbar mit GPT-4V +GPT4; Die Anzahl der Modellparameter beträgt weniger als 1 Milliarde und es ist mehrsprachig.

Mit anderen Worten: Im Vergleich zu herkömmlichen großen Sprachmodellen ist es kleiner und verbraucht weniger Energie. Es kann einfacher auf verschiedenen kleinen Geräten wie dem Raspberry Pi ausgeführt werden und ermöglicht eine schnelle und genaue Übertragung .

Das bedeutet, dass AI Agent in Zukunft in großem Umfang in

Smartphones, AR/VR, Robotern, intelligenten Autosund anderen Endgeräten eingesetzt werden kann, um die Benutzerinteraktion reibungsloser und intelligenter zu gestalten. Da V3 andererseits über multimodale Verarbeitungsfunktionen verfügt, kann es Text- und Bildeingaben gleichzeitig verarbeiten und in Verbindung mit Mehrsprachenfunktionen auch das Benutzererlebnis bereichern.

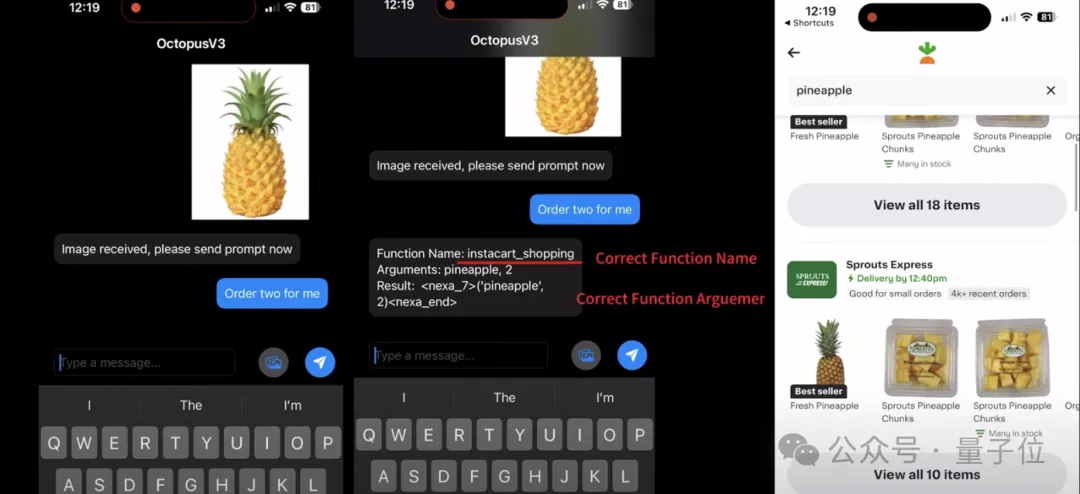

In der Instacart-Shopping-App können Benutzer beispielsweise den KI-Agenten über ein Bild einer Ananas und einen einfachen Konversationsbefehl automatisch nach Produkten für sie suchen lassen, was die Effizienz und das Benutzererlebnis verbessert.

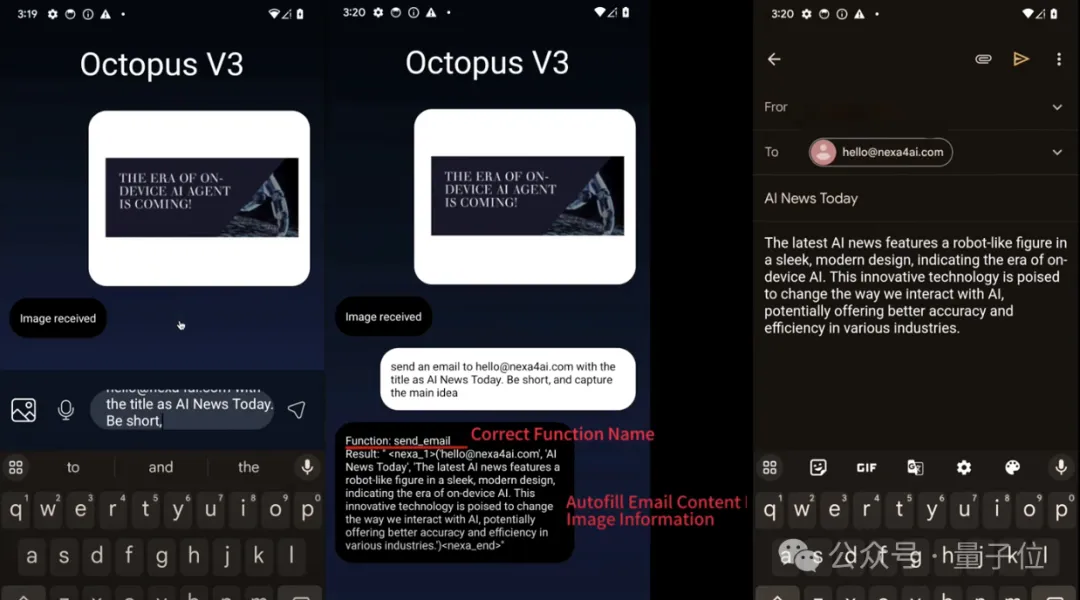

Ein weiteres Beispiel: In Szenarien wie dem Versenden von E-Mails kann Octopus V3 automatisch Informationen extrahieren und den E-Mail-Inhalt basierend auf einem Bild mit Text ergänzen, wodurch Benutzer intelligentere und bequemere Dienste erhalten.

Ein weiteres Beispiel: In Szenarien wie dem Versenden von E-Mails kann Octopus V3 automatisch Informationen extrahieren und den E-Mail-Inhalt basierend auf einem Bild mit Text ergänzen, wodurch Benutzer intelligentere und bequemere Dienste erhalten.

Von der Softwareinteraktion bis hin zu intelligenten Autos hat die geräteseitige KI ein enormes Potenzial

Von der Softwareinteraktion bis hin zu intelligenten Autos hat die geräteseitige KI ein enormes Potenzial

Basierend auf diesen Eigenschaften verfügen Octopus V2 und V3 über reichhaltige und vielfältige Anwendungsszenarien und breite Anwendungsaussichten.

Zusätzlich zu den oben genannten Mobiltelefonszenarien kann die Anwendung von Octopus V2 auf Smart Cars auch neue interaktive Erlebnisse bringen. Heutige Sprachassistenten können Autobesitzern oft nur schwer bei der Bewältigung komplexerer Aufgaben helfen, wie z. B. dem vorübergehenden Ändern von Zielen während der Fahrt, dem Hinzufügen zusätzlicher Stopps usw. Nach der Anwendung von Octopus V3 kann der KI-Assistent entsprechende Aufgaben anhand relativ vager und einfacher Anweisungen schnell und präzise erledigen.

Durch die Kombination der Funktionen von V2 und V3, vom Informationsabruf bis zum befehlsbasierten Design, können Benutzer ein reibungsloses KI-Erlebnis in virtuellen Szenen erhalten: In der VR-Szenendemo eines Community-Benutzers wird nach Eingabe einfacher Sprachbefehle der KI-Agent It kann Benutzern dabei helfen, mit einem Fingerklick schnell eine Wohnzimmergestaltung fertigzustellen, Sofas auszutauschen, die Farbe von Lichtern zu ändern usw. Nachdem der Benutzer die Reiseanweisungen eingegeben hat, gelangt er schnell nach Japan, und der KI-Agent kann dem Benutzer auch bei der Suche nach entsprechenden Attraktionen helfen und in einfacher Konversationskommunikation umfassende Informationen bereitstellen.

Daten zeigen, dass der globale Markt für groß angelegte Sprachmodelle schnell wächst. Der Bericht von Granview Research zeigt, dass die globale Marktgröße für große Sprachmodelle auf 4,35 Milliarden US-Dollar geschätzt wird und von 2024 bis 2030 voraussichtlich mit einer durchschnittlichen jährlichen Wachstumsrate von 35,9 % wachsen wird. In ähnlicher Weise zeigt auch der Markt für künstliche Intelligenz am Rande eine boomende Dynamik – es wird erwartet, dass der globale Markt für künstliche Intelligenz am Rande von 2023 bis 2030 mit einer durchschnittlichen jährlichen Wachstumsrate von 21,0 % wachsen und im Jahr 2030 einen Wert von 66,478 Milliarden US-Dollar erreichen wird.

Das NEXA AI-Team wurde von herausragenden Forschern der Stanford University gegründet.

Gründer und Chefwissenschaftler Alex Chen (Chen Wei) promoviert an der Stanford University. Er verfügt über umfangreiche Erfahrung in der Forschung zu künstlicher Intelligenz und war Vorsitzender der Stanford Chinese Entrepreneurs Organization.

Mitbegründer und Chief Technology Officer Zack Li (李志元) ist ebenfalls Absolvent der Stanford University und verfügt über 4 Jahre Erfahrung in der Forschung und Entwicklung an vorderster Front im Bereich End-Side-KI bei Google und Amazon Lab126 ein chinesischer Unternehmer in Stanford, Präsident des Verbandes.

Assoziierter Professor an der Stanford University und stellvertretender Direktor des Stanford Technology Entrepreneurship ProgramCharles (Chuck) Eesley fungiert als Berater und berät und unterstützt das Team.

△Links: Li Zhiyuan; Rechts: Chen Wei

△Links: Li Zhiyuan; Rechts: Chen Wei

Derzeit hat die Originaltechnologie von NEXA AI Patentschutz beantragt.

Das Gründungsteam von NEXA AI erklärte, dass es sich weiterhin dafür einsetzen werde, die Entwicklung der End-Side-KI-Technologie voranzutreiben, den Einfluss seiner innovativen Technologien durch Open-Source-Modelle zu erhöhen und ein intelligenteres und effizienteres zukünftiges Leben für Benutzer zu schaffen .

Papieradresse: https://arxiv.org/abs/2404.11459

Das obige ist der detaillierte Inhalt vonDas multimodale AI-Agent-Modell von Stanford mit 2 Milliarden Parametern und Endtests wurde erheblich verbessert und kann von Mobiltelefonen, Autos und Robotern verwendet werden. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Detaillierte Erläuterung des PyTorch-Batch-Trainings und des Optimierervergleichs

- So implementieren Sie die Funktion „Contains' in Python-Strings

- Was ist die Tastenkombination für die AI-Sperrschicht?

- Was ist der Unterschied zwischen Raid 0 1 5 10

- NUS und Byte arbeiteten branchenübergreifend zusammen, um durch Modelloptimierung ein 72-mal schnelleres Training zu erreichen, und gewannen den AAAI2023 Outstanding Paper.