Heim >Technologie-Peripheriegeräte >KI >OWASP veröffentlicht Checkliste für Netzwerksicherheit und Governance für umfangreiche Sprachmodelle

OWASP veröffentlicht Checkliste für Netzwerksicherheit und Governance für umfangreiche Sprachmodelle

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2024-04-17 19:31:011191Durchsuche

Das größte Risiko, dem die Technologie der künstlichen Intelligenz derzeit ausgesetzt ist, besteht darin, dass die Entwicklungs- und Anwendungsgeschwindigkeit großer Sprachmodelle (LLM) und generativer Technologie der künstlichen Intelligenz die Geschwindigkeit von Sicherheit und Governance bei weitem übertroffen hat.

Die Nutzung generativer KI und großer Sprachmodellprodukte von Unternehmen wie OpenAI, Anthropic, Google und Microsoft nimmt exponentiell zu. Gleichzeitig nehmen auch Open-Source-Lösungen für große Sprachmodelle schnell zu. Open-Source-Communitys für künstliche Intelligenz wie HuggingFace bieten eine große Anzahl von Open-Source-Modellen, Datensätzen und KI-Anwendungen.

Um die Entwicklung künstlicher Intelligenz voranzutreiben, entwickeln und stellen Branchenorganisationen wie OWASP, OpenSSF und CISA aktiv wichtige Ressourcen für die Sicherheit und Governance künstlicher Intelligenz bereit, wie z. B. OWASP AI Exchange, AI Security and Privacy Guide und das Top-Ten-Risikoliste großer Sprachmodelle (LLMTop10).

Kürzlich hat OWASP eine umfassende Checkliste für Cybersicherheit und Governance für Sprachmodelle veröffentlicht, die die Lücke in der Sicherheitsgovernance für generative künstliche Intelligenz schließt. Der spezifische Inhalt lautet wie folgt:

OWASPs Definition von KI-Typen und Bedrohungen

OWASPs Sprachmodell für Cybersicherheit und Governance Die Checkliste definiert die Unterschiede zwischen künstlicher Intelligenz, maschinellem Lernen, generativer KI und großen Sprachmodellen.

Zum Beispiel lautet OWASPs Definition von generativer KI: eine Art maschinelles Lernen, die sich auf die Erstellung neuer Daten konzentriert, während große Sprachmodelle ein KI-Modell sind, das zur Verarbeitung und Generierung menschenähnlicher „natürlicher Inhalte“ verwendet wird – – Sie treffen Vorhersagen auf der Grundlage dieser die Eingabe, die ihnen bereitgestellt wird, und die Ausgabe ist menschenähnlicher „natürlicher Inhalt“.

In Bezug auf die zuvor veröffentlichte „Big Language Model Top Ten Threat List“ ist OWASP davon überzeugt, dass sie Cybersicherheitsexperten dabei helfen kann, mit der sich schnell entwickelnden KI-Technologie Schritt zu halten, wichtige Bedrohungen zu identifizieren und sicherzustellen, dass Unternehmen über grundlegende Sicherheitskontrollen zum Schutz und zur Unterstützung der Nutzung verfügen Geschäft mit generativer künstlicher Intelligenz und großen Sprachmodellen. OWASP ist jedoch der Ansicht, dass diese Liste nicht vollständig ist und auf der Grundlage der Entwicklung generativer künstlicher Intelligenz kontinuierlich verbessert werden muss.

OWASP unterteilt KI-Sicherheitsbedrohungen in die folgenden fünf Typen:

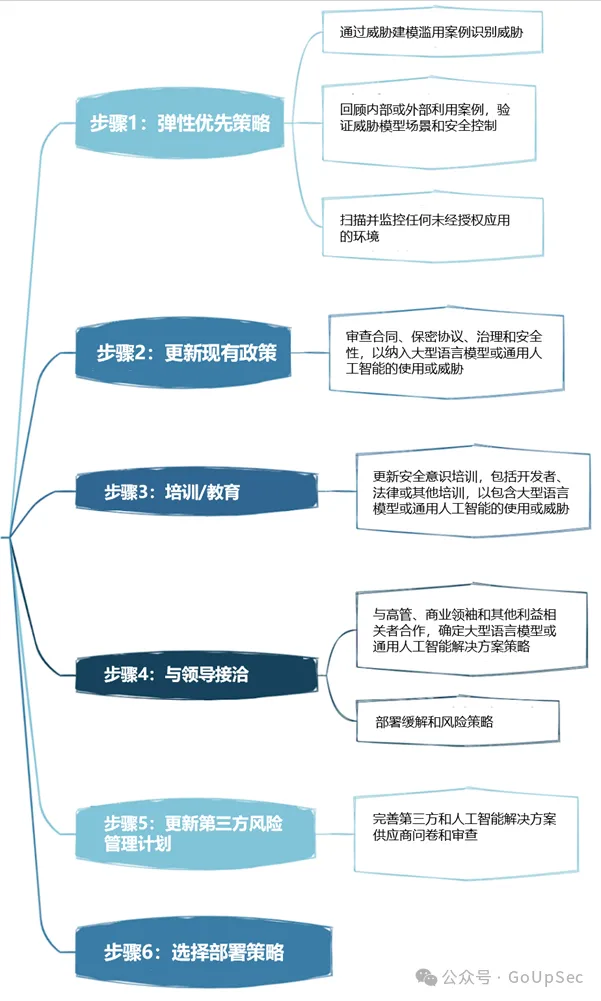

Die Bereitstellung der Sicherheits-Governance-Strategie für das große Sprachmodell von OWASP ist in sechs Schritte unterteilt:

Das Folgende ist die OWASP-Liste für Netzwerksicherheit und -governance für das große Sprachmodell :

1. Das Gegnerrisiko großer Sprachmodelle betrifft nicht nur Konkurrenten, sondern auch Angreifer. Der Schwerpunkt liegt nicht nur auf der Angriffshaltung, sondern auch auf der Geschäftshaltung. Dazu gehört das Verständnis, wie Wettbewerber KI nutzen, um Geschäftsergebnisse voranzutreiben, sowie die Aktualisierung interner Prozesse und Richtlinien, wie etwa Incident-Response-Pläne (IRPs), um auf generative KI-Angriffe und -Vorfälle zu reagieren.

2. Bedrohungsmodellierung

Bedrohungsmodellierung ist eine immer beliebter werdende Sicherheitstechnologie, die mit der Förderung des Konzepts sicherer Designsysteme immer mehr Aufmerksamkeit erregt und von der US-amerikanischen Cybersecurity and Infrastructure Security Agency (CISA) genehmigt wurde andere maßgebliche Organisationen. Bei der Bedrohungsmodellierung muss darüber nachgedacht werden, wie Angreifer große Sprachmodelle und generative KI nutzen, um die Ausnutzung von Schwachstellen zu beschleunigen, über die Fähigkeit des Unternehmens, bösartige große Sprachmodelle zu erkennen, und darüber, ob Unternehmen große Sprachmodelle und generative KI-Plattformen vor internen Systemen und Umgebungen schützen können.

3. Checkliste für künstliche Intelligenz-Assets

Das Sprichwort „Man kann ein unbekanntes Asset nicht schützen“ gilt auch für die Bereiche generative KI und große Sprachmodelle. Dieser Teil des OWASP-Inventars umfasst die Inventarisierung von KI-Assets für intern entwickelte KI-Lösungen sowie externe Tools und Plattformen.

OWASP betont, dass Unternehmen nicht nur verstehen müssen, welche Tools und Dienste intern verwendet werden, sondern auch deren Eigentümer, d. h. wer für die Nutzung dieser Tools und Dienste verantwortlich ist. Die Checkliste empfiehlt außerdem, KI-Komponenten in eine Software-Stückliste (SBOM) aufzunehmen und KI-Datenquellen und ihre jeweiligen Empfindlichkeiten zu dokumentieren.

Zusätzlich zur Inventarisierung vorhandener KI-Tools sollten Unternehmen auch einen sicheren Prozess für die Aufnahme zukünftiger KI-Tools und -Dienste in die Bestandsaufnahme etablieren.

4. Schulung zur Sensibilisierung für künstliche Intelligenz und Datenschutz

Es wird oft gesagt, dass „Menschen die größte Sicherheitslücke darstellen“. Modelle können menschliche Risiken erheblich mindern.

Dazu gehört es, den Mitarbeitern dabei zu helfen, bestehende Initiativen zur generativen KI/großen Sprachmodelle, Technologien und deren Fähigkeiten sowie wichtige Sicherheitsaspekte wie Datenschutzverletzungen zu verstehen. Darüber hinaus ist der Aufbau einer Sicherheitskultur des Vertrauens und der Transparenz von entscheidender Bedeutung.

Eine Kultur des Vertrauens und der Transparenz innerhalb des Unternehmens kann auch dazu beitragen, Bedrohungen durch Schatten-KI zu vermeiden, da Mitarbeiter andernfalls „heimlich“ Schatten-KI einsetzen, ohne es den IT- und Sicherheitsteams mitzuteilen.

5. Business Case für Projekte zur künstlichen Intelligenz . Lassen Sie sich vom Hype mitreißen. Ohne ein solides Geschäftsszenario führen KI-Anwendungen in Unternehmen wahrscheinlich zu schlechten Ergebnissen und erhöhen die Risiken.

6. Governance

Ohne Governance können Unternehmen keine Rechenschaftsmechanismen und klare Ziele für künstliche Intelligenz etablieren. In der OWASP-Checkliste wird empfohlen, dass Unternehmen ein RACI-Diagramm (Responsibility Allocation Matrix) für Anwendungen der künstlichen Intelligenz entwickeln, Risikoverantwortungen und Governance-Aufgaben erfassen und zuweisen sowie unternehmensweite Richtlinien und Verfahren für künstliche Intelligenz festlegen.

7. Rechtliches

Angesichts der rasanten Entwicklung der Technologie der künstlichen Intelligenz sind ihre rechtlichen Auswirkungen nicht zu unterschätzen und können erhebliche finanzielle Risiken und Reputationsrisiken für Unternehmen mit sich bringen.

Rechtsangelegenheiten im Bereich der künstlichen Intelligenz umfassen eine Reihe von Aktivitäten, wie z. B. die Produktgarantie für künstliche Intelligenz, die Endbenutzer-Lizenzvereinbarung (EULA) für künstliche Intelligenz, das Eigentum an Code, der mit Tools der künstlichen Intelligenz entwickelt wurde, Risiken in Bezug auf geistiges Eigentum und vertragliche Vergütungsklauseln usw. Kurz gesagt: Stellen Sie sicher, dass Ihr Rechtsteam oder Ihre Experten die verschiedenen unterstützenden rechtlichen Aktivitäten verstehen, die Ihr Unternehmen beim Einsatz generativer KI und großer Sprachmodelle durchführen sollte.

8. Regulierung

Auch die Regulierungsvorschriften für künstliche Intelligenz entwickeln sich rasant, wie zum Beispiel das EU-Gesetz zur künstlichen Intelligenz, und in anderen Ländern und Regionen werden bald Vorschriften eingeführt. Unternehmen sollten die KI-Compliance-Anforderungen ihres Landes kennen, beispielsweise die Mitarbeiterüberwachung, und ein klares Verständnis davon haben, wie ihre KI-Anbieter Daten speichern und löschen und deren Verwendung regeln.

9. Verwenden oder implementieren Sie große Sprachmodelllösungen.

Die Verwendung großer Sprachmodelllösungen erfordert die Berücksichtigung spezifischer Risiken und Kontrollen. Die OWASP-Checkliste listet Elemente wie Zugriffskontrolle, Schulung der Pipeline-Sicherheit, Zuordnung von Daten-Workflows und Verständnis bestehender oder potenzieller Schwachstellen in großen Sprachmodellmodellen und Lieferketten auf. Darüber hinaus sind sowohl anfänglich als auch fortlaufend Audits durch Dritte, Penetrationstests und sogar Codeüberprüfungen von Anbietern erforderlich.

10. Test, Bewertung, Verifizierung und Validierung (TEVV)

Der TEVV-Prozess ist ein Prozess, der speziell vom NIST in seinem Rahmen für künstliche Intelligenz empfohlen wird. Dazu gehört die Einrichtung kontinuierlicher Tests, Bewertungen, Validierungen und Validierungen während des gesamten Lebenszyklus des KI-Modells sowie die Bereitstellung von Ausführungsmetriken zur Funktionalität, Sicherheit und Zuverlässigkeit des KI-Modells.

11. Modellkarten und Risikokarten

Um große Sprachmodelle ethisch einzusetzen, verlangt die OWASP-Checkliste, dass Unternehmen Modell- und Risikokarten verwenden, die es Benutzern ermöglichen, KI-Systeme zu verstehen und ihnen zu vertrauen und Voreingenommenheit und Datenschutz offen anzusprechen. usw. mögliche negative Folgen.

Diese Karten können Elemente wie Modelldetails, Architektur, Trainingsdatenmethoden und Leistungsmetriken enthalten. Überlegungen zu verantwortungsvoller KI und Bedenken hinsichtlich Fairness und Transparenz werden ebenfalls hervorgehoben.

12RAG: Optimierung großer Sprachmodelle

Retrieval Augmented Generation (RAG) ist eine Methode zur Optimierung der Fähigkeit großer Sprachmodelle, relevante Daten aus bestimmten Quellen abzurufen. Dies ist eine der Möglichkeiten, vorab trainierte Modelle zu optimieren oder bestehende Modelle auf der Grundlage neuer Daten neu zu trainieren, um die Leistung zu verbessern. OWASP empfiehlt Unternehmen, RAG zu implementieren, um den Wert und die Effektivität großer Sprachmodelle zu maximieren.

13. AI Red Team

Abschließend unterstreicht die OWASP-Checkliste die Bedeutung von AI Red Teaming, das gegnerische Angriffe auf KI-Systeme simuliert, um Schwachstellen zu identifizieren und bestehende Kontrollen und Abwehrmaßnahmen zu validieren. OWASP betont, dass Red Teams ein integraler Bestandteil einer umfassenden Sicherheitslösung mit generativer KI und großen Sprachmodellen sein sollten.

Es ist erwähnenswert, dass Unternehmen auch ein klares Verständnis der Red-Team-Dienste sowie der Systemanforderungen und -fähigkeiten externer generativer KI und großer Anbieter von Sprachmodellen haben müssen, um Richtlinienverstöße oder sogar rechtliche Probleme zu vermeiden.

Das obige ist der detaillierte Inhalt vonOWASP veröffentlicht Checkliste für Netzwerksicherheit und Governance für umfangreiche Sprachmodelle. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Was sind die Entwicklungstrends der künstlichen Intelligenz?

- BLIP-2 und InstructBLIP sind fest unter den ersten drei! Zwölf Hauptmodelle, sechzehn Listen, umfassende Bewertung des „multimodalen großen Sprachmodells'

- Das visuelle Talent großer Sprachmodelle: GPT kann auch visuelle Aufgaben durch kontextuelles Lernen lösen

- Der „Leseclub für große Sprachmodelle und Multiagentensysteme' startet diesen Samstag!

- Extrem lange Sequenzen, extrem schnell: LASP-Sequenzparallelität für eine neue Generation effizienter großer Sprachmodelle