Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI 0-Grenze für kostenlose kommerzielle Nutzung! Das große Modell Mencius 3-13B ist offiziell Open Source und wird mit Billionen von Token-Daten trainiert

0-Grenze für kostenlose kommerzielle Nutzung! Das große Modell Mencius 3-13B ist offiziell Open Source und wird mit Billionen von Token-Daten trainiertLanzhou Technology offiziell angekündigt: Das große Modell Mencius 3-13B ist offiziell Open Source!

Dieses große, kostengünstige, leichte Modell steht der akademischen Forschung uneingeschränkt offen und unterstützt die kostenlose kommerzielle Nutzung.

In verschiedenen Benchmark-Bewertungen wie MMLU, GSM8K und HUMAN-EVAL hat Mencius 3-13B eine gute Leistung gezeigt.

Gerade im Bereich leichter Großmodelle mit Parametern innerhalb von 20B sind die Chinesisch- und Englischkenntnisse besonders herausragend. Auch Mathematik- und Programmierkenntnisse stehen im Vordergrund.

△Die oben genannten Ergebnisse basieren auf 5-Schuss.

Berichten zufolge basiert das große Modell Mencius 3-13B auf der Llama-Architektur und die Datensatzgröße beträgt bis zu 3T-Tokens.

Der Korpus wird aus Webseiten, Enzyklopädien, sozialen Medien, Medien, Nachrichten und hochwertigen Open-Source-Datensätzen ausgewählt. Durch das kontinuierliche Training auf Billionen von Token mit mehrsprachigem Korpus verfügt das Modell über herausragende chinesische Fähigkeiten und berücksichtigt mehrsprachige Fähigkeiten.

Das große Modell Mencius 3-13B ist Open Source

Sie können das große Modell Mencius 3-13B in nur zwei Schritten verwenden.

Konfigurieren Sie zunächst die Umgebung.

pip install -r requirements.txt

Dann fang schnell an.

import torchfrom transformers import AutoModelForCausalLM, AutoTokenizertokenizer = AutoTokenizer.from_pretrained("Langboat/Mengzi3-13B-Base", use_fast=False, trust_remote_code=True)model = AutoModelForCausalLM.from_pretrained("Langboat/Mengzi3-13B-Base", device_map="auto", trust_remote_code=True)inputs = tokenizer('指令:回答以下问题。输入:介绍一下孟子。输出:', return_tensors='pt')if torch.cuda.is_available():inputs = inputs.to('cuda')pred = model.generate(**inputs, max_new_tokens=512, repetition_penalty=1.01, eos_token_id=tokenizer.eos_token_id)print(tokenizer.decode(pred[0], skip_special_tokens=True))Darüber hinaus stellen sie einen Beispielcode bereit, der für eine interaktive Einzelrunden-Inferenz mit dem Basismodell verwendet werden kann.

cd examplespython examples/base_streaming_gen.py --model model_path --tokenizer tokenizer_path

Wenn Sie das Modell verfeinern möchten, stellen sie auch relevante Dateien und Code bereit.

Tatsächlich wurden viele Details des Großmodells Mencius 3-13B bereits am 18. März auf der Technologie- und Produkteinführungskonferenz für Großmodelle in Lanzhou enthüllt.

Damals gaben sie an, dass die Schulung des Großmodells Mencius 3-13B abgeschlossen sei.

Zu den Gründen für die Wahl der 13B-Version erklärte Zhou Ming:

Zuallererst konzentriert sich Lanzhou klar auf die Bereitstellung von ToB-Szenarien, ergänzt durch ToC.

Die Praxis hat herausgefunden, dass die Parameter großer Modelle, die in ToB-Szenarien am häufigsten verwendet werden, meist 7B, 13B, 40B, 100B sind und die Gesamtkonzentration zwischen 10B und 100B liegt.

Zweitens erfüllt es innerhalb dieses Bereichs aus Sicht des ROI (Return on Investment) nicht nur die Bedürfnisse der Szene, sondern ist auch am kostengünstigsten.

Daher besteht Lanzhous Ziel seit langem darin, qualitativ hochwertige Industrie-Großmodelle innerhalb der Parameterskala 10B-100B zu entwickeln.

Als eines der ersten großen Unternehmerteams in China veröffentlichte Lanzhou im März letzten Jahres Mencius GPT V1 (MChat).

Im Januar dieses Jahres wurde Mencius Big Model GPT V2 (einschließlich Mencius Big Model-Standard, Mencius Big Model-Lightweight, Mencius Big Model-Finance, Mencius Big Model-Encoding) der Öffentlichkeit zugänglich gemacht.

Okay, interessierte Freunde können auf den Link unten klicken, um es zu erleben.

GitHub-Link: https://github.com/Langboat/Mengzi3

HuggingFace: https://huggingface.co/Langboat/Mengzi3-13B-Base

ModelScope: https: //www.modelscope.cn/models/langboat/Mengzi3-13B-Base

Wisemodel:https://wisemodel.cn/models/Langboat/Mengzi3-13B-Base

Das obige ist der detaillierte Inhalt von0-Grenze für kostenlose kommerzielle Nutzung! Das große Modell Mencius 3-13B ist offiziell Open Source und wird mit Billionen von Token-Daten trainiert. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Wie entfernt ich Duplikate in Excel? - Analytics VidhyaApr 15, 2025 am 09:20 AM

Wie entfernt ich Duplikate in Excel? - Analytics VidhyaApr 15, 2025 am 09:20 AMDatenintegrität: Entfernen von Duplikaten in Excel zur genauen Analyse Saubere Daten sind für eine effektive Entscheidungsfindung von entscheidender Bedeutung. Doppelte Einträge in Excel -Tabellen können zu Fehlern und unzuverlässigen Analysen führen. Diese Anleitung zeigt Ihnen, wie Sie DUP problemlos entfernen können

Top 10 telefonische Interviewtipps - Analytics VidhyaApr 15, 2025 am 09:19 AM

Top 10 telefonische Interviewtipps - Analytics VidhyaApr 15, 2025 am 09:19 AMBeherrschen Sie die Kunst des Telefoninterviews: Ihr Leitfaden zum Erfolg Ein erfolgreiches Telefoninterview kann Ihre Chancen auf die nächste Phase des Bewerbungsprozesses erheblich erhöhen. Dieser entscheidende erste Eindruck, oft der einzige Pre-Fac

Wie wird ich Statistiker?Apr 15, 2025 am 09:15 AM

Wie wird ich Statistiker?Apr 15, 2025 am 09:15 AMEinführung Stellen Sie sich vor, Sie hätten die Befugnis, fundierte Entscheidungen für sich und Ihr Unternehmen in Bereichen wie Gesundheitswesen, Finanzen oder Sport zu treffen. Das ist die Rolle eines Statistikers. Mit der zunehmenden Verwendung von Daten in Organisationen die Nachfrage nach Statist

Wie funktioniert KI? - Analytics VidhyaApr 15, 2025 am 09:14 AM

Wie funktioniert KI? - Analytics VidhyaApr 15, 2025 am 09:14 AMKünstliche Intelligenz: Ein umfassender Leitfaden Die Technologie hat es uns ermöglicht, uns eine Welt vorzustellen, in der Maschinen unsere Vorlieben verstehen, unsere Bedürfnisse vorwegnehmen und aus früheren Interaktionen lernen, um bessere Ergebnisse zu erzielen. Dies ist keine Science -Fiction; es ist

Was ist Pictogram -Diagramm? - Analytics VidhyaApr 15, 2025 am 09:09 AM

Was ist Pictogram -Diagramm? - Analytics VidhyaApr 15, 2025 am 09:09 AMEinführung In der Welt der Datenanalyse ist eine effektive Kommunikation der Schlüssel. Piktogramm -Diagramme bieten eine leistungsstarke Lösung, die Informationen in einem visuell ansprechenden und leicht verdaulichen Format präsentiert. Im Gegensatz zu komplexen Diagrammen und Figuren, Piktogrammen - auch

LAMA-3.1-STORM-8B: Die 8B LLM übertreffen Meta und HermesApr 15, 2025 am 09:08 AM

LAMA-3.1-STORM-8B: Die 8B LLM übertreffen Meta und HermesApr 15, 2025 am 09:08 AMLama 3.1 Storm 8b: Ein Durchbruch in effizienten Sprachmodellen Das Streben nach effizienten und genauen Sprachmodellen hat zur Entwicklung von Lama 3.1 Storm 8b geführt, ein signifikanter Fortschritt in der Kategorie von 8-Milliarden Parametermodell. Das raffinierte

Wie installiere ich Git? - Analytics VidhyaApr 15, 2025 am 09:07 AM

Wie installiere ich Git? - Analytics VidhyaApr 15, 2025 am 09:07 AMGIT: Ihr wesentlicher Leitfaden zur Versionskontrolle und Zusammenarbeit Git ist ein entscheidendes Instrument für Entwickler, die die Projektzusammenarbeit und die Versionskontrolle vereinfachen. Diese Anleitung enthält einfache Anweisungen für die Installation von Git unter Linux, MacOS und Wind

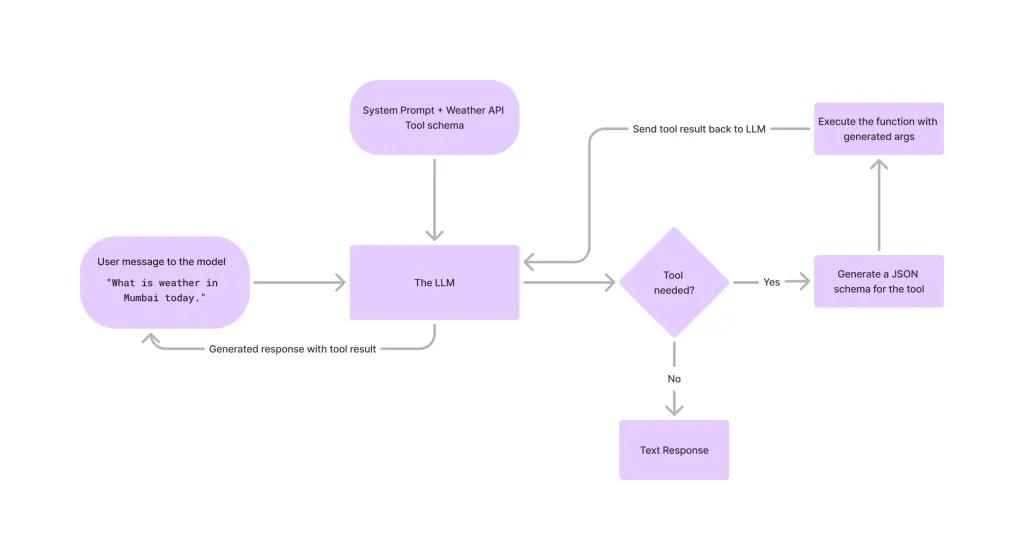

Werkzeuganruf in LLMsApr 14, 2025 am 11:28 AM

Werkzeuganruf in LLMsApr 14, 2025 am 11:28 AMGroße Sprachmodelle (LLMs) sind immer beliebter, wobei die Tool-Calling-Funktion ihre Fähigkeiten über die einfache Textgenerierung hinaus erweitert hat. Jetzt können LLMs komplexe Automatisierungsaufgaben wie dynamische UI -Erstellung und autonomes A erledigen

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Dreamweaver CS6

Visuelle Webentwicklungstools

Sicherer Prüfungsbrowser

Safe Exam Browser ist eine sichere Browserumgebung für die sichere Teilnahme an Online-Prüfungen. Diese Software verwandelt jeden Computer in einen sicheren Arbeitsplatz. Es kontrolliert den Zugriff auf alle Dienstprogramme und verhindert, dass Schüler nicht autorisierte Ressourcen nutzen.

SublimeText3 Linux neue Version

SublimeText3 Linux neueste Version

MantisBT

Mantis ist ein einfach zu implementierendes webbasiertes Tool zur Fehlerverfolgung, das die Fehlerverfolgung von Produkten unterstützen soll. Es erfordert PHP, MySQL und einen Webserver. Schauen Sie sich unsere Demo- und Hosting-Services an.

WebStorm-Mac-Version

Nützliche JavaScript-Entwicklungstools