Heim >Technologie-Peripheriegeräte >KI >Microsoft hat ein Dokument herausgegeben: Die Leistung des KI-Modells Phi-2 übertrifft Google Gemini Nano-2 mit einer Parametergröße von 2,7 Milliarden

Microsoft hat ein Dokument herausgegeben: Die Leistung des KI-Modells Phi-2 übertrifft Google Gemini Nano-2 mit einer Parametergröße von 2,7 Milliarden

- 王林nach vorne

- 2023-12-15 13:37:231451Durchsuche

Am 13. Dezember veröffentlichte Microsoft heute eine Pressemitteilung, in der es hieß, dass sein Modell Phi-2 2.7B dem von Google veröffentlichten Gemini Nano-2 3.2B in vielerlei Hinsicht überlegen sei.

Phi-2 2.7B-Modell

Berichten dieser Website zufolge veröffentlichte Microsoft im November letzten Jahres auf der Ignite 2023-Konferenz Phi-2 mit Parametern von 2,7 Milliarden und einer deutlich verbesserten Leistung im Vergleich zur Vorgängerversion

Microsoft veröffentlichte Phi-1 im Juni dieses Jahres mit nur 1,3 Milliarden Parametern, geeignet für Szenarien wie QA Q&A, Chat-Format und Code. Das Modell wird vollständig auf hochwertigen Daten trainiert und übertrifft Konkurrenzmodelle bei Benchmarks um das bis zu Zehnfache.

Microsoft hat im September dieses Jahres die Phi-1.5-Version aktualisiert, die ebenfalls 1,3 Milliarden Parameter enthält. Diese Version kann zum Schreiben von Gedichten, zum Schreiben von E-Mails, zum Schreiben von Geschichten und zum Zusammenfassen von Texten verwendet werden. In Benchmarks zu gesundem Menschenverstand, Sprachverständnis und Argumentation konnte das Modell in einigen Bereichen mit Modellen mit bis zu 10 Milliarden Parametern mithalten

Microsofts neueste Version von Phi-2 verfügt nun über 2,7 Milliarden Parameter, wenn auch in einem größeren Maßstab als frühere Versionen Verdoppelt, aber immer noch klein im Vergleich zu anderen Mainstream-Sprachmodellen

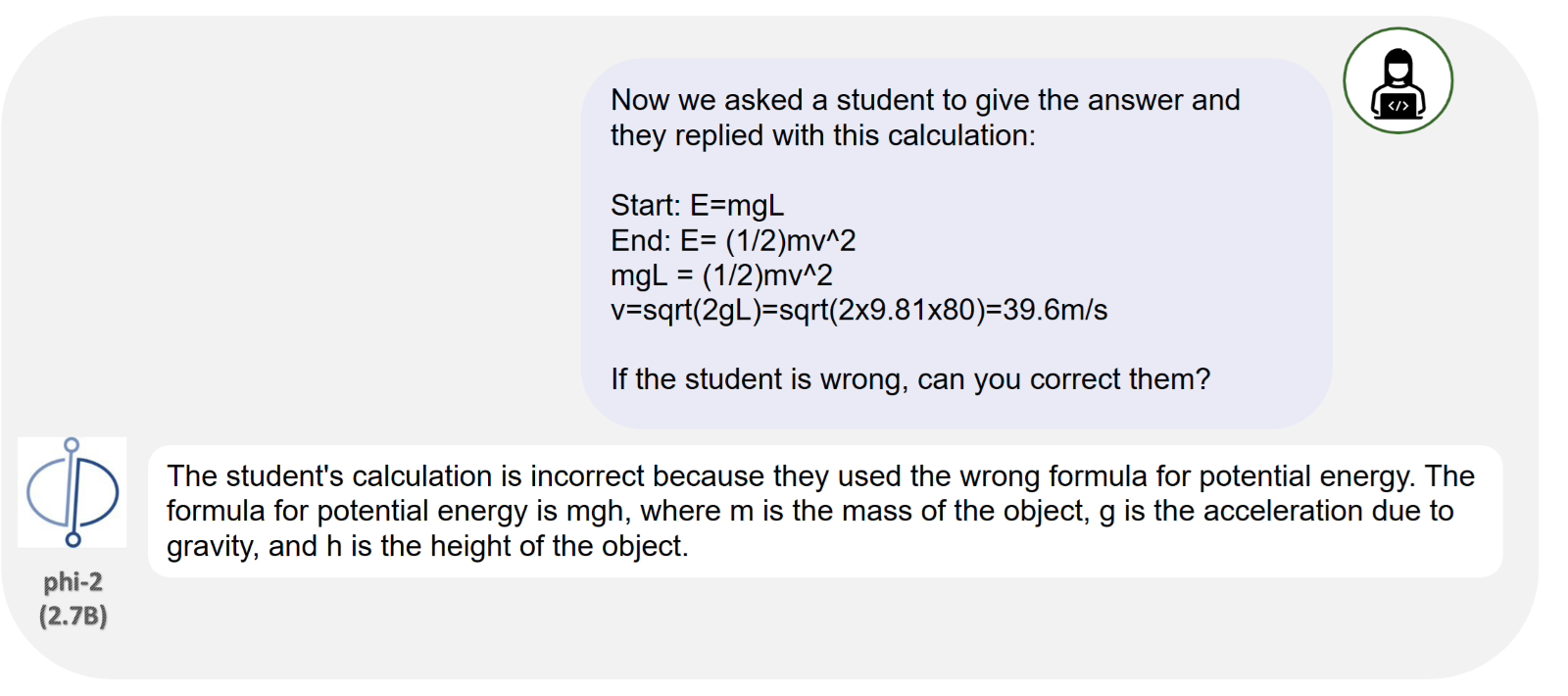

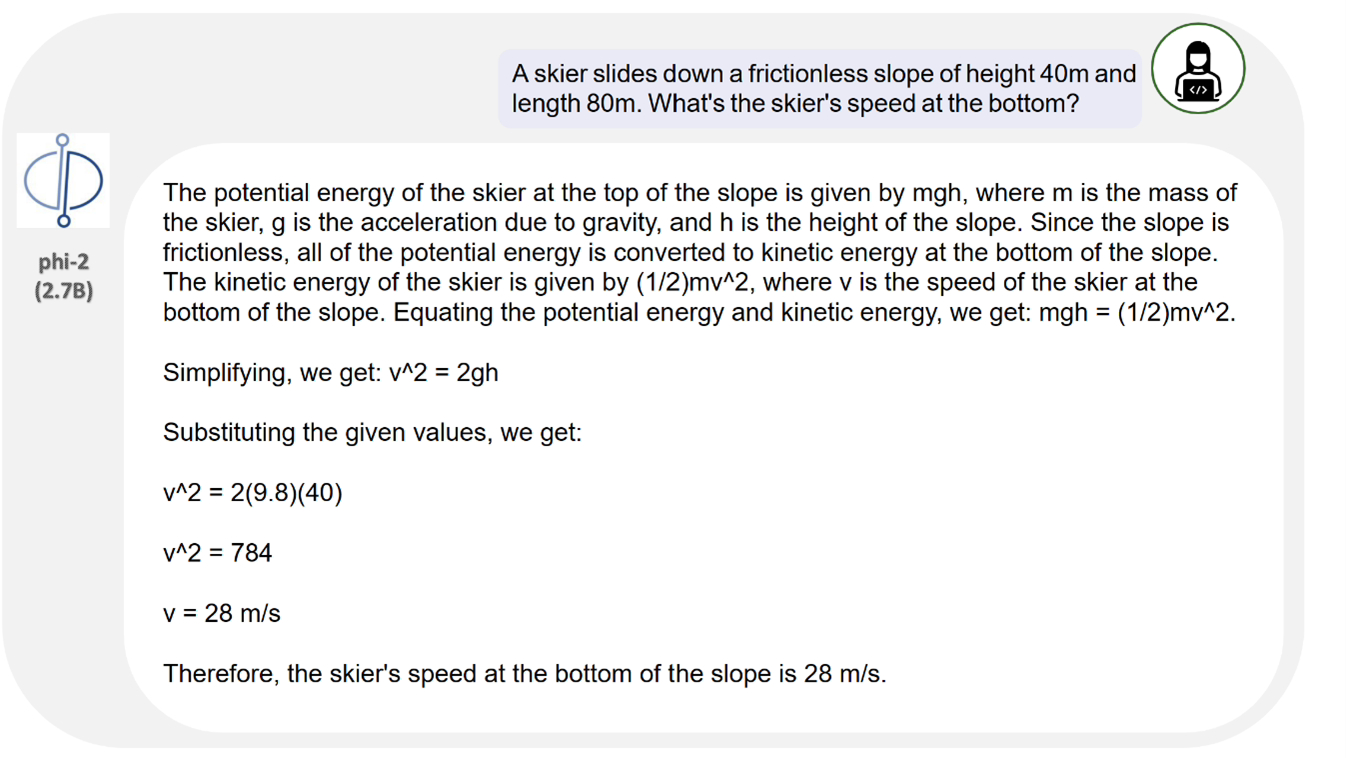

Laut Microsoft zeigt Phi-2 erhebliche Verbesserungen im logischen Denken und in der Sicherheit. Mit der richtigen Feinabstimmung und Anpassung sind kleine Sprachmodelle leistungsstarke Werkzeuge für Cloud- und Edge-Anwendungen.

Google Gemini Nano-2 3.2B

Gemini Nano ist eine Modellversion, die speziell für den nativen Betrieb auf kleinen Geräten entwickelt wurde. Die neueste Version 2.0 verfügt über 3,2 Milliarden Parameter und wird die erste sein, die auf Pixel 8 Pro-Modellen ausgestattet ist.

Wählen Sie in der Aufnahmeszene die Aufnahmedatei aus und klicken Sie auf die Registerkarte „Transkript“. Klicken Sie dann oben auf die Schaltfläche „Zusammenfassung“. Die App generiert dann mehrere Schlüsselpunkte im Zusammenhang mit dem Aufnahmeinhalt.

Bei der Gboard-Eingabemethode wird Gemini Nano „konversationsbewusste Antworten in hoher Qualität“ erzielen. WhatsApp wird die erste App sein, die intelligente Antworten unterstützt, und auch andere Apps werden nächstes Jahr Unterstützung erhalten.

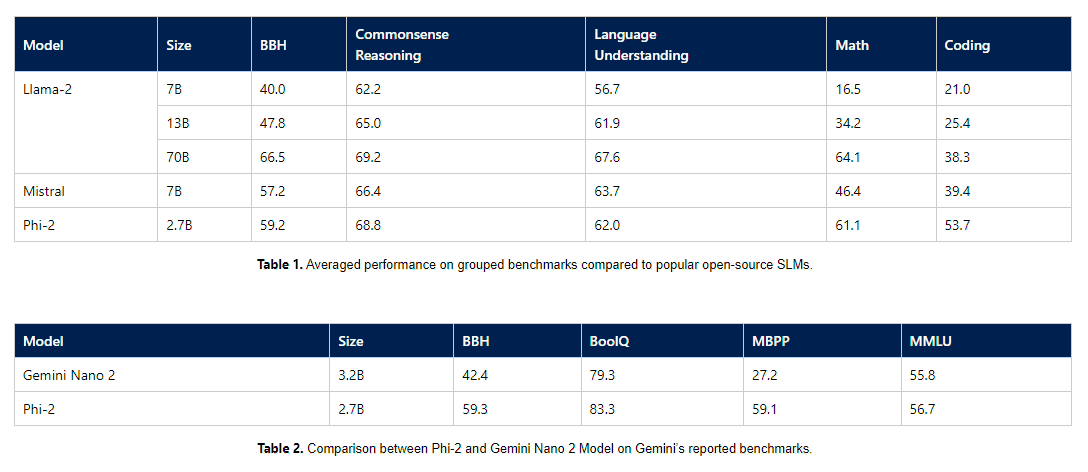

Vergleich

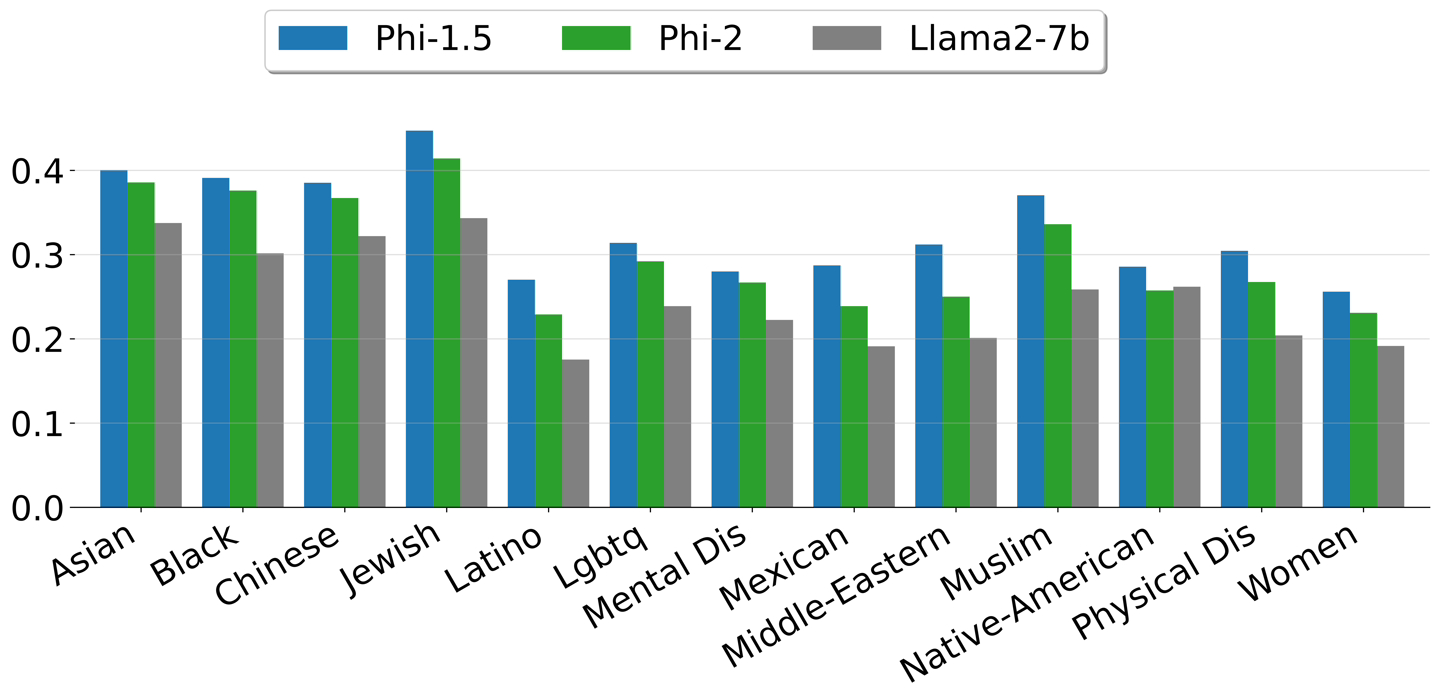

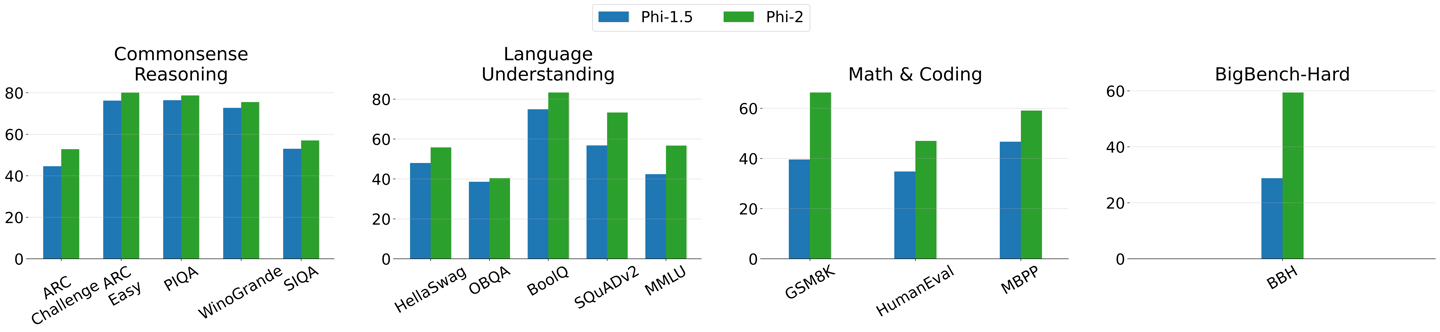

In seinem neuesten Blogbeitrag verglich Microsoft das Phi-2-Modell mit dem Gemini Nano-2-Modell von Google und gab an, dass Phi-2 in vielerlei Hinsicht eine bessere Leistung als das Gemini Nano-2-Modell aufweist.

Microsoft wies außerdem darauf hin, dass die Leistung von Phi-2 die 7 Milliarden Parameter von Llama-2 und die 13 Milliarden Parameter sowie die 7 Milliarden Parameter von Mistral übertroffen hat

Im Anhang der Website finden Sie die „offizielle Blogpost-Adresse“ von Microsoft, die interessierte Benutzer ausführlich lesen können.

Das obige ist der detaillierte Inhalt vonMicrosoft hat ein Dokument herausgegeben: Die Leistung des KI-Modells Phi-2 übertrifft Google Gemini Nano-2 mit einer Parametergröße von 2,7 Milliarden. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Was soll ich tun, wenn beim Einschalten der Oberfläche nur das Microsoft-Symbol angezeigt wird?

- Der Zukunftstrend der künstlichen Intelligenz

- Wofür wird Microsoft Translator verwendet?

- Was sind die Entwicklungsrichtungen der Künstlichen Intelligenz?

- Detaillierte Einführung zum Herunterladen von Microsoft Win7