Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI Microsoft führt die XOT-Technologie ein, um die Argumentationsfähigkeiten von Sprachmodellen zu verbessern

Microsoft führt die XOT-Technologie ein, um die Argumentationsfähigkeiten von Sprachmodellen zu verbessernMicrosoft führt die XOT-Technologie ein, um die Argumentationsfähigkeiten von Sprachmodellen zu verbessern

Nachrichten vom 15. November: Microsoft hat kürzlich eine Methode namens „Everything of Thought“ (XOT) auf den Markt gebracht, die von Google DeepMinds AlphaZero inspiriert ist und kompakte neuronale Netze verwendet, um die Argumentationsfähigkeiten von KI-Modellen zu verbessern.

- Vorschulungsphase: Das MCTS-Modul wird auf bestimmte Aufgaben vorab trainiert, um Domänenwissen über eine effektive Gedankensuche zu erlernen. Leichte, richtlinien- und wertschöpfungsnetzwerkgeführte Suche. Ideensuche: Während der Inferenz nutzt das vorab trainierte MCTS-Modul ein Richtlinien-/Wertenetzwerk, um die Ideenverläufe von LLM effizient zu erkunden und zu generieren.

- Gedankenkorrektur: LLM überprüft die Ideen von MCTS und identifiziert etwaige Fehler. Durch zusätzliche MCTS-Simulationen wurden Ideen für Überarbeitungen generiert.

- LLM-Begründung: Letzter Tipp, um LLM überarbeitete Ideen zur Lösung von Problemen zu geben.

PDF] hier bei, interessierte Benutzer können es ausführlich lesen.

Das obige ist der detaillierte Inhalt vonMicrosoft führt die XOT-Technologie ein, um die Argumentationsfähigkeiten von Sprachmodellen zu verbessern. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

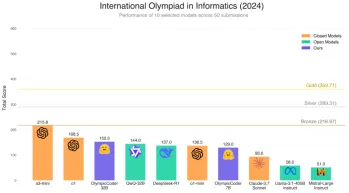

Schlägt das 7B -Model Olympiccoder von Face Claude 3.7?Apr 23, 2025 am 11:49 AM

Schlägt das 7B -Model Olympiccoder von Face Claude 3.7?Apr 23, 2025 am 11:49 AMDas Olympiccoder-7b von Face umarmt: Ein leistungsstarkes Open-Source-Code-Argumentationsmodell Das Rennen um die Entwicklung von Sprachmodellen mit oberen Code-fokussierten Sprachläufern und das Umarmungsgesicht hat sich dem Wettbewerb mit einem beeindruckenden Anwärter angeschlossen: Olympiccoder-7b, ein Produkt, ein Produkt, ein Produkt

4 neue Gemini -Funktionen, die Sie sich nicht leisten können, sich zu verpassenApr 23, 2025 am 11:48 AM

4 neue Gemini -Funktionen, die Sie sich nicht leisten können, sich zu verpassenApr 23, 2025 am 11:48 AMWie viele von Ihnen haben sich gewünscht, KI zu beantworten, als nur Fragen zu beantworten? Ich weiß, dass ich es habe, und in letzter Zeit bin ich erstaunt, wie es sich verändert. Bei KI -Chatbots geht es nicht mehr nur darum, zu chatten, sondern auch darum, zu erstellen, zu recherchieren

Camunda schreibt eine neue Punktzahl für die Agentic AI OrchestrationApr 23, 2025 am 11:46 AM

Camunda schreibt eine neue Punktzahl für die Agentic AI OrchestrationApr 23, 2025 am 11:46 AMDa Smart AI in alle Ebenen der Plattformen und Anwendungen und Anwendungen von Unternehmen integriert wird (wir müssen betonen, dass es sowohl leistungsstarke Kernwerkzeuge als auch einige weniger zuverlässige Simulationstools gibt), benötigen wir eine neue Reihe von Infrastrukturfunktionen, um diese Agenten zu verwalten. Camunda, ein in Berlin mit Sitz in Berlin ansässiger Prozessorchestrierungsunternehmen, ist der Ansicht, dass es intelligente KI dabei helfen kann, seine gebührende Rolle zu spielen und genaue Geschäftsziele und -regeln am neuen digitalen Arbeitsplatz auszurichten. Das Unternehmen bietet derzeit intelligente Orchestrierungsfunktionen an, mit denen Unternehmen das Modellieren, die Bereitstellung und Verwaltung von AI -Agenten helfen sollen. Was bedeutet das aus praktischer Sicht der praktischen Software -Engineering? Die Integration von Sicherheit und nicht deterministischen Prozessen Das Unternehmen sagte, der Schlüssel sei, Benutzern (in der Regel Datenwissenschaftler, Software) zuzulassen.

Gibt es einen Wert in einer kuratierten KI -Erfahrung in der Unternehmen?Apr 23, 2025 am 11:45 AM

Gibt es einen Wert in einer kuratierten KI -Erfahrung in der Unternehmen?Apr 23, 2025 am 11:45 AMAls ich die Google Cloud Next '25 besuchte, war ich gespannt, wie Google seine KI -Angebote unterscheiden würde. Jüngste Ankündigungen bezüglich Agentspace (hier erörtert) und die Customer Experience Suite (hier diskutiert) waren vielversprechend und betonten den Geschäftswert für den Geschäftswert

Wie finde ich das beste mehrsprachige Einbettungsmodell für Ihren Lappen?Apr 23, 2025 am 11:44 AM

Wie finde ich das beste mehrsprachige Einbettungsmodell für Ihren Lappen?Apr 23, 2025 am 11:44 AMAuswählen des optimalen mehrsprachigen Einbettungsmodells für Ihr RAG -System (Abruf Augmented Generation) In der heutigen miteinander verbundenen Welt ist es von größter Bedeutung, effektive mehrsprachige KI -Systeme aufzubauen. Robuste mehrsprachige Einbettungsmodelle sind für RE von entscheidender Bedeutung

Moschus: Robotaxis in Austin braucht alle 10.000 Meilen EingriffeApr 23, 2025 am 11:42 AM

Moschus: Robotaxis in Austin braucht alle 10.000 Meilen EingriffeApr 23, 2025 am 11:42 AMTeslas Austin Robotaxi Start: Ein genauerer Blick auf die Behauptungen von Musk Elon Musk kündigte kürzlich den bevorstehenden Robotaxi-Start von Tesla in Austin, Texas, an und stellte zunächst eine kleine Flotte von 10 bis 20 Fahrzeugen aus Sicherheitsgründen mit Plänen für eine schnelle Erweiterung ein. H

KIs schockierender Pivot: Vom Arbeitstool zum digitalen Therapeuten und LebenscoachApr 23, 2025 am 11:41 AM

KIs schockierender Pivot: Vom Arbeitstool zum digitalen Therapeuten und LebenscoachApr 23, 2025 am 11:41 AMDie Art und Weise, wie künstliche Intelligenz angewendet wird, kann unerwartet sein. Zunächst könnten viele von uns glauben, dass es hauptsächlich für kreative und technische Aufgaben wie das Schreiben von Code und das Erstellen von Inhalten verwendet wurde. Eine kürzlich von Harvard Business Review gemeldete Umfrage zeigt jedoch, dass dies nicht der Fall ist. Die meisten Benutzer suchen künstliche Intelligenz nicht nur für die Arbeit, sondern auch für Unterstützung, Organisation und sogar Freundschaft! In dem Bericht heißt es, dass die erste von AI -Anwendungsfällen Behandlung und Kameradschaft ist. Dies zeigt, dass die Verfügbarkeit rund um die Uhr und die Fähigkeit, anonyme, ehrliche Ratschläge und Feedback zu liefern, von großem Wert sind. Andererseits sind Marketingaufgaben (z. B. das Schreiben eines Blogs, das Erstellen von Social -Media -Beiträgen oder die Werbekopie) auf der beliebten Nutzungsliste viel niedriger. Warum ist das? Lassen Sie uns die Ergebnisse der Forschung sehen und wie sie weiterhin ist

Unternehmen rennen sich auf die Einführung von AI -AgentenApr 23, 2025 am 11:40 AM

Unternehmen rennen sich auf die Einführung von AI -AgentenApr 23, 2025 am 11:40 AMDer Aufstieg der AI -Agenten verändert die Geschäftslandschaft. Im Vergleich zur Cloud -Revolution wird vorausgesagt, dass die Auswirkungen von AI -Agenten exponentiell größer sind und vielversprechend sind, die Wissensarbeit zu revolutionieren. Die Fähigkeit, menschliche Entscheidungsmaki zu simulieren

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

DVWA

Damn Vulnerable Web App (DVWA) ist eine PHP/MySQL-Webanwendung, die sehr anfällig ist. Seine Hauptziele bestehen darin, Sicherheitsexperten dabei zu helfen, ihre Fähigkeiten und Tools in einem rechtlichen Umfeld zu testen, Webentwicklern dabei zu helfen, den Prozess der Sicherung von Webanwendungen besser zu verstehen, und Lehrern/Schülern dabei zu helfen, in einer Unterrichtsumgebung Webanwendungen zu lehren/lernen Sicherheit. Das Ziel von DVWA besteht darin, einige der häufigsten Web-Schwachstellen über eine einfache und unkomplizierte Benutzeroberfläche mit unterschiedlichen Schwierigkeitsgraden zu üben. Bitte beachten Sie, dass diese Software

MantisBT

Mantis ist ein einfach zu implementierendes webbasiertes Tool zur Fehlerverfolgung, das die Fehlerverfolgung von Produkten unterstützen soll. Es erfordert PHP, MySQL und einen Webserver. Schauen Sie sich unsere Demo- und Hosting-Services an.

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

mPDF

mPDF ist eine PHP-Bibliothek, die PDF-Dateien aus UTF-8-codiertem HTML generieren kann. Der ursprüngliche Autor, Ian Back, hat mPDF geschrieben, um PDF-Dateien „on the fly“ von seiner Website auszugeben und verschiedene Sprachen zu verarbeiten. Es ist langsamer und erzeugt bei der Verwendung von Unicode-Schriftarten größere Dateien als Originalskripte wie HTML2FPDF, unterstützt aber CSS-Stile usw. und verfügt über viele Verbesserungen. Unterstützt fast alle Sprachen, einschließlich RTL (Arabisch und Hebräisch) und CJK (Chinesisch, Japanisch und Koreanisch). Unterstützt verschachtelte Elemente auf Blockebene (wie P, DIV),