Heim >Technologie-Peripheriegeräte >KI >„Grundlegende Sicherheitsanforderungen für generative künstliche Intelligenzdienste' kann öffentlich kommentiert werden

„Grundlegende Sicherheitsanforderungen für generative künstliche Intelligenzdienste' kann öffentlich kommentiert werden

- PHPznach vorne

- 2023-10-12 17:37:04942Durchsuche

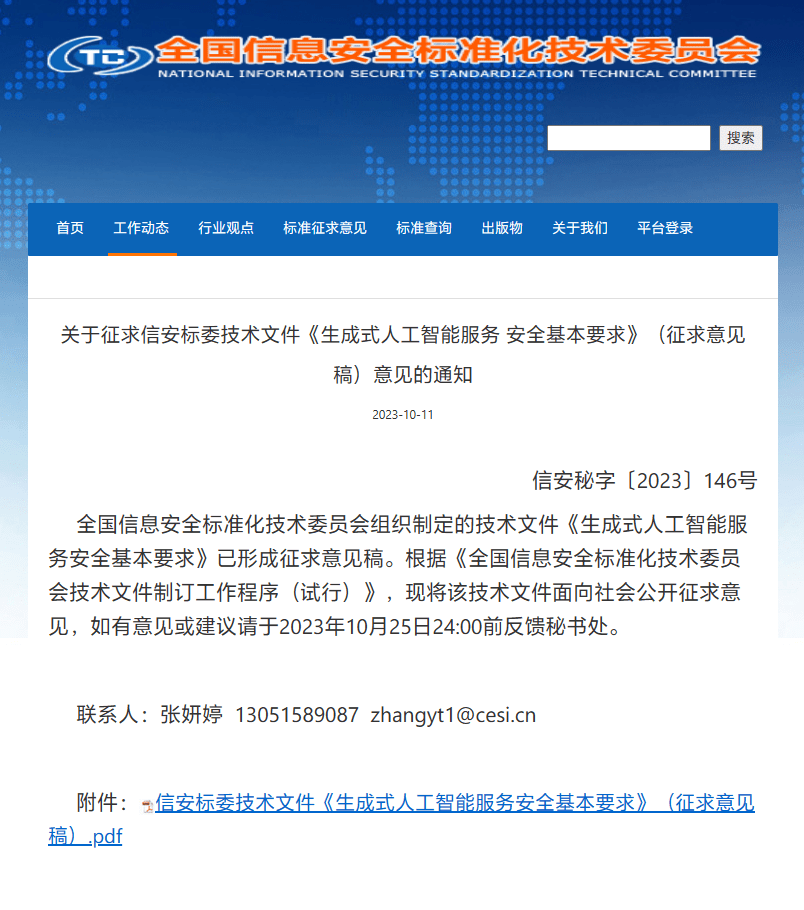

IT House berichtete am 12. Oktober, dass laut der offiziellen Website des National Information Security Standardization Technical Committee das vom Ausschuss erstellte technische Dokument „Grundlegende Anforderungen für die Sicherheit generativer künstlicher Intelligenzdienste“ (im Folgenden als „Anforderungen“ bezeichnet) erstellt wurde erstellt am 11. Oktober. Der Entwurf des technischen Dokuments ist nun für die Öffentlichkeit zugänglich. Wenn Sie Kommentare oder Vorschläge haben, geben Sie bitte bis zum 25. Oktober um 24:00 Uhr Feedback.

Die „Anforderungen“ enthalten die grundlegenden Sicherheitsanforderungen für generative künstliche Intelligenzdienste, einschließlich Korpussicherheit, Modellsicherheit, Sicherheitsmaßnahmen, Sicherheitsbewertung usw. Gilt für Anbieter generativer künstlicher Intelligenzdienste für die Öffentlichkeit in meinem Land, um den Dienst zu verbessern Sicherheitsniveau , oder der Anbieter führt selbst eine Sicherheitsbewertung durch oder beauftragt einen Dritten mit der Durchführung einer Sicherheitsbewertung. Es kann auch vorgesehen sein, dass relevante Behörden das Sicherheitsniveau von generativen künstlichen Intelligenzdiensten bewerten, um den Inhalt neu zu schreiben Ohne die ursprüngliche Bedeutung zu ändern, muss die Sprache auf Chinesisch umgeschrieben werden.

Bildquelle Pexels

IT House organisiert einige Anforderungen wie folgt:

- Erstellen Sie eine Blacklist mit Korpusquellen und verwenden Sie keine Daten aus Blacklist-Quellen für das Training.

- Eine Sicherheitsbewertung sollte für jedes Quellkorpus durchgeführt werden, wenn der Inhalt eines einzelnen Quellkorpus mehr als 5 % illegale und schädliche Informationen enthält, sollte er zur schwarzen Liste hinzugefügt werden.

- Bei der Verwendung von Korpussen, die personenbezogene Daten enthalten, sollten Sie die Genehmigung und Zustimmung des entsprechenden Betroffenen der personenbezogenen Daten einholen oder andere Bedingungen für die rechtmäßige Nutzung der personenbezogenen Daten erfüllen.

- Bei der Verwendung von Korpussen, die biometrische Informationen wie Gesichter enthalten, sollte eine schriftliche Genehmigung und Zustimmung der entsprechenden Person für personenbezogene Daten eingeholt werden oder andere Bedingungen für die rechtmäßige Verwendung der biometrischen Informationen erfüllt sein.

- Die Annotatoren sollten selbst beurteilt werden, diejenigen, die den Test bestehen, sollten Annotationsqualifikationen erhalten, und es sollte einen Mechanismus für die regelmäßige Umschulung und Bewertung sowie einen Mechanismus zur Aussetzung oder Aufhebung der Annotationsqualifikationen bei Bedarf geben.

- Während des Trainingsprozesses sollte die Sicherheit der generierten Inhalte einer der Hauptaspekte für die Bewertung der Qualität der generierten Ergebnisse sein.

- Wenn Dienste über eine interaktive Schnittstelle bereitgestellt werden, sollten die folgenden Informationen an prominenter Stelle, beispielsweise auf der Startseite der Website, der Öffentlichkeit zugänglich gemacht werden:

Der Inhalt, der neu geschrieben werden muss, ist: – Anwendbare Personen, Anlässe, Zwecke und andere Informationen

-Nutzung des Basismodells von Drittanbietern.

- Die Notwendigkeit, Anwendbarkeit und Sicherheit des Einsatzes generativer künstlicher Intelligenz in verschiedenen Bereichen innerhalb des Leistungsumfangs sollte vollständig nachgewiesen werden.

Laut früheren Berichten von IT House gibt es sieben Abteilungen, darunter die Cyberspace Administration of China, die Nationale Entwicklungs- und Reformkommission, das Bildungsministerium, das Ministerium für Wissenschaft und Technologie, das Ministerium für Industrie und Informationstechnologie und das Ministerium für öffentliche Sicherheit , und die staatliche Verwaltung für Radio und Fernsehen hat am 10. Juli die „Vorläufigen Maßnahmen für die Verwaltung generativer künstlicher Intelligenzdienste“ erlassen. Diese Maßnahme wird am 15. August umgesetzt

Die „Maßnahmen“ legen fest, dass niemand die Vorteile von Algorithmen, Daten, Plattformen usw. zur Durchsetzung von Monopolen und unlauterem Wettbewerb nutzen darf, die körperliche und geistige Gesundheit anderer nicht gefährden und die Bildrechte anderer nicht verletzen darf. Reputationsrechte, Ehrenrechte, Datenschutzrechte und persönliche Informationsrechte werden wirksame Maßnahmen ergriffen, um die Transparenz generativer künstlicher Intelligenzdienste zu verbessern und die Genauigkeit und Zuverlässigkeit der generierten Inhalte zu verbessern.

Um den Inhalt neu zu schreiben, ohne die ursprüngliche Bedeutung zu ändern, muss die Sprache auf Chinesisch umgeschrieben werden

Das obige ist der detaillierte Inhalt von„Grundlegende Sicherheitsanforderungen für generative künstliche Intelligenzdienste' kann öffentlich kommentiert werden. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Was ist die UnionPay Trusted Service-Sicherheitskomponente?

- Zhang Yong sagte, Alibaba werde vollständig in den Aufbau groß angelegter generativer Modelle für künstliche Intelligenz investieren.

- Wie prognostizieren Sie, dass generative KI die Zukunft der Arbeit verändern wird?

- Baichuan Intelligence führt die Registrierung generativer künstlicher Intelligenz ein und öffnet die öffentlichen Dienste vollständig