Heim >Technologie-Peripheriegeräte >KI >Das Weltmodell glänzt! Der Realismus dieser über 20 autonomen Fahrszenariodaten ist unglaublich ...

Das Weltmodell glänzt! Der Realismus dieser über 20 autonomen Fahrszenariodaten ist unglaublich ...

- PHPznach vorne

- 2023-10-09 15:01:20760Durchsuche

Denken Sie, dass das ein langweiliges Selbstfahrvideo ist?

Die ursprüngliche Bedeutung dieses Inhalts muss nicht geändert werden, er muss ins Chinesische umgeschrieben werden

Kein einziger Frame ist „echt“.

Unterschiedliche Straßenbedingungen, unterschiedliche Wetterbedingungen, mehr als 20 Situationen können simuliert werden, und der Effekt ist genau wie im Original.

Das Weltmodell stellt einmal mehr seine mächtige Rolle unter Beweis! Dieses Mal leitete LeCun es aufgeregt weiter, nachdem er es gesehen hatte

Der obige Effekt wird durch die neueste Version von GAIA-1 erzielt.

Es verfügt über eine Skala von 9 Milliarden Parametern und ist mit 4700 StundenFahrvideos trainiert, um durch die Eingabe von Videos, Text oder Vorgängen den Effekt zu erzielen, selbstfahrende Videos zu generieren.

Der unmittelbarste Vorteil ist die Möglichkeit, zukünftige Ereignisse besser vorherzusagen. Es kann mehr als 20 Szenarien simulieren und dadurch die Sicherheit des autonomen Fahrens weiter verbessern und die Kosten senken

Das Kreativteam sagte, dass dies die Spielregeln für autonomes Fahren ändern wird!

Wie wird GAIA-1 umgesetzt? Tatsächlich haben wir den vom Wayve-Team entwickelten GAIA-1 bereits in Autonomous Driving Daily ausführlich vorgestellt: ein generatives Weltmodell für autonomes Fahren. Wenn Sie daran interessiert sind, können Sie auf unserem offiziellen Konto relevante Inhalte lesen!

Je größer der Maßstab, desto besser die Wirkung

GAIA-1 ist ein multimodales generatives Weltmodell, das durch die Integration mehrerer Wahrnehmungsmethoden wie Sehen, Hören und Sprache Ausdrücke der Welt verstehen und erzeugen kann. Dieses Modell verwendet Deep-Learning-Algorithmen, um aus einer großen Datenmenge die Struktur und Gesetze der Welt zu erlernen und zu begründen. Ziel von GAIA-1 ist es, die menschliche Wahrnehmung und kognitiven Fähigkeiten zu simulieren, um die Welt besser zu verstehen und mit ihr zu interagieren. Es hat breite Anwendungsmöglichkeiten in vielen Bereichen, darunter autonomes Fahren, Robotik und virtuelle Realität. Durch kontinuierliches Training und Optimierung wird sich GAIA-1 weiterentwickeln und verbessern und zu einem intelligenteren und umfassenderen Weltmodell werden Die Eigenschaften werden genau gesteuert

und Videos können

mit nur Textaufforderungen generiertwerden.

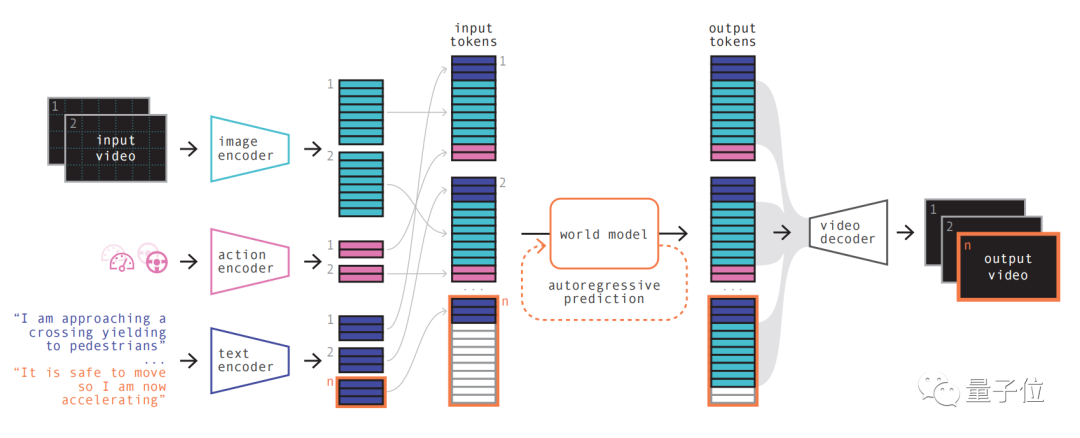

Das Prinzip seines Modells ähnelt dem großer Sprachmodelle, d Vorhersage des nächsten im Sequenz-Token. Das Diffusionsmodell wird dann verwendet, um hochwertige Videos aus dem Sprachraum des Weltmodells zu generieren.

Das Prinzip seines Modells ähnelt dem großer Sprachmodelle, d Vorhersage des nächsten im Sequenz-Token. Das Diffusionsmodell wird dann verwendet, um hochwertige Videos aus dem Sprachraum des Weltmodells zu generieren.

Die spezifischen Schritte sind wie folgt:

Der erste Schritt ist einfach zu verstehen, nämlich das Neukodieren, Anordnen und Kombinieren verschiedener Eingaben. Verschiedene Eingaben können in eine gemeinsame Darstellung projiziert werden, indem spezielle Encoder zum Codieren verschiedener Eingaben verwendet werden. Text- und Video-Encoder trennen und betten die Eingabe ein, während die operativen Darstellungen einzeln in eine gemeinsame Darstellung projiziert werden. Diese codierten Darstellungen sind zeitlich konsistent. Nach Permutationen kommt der Schlüsselteil, das Weltmodell, auf die Bühne.

Verschiedene Eingaben können in eine gemeinsame Darstellung projiziert werden, indem spezielle Encoder zum Codieren verschiedener Eingaben verwendet werden. Text- und Video-Encoder trennen und betten die Eingabe ein, während die operativen Darstellungen einzeln in eine gemeinsame Darstellung projiziert werden. Diese codierten Darstellungen sind zeitlich konsistent. Nach Permutationen kommt der Schlüsselteil, das Weltmodell, auf die Bühne.

Als autoregressiver Transformer hat er die Fähigkeit, den nächsten Satz von Bild-Tokens in der Sequenz vorherzusagen. Es berücksichtigt nicht nur frühere Bild-Token, sondern berücksichtigt gleichzeitig auch Kontextinformationen von Text und Aktionen. Der vom Modell generierte Inhalt behält nicht nur die Konsistenz mit dem Bild bei, sondern auch mit den vorhergesagten Texten und Aktionen. Teameinführung, GAIA Die Größe des Weltmodells in -1 beträgt

6,5 Milliarden Parameter, die 15 Tage lang auf 64 A100 trainiert wurden.

Durch die Verwendung eines Videodecoders und eines Videodiffusionsmodells werden diese Token schließlich wieder in Video umgewandelt.

In diesem Schritt geht es um die semantische Qualität, Bildgenauigkeit und zeitliche Konsistenz des Videos. Der Videodecoder von GAIA-1 hat eine Skala von 2,6 Milliarden Parametern und wurde 15 Tage lang mit 32 A100 trainiert. Es ist erwähnenswert, dass GAIA-1 nicht nur im Prinzip dem großen Sprachmodell ähnelt, sondern auch die Merkmale aufweist: Mit zunehmender Modellskala verbessert sich die Generierungsqualität. Das Team verglich die zuvor im Juni veröffentlichte frühe Version mit dem neuesten Effekt Letzterer ist 480-mal größer als ersterer. Sie können intuitiv erkennen, dass die Videodetails und die Auflösung deutlich verbessert wurden. In Bezug auf praktische Anwendungen hat GAIA-1 auch Auswirkungen gehabt. Sein Kreativteam sagte, dass dies die Regeln des autonomen Fahrens ändern wird. Die Gründe liegen in drei Aspekten: Zuallererst kann das Weltmodell in Bezug auf die Sicherheit die Zukunft simulieren und der KI das geben Die Fähigkeit, eigene Entscheidungen umzusetzen, ist für die Sicherheit des autonomen Fahrens von entscheidender Bedeutung. Zweitens sind Trainingsdaten auch für das autonome Fahren sehr wichtig. Die generierten Daten sind sicherer, günstiger und unbegrenzt skalierbar. Generative KI kann eine große Herausforderung des autonomen Fahrens lösen – Long-Tail-Szenarien. Es kann mehr Grenzfälle bewältigen, beispielsweise die Begegnung mit Fußgängern, die bei nebligem Wetter die Straße überqueren. Dies wird die Leistung des autonomen Fahrens weiter verbessern GAIA-1 stammt vom britischen Startup für autonomes Fahren Wayve. Wayve wurde 2017 gegründet. Zu den Investoren zählen Microsoftusw. und seine Bewertung hat Unicorn erreicht. Die Gründer sind die derzeitigen CEOs Alex Kendall und Amar Shah (die Führungsseite der offiziellen Website des Unternehmens enthält keine Informationen mehr). Beide haben ihren Abschluss an der Universität Cambridge und einen Doktortitel in maschinellem Lernen. Auf der technischen Roadmap Wie Tesla befürwortet Wayve eine rein visuelle Lösung mit Kameras, verzichtet schon sehr früh auf hochpräzise Karten und folgt konsequent dem Weg der „sofortigen Wahrnehmung“. Vor nicht allzu langer Zeit sorgte auch ein weiteres vom Team herausgebrachtes großes Modell LINGO-1 für Aufsehen. Dieses selbstfahrende Modell kann während der Fahrt Erklärungen in Echtzeit generieren und dadurch die Interpretierbarkeit des Modells weiter verbessern. Im März dieses Jahres hat Bill Gates auch ein selbstfahrendes Auto von Wayve ausprobiert. Papieradresse: https://arxiv.org/abs/2309.17080 Der Inhalt, der neu geschrieben werden muss, ist: Originallink: https://mp.weixin.qq. com/ s/bwTDovx9-UArk5lx5pZPag

Wer ist Wayve?

Das obige ist der detaillierte Inhalt vonDas Weltmodell glänzt! Der Realismus dieser über 20 autonomen Fahrszenariodaten ist unglaublich .... Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- So erstellen Sie ein mathematisches Modell mit Python

- Wie läuft beim Datenbankdesign die Konvertierung eines ER-Diagramms in ein relationales Datenmodell ab?

- Was sind in der Datenbanktechnologie die vier wichtigsten Datenmodelle?

- Ein Artikel über die Anwendung der SLAM-Technologie beim autonomen Fahren

- Besprechen Sie den aktuellen Status und die Entwicklungstrends der Technologie zur Vorhersage der Flugbahn des autonomen Fahrens