Heim >Technologie-Peripheriegeräte >KI >Mit 13.000 Sternen steht die Open-Source-Version des Code-Interpreters an der Spitze der GitHub-Hotlist und kann lokal ausgeführt werden und auf das Internet zugreifen.

Mit 13.000 Sternen steht die Open-Source-Version des Code-Interpreters an der Spitze der GitHub-Hotlist und kann lokal ausgeführt werden und auf das Internet zugreifen.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-09-17 19:13:011322Durchsuche

Im Juli dieses Jahres hat OpenAI ein leistungsstarkes Plug-in eingeführt – Code Interpreter (Code-Interpreter), das Codelösungen basierend auf den natürlichen Sprachanforderungen des Benutzers generieren und ausführen und letztendlich die Datenanalyse abschließen, Diagramme erstellen und Dateien bearbeiten kann usw. Aufgabe.

Allerdings weist der Code Interpreter von OpenAI einige spezifische Einschränkungen auf. Das Plugin läuft in einer kontrollierten Remote-Umgebung, wird gehostet und ist Closed Source, was bedeutet, dass der Entwickler nur begrenzte Kontrolle über lokale Einstellungen hat. Darüber hinaus hat Code Interpreter keinen Zugang zum Internet und unterliegt bestimmten Einschränkungen hinsichtlich der Größe hochgeladener Dateien und der Laufzeit.

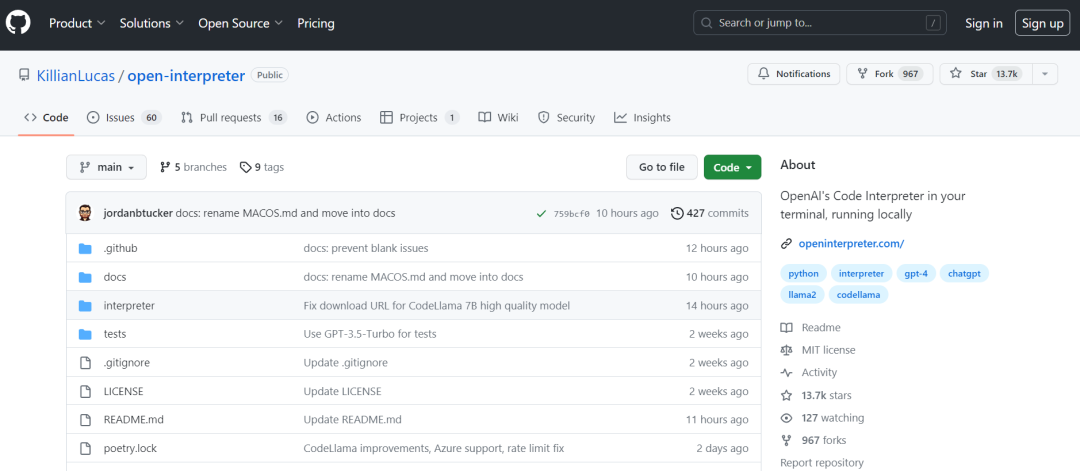

Jetzt hat ein Open-Source-Projekt namens Open Interpreter diese Probleme gelöst. Open Interpreter kann in einer lokalen Umgebung mit Internetzugang ausgeführt werden, unterliegt keinen Einschränkungen hinsichtlich der Dateigröße oder Laufzeit und kann jedes Paket oder jede Bibliothek nutzen. Das Projekt ist erst seit einer Woche online und hat bereits 13.000 Sterne erhalten Homepage: https://openinterpreter.com/

- Mit der GPT-4-API und in Kombination mit Open Interpreter kann Python-Code in der lokalen Umgebung oder in Google Colab ausgeführt werden. Dies macht GPT-4 sehr leistungsfähig. Über Open Interpreter können Benutzer Computer steuern, um verschiedene Aufgaben in natürlicher Sprache auszuführen, z. B. PDFs zusammenzufassen, Datensätze zu visualisieren und Browser zu steuern.

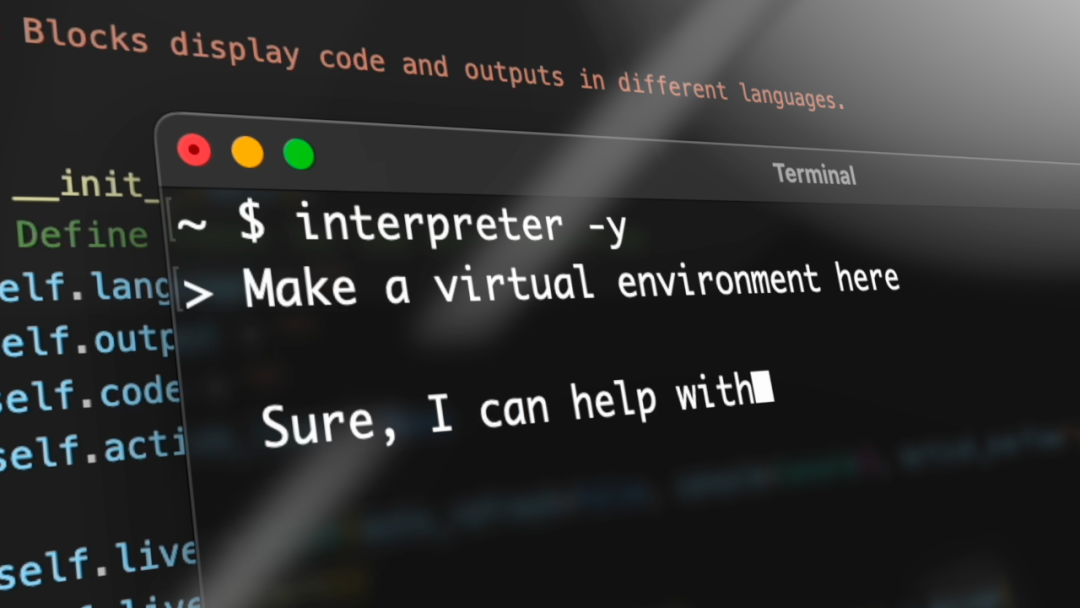

- Am Beispiel von Apple-Computern können Benutzer natürliche Wörter in den Mac eingeben Terminalschnittstelle Sprachbefehle, die die Bedürfnisse des Benutzers erfüllen, indem sie einen Interpreter öffnen. Sie können Ihr System beispielsweise in den Dunkelmodus schalten, indem Sie den Befehl

eingeben Aufgaben in der Kalendersoftware erledigen und per E-Mail an jemanden senden:

Sie können sogar eine einfache Pomodoro-Software schreiben:

Darüber hinaus kann Open Interpreter auch mathematische Probleme durch die Ausführung von Python-Code lösen . Um beispielsweise die Gleichung 10x + 14 = 12 zu lösen:

In Bezug auf Installation und Verwendung ist die Installation von Open Interpreter sehr einfach und erfordert nur eine Codezeile:

pip install open-interpreter

Nach dem Wenn die Installation abgeschlossen ist, geben Sie im Terminal „Interpreter“ ein, um sie zu starten. Verwenden Sie „Open Interpreter“.

Open Interpreter ermöglicht LLM die lokale Ausführung von Code in Python, Javascript, Shell und anderen Sprachen. Wenn keine GPT-4-API vorhanden ist, können Sie auch das Open-Source-Modell Code Llama über die folgende Befehlszeile verwenden:

interpreter —local

oder die folgende Befehlszeile verwenden, um gpt-3.5-turbo zu verwenden:

oder die folgende Befehlszeile verwenden, um gpt-3.5-turbo zu verwenden:

interpreter —fast

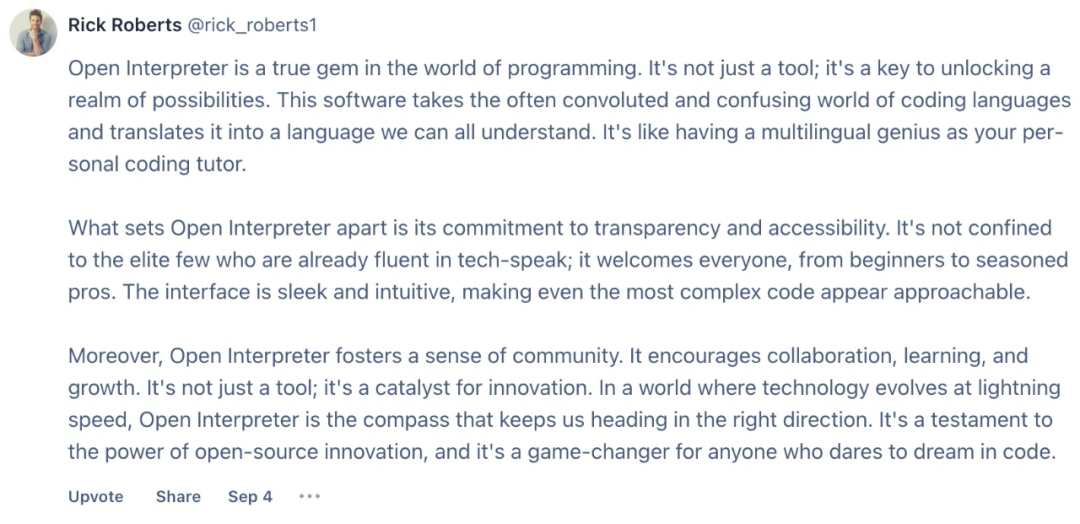

Open Interpreter 迅速在机器学习社区爆火,很多网友都称赞其是一个非常优秀的项目:

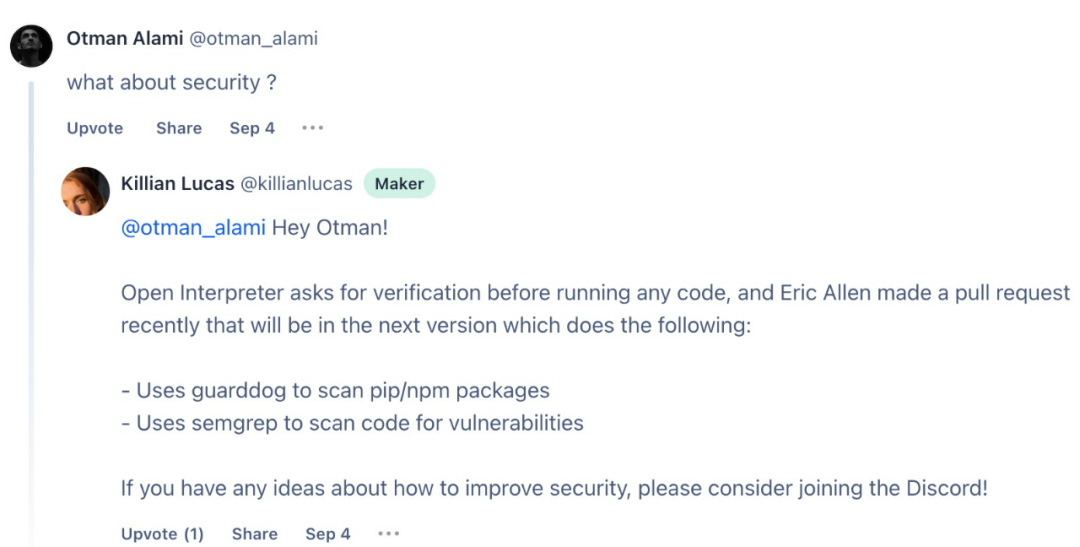

还有网友关心 Open Interpreter 的安全问题。对此,项目作者回应道:「Open Interpreter 在运行任何代码之前都会要求进行验证」。

项目作者还表示后续将把 Open Interpreter 开发成一个桌面应用程序:

对于那些对这个强大又有趣的开源项目感兴趣的读者们,不妨赶快去试试看吧

Das obige ist der detaillierte Inhalt vonMit 13.000 Sternen steht die Open-Source-Version des Code-Interpreters an der Spitze der GitHub-Hotlist und kann lokal ausgeführt werden und auf das Internet zugreifen.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!