Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI ChatGPT, das Sprache verstehen kann, ist da: 10 Stunden Aufzeichnung sind enthalten, und Sie können fragen, was Sie wollen.

ChatGPT, das Sprache verstehen kann, ist da: 10 Stunden Aufzeichnung sind enthalten, und Sie können fragen, was Sie wollen.Große Sprachmodelle (LLM) verändern die Erwartungen der Benutzer in jeder Branche. Die Entwicklung generativer KI-Produkte, die sich auf die menschliche Sprache konzentrieren, bleibt jedoch schwierig, da Audiodateien eine Herausforderung für große Sprachmodelle darstellen.

Eine wesentliche Herausforderung bei der Anwendung von LLM auf Audiodateien besteht darin, dass LLM durch sein Kontextfenster begrenzt ist. Bevor eine Audiodatei in LLM eingespeist werden kann, muss sie in Text konvertiert werden. Je länger die Audiodatei ist, desto größer ist die technische Herausforderung, die Einschränkungen des LLM-Kontextfensters zu umgehen. Aber in Arbeitsszenarien benötigen wir oft LLM, um uns bei der Verarbeitung sehr langer Sprachdateien zu helfen, beispielsweise beim Extrahieren des Kerninhalts aus einer mehrstündigen Besprechungsaufzeichnung oder beim Finden der Antwort auf eine bestimmte Frage aus einem Interview ...

Vor kurzem hat das Spracherkennungs-KI-Unternehmen AssemblyAI ein neues Modell namens LeMUR auf den Markt gebracht. So wie ChatGPT Dutzende Seiten PDF-Text verarbeitet, kann LeMUR bis zu 10 Stunden an Aufzeichnungen transkribieren und verarbeiten und Benutzern dann dabei helfen, den Kerninhalt der Rede zusammenzufassen und vom Benutzer eingegebene Fragen zu beantworten.

Testadresse: https://www.assemblyai.com/playground/v2/source

LeMUR nutzt große Sprachmodelle, um erkannte Sprache zu verstehen (Verwendung großer Sprachmodelle zum Verstehen Recognized Speech) ist ein neues Framework, das leistungsstarkes LLM auf transkribierte Sprache anwendet. Mit nur einer Codezeile (über das Python SDK von AssemblyAI) kann LeMUR die Transkription von bis zu 10 Stunden Audioinhalt schnell verarbeiten und diese effektiv in etwa 150.000 Token umwandeln. Im Gegensatz dazu können Standard-LLMs innerhalb der Einschränkungen ihres Kontextfensters nur bis zu 8 KB oder etwa 45 Minuten transkribiertes Audio aufnehmen.

Um die Komplexität der Anwendung von LLM auf transkribierte Audiodateien zu reduzieren, umfasst die Pipeline von LeMUR hauptsächlich intelligente Segmentierung, eine schnelle Vektordatenbank und mehrere Argumentationsschritte (wie Denkkettenaufforderungen und Selbsteinschätzung). wie unten gezeigt:

Abbildung 1: Die Architektur von LeMUR ermöglicht es Benutzern, lange und/oder mehrere Audiotranskriptionsdateien mit einem einzigen API-Aufruf an LLM zu senden.

In Zukunft wird LeMUR voraussichtlich im Kundenservice und in anderen Bereichen weit verbreitet sein.

LeMUR eröffnet einige erstaunliche neue Möglichkeiten, die ich noch vor ein paar Jahren nicht für möglich gehalten hätte. Es fühlt sich wirklich erstaunlich an, mühelos wertvolle Erkenntnisse gewinnen zu können, etwa zur Ermittlung der besten Maßnahmen und zu anspruchsvollen Anrufergebnissen wie Verkäufen, Terminen oder dem Zweck des Anrufs. ——Ryan Johnson, Chief Product Officer bei CallRail, einem Technologieunternehmen für Anrufverfolgung und Analysedienste

Welche Möglichkeiten eröffnet LeMUR?

LLM auf mehrere Audiotexte anwenden

Mit LeMUR können Benutzer LLM-Verarbeitungsfeedback für mehrere Audiodateien gleichzeitig sowie bis zu 10 Stunden Sprachtranskriptionsergebnisse und die Länge des konvertierten Textes erhalten Token Bis zu 150.000.

Zuverlässige, sichere Ausgabe

Da LeMUR Sicherheitsmaßnahmen und Inhaltsfilter enthält, erhalten Benutzer Antworten von LLM, die weniger schädlich oder voreingenommen sind.

Ergänzender Kontext

Während der Inferenz können zusätzliche Kontextinformationen hinzugefügt werden, die LLM nutzen kann, um bei der Ausgabegenerierung personalisierte und genauere Ergebnisse zu liefern.

Modulare, schnelle Integration

LeMUR gibt strukturierte Daten immer in einer verarbeitbaren JSON-Form zurück. Benutzer können das Ausgabeformat von LeMUR weiter anpassen, um sicherzustellen, dass die vom LLM gegebene Antwort das Format hat, das von ihrer nächsten Geschäftslogik erwartet wird (z. B. Konvertieren der Antwort in einen booleschen Wert). In diesem Prozess müssen Benutzer keinen spezifischen Code mehr schreiben, um die Ausgabe von LLM zu verarbeiten.

Testergebnisse

Laut dem von AssemblyAI bereitgestellten Testlink hat Machine Heart LeMUR getestet.

Die Benutzeroberfläche von LeMUR unterstützt zwei Dateieingabemethoden: Hochladen von Audio- und Videodateien oder Einfügen von Weblinks.

Wir haben aktuelle Interviewdaten von Hinton als Input verwendet, um die Leistung von LeMUR zu testen.

Nach dem Hochladen fordert uns das System auf, eine Weile zu warten, da die Sprache zunächst in Text umgewandelt werden muss.

Die Schnittstelle nach der Transkription sieht wie folgt aus:

Auf der rechten Seite der Seite können wir LeMUR bitten, das Interview zusammenzufassen oder Fragen zu beantworten. LeMUR kann die Aufgabe grundsätzlich problemlos erledigen:

Wenn es sich bei der zu verarbeitenden Stimme um eine Rede oder eine Kundendienstantwort handelt, können Sie LeMUR auch um Verbesserungsvorschläge bitten.

Allerdings scheint LeMUR Chinesisch noch nicht zu unterstützen. Interessierte Leser können es ausprobieren.

Das obige ist der detaillierte Inhalt vonChatGPT, das Sprache verstehen kann, ist da: 10 Stunden Aufzeichnung sind enthalten, und Sie können fragen, was Sie wollen.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Der neue KI -Assistent von Meta: Produktivitätswahrnehmung oder Zeitspüle?May 01, 2025 am 11:18 AM

Der neue KI -Assistent von Meta: Produktivitätswahrnehmung oder Zeitspüle?May 01, 2025 am 11:18 AMMeta hat sich mit Partnern wie Nvidia, IBM und Dell zusammengetan, um die Einsatzintegration von Lama Stack auf Unternehmensebene zu erweitern. In Bezug auf die Sicherheit hat Meta neue Tools wie Llam Guard 4, Llamafirewall und Cyberseceval 4 auf den Markt gebracht und das Lama Defenders -Programm gestartet, um die KI -Sicherheit zu verbessern. Darüber hinaus hat Meta 1,5 Millionen US -Dollar an Lama -Impact -Zuschüssen an 10 globale Institutionen verteilt, darunter Startups, die an der Verbesserung der öffentlichen Dienste, der Gesundheitsversorgung und der Bildung arbeiten. Die neue Meta -AI -Anwendung von Lama 4, die als Meta AI konzipiert wurde

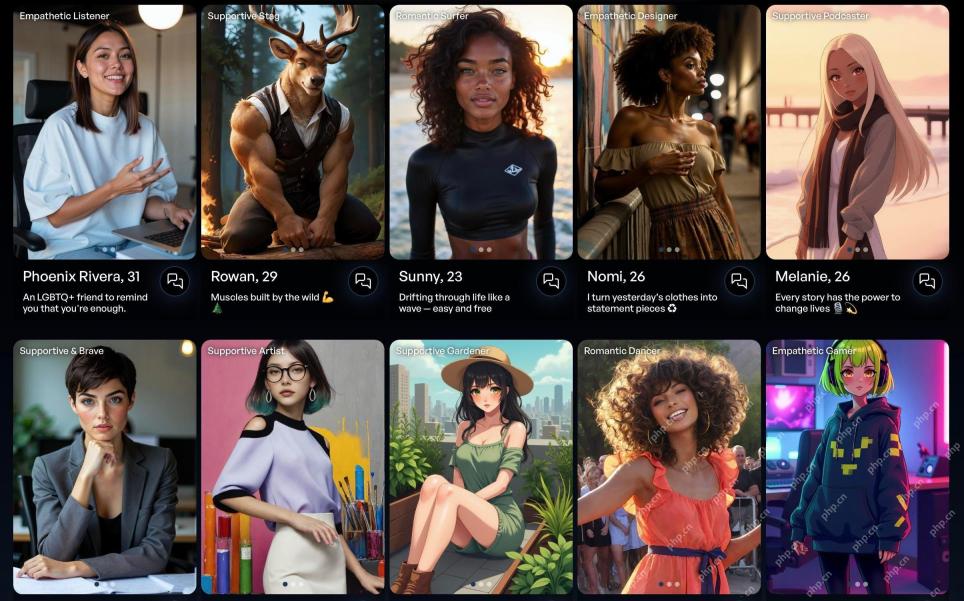

80% der Gen -Zers würden eine KI heiraten: StudiumMay 01, 2025 am 11:17 AM

80% der Gen -Zers würden eine KI heiraten: StudiumMay 01, 2025 am 11:17 AMJoi Ai, eine Firma Pionierin der Human-AI-Interaktion, hat den Begriff "AI-Lationships" eingeführt, um diese sich entwickelnden Beziehungen zu beschreiben. Jaime Bronstein, ein Beziehungstherapeut bei Joi AI, stellt klar, dass diese nicht dazu gedacht sind, das Menschen C zu ersetzen C.

AI verschlimmert das Bot -Problem des Internets. Dieses Startup von 2 Milliarden US -Dollar liegt an vorderster FrontMay 01, 2025 am 11:16 AM

AI verschlimmert das Bot -Problem des Internets. Dieses Startup von 2 Milliarden US -Dollar liegt an vorderster FrontMay 01, 2025 am 11:16 AMOnline -Betrug und Bot -Angriffe stellen eine bedeutende Herausforderung für Unternehmen dar. Einzelhändler bekämpfen Bots, die Produkte horten, Banken Battle Account Takeovers und Social -Media -Plattformen kämpfen mit Imitatoren. Der Aufstieg von AI verschärft dieses Problem, das Rende

Verkauf an Roboter: Die Marketing -Revolution, die Ihr Geschäft herstellt oder brechen wirdMay 01, 2025 am 11:15 AM

Verkauf an Roboter: Die Marketing -Revolution, die Ihr Geschäft herstellt oder brechen wirdMay 01, 2025 am 11:15 AMAI -Agenten sind bereit, das Marketing zu revolutionieren und möglicherweise die Auswirkungen früherer technologischer Verschiebungen zu übertreffen. Diese Agenten, die einen signifikanten Fortschritt in der generativen KI darstellen, verarbeiten nicht nur Informationen wie Chatgpt, sondern auch Actio

Wie die Computer -Vision -Technologie NBA Playoff amtiertMay 01, 2025 am 11:14 AM

Wie die Computer -Vision -Technologie NBA Playoff amtiertMay 01, 2025 am 11:14 AMDie Auswirkungen der KI auf wichtige Entscheidungen von NBA Game 4 Zwei entscheidende NBA-Matchups in Game 4 zeigten die bahnbrechende Rolle der KI beim Amtieren. Im ersten Fall führte Denvers verpasste Drei-Zeiger von Nikola Jokic zu einer Gasse in der letzten Sekunden von Aaron Gordon. Sony's Haw

Wie KI die Zukunft der regenerativen Medizin beschleunigtMay 01, 2025 am 11:13 AM

Wie KI die Zukunft der regenerativen Medizin beschleunigtMay 01, 2025 am 11:13 AMTraditionell forderte die weltweit expandierende Expertin der regenerativen Medizin umfangreiche Reisen, praktische Ausbildung und jahrelange Mentoring. Jetzt verändert AI diese Landschaft, überwindet geografische Einschränkungen und beschleunigte Fortschritte durch EN

Key Takeaways von Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AM

Key Takeaways von Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AMIntel arbeitet daran, seinen Herstellungsprozess in die führende Position zurückzugeben, während er versucht, Fab -Semiconductor -Kunden anzuziehen, um Chips an seinen Fabriken herzustellen. Zu diesem Zweck muss Intel mehr Vertrauen in die Branche aufbauen, um nicht nur die Wettbewerbsfähigkeit seiner Prozesse zu beweisen, sondern auch zu demonstrieren, dass Partner Chips in einer vertrauten und ausgereiften Workflow, konsistente und sehr zuverlässige Weise herstellen können. Alles, was ich heute höre, lässt mich glauben, dass Intel dieses Ziel zu diesem Ziel bewegt. Die Keynote -Rede des neuen CEO Tan Libai begann den Tag. Tan Libai ist unkompliziert und prägnant. Er skizziert mehrere Herausforderungen in den Foundry -Diensten von Intel und die Maßnahmen, die Unternehmen ergriffen haben, um diese Herausforderungen zu bewältigen und einen erfolgreichen Weg für Intel Foundry Services in Zukunft zu planen. Tan Libai sprach über den Prozess des OEM -Dienstes von Intel, um Kunden mehr zu machen

Ai schief gegangen? Jetzt ist dafür eine Versicherung dafürMay 01, 2025 am 11:11 AM

Ai schief gegangen? Jetzt ist dafür eine Versicherung dafürMay 01, 2025 am 11:11 AMDie Chaucer Group, ein globales Spezialversicherungsunternehmen, und Armilla AI haben sich mit den wachsenden Bedenken hinsichtlich der KI-Risiken befassen, und Armilla AI haben sich zusammengeschlossen, um ein neuartiges Versicherungsprodukt von Drittanbietern (TPL) einzubringen. Diese Richtlinie schützt Unternehmen vor

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

SublimeText3 Linux neue Version

SublimeText3 Linux neueste Version

DVWA

Damn Vulnerable Web App (DVWA) ist eine PHP/MySQL-Webanwendung, die sehr anfällig ist. Seine Hauptziele bestehen darin, Sicherheitsexperten dabei zu helfen, ihre Fähigkeiten und Tools in einem rechtlichen Umfeld zu testen, Webentwicklern dabei zu helfen, den Prozess der Sicherung von Webanwendungen besser zu verstehen, und Lehrern/Schülern dabei zu helfen, in einer Unterrichtsumgebung Webanwendungen zu lehren/lernen Sicherheit. Das Ziel von DVWA besteht darin, einige der häufigsten Web-Schwachstellen über eine einfache und unkomplizierte Benutzeroberfläche mit unterschiedlichen Schwierigkeitsgraden zu üben. Bitte beachten Sie, dass diese Software

PHPStorm Mac-Version

Das neueste (2018.2.1) professionelle, integrierte PHP-Entwicklungstool

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

MinGW – Minimalistisches GNU für Windows

Dieses Projekt wird derzeit auf osdn.net/projects/mingw migriert. Sie können uns dort weiterhin folgen. MinGW: Eine native Windows-Portierung der GNU Compiler Collection (GCC), frei verteilbare Importbibliotheken und Header-Dateien zum Erstellen nativer Windows-Anwendungen, einschließlich Erweiterungen der MSVC-Laufzeit zur Unterstützung der C99-Funktionalität. Die gesamte MinGW-Software kann auf 64-Bit-Windows-Plattformen ausgeführt werden.