Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI AltDiffusion-m18, ein vielseitiges Tool zum Generieren mehrsprachiger Texte und Bilder

AltDiffusion-m18, ein vielseitiges Tool zum Generieren mehrsprachiger Texte und BilderAltDiffusion-m18, ein vielseitiges Tool zum Generieren mehrsprachiger Texte und Bilder

Derzeit ist die Auswahl an nicht-englischen Text- und Bildgenerierungsmodellen begrenzt und Benutzer müssen die Eingabeaufforderung häufig ins Englische übersetzen, bevor sie das Modell eingeben. Dies führt nicht nur zu einer zusätzlichen betrieblichen Belastung, sondern auch sprachliche und kulturelle Fehler im Übersetzungsprozess beeinträchtigen die Genauigkeit der generierten Bilder.

Das FlagAI-Team des Zhiyuan Research Institute hat eine effiziente Trainingsmethode entwickelt, bei der ein mehrsprachiges Vortrainingsmodell in Kombination mit Stable Diffusion verwendet wurde, um ein mehrsprachiges Text- und Bildgenerierungsmodell zu trainieren – AltDiffusion-m18, das Text und unterstützt Bildgenerierung in 18 Sprachen.

Einschließlich Chinesisch, Englisch, Japanisch, Thailändisch, Koreanisch, Hindi, Ukrainisch, Arabisch, Türkisch, Vietnamesisch, Polnisch, Niederländisch, Portugiesisch, Italienisch, Spanisch, Deutsch, Französisch, Russisch.

Huggingface: https://huggingface.co/BAAI/AltDiffusion-m18

GitHub: https://github.com/FlagAI-Open/FlagAI/blob/master/examples/AltDiffusion-m18

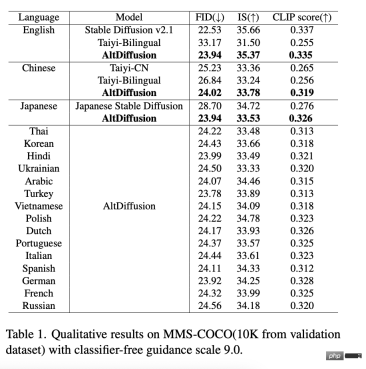

AltDiffusion-m18 in Die objektive Bewertung des FID-, IS- und CLIP-Scores in Englisch hat einen stabilen Diffusionseffekt von 95 bis 99 % erreicht und das optimale Niveau in Chinesisch und Japanisch erreicht. Gleichzeitig wurden die Lücken in den Text- und Bildgenerierungsmodellen von geschlossen die restlichen 15 Sprachen, was den Anforderungen von in hohem Maße gerecht wird. In der Branche besteht eine starke Nachfrage nach mehrsprachiger Text- und Grafikerstellung. Besonderer Dank geht an das Stable Diffusion Research Team für die Beratung bei dieser Arbeit.

Darüber hinaus wurde der AltDiffusion-m18-bezogene innovative Technologiebericht „AltCLIP: Altering the Language Encoder in CLIP for Extended Language Capabilities“ von Findings of ACL 2023 akzeptiert. Technische Highlights 4 AltCLIP für den mehrsprachigen Turm und mit mehrsprachigen Daten in neun Sprachen verfeinert, wodurch die ursprüngliche, nur auf Englisch verfügbare Stable Diffusion auf die Unterstützung von neun verschiedenen Sprachen erweitert wird.

AltCLIP: https://github.com/FlagAI-Open/FlagAI/tree/master/examples/AltCLIP-m18

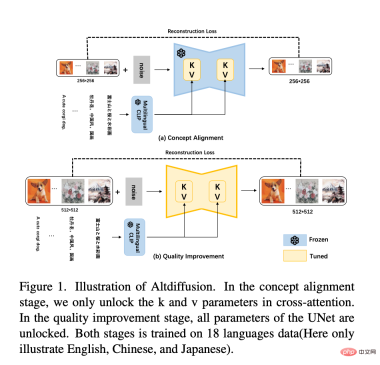

Und AltDiffusion-m18 wird basierend auf Stable Diffusion v2.1 trainiert. Der neue Sprachturm von Stable Diffusion v2.1 ist die invertierte zweite Schicht von OpenCLIP. Daher verwendet der neue AltCLIP die invertierte zweite Schicht von OpenCLIP als Destillationsziel für die Neuschulung und verwendet basierend auf m9 nur die CrossAttention-Schicht K Die Feinabstimmung wird zu einer zweistufigen Trainingsmethode erweitert, wie in der folgenden Abbildung dargestellt:

– Phase 1: Zu Beginn des Experiments von m9 wurde festgestellt, dass die Feinabstimmung der K- und V-Matrizen erlernen hauptsächlich die Konzeptausrichtung von Text und Bildern. Daher werden in der ersten Stufe des m18-Trainings weiterhin die Daten von 18 Sprachen verwendet, um die K- und V-Matrizen zu optimieren. Darüber hinaus haben Experimente gezeigt, dass die Reduzierung der Auflösung eines Bildes von 512*512 auf 256*256 nicht zum Verlust der semantischen Informationen des Bildes führt. Daher wird in der ersten Phase des Erlernens der Text-Bild-Konzeptausrichtung die Auflösung 256*256 für das Training verwendet, was das Training beschleunigt. - Die zweite Stufe: Um die Qualität der generierten Bilder weiter zu verbessern, verwenden Sie die Auflösung von 512*512, um die vollständigen Parameter von Unet in den Daten von 18 Sprachen zu trainieren. Darüber hinaus werden 10 % des Textes für das bedingungslose Training verworfen, um eine klassifiziererfreie Leitfolgerung zu ermöglichen. - Darüber hinaus wird eine klassifikatorfreie geführte Trainingstechnik eingesetzt, um die Generierungsqualität weiter zu verbessern. Die neuesten Bewertungsergebnisse zeigen, dass AltCLIP-m18 CLIP übertrifft und das optimale Niveau bei chinesischen und englischen Zero-Shot-(Zero-Sample-)Abrufaufgaben erreicht Version, unterstützt 9 Sprachen) erreicht das optimale Niveau mit AltCLIP-m18 ⬇️

Mit der Unterstützung des neuen AltCLIP hat AltDiffusion-m18 95 bis 99 % des ursprünglichen stabilen Diffusionseffekts in der englischen FID-, IS- und CLIP-Score-Bewertung erreicht und die besten Ergebnisse in 17 Sprachen erzielt, darunter Chinesisch und Japanisch. Erweiterte Leistung, detaillierte Daten werden in der folgenden Tabelle angezeigt:

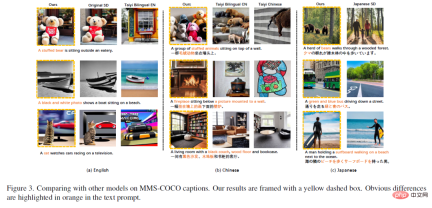

In Englisch, Chinesisch, Japanisch wird AltDiffusion-m18 mit anderen Modellgenerationen verglichen Ergebnisse, Der Effekt ist überlegen und die Details sind genauer:

AltDiffusion-m18 in (a) oben kann Ergebnisse erzeugen, die in hohem Maße mit dem übereinstimmen Original Stable Diffusion, und im Prompt ist es besser zu verstehen als andere inländische zweisprachige Chinesisch-Englisch-Modelle, zum Beispiel: „Ein ausgestopfter Bär“, „Ein Schwarz-Weiß-Foto“, „Katze“ und andere Konzepte, die in anderen Sprachen nicht generiert werden konnten Inländische zweisprachige Modelle Chinesisch-Englisch können erfolgreich in AltDiffusion generiert werden. Das gleiche Phänomen tritt im Chinesischen und Japanischen auf.

Das „schwarze Sofa, Holzboden“ in (b) oben wird nur von AltDiffusion-m18 korrekt generiert.

Die „Bären“ in (c) oben, Japanese Stable Diffusion generiert fälschlicherweise „Menschen“, AltDiffusion-m18 kann jedoch korrekt „Bären“ generieren.

Darüber hinaus entwickelte das Zhiyuan FlagEval-Team das Bewertungstool ImageEval für das Text- und Bildgenerierungsmodell. Nach der Evaluierung übertrifft die Genauigkeit von AltDiffusion-m18 in den Dimensionen Entitätsobjekt und Entitätsmenge die von inländischen Peer-Modellen um 11 % bzw. 10 % (Hinweis: Die ImageEval-Bewertungsmethode und die Ergebnisse werden in naher Zukunft öffentlich veröffentlicht, also bleiben Sie abgestimmt).

3 Der Retter kleiner Sprachtexte und Bilder, der ein Referenzsystem für mehrsprachige Text- und Bildgenerierungsmodelle bereitstellt

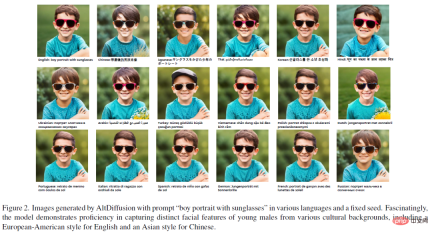

AltDiffusion-m18 Gelernt von Mehrsprachige Daten Die Voreingenommenheit in verschiedenen Sprachen hilft Benutzern, die Sprachübersetzungsschwelle zu überschreiten und kulturelle Übersetzungen zu umgehen, wodurch der Verlust kultureller Informationen hinter der Sprache verringert wird. Wie in der Abbildung unten gezeigt, ist die Gesichtskontur des kleinen Jungen, die durch Eingabeaufforderungen in chinesischer und japanischer Sprache generiert wird, eher „asiatischer Stil“, während die Gesichtskontur des kleinen Jungen, die durch Eingabeaufforderungen in englischer und anderer europäischer Sprache generiert wird, eher „europäischer und amerikanischer Stil“ ist.

Interessanter ist, dass auch die Details der Bilder, die durch Tieraufforderungen in verschiedenen Sprachen generiert werden, unterschiedlich sind. Wie in der folgenden Abbildung gezeigt, sind die in verschiedenen Sprachen generierten Bilder insgesamt zwar sehr konsistent, es gibt jedoch geringfügige Unterschiede im Hintergrund des Bildes und in den Details der Gesichtszüge von Corgi.

Im Allgemeinen bietet AltDiffusion-m18 einen grundlegenden Referenzrahmen für mehrsprachige Text- und Bildgenerierungsmodelle. Benutzer, deren Muttersprachen Spanisch, Deutsch und Französisch sind, können den Spaß von AIGC genießen, ohne die Eingabeaufforderungen in ihrem Kopf ins Englische übersetzen zu müssen. KI-Trainingsexperten können basierend auf AltDiffusion-m18 auch durch die Kombination von DreamBooth, ControlNet und LoRA eine weitere Optimierung durchführen oder Korpus-Feinabstimmungen in anderen Sprachen verwenden, um bessere Effekte bei der Text- und Bildgenerierung zu erzielen.

Gleichzeitig stellt FlagAI (github.com/FlagAI-Open/FlagAI), ein One-Stop-Open-Source-Projekt für große Modellalgorithmen, Modelle und Tools, auch Trainingsinferenztools und APIs für bereit Jeder kann AltDiffusion-m18 schnell herunterladen und verwenden.

Das obige ist der detaillierte Inhalt vonAltDiffusion-m18, ein vielseitiges Tool zum Generieren mehrsprachiger Texte und Bilder. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

10 generative AI -Codierungsweiterungen im VS -Code, die Sie untersuchen müssenApr 13, 2025 am 01:14 AM

10 generative AI -Codierungsweiterungen im VS -Code, die Sie untersuchen müssenApr 13, 2025 am 01:14 AMHey da, codieren Ninja! Welche Codierungsaufgaben haben Sie für den Tag geplant? Bevor Sie weiter in diesen Blog eintauchen, möchte ich, dass Sie über all Ihre Coding-Leiden nachdenken-die Auflistung auflisten diese auf. Erledigt? - Lassen Sie ’

Kochen innovation: Wie künstliche Intelligenz den Lebensmittelservice verändertApr 12, 2025 pm 12:09 PM

Kochen innovation: Wie künstliche Intelligenz den Lebensmittelservice verändertApr 12, 2025 pm 12:09 PMKI verstärken die Zubereitung der Lebensmittel KI -Systeme werden während der Nahten immer noch in der Zubereitung von Nahrungsmitteln eingesetzt. KI-gesteuerte Roboter werden in Küchen verwendet, um Aufgaben zur Zubereitung von Lebensmitteln zu automatisieren, z.

Umfassende Anleitung zu Python -Namespaces und variablen ScopesApr 12, 2025 pm 12:00 PM

Umfassende Anleitung zu Python -Namespaces und variablen ScopesApr 12, 2025 pm 12:00 PMEinführung Das Verständnis der Namespaces, Scopes und des Verhaltens von Variablen in Python -Funktionen ist entscheidend, um effizient zu schreiben und Laufzeitfehler oder Ausnahmen zu vermeiden. In diesem Artikel werden wir uns mit verschiedenen ASP befassen

Ein umfassender Leitfaden zu Vision Language Models (VLMs)Apr 12, 2025 am 11:58 AM

Ein umfassender Leitfaden zu Vision Language Models (VLMs)Apr 12, 2025 am 11:58 AMEinführung Stellen Sie sich vor, Sie gehen durch eine Kunstgalerie, umgeben von lebhaften Gemälden und Skulpturen. Was wäre, wenn Sie jedem Stück eine Frage stellen und eine sinnvolle Antwort erhalten könnten? Sie könnten fragen: „Welche Geschichte erzählst du?

MediaTek steigert die Premium -Aufstellung mit Kompanio Ultra und Abmessung 9400Apr 12, 2025 am 11:52 AM

MediaTek steigert die Premium -Aufstellung mit Kompanio Ultra und Abmessung 9400Apr 12, 2025 am 11:52 AMIn diesem Monat hat MediaTek in diesem Monat eine Reihe von Ankündigungen gemacht, darunter das neue Kompanio Ultra und die Abmessung 9400. Diese Produkte füllen die traditionelleren Teile von MediaTeks Geschäft aus, die Chips für Smartphone enthalten

Diese Woche in AI: Walmart setzt Modetrends vor, bevor sie jemals passierenApr 12, 2025 am 11:51 AM

Diese Woche in AI: Walmart setzt Modetrends vor, bevor sie jemals passierenApr 12, 2025 am 11:51 AM#1 Google gestartet Agent2Agent Die Geschichte: Es ist Montagmorgen. Als mit KI betriebener Personalvermittler arbeiten Sie intelligenter, nicht härter. Sie melden sich im Dashboard Ihres Unternehmens auf Ihrem Telefon an. Es sagt Ihnen, dass drei kritische Rollen bezogen, überprüft und geplant wurden

Generative KI trifft PsychobabbleApr 12, 2025 am 11:50 AM

Generative KI trifft PsychobabbleApr 12, 2025 am 11:50 AMIch würde vermuten, dass du es sein musst. Wir alle scheinen zu wissen, dass Psychobabble aus verschiedenen Geschwätzern besteht, die verschiedene psychologische Terminologie mischen und oft entweder unverständlich oder völlig unsinnig sind. Alles was Sie tun müssen, um fo zu spucken

Der Prototyp: Wissenschaftler verwandeln Papier in PlastikApr 12, 2025 am 11:49 AM

Der Prototyp: Wissenschaftler verwandeln Papier in PlastikApr 12, 2025 am 11:49 AMLaut einer neuen Studie, die diese Woche veröffentlicht wurde, wurden im Jahr 2022 nur 9,5% der im Jahr 2022 hergestellten Kunststoffe aus recycelten Materialien hergestellt. In der Zwischenzeit häufen sich Plastik weiter in Deponien - und Ökosystemen - um die Welt. Aber Hilfe ist unterwegs. Ein Team von Engin

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

MantisBT

Mantis ist ein einfach zu implementierendes webbasiertes Tool zur Fehlerverfolgung, das die Fehlerverfolgung von Produkten unterstützen soll. Es erfordert PHP, MySQL und einen Webserver. Schauen Sie sich unsere Demo- und Hosting-Services an.

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

MinGW – Minimalistisches GNU für Windows

Dieses Projekt wird derzeit auf osdn.net/projects/mingw migriert. Sie können uns dort weiterhin folgen. MinGW: Eine native Windows-Portierung der GNU Compiler Collection (GCC), frei verteilbare Importbibliotheken und Header-Dateien zum Erstellen nativer Windows-Anwendungen, einschließlich Erweiterungen der MSVC-Laufzeit zur Unterstützung der C99-Funktionalität. Die gesamte MinGW-Software kann auf 64-Bit-Windows-Plattformen ausgeführt werden.

PHPStorm Mac-Version

Das neueste (2018.2.1) professionelle, integrierte PHP-Entwicklungstool

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen