Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI Offener Brief fordert Moratorium für die Forschung im Bereich der künstlichen Intelligenz

Offener Brief fordert Moratorium für die Forschung im Bereich der künstlichen IntelligenzOffener Brief fordert Moratorium für die Forschung im Bereich der künstlichen Intelligenz

Das Future of Life Institute hat einen offenen Brief veröffentlicht, in dem ein sechsmonatiges Moratorium für einige Formen der Forschung im Bereich der künstlichen Intelligenz gefordert wird. Unter Berufung auf „ernsthafte Risiken für die Gesellschaft und die Menschheit“ forderte die Gruppe die KI-Labore auf, die Forschung an KI-Systemen, die leistungsfähiger als GPT-4 sind, auszusetzen, bis mehr „Sicherheitsleitplanken“ um sie herum errichtet werden können.

Das Future of Life Institute schrieb am 22. März in einem offenen Brief: „KI-Systeme, die mit Menschen konkurrieren, stellen enorme Risiken für die Gesellschaft und die Menschheit dar.“ „Fortgeschrittene KI könnte die tiefgreifenden Veränderungen in der Geschichte darstellen.“ Das Leben auf der Erde sollte mit angemessener Sorgfalt und Ressourcen geplant und verwaltet werden. Leider ist dieses Maß an Planung und Management ohne künstliche Intelligenz nicht erreicht worden, so das Institut Prinzipien, eine erweiterte Version der berühmten Drei Gesetze der Robotik von Asimov. Diese 23 Prinzipien wurden vom Institut geleitet.) - Wir Es mangelt an geeigneten Kontrollmechanismen, um sicherzustellen, dass sich die KI auf geplante und kontrollierte Weise entwickelt.

Das ist es, womit wir heute konfrontiert sind.Der Brief lautet: „Leider ist dieses Maß an Planung und Management nicht erreicht worden, obwohl KI-Labore in den letzten Monaten in einen außer Kontrolle geratenen Wettlauf um die Entwicklung und den Einsatz immer leistungsfähigerer digitaler Köpfe verwickelt waren, die es nicht gibt.“ “

In Ermangelung eines freiwilligen Moratoriums für KI-Forscher fordert das Future of Life Institute die Regierung auf, Maßnahmen zu ergreifen, um Schäden durch die laufende Forschung im Bereich der großen künstlichen Intelligenz zu verhindern Modelle. Top-KI-Forscher sind sich uneinig, ob sie die Forschung pausieren sollen. Mehr als 5.000 Menschen haben den offenen Brief unterschrieben, darunter Turing-Award-Gewinner Yoshua Bengio, OpenAI-Mitbegründer Elon Musk und Apple-Mitbegründer Steve Wozniak.

Allerdings sind nicht alle davon überzeugt, dass ein Verbot der Forschung an KI-Systemen, die leistungsfähiger sind als GPT-4, in unserem besten Interesse ist.

„Ich habe diesen Brief nicht unterschrieben“, sagte Metas Chefwissenschaftler für künstliche Intelligenz und Turing-Award-Gewinner Yann LeCun (der 2018 zusammen mit Bengio und Geoffrey Hinton den Turing Award gewann) auf Twitter. „Ich bin mit seiner Prämisse nicht einverstanden.“

„Ich habe diesen Brief nicht unterschrieben“, sagte Metas Chefwissenschaftler für künstliche Intelligenz und Turing-Award-Gewinner Yann LeCun (der 2018 zusammen mit Bengio und Geoffrey Hinton den Turing Award gewann) auf Twitter. „Ich bin mit seiner Prämisse nicht einverstanden.“

LeCun, Bengio und Hinton werden von der Association for Computing Machinery (ACM), die sie vor mehr als einem Jahrzehnt ins Leben gerufen hat, als „Väter der Deep-Learning-Revolution“ bezeichnet mit ihrer Forschung zu neuronalen Netzen Der aktuelle Trend in der künstlichen Intelligenz. Damals waren tiefe neuronale Netze ein Hauptschwerpunkt der Forscher im Bereich der künstlichen Intelligenz auf der ganzen Welt.

Mit dem 2017 von Google veröffentlichten Transformer-Papier ist die Forschung im Bereich der künstlichen Intelligenz auf Hochtouren geraten. Schon bald bemerkten die Forscher unerwartete Leistungsvorteile in großen Sprachmodellen, etwa die Fähigkeit, Mathematik zu lernen, Gedankenketten zu folgern und Anweisungen zu befolgen. Ende November 2022 bekam die Öffentlichkeit einen Vorgeschmack darauf, was diese LLMs leisten können, als OpenAI ChatGPT der Welt zugänglich machte. Seitdem arbeitet die Tech-Community daran, LLM in allen Bereichen zu implementieren, und das „Wettrüsten“ zum Bau größerer, leistungsstärkerer Modelle hat zusätzlich an Dynamik gewonnen, wie die Ankündigung von GPT-4 am 15. März zeigt.

Während einige KI-Experten Bedenken hinsichtlich der negativen Auswirkungen von LLM geäußert haben, einschließlich der Tendenz zum Lügen, des Risikos der Offenlegung privater Daten und der möglichen Auswirkungen auf die Beschäftigung, hat dies die große öffentliche Nachfrage danach nicht gedämpft neue KI-Fähigkeiten. Jensen Huang, CEO von Nvidia, sagt, dass wir uns möglicherweise an einem Wendepunkt in der künstlichen Intelligenz befinden. Aber der Geist scheint aus der Flasche zu sein und es ist nicht abzusehen, wohin er als nächstes gehen wird.

Das obige ist der detaillierte Inhalt vonOffener Brief fordert Moratorium für die Forschung im Bereich der künstlichen Intelligenz. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Wie sperle ich Zellen in Excel? - Analytics VidhyaApr 16, 2025 am 09:17 AM

Wie sperle ich Zellen in Excel? - Analytics VidhyaApr 16, 2025 am 09:17 AMSchutz Ihrer Excel -Daten: Eine Anleitung zum Verriegelungszellen Haben Sie jemals unzählige Stunden damit verbracht, eine Excel -Tabelle zu perfektionieren, nur um versehentliche (oder absichtliche!) Datenversorgung zu fürchten? Diese Anleitung zeigt, wie Sie Ihre Arbeit mit Excels Cell Locking FEA schützen können

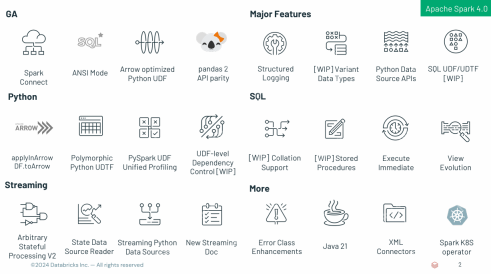

Apache Spark 4.0: Eine neue Ära der Big -Data -Verarbeitung - Analytics VidhyaApr 16, 2025 am 09:15 AM

Apache Spark 4.0: Eine neue Ära der Big -Data -Verarbeitung - Analytics VidhyaApr 16, 2025 am 09:15 AMApache Spark 4.0: Ein revolutionärer Sprung in der Big -Data -Verarbeitung Apache Spark hat durchweg von seiner Fähigkeit beeindruckt, massive Datensätze zu verarbeiten. Die bevorstehende Veröffentlichung von Apache Spark 4.0 verspricht, noch transformativer zu sein und signifikant einzuführen

Ein umfassender Leitfaden zur ExtrapolationApr 15, 2025 am 11:38 AM

Ein umfassender Leitfaden zur ExtrapolationApr 15, 2025 am 11:38 AMEinführung Angenommen, es gibt einen Landwirt, der täglich den Fortschritt von Pflanzen in mehreren Wochen beobachtet. Er untersucht die Wachstumsraten und beginnt darüber nachzudenken, wie viel größerer seine Pflanzen in weiteren Wochen wachsen könnten. Von th

Der Aufstieg der weichen KI und was es für Unternehmen heute bedeutetApr 15, 2025 am 11:36 AM

Der Aufstieg der weichen KI und was es für Unternehmen heute bedeutetApr 15, 2025 am 11:36 AMSoft AI-definiert als KI-Systeme zur Ausführung spezifischer, enger Aufgaben mit ungefährem Denken, Mustererkennung und flexibler Entscheidungsfindung-versucht, ein menschliches Denken nachzuahmen, indem sie Mehrdeutigkeiten einnehmen. Aber was bedeutet das für das Geschäft

Sich entwickelnde Sicherheitsrahmen für die KI -Grenze entwickelnApr 15, 2025 am 11:34 AM

Sich entwickelnde Sicherheitsrahmen für die KI -Grenze entwickelnApr 15, 2025 am 11:34 AMDie Antwort ist klar-genau da Cloud Computing eine Verschiebung zu Cloud-nativen Sicherheitstools erfordert, erfordert KI eine neue Generation von Sicherheitslösungen, die speziell für die individuellen Anforderungen von AI entwickelt wurden. Der Aufstieg von Cloud -Computing- und Sicherheitsstunden gelernt In th

3 Wege generative KI verstärkt Unternehmer: Vorsicht vor Durchschnittswerten!Apr 15, 2025 am 11:33 AM

3 Wege generative KI verstärkt Unternehmer: Vorsicht vor Durchschnittswerten!Apr 15, 2025 am 11:33 AMUnternehmer und Verwendung von KI und Generative KI, um ihre Geschäfte besser zu machen. Gleichzeitig ist es wichtig, sich zu erinnern, wie alle Technologien ein Verstärker ist. Eine strenge Studie von 2024 o

Neuer kurzer Kurs zum Einbetten von Modellen von Andrew NGApr 15, 2025 am 11:32 AM

Neuer kurzer Kurs zum Einbetten von Modellen von Andrew NGApr 15, 2025 am 11:32 AMSchalte die Kraft des Einbettungsmodelle frei: einen tiefen Eintauchen in den neuen Kurs von Andrew Ng Stellen Sie sich eine Zukunft vor, in der Maschinen Ihre Fragen mit perfekter Genauigkeit verstehen und beantworten. Dies ist keine Science -Fiction; Dank der Fortschritte in der KI wird es zu einem R

Ist die Halluzination in Großsprachenmodellen (LLMs) unvermeidlich?Apr 15, 2025 am 11:31 AM

Ist die Halluzination in Großsprachenmodellen (LLMs) unvermeidlich?Apr 15, 2025 am 11:31 AMGroßsprachenmodelle (LLMs) und das unvermeidliche Problem der Halluzinationen Sie haben wahrscheinlich AI -Modelle wie Chatgpt, Claude und Gemini verwendet. Dies sind alles Beispiele für große Sprachmodelle (LLMs), leistungsstarke KI -Systeme, die auf massiven Textdatensätzen geschult wurden

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Herunterladen der Mac-Version des Atom-Editors

Der beliebteste Open-Source-Editor

SublimeText3 Linux neue Version

SublimeText3 Linux neueste Version

Dreamweaver CS6

Visuelle Webentwicklungstools

mPDF

mPDF ist eine PHP-Bibliothek, die PDF-Dateien aus UTF-8-codiertem HTML generieren kann. Der ursprüngliche Autor, Ian Back, hat mPDF geschrieben, um PDF-Dateien „on the fly“ von seiner Website auszugeben und verschiedene Sprachen zu verarbeiten. Es ist langsamer und erzeugt bei der Verwendung von Unicode-Schriftarten größere Dateien als Originalskripte wie HTML2FPDF, unterstützt aber CSS-Stile usw. und verfügt über viele Verbesserungen. Unterstützt fast alle Sprachen, einschließlich RTL (Arabisch und Hebräisch) und CJK (Chinesisch, Japanisch und Koreanisch). Unterstützt verschachtelte Elemente auf Blockebene (wie P, DIV),

SAP NetWeaver Server-Adapter für Eclipse

Integrieren Sie Eclipse mit dem SAP NetWeaver-Anwendungsserver.