Heim >Web-Frontend >js-Tutorial >Was ist Unicode?

Was ist Unicode?

- 清浅Original

- 2019-01-26 10:56:1439458Durchsuche

Unicode ist ein Zeichenkodierungsschema, das eine einheitliche und eindeutige Binärkodierung für jedes Zeichen in jeder Sprache festlegt, um sprach- und plattformübergreifende Anforderungen an die Textkonvertierung und -verarbeitung zu erfüllen

Unicode-Bedeutung

Unicode stellt für jedes Zeichen eine eindeutige Nummer bereit, egal auf welcher Plattform, egal welches Programm, egal welche Sprache. Es wurde 1994 offiziell angekündigt und ist ein Industriestandard im Computerbereich, einschließlich Zeichensätzen, Kodierungsschemata usw. Unicode wurde entwickelt, um die Einschränkungen herkömmlicher Zeichenkodierungsschemata zu überwinden. Es legt eine einheitliche und eindeutige Binärkodierung für jedes Zeichen in jeder Sprache fest, um sprach- und plattformübergreifende Anforderungen an die Textkonvertierung und -verarbeitung zu erfüllen.

Die Entwicklung der Unicode-Kodierung

Computer werden mit 8 Bits als Byte entworfen. Daher kann ein Byte bis zu 256 Zeichen. In den frühen Tagen, in denen Englisch verwendet wurde, konnte ein Byte englische Groß- und Kleinbuchstaben, Mathematik und einige Symbole speichern, sodass ein Byte zur Erstellung der Codetabelle (ASCII) verwendet wurde. Später wurden Computer auf andere Länder ausgeweitet und viele Länder verwendeten ihre eigenen Sprachen, wie Chinesisch, Japanisch, Koreanisch ... Um dieses Problem zu lösen, formulierte jedes Land seine eigene Codetabelle formuliert GB2312 im Jahr 1980 Im chinesischen Zeichensatz gibt es viel mehr chinesische Zeichen als im Englischen. Ein Byte reicht offensichtlich nicht aus, daher werden 2 Bytes für die Codierung verwendet. Obwohl die von verschiedenen Ländern definierten Zeichenkodierungen verwendet werden können, sind sie zwischen verschiedenen Ländern jedoch häufig nicht kompatibel. Wenn der Computer mit mehreren Sprachumgebungen (unter Verwendung von Chinesisch oder anderen Sprachen) umgehen möchte, ist er möglicherweise nicht in der Lage, mehrere Sprachumgebungen gleichzeitig zu unterstützen. Um die Kodierung aller Texte zu vereinheitlichen, wurde Unicode entwickelt, um alle Sprachen in einem Satz von Kodierungen zu vereinen, damit keine verstümmelten Zeichen entstehen.

Unicode-Kodierung repräsentiert

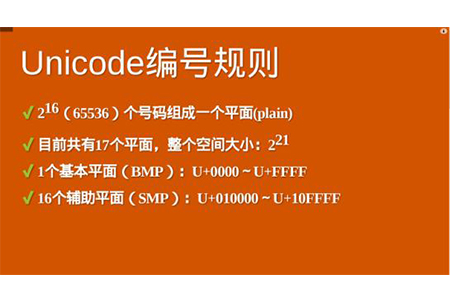

Bei der Darstellung von Unicode-Zeichen wird normalerweise U+ gefolgt von einer Reihe hexadezimaler Ziffern verwendet. Stellt ein Zeichen dar, Die Kodierung reicht von U+0000 bis U+FFFF und unterstützt insgesamt mehr als 60.000 Zeichen außer BMP

müssen mit 5 oder 6 Ziffern im Hexadezimalformat dargestellt werden.

Derzeit sind Unicode-Zeichen in 17 Gruppen unterteilt, 0x0000 bis 0x10FFFF. Jede Gruppe wird als Ebene bezeichnet, also insgesamt 1114112.

Unicode ist wie eine Tabelle. Jedes Zeichen entspricht einer Zahl, einem sogenannten Codepunkt. Diese Zahl wird im Allgemeinen nicht direkt verwendet Verwenden Sie verschiedene Kodierungsmethoden

UTF-8, UTF-16 und UTF-32 sind Kodierungsschemata zum Konvertieren von Zahlen in Programmdaten. UTF ist die Abkürzung für „UnicodeTransformation Format“, die in das

UTF-8, UTF-16 und UTF-32 sind Kodierungsschemata zum Konvertieren von Zahlen in Programmdaten. UTF ist die Abkürzung für „UnicodeTransformation Format“, die in das

Unicode-Zeichensatzkonvertierungsformat übersetzt werden kann, das heißt, wie durch Unicode definierte Zahlen in Programmdaten konvertiert werden

| Dezimal |

Unicode-Kodierung | UTF-8-Byte-Stream | |||||||||||||||

| 0-127 Bit | 0x000000-0x00007F | 0xxxxxxx(7 Ziffern)

|

|||||||||||||||

| 128- 2047 Bits | 0x000080-0x0007FF | 110xxxxx 10xxxxxx (11 Ziffern) | |||||||||||||||

| 2048-65535 Bit | 0x000800-0x00FFFF td> | 1110xxxx 10xxxxxx 10xxxxxx (16 Bit) | |||||||||||||||

| 65536-1114111 Bit | 0x010000-0x10FFFF | 11110xxx 10xxxxxx 10xxxxxx 10xxxxxx (21 Bits) |

Das obige ist der detaillierte Inhalt vonWas ist Unicode?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Eine eingehende Analyse der Bootstrap-Listengruppenkomponente

- Detaillierte Erläuterung des JavaScript-Funktions-Curryings

- Vollständiges Beispiel für die Generierung von JS-Passwörtern und die Erkennung der Stärke (mit Download des Demo-Quellcodes)

- Angularjs integriert WeChat UI (weui)

- Wie man mit JavaScript schnell zwischen traditionellem Chinesisch und vereinfachtem Chinesisch wechselt und wie Websites den Wechsel zwischen vereinfachtem und traditionellem Chinesisch unterstützen – Javascript-Kenntnisse