Heim >Backend-Entwicklung >XML/RSS-Tutorial >RSS und Crawler, ausführliche Erklärung zur Datenerfassung

RSS und Crawler, ausführliche Erklärung zur Datenerfassung

- Y2JOriginal

- 2017-04-24 16:41:003764Durchsuche

Zusammenfassung: Bevor der Wert von Daten ermittelt werden kann, müssen diese zunächst Prozesse wie das Sammeln, Speichern, Analysieren und Berechnen durchlaufen. Die Gewinnung umfassender und genauer Daten ist die Grundlage für das Data Value Mining. Diese Ausgabe der „Big Data Story“ des CSDN Cloud Computing Club beginnt mit den gängigsten Datenerfassungsmethoden – RSS und Suchmaschinen-Crawlern.

Am 30. Dezember fand die CSDN Cloud Computing Club-Veranstaltung im 3W Coffee statt. Das Thema der Veranstaltung lautete „RSS und Crawler: Die Geschichte von Big Data – Beginnend mit der Datenerfassung.“ Bevor der Wert von Daten ermittelt werden kann, müssen diese zunächst Prozesse wie das Sammeln, Speichern, Analysieren und Berechnen durchlaufen. Die Gewinnung umfassender und genauer Daten ist die Grundlage für das Data Value Mining. Vielleicht können die aktuellen Daten dem Unternehmen oder der Organisation keinen tatsächlichen Wert bringen, aber als weitsichtiger Entscheidungsträger sollten Sie sich darüber im Klaren sein, dass wichtige Daten so früh wie möglich gesammelt und gespeichert werden sollten. Diese Ausgabe von „Big Data Story“ beginnt mit den gängigsten Datenerfassungsmethoden – RSS und Suchmaschinen-Crawlern.

Die Veranstaltung war voller Sitzplätze

Zuallererst sagte Cui Kejun, General Manager der Bibliotheksabteilung von Beijing Wanfang Software Co., Ltd., teilte das Thema „RSS-Implementierung in großem Maßstab – Erste Anwendungen der Aggregation und des Herunterladens von Websites in der wissenschaftlichen Forschung“. Cui Kejun ist seit 12 Jahren in der Bibliotheks- und Informationsbranche tätig und verfügt über umfangreiche Erfahrung in der Datenerfassung. Er teilte hauptsächlich RSS, eine wichtige Methode zur Informationsaggregation, und deren Implementierungstechnologie.

RSS (Really Simple Syndication) ist eine Quellformatspezifikation, die zum Zusammenfassen von Websites verwendet wird, die häufig aktualisierte Daten veröffentlichen, wie z. B. Blogbeiträge, Nachrichten, Audio- oder Videoauszüge. RSS-Dateien enthalten Volltext oder Textauszüge sowie auszugsweise Daten und Autorisierungsmetadaten aus dem Netzwerk, bei dem der Benutzer abonniert ist.

Die Aggregation von Hunderten oder sogar Tausenden von RSS-Seeds, die eng mit einer bestimmten Branche verbunden sind, ermöglicht es Ihnen, die neuesten Entwicklungen in einer bestimmten Branche schnell und umfassend zu verstehen wird in der Lage sein, die Entwicklung eines bestimmten Themas in der Branche in allen Einzelheiten zu verstehen.

Cui Kejun, General Manager der Bibliotheksabteilung von Beijing Wanfang Software Co., Ltd.

Cui Kejun stellte die Rolle von RSS im Institut für vor Hochenergiephysik als Beispiel. Anwendungen in wissenschaftlichen Forschungsinstituten. Die Informationsüberwachung der Hochenergiephysik richtet sich an Partnerinstitutionen der Hochenergiephysik auf der ganzen Welt: Laboratorien, Industriegesellschaften, internationale Verbände, Regierungsbehörden, die in verschiedenen Ländern für die wissenschaftliche Forschung zuständig sind, wichtige umfassende wissenschaftliche Veröffentlichungen, experimentelle Projekte und experimentelle Einrichtungen der Hochenergiephysik . Die überwachten Arten von Informationen sind: Nachrichten, Aufsätze, Konferenzberichte, Analysen und Rezensionen, Vorabdrucke, Fallstudien, Multimedia, Bücher, Informationen zur Personalbeschaffung usw.

Die Literaturinformationen zur Hochenergiephysik nutzen das fortschrittlichste Open-Source-Content-Management-System Drupal, die Open-Source-Suchtechnologie Apache Solr sowie die von Google-Mitarbeitern entwickelte PubSubHubbub-Technologie zum Abonnieren von Nachrichten in Echtzeit und die von Amazon OpenSearch zur Einrichtung einer Reihe von Hochenergiephysik-Informationsüberwachungssystemen unterscheidet sich vom herkömmlichen RSS-Abonnement und -Push und ermöglicht die Informationserfassung nahezu in Echtzeit und den aktiven Push von Nachrichten mit beliebigen Schlüsselwörtern, Kategorien und zusammengesetzten Bedingungen.

Als nächstes teilte Cui Kejun seine Erfahrungen mit der Verwendung von Technologien wie Drupal, Apache Solr, PubSubHubbub und OpenSearch.

Als nächstes hielt Ye Shunping, der Architekt und Crawler-Teamleiter der Suchabteilung von Yisou Technology, einen Vortrag mit dem Titel „Web Search Crawler Timeliness System“, einschließlich der Hauptziele, der Architektur und verschiedener Untermodule von das Pünktlichkeitssystem.

Ye Shunping, Architekt und Leiter des Crawl-Teams der Suchabteilung von Yisou Technology

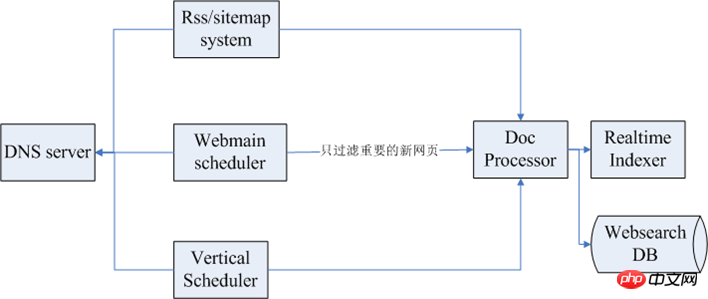

Die verschiedenen Ziele von Webcrawlern sind eine hohe Abdeckung und niedrige Dead-Link-Rate Wie bei guter Effektivität ist das Ziel des Crawler-Effektivitätssystems ähnlich, hauptsächlich die schnelle und umfassende Einbindung neuer Webseiten. Die folgende Abbildung zeigt die Gesamtarchitektur des Aktualitätssystems:

Darunter ist das erste oben das RSS/Sitemap-Subsystem und das nächste der Webmain-Planer. Das Planungssystem für das Crawlen von Webseiten und dann ein Vertikalplaner. Ganz links gibt es beim Crawlen normalerweise Dutzende oder sogar Hunderte von Crawling-Clustern relativ groß sein, daher gibt es in der Regel ein DNS-Dienstmodul zur Bereitstellung globaler Dienste. Nach der Datenerfassung erfolgt in der Regel eine anschließende Datenverarbeitung.

Zu den mit der Wirksamkeit verbundenen Modulen gehören die folgenden:

RSS/Sitemap-System: Der Prozess der Verwendung von RSS/Sitemap durch das Timeliness-System besteht darin, Seeds abzubauen, regelmäßig zu crawlen und die Link-Release-Zeit zu analysieren. Crawlen und indizieren Sie zuerst neuere Webseiten.

Pan-Crawling-System: Wenn das Pan-Crawling-System gut konzipiert ist, trägt es dazu bei, die hohe Abdeckung zeitkritischer Webseiten zu verbessern, aber Pan-Crawling muss den Planungszyklus so weit wie möglich verkürzen.

Seed-Planungssystem: Es handelt sich hauptsächlich um eine zeitkritische Seed-Bibliothek. Das Planungssystem scannt die Datenbank kontinuierlich und sendet sie dann an den Crawling-Cluster Links werden extrahiert und dann nach Kategorie gesendet, und jeder vertikale Kanal erhält zeitnahe Daten.

Seed-Mining: umfasst das Parsen von Seiten oder andere Mining-Methoden, die über Sitemaps und Navigationsleisten erstellt werden können und auf Seitenstrukturmerkmalen und Seitenänderungsregeln basieren.

Seed-Aktualisierungsmechanismus: Zeichnen Sie den Crawling-Verlauf jedes Seeds auf, folgen Sie den Linkinformationen, aktualisieren Sie regelmäßig die externen Linkeigenschaften des Seeds und berechnen Sie den Aktualisierungszyklus des Seeds neu.

Crawling-System und JavaScript-Analyse: Verwenden Sie den Browser zum Crawlen und Erstellen eines Crawling-Clusters basierend auf dem Browser-Crawling. Oder übernehmen Sie ein Open-Source-Projekt wie Qtwebkit.

Das obige ist der detaillierte Inhalt vonRSS und Crawler, ausführliche Erklärung zur Datenerfassung. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Verwenden von dom4j zum Parsen von XML in Java (Beispielcode)

- Wie liest Java XML-Dateien? Spezifische Implementierung

- Java-Beispielcode zum Generieren und Parsen von Dateien und Zeichenfolgen im XML-Format

- Lösung für die Verwendung von Sax zum Parsen von XML in Java

- Java verwendet XPath, um die gemeinsame Nutzung von XML-Beispielen zu analysieren