Googles Gemini: Code -Ausführungsfunktionen großer Sprachmodelle

Großsprachenmodelle (LLMs), Nachfolger von Transformatoren, haben natürliche Sprachverarbeitung (NLP) und natürliches Sprachverständnis (NLU) revolutioniert. Das Ersetzen von regelbasierten Chatbots aufgrund ihres überlegenen Textverständnisses und der natürlichen Konversationserzeugung erledigt LLMs jetzt weitaus komplexere Aufgaben. Dazu gehört die natürliche Sprache zur SQL -Abfragekonvertierung, das Durchsuchen des Internet -Browsens zum Abrufen von Informationen und zuletzt die Codesteuerung. In diesem Artikel werden die neu veröffentlichte Code -Ausführungsfunktion von Gemini untersucht.

Lernziele:

- LLM -Codeausführung verstehen.

- Entdecken Sie Gemini Flash 1.5.

- Erhalten Sie einen Gemini -API -Schlüssel.

- Untersuchen Sie die Einschränkungen der LLMs bei mathematischen Aufgaben.

- Verwenden Sie LLMs mit Codeausführung für genaue Antworten.

Gemini: Googles multimodales LLM

Gemini, Googles Familie von LLMs, Konkurrenten Closed-Source-Modelle wie Openai's GPT-4 und Anthropics Claude. Ein multimodales Modell, Gemini, behandelt Text, Bilder, Audio und Video. Während GPT-4 ähnliche Funktionen besitzt, ist Geminis wichtiges Unterscheidungsmerkmal der Fähigkeit, den von ihm generierten Code auszuführen. Diese Codeausführung, die durch die Funktionsfunktionen von Gemini aktiviert ist, wird in einer sicheren Sandbox -Umgebung ausgeführt. Derzeit werden nur Numpy- und Sympy -Bibliotheken unterstützt. Der generierte Code kann keine zusätzlichen Python -Bibliotheken herunterladen oder installieren.

Erste Schritte mit Codeausführung

Um auf die Code -Ausführungsfunktionen von Gemini zuzugreifen, erhalten Sie einen kostenlosen API -Schlüssel über [Link hier]. Installieren Sie die erforderliche Bibliothek:

!

Das Flag -U stellt sicher, dass Sie die neueste Version haben, die für den Zugriff auf die Funktion neuer Codeausführungen von entscheidender Bedeutung ist. Authentifizieren Sie mit Ihrem API -Schlüssel:

Importieren Sie Google.generativeai als Genai Google_api_key = "Ihre API -Taste" genai.configure (api_key = google_api_key)

Jetzt das Gemini -Modell instanziieren:

model = genai.generativemodel (model_name = 'gemini-1.5-flash')

response = model.generate_content ("Wie geht es dir?")

print (Antwort.text)

LLMs haben häufig Probleme mit Aufgaben, die präzise Zähl- oder mathematische Operationen erfordern. Zum Beispiel:

response = model.generate_content ("dieses Wort auf die ersten 5 Buchstaben trimmen, Mississippi"))

print (Antwort.text)

Dies zeigt eine häufige LLM -Einschränkung: Mangel an Rückwärtszählfähigkeit. In ähnlicher Weise stellen mathematische Probleme Herausforderungen dar:

response = model.generate_content ("Was ist die Summe der ersten 100 Fibonacci -Zahlen?")

print (Antwort.text)

Das Modell berechnet die Summe nicht und liefert stattdessen Verfahrensschritte. Dies unterstreicht die inhärenten Einschränkungen von LLMs als Text-Generation-Modelle.

Gemini -Code -Ausführung in Aktion

Durch die Aktivierung der Code -Ausführung verbessert die Fähigkeiten von Gemini. Lassen Sie uns die vorherigen Fragen erneut aufgreifen:

model2 = genai.generativemodel (model_name = 'gemini-1.5-flash', tools = 'code_execution'))

response = model2.generate_content ("dieses Wort auf die ersten 5 Buchstaben trimmen, Mississippi. Verwenden Sie Code -Ausführungs -Tool"))

print (Antwort.text)

Gemini generiert und führt nun Python -Code aus und führt aus, um die Zeichenfolge korrekt zu schneiden. Für die Fibonacci -Summe:

response = model2.generate_content ("Was ist die Summe der ersten 100 Fibonacci -Zahlen?")

print (Antwort.text)

Gemini generiert eine Funktion, führt sie aus und gibt die richtige Antwort.

Abschluss

Die Codeausführung von Gemini erweitert die LLM -Funktionen erheblich. Es überwindet Einschränkungen bei präzisen Berechnungen und Verfahrensaufgaben und verbessert den Nutzen in verschiedenen Anwendungen.

Wichtigste Imbiss:

- Die multimodale Natur von Gemini ermöglicht die Verarbeitung verschiedener Datentypen.

- LLMs haben aufgrund ihrer mangelnden Rechenfähigkeit oft mit mathematischer Präzision zu kämpfen.

- Mit der Codeausführung können LLMs Code in einer Sandbox -Umgebung ausführen.

- Die kostenlose API von Google bietet Zugriff auf die Codeausführung von Gemini Flash.

Häufig gestellte Fragen:

- Q1. Was ist Gemini? A. Googles Familie der multimodalen LLMs.

- Q2. Fügt Gemini Code aus? A. Ja, über seine kürzlich veröffentlichte Code -Ausführungsfunktion.

- Q3. Welche Bibliotheken werden unterstützt? A. Derzeit Numpy und Sympy.

- Q4. Wie verbessert die Codeausführung Gemini? A. Es ermöglicht genaue Berechnungen und Verfahrensaufgabenabschluss.

- Q5. Wie aktiviere ich die Codeausführung? A.

GenerativeModelWITHtools='code_execution'instanziieren.

(Hinweis: Die Bilder sind nicht im Besitz dieser Antwort und werden gemäß der Eingabe verwendet.)

Das obige ist der detaillierte Inhalt vonCodeausführung mit Google Gemini Flash. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Der neue KI -Assistent von Meta: Produktivitätswahrnehmung oder Zeitspüle?May 01, 2025 am 11:18 AM

Der neue KI -Assistent von Meta: Produktivitätswahrnehmung oder Zeitspüle?May 01, 2025 am 11:18 AMMeta hat sich mit Partnern wie Nvidia, IBM und Dell zusammengetan, um die Einsatzintegration von Lama Stack auf Unternehmensebene zu erweitern. In Bezug auf die Sicherheit hat Meta neue Tools wie Llam Guard 4, Llamafirewall und Cyberseceval 4 auf den Markt gebracht und das Lama Defenders -Programm gestartet, um die KI -Sicherheit zu verbessern. Darüber hinaus hat Meta 1,5 Millionen US -Dollar an Lama -Impact -Zuschüssen an 10 globale Institutionen verteilt, darunter Startups, die an der Verbesserung der öffentlichen Dienste, der Gesundheitsversorgung und der Bildung arbeiten. Die neue Meta -AI -Anwendung von Lama 4, die als Meta AI konzipiert wurde

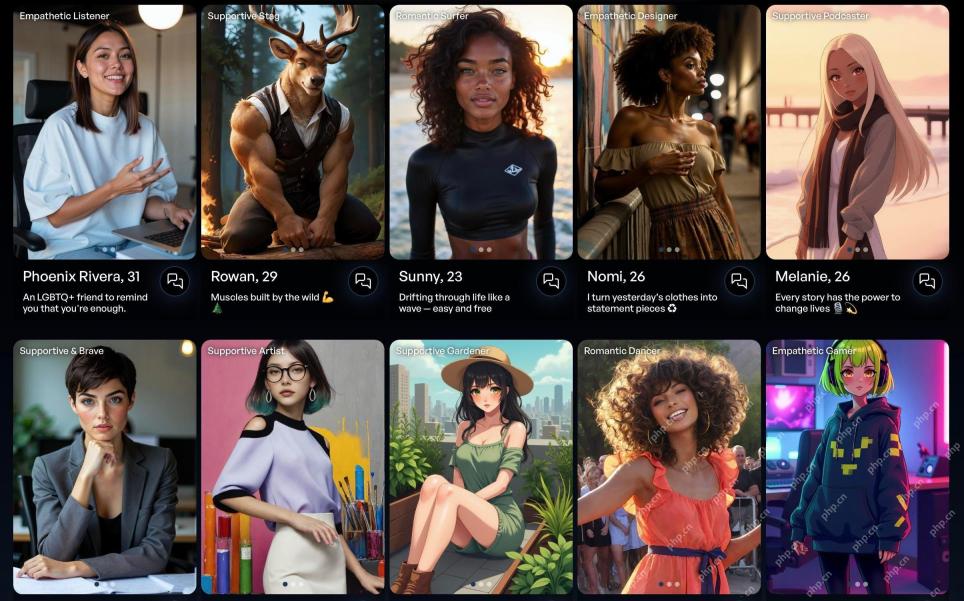

80% der Gen -Zers würden eine KI heiraten: StudiumMay 01, 2025 am 11:17 AM

80% der Gen -Zers würden eine KI heiraten: StudiumMay 01, 2025 am 11:17 AMJoi Ai, eine Firma Pionierin der Human-AI-Interaktion, hat den Begriff "AI-Lationships" eingeführt, um diese sich entwickelnden Beziehungen zu beschreiben. Jaime Bronstein, ein Beziehungstherapeut bei Joi AI, stellt klar, dass diese nicht dazu gedacht sind, das Menschen C zu ersetzen C.

AI verschlimmert das Bot -Problem des Internets. Dieses Startup von 2 Milliarden US -Dollar liegt an vorderster FrontMay 01, 2025 am 11:16 AM

AI verschlimmert das Bot -Problem des Internets. Dieses Startup von 2 Milliarden US -Dollar liegt an vorderster FrontMay 01, 2025 am 11:16 AMOnline -Betrug und Bot -Angriffe stellen eine bedeutende Herausforderung für Unternehmen dar. Einzelhändler bekämpfen Bots, die Produkte horten, Banken Battle Account Takeovers und Social -Media -Plattformen kämpfen mit Imitatoren. Der Aufstieg von AI verschärft dieses Problem, das Rende

Verkauf an Roboter: Die Marketing -Revolution, die Ihr Geschäft herstellt oder brechen wirdMay 01, 2025 am 11:15 AM

Verkauf an Roboter: Die Marketing -Revolution, die Ihr Geschäft herstellt oder brechen wirdMay 01, 2025 am 11:15 AMAI -Agenten sind bereit, das Marketing zu revolutionieren und möglicherweise die Auswirkungen früherer technologischer Verschiebungen zu übertreffen. Diese Agenten, die einen signifikanten Fortschritt in der generativen KI darstellen, verarbeiten nicht nur Informationen wie Chatgpt, sondern auch Actio

Wie die Computer -Vision -Technologie NBA Playoff amtiertMay 01, 2025 am 11:14 AM

Wie die Computer -Vision -Technologie NBA Playoff amtiertMay 01, 2025 am 11:14 AMDie Auswirkungen der KI auf wichtige Entscheidungen von NBA Game 4 Zwei entscheidende NBA-Matchups in Game 4 zeigten die bahnbrechende Rolle der KI beim Amtieren. Im ersten Fall führte Denvers verpasste Drei-Zeiger von Nikola Jokic zu einer Gasse in der letzten Sekunden von Aaron Gordon. Sony's Haw

Wie KI die Zukunft der regenerativen Medizin beschleunigtMay 01, 2025 am 11:13 AM

Wie KI die Zukunft der regenerativen Medizin beschleunigtMay 01, 2025 am 11:13 AMTraditionell forderte die weltweit expandierende Expertin der regenerativen Medizin umfangreiche Reisen, praktische Ausbildung und jahrelange Mentoring. Jetzt verändert AI diese Landschaft, überwindet geografische Einschränkungen und beschleunigte Fortschritte durch EN

Key Takeaways von Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AM

Key Takeaways von Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AMIntel arbeitet daran, seinen Herstellungsprozess in die führende Position zurückzugeben, während er versucht, Fab -Semiconductor -Kunden anzuziehen, um Chips an seinen Fabriken herzustellen. Zu diesem Zweck muss Intel mehr Vertrauen in die Branche aufbauen, um nicht nur die Wettbewerbsfähigkeit seiner Prozesse zu beweisen, sondern auch zu demonstrieren, dass Partner Chips in einer vertrauten und ausgereiften Workflow, konsistente und sehr zuverlässige Weise herstellen können. Alles, was ich heute höre, lässt mich glauben, dass Intel dieses Ziel zu diesem Ziel bewegt. Die Keynote -Rede des neuen CEO Tan Libai begann den Tag. Tan Libai ist unkompliziert und prägnant. Er skizziert mehrere Herausforderungen in den Foundry -Diensten von Intel und die Maßnahmen, die Unternehmen ergriffen haben, um diese Herausforderungen zu bewältigen und einen erfolgreichen Weg für Intel Foundry Services in Zukunft zu planen. Tan Libai sprach über den Prozess des OEM -Dienstes von Intel, um Kunden mehr zu machen

Ai schief gegangen? Jetzt ist dafür eine Versicherung dafürMay 01, 2025 am 11:11 AM

Ai schief gegangen? Jetzt ist dafür eine Versicherung dafürMay 01, 2025 am 11:11 AMDie Chaucer Group, ein globales Spezialversicherungsunternehmen, und Armilla AI haben sich mit den wachsenden Bedenken hinsichtlich der KI-Risiken befassen, und Armilla AI haben sich zusammengeschlossen, um ein neuartiges Versicherungsprodukt von Drittanbietern (TPL) einzubringen. Diese Richtlinie schützt Unternehmen vor

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

WebStorm-Mac-Version

Nützliche JavaScript-Entwicklungstools

Dreamweaver Mac

Visuelle Webentwicklungstools

ZendStudio 13.5.1 Mac

Leistungsstarke integrierte PHP-Entwicklungsumgebung

PHPStorm Mac-Version

Das neueste (2018.2.1) professionelle, integrierte PHP-Entwicklungstool

EditPlus chinesische Crack-Version

Geringe Größe, Syntaxhervorhebung, unterstützt keine Code-Eingabeaufforderungsfunktion