Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI Erforschung von Meta -Segment irgendetwas Modell für die medizinische Bildgebung

Erforschung von Meta -Segment irgendetwas Modell für die medizinische BildgebungErforschung von Meta -Segment irgendetwas Modell für die medizinische Bildgebung

Das Modell von Meta, das alles Modell (SAM) hat, hat seine Fähigkeit demonstriert, Objekte in verschiedenen Bereichen eines Bildes zu erkennen. Die Architektur dieses Modells ist flexibel und Benutzer können sie mit verschiedenen Eingabeaufforderungen anführen. Während des Trainings konnte es Objekte segmentieren, die sich nicht in seinem Datensatz befanden.

Diese Funktionen machen dieses Modell zu einem hochwirksamen Werkzeug zum Erkennen und Segmentieren von Objekten für jeden Zweck. Dieses Tool kann auch für bestimmte Segmentierungsaufgaben verwendet werden, wie wir bei branchenbasierten Anwendungen wie selbstfahrenden Fahrzeugen und Robotik gesehen haben. Ein weiteres entscheidendes Detail dieses Modells ist, wie es Bilder mit Masken und Begrenzungsboxen segmentieren kann, was für die Funktionsweise von medizinischen Zwecken von entscheidender Bedeutung ist.

Das Segment von Meta für medizinische Bildgebung spielt jedoch eine große Rolle bei der Diagnose und Erkennung von Anomalien in gescannten Bildern. Medsam trainiert ein Modell auf Bildmaskenpaaren, die aus verschiedenen Quellen gesammelt wurden. Dieser Datensatz deckt auch über 15 Bildmodalitäten und über 30 Krebstypen ab.

Wir werden diskutieren, wie dieses Modell Objekte aus medizinischen Bildern mithilfe von Begrenzungsboxen erkennen kann.

Lernziele

- Das META -Segment Any Model (SAM) zeichnet sich in den Segmentieren von Objekten in verschiedenen Regionen eines Bildes aus und macht es sehr anpassbar an verschiedene Aufgaben.

- Sams Fähigkeit, Objekte über den Trainingsdatensatz hinaus zu erkennen, zeigt seine Flexibilität, insbesondere in Kombination mit Begrenzungsboxen und Masken.

- Medsam, eine fein abgestimmte Version von SAM, verbessert die medizinische Bildgebung, indem sie komplexe diagnostische Aufgaben erledigen, wie z. B. Krebs in 15 Bildgebungsmodalitäten.

- Durch die Verwendung von Begrenzungsboxen und effizienten Computertechniken optimiert Medsam die Segmentierung des medizinischen Bildes und überschreitet die Grenzen von AI -Anwendungen im Gesundheitswesen.

- Sams Kern Vielseitigkeit, gepaart mit Medsams medizinischer Spezialisierung, eröffnet ein ein großes Potenzial für die Revolutionierung der Bildanalyse in Bereichen wie Robotik, autonomen Fahrzeugen und Gesundheitsversorgung.

Dieser Artikel wurde als Teil des Data Science -Blogathons veröffentlicht.

Inhaltsverzeichnis

- Wie funktioniert Segment irgendetwas Modell (SAM)?

- Kann Sam direkt auf die medizinische Bildgebung angewendet werden?

- Modellarchitektur von Medsam

- So verwenden Sie Medsam für die medizinische Bildgebung

- Anwendung dieses Modells: Was hält die Zukunft?

- Abschluss

- Häufig gestellte Fragen

Wie funktioniert Segment irgendetwas Modell (SAM)?

SAM ist ein von Meta entwickeltes Bildsegmentierungsmodell, um Objekte in nahezu jedem Bereich eines Bildes zu identifizieren. Das beste Attribut dieses Modells ist seine Vielseitigkeit, die es ihm ermöglicht, beim Erkennen von Bildern zu verallgemeinern.

Dieses Modell wurde auf faszinierenden 11 Millionen realen Bildern ausgebildet, aber faszinierter kann es Objekte segmentieren, die nicht einmal in seinem Datensatz vorhanden sind.

Es gibt viele Bildsegmentierungs- und Objekterkennungsmodelle mit unterschiedlichen Strukturen. Modelle wie diese könnten aufgabenspezifische oder Basismodelle sein, aber Sam, das ein "Segment-It-All" -Modell ist, kann beide einen guten grundlegenden Hintergrund haben, um Millionen von Bildern zu erkennen und gleichzeitig Raum für Feinabstimmung zu lassen. Hier kommen Forscher mit verschiedenen Ideen, genau wie bei Medsam.

Ein Höhepunkt der Fähigkeiten von Sam ist die Fähigkeit, sich anzupassen. Es handelt sich auch um ein prompt-basiertes Segmentierungsmodell, was bedeutet, dass Informationen zur Ausführung von Segmentierungsaufgaben empfangen werden können. Dazu gehören Vordergrund, Hintergrund, eine grobe Box, Begrenzungsboxen, Masken, Texte und andere Informationen, die dem Modell helfen könnten, das Bild zu segmentieren.

Das Grundprinzip der Architektur dieses Modells ist der Bildcodierer, ein promptierter Encoder und den Mask -Encoder. Alle drei Komponenten spielen eine große Rolle bei der Ausführung der Segmentierungsaufgaben. Das Bild- und Eingabeaufforderung Encoder erzeugt das Bild und die Eingabeaufbettung. Der Maskencodierer erkennt die für das Bild erzeugte Maske, die Sie mit der Eingabeaufforderung segmentieren möchten.

Kann Sam direkt auf die medizinische Bildgebung angewendet werden?

Die Verwendung des Segments alles Modell für medizinische Zwecke war es wert, es zu versuchen. Auch das Modell verfügt über einen großen Datensatz und unterschiedliche Funktionen. Warum also nicht die medizinische Bildgebung? Die Anwendung in der medizinischen Segmentierung war jedoch mit einigen Einschränkungen aufgrund der Art von medizinischen Bildern und Problemen mit der Art und Weise, wie das Modell mit unsicheren Begrenzungsboxen im Bild umgehen kann, entstanden. Mit Herausforderungen aus der Natur von Bildmasken in medizinischen Bildern wird die Notwendigkeit einer Spezialisierung von wesentlicher Bedeutung. Das führte also zur Innovation von Medsam, einem Segmentierungsmodell, das auf Sams Architektur basiert, aber auf medizinische Bilder zugeschnitten war.

Dieses Modell kann verschiedene Aufgaben in anatomischen Strukturen und unterschiedlichen Bildinstanzen erledigen. Die medizinische Bildgebung erzielt mit diesem Modell wirksame Ergebnisse. 15 Bildgebungsmodalitäten und über 30 Krebstypen zeigen die große Auswahl an medizinischem Bild -Segmentierungstraining, die an Medsam beteiligt ist.

Modellarchitektur von Medsam

Das Medsam wurde auf dem vorgebildeten SAM-Modell gebaut. Das Framework umfasst die Bild- und Eingabeaufforderung, die Einbettungen für die Codierungsmaske für Zielbilder generieren.

Der Bildcodierer im Segment Any Model verarbeitet Positionsinformationen, für die viel Rechenleistung erforderlich ist. Um den Prozess effizienter zu gestalten, beschlossen die Forscher dieses Modells, sowohl den Image -Encoder als auch den forderten Encoder zu „einfrieren“. Das bedeutet, dass sie während des Trainings nicht mehr aktualisieren oder diese Teile ändern.

Der Eingabeaufforderungscodierer, der hilft, die Positionen von Objekten zu verstehen, die Daten aus dem Begrenzungsbox-Encoder in SAM verwenden, blieb ebenfalls unverändert. Durch das Einfrieren dieser Komponenten reduzierten sie die benötigte Rechenleistung und machten das System effizienter.

Die Forscher verbesserten die Architektur dieses Modells, um es effizienter zu gestalten. Bevor sie das Modell aufforderten, berechneten sie die Bildeinbettungen der Trainingsbilder, um wiederholte Berechnungen zu vermeiden. Der Maskencodierer-der einzige feinstimmige-erstellt nun einen Masken-Encoder anstelle von drei, da der Begrenzungsbox den Bereich für das Segment deutlich definiert. Dieser Ansatz machte das Training effizienter.

Hier ist eine grafische Darstellung der Funktionsweise dieses Modells:

So verwenden Sie Medsam für die medizinische Bildgebung

Dieses Modell würde einige Bibliotheken benötigen, um zu funktionieren, und wir werden darauf eingehen, wie Sie medizinische Bildgebungsaufgaben auf einem Bild ausführen können.

Installation der erforderlichen Bibliotheken

Wir brauchen noch ein paar Bibliotheken, um dieses Modell auszuführen, da wir auch als Teil der Eingabeaufforderung Zeilen auf den Begrenzungsboxen zeichnen müssen. Wir beginnen mit Anfragen, Numpy und Metaplot.

Anfragen importieren Numph als NP importieren matplotlib.pyplot als pLT importieren vom PIL -Importbild aus Transformatoren importieren sammodel, samprocessor Taschenlampe importieren

Die "Anfrage" -Bibliothek hilft beim Abrufen von Bildern aus ihrer Quelle. Die "Numpy" -Bibliothek wird nützlich, da wir numerische Operationen mit den Koordinaten der Begrenzungsboxen ausführen. Pil und Metaplot unterstützen die Bildverarbeitung bzw. der Anzeige. Zusätzlich zum SAM -Modell sind der Prozessor und die Taschenlampe (die im folgenden Code definierten Berechnung des Codes) wichtige Pakete für das Ausführen dieses Modells.

Device = "CUDA" if fackel.cuda.is_available () else "cpu"

Laden des vorgebildeten SAM

model = sammodel.from_Pretrained ("Flaviagiammarino/Medsam-Vit-Base"). An (Gerät)

processor = samprocessor.from_pretraed ("flaviagiammarino/medsam-vit-base")

Daher verwendet das vorgebildete Modell normalerweise das am besten geeignete Computergerät, z. B. eine GPU oder eine CPU. Dieser Vorgang erfolgt vor dem Laden des Prozessors des Modells und Vorbereitung für Bildeingabedaten.

Bildeingabe

img_url = "https://huggingface.co/flaviagiammarino/medsam-vit-base/resolve/main/scripts/input.png"

raw_image = image.open (requests.get (img_url, stream = true) .raw) .convert ("rgb"))

input_boxes = [95., 255., 190., 350.]

Das Laden des Bildes mit einer URL ist einfach, insbesondere mit unserer Bibliothek in der Umgebung. Wir können das Bild auch öffnen und es zur Verarbeitung in ein kompatibles Format umwandeln. Die Liste 'Input_boxes' definiert das Begrenzungsfeld mit Koordinaten [95, 255, 190, 350]. Diese Zahl repräsentiert die oberen linken und unteren Rechten des Bildes der interessierenden Region. Mit dem Begrenzungsfeld können wir die Segmentierungsaufgabe mit Schwerpunkt auf einer bestimmten Region ausführen.

Verarbeitungsbildeingabe

Als nächstes verarbeiten wir die Bildeingabe, führen das Segmentierungsmodell aus und erstellen Sie die Ausgangsmaske. Der Modellprozessor bereitet das Rohbild- und Eingangsboxen vor und wandelt sie zur Verarbeitung in ein geeignetes Format um. Danach wird der verarbeitete Eingang ausgeführt, um Maskenwahrscheinlichkeiten vorherzusagen. Dieser Code führt zu einer raffinierten, wahrscheinlichbasierten Maske für die segmentierte Region.

inputs = processor (raw_image, input_boxes = [[input_boxes]], return_tensors = "pt"). TO (Gerät) Ausgänge = Modell (** Eingänge, multimask_output = false) probs = processor.image_processor.post_process_masks (outs.Pred_masks.siigmaid (). cpu (), inputs ["original_sizes"]. cpu (), inputs ["reshaped_input_sizes"].

Maske

Def show_mask (Maske, AX, Random_Color):

Wenn random_color:

color = np.concatenate ([np.random.random (3), np.Array ([0,6])], Achse = 0)

anders:

color = np.Array ([251/255, 252/255, 30/255, 0,6])

H, w = mask.shape [-2:]

mask_image = mask.reshape (h, w, 1) * color.reshape (1, 1, -1)

ax.imshow (mask_image)

Hier versuchen wir, die farbige Maske auf dem Bild mit 'Axt zu zeigen. zeigen.' Die Funktion show_mask zeigt eine Segmentierungsmaske auf einem Diagramm. Es kann eine zufällige Farbe oder das Standardgelb verwenden. Die Maske wird geändert, um das Bild anzupassen, mit der ausgewählten Farbe überlagert und unter Verwendung von 'ax.show' visualisiert wird.

Danach zeichnet die Funktion ein Rechteck unter Verwendung der Koordinaten und ihrer Position. Dieser Prozess wird wie unten gezeigt ausgeführt.

Def show_box (Box, AX): x0, y0 = Box [0], Box [1] W, H = Box [2] - Box [0], Box [3] - Box [1] ax.add_patch (plt.Rectangle ((x0, y0), w, h, edgecolor = "blau", facecolor = (0, 0, 0, 0), lw = 2))

Ausgabe

Abb, ax = plt.subplots (1, 2, figsize = (10, 5))

AX [0] .imshow (NP.Array (RAW_IMAGE))

show_box (input_boxes, ax [0])

ax [0] .set_title ("Eingabebild und Begrenzungsfeld")

AX [0] .AXIS ("OFF")

AX [1] .imshow (NP.Array (RAW_IMAGE))

show_mask (mask = probs [0]> 0,5, ax = ax [1], random_color = false)

show_box (input_boxes, ax [1])

AX [1] .set_title ("Medsam -Segmentierung")

AX [1] .AXIS ("OFF")

Plt.Show ()

Dieser Code erstellt eine Figur mit zwei Nebenhandlagen, um das Eingabebild mit einem Begrenzungsfeld und dem Ergebnis anzuzeigen. Die erste Nebenhandlung zeigt das Originalbild mit dem Begrenzungsfeld und das zweite zeigt das Bild mit der überlagten Maske und dem Begrenzungsfeld.

Anwendung dieses Modells: Was hält die Zukunft?

Sam als grundlegendes Modell ist ein Mehrzweck -Tool; Mit seinen hohen Generalisierungsfunktionen und den Millionen von Datensatztraining aus realen Bildern kann dieses Modell viel tun. Hier sind einige häufige Anwendungen dieses Modells:

- Eine der beliebtesten Verwendungen dieses Tools ist die Bild- und Videobearbeitung, die die Objekterkennung und -manipulation von Bildern und Videos vereinfacht.

- Autonome Fahrzeuge können dieses Modell verwenden, um Objekte effizient zu erkennen und gleichzeitig den Kontext jeder Szene zu verstehen.

- Robotik benötigt auch eine Objekterkennung, um mit ihrer Umgebung zu interagieren.

Medsam ist ein riesiger Meilenstein im Segment, was das Modell des Modells verwendete. Die medizinische Bildgebung ist komplexer als normale Bilder; Dieses Modell hilft uns, diesen Kontext zu verstehen. Die Verwendung verschiedener diagnostischer Ansätze zur Erkennung von Krebstypen und anderen Zellen in der medizinischen Bildgebung kann dieses Modell für die aufgabenspezifische Erkennung effizienter machen.

Abschluss

Das Segment von Meta, das die Vielseitigkeit des Modells hat, hat ein großes Potenzial gezeigt. Die medizinische Bildgebungsfähigkeit ist ein erheblicher Meilenstein bei der Revolutionierung von Diagnosen und damit verbundenen Aufgaben in der Gesundheitsbranche. Das Integrieren von Begrenzungsboxen macht es noch effektiver. Die medizinische Bildgebung kann sich nur verbessern, wenn sich das SAM -Basismodell entwickelt.

Ressourcen

- Umarmtes Gesicht

- AV SAM EINLEITUNG

- Mittelmedam

Schlüssel zum Mitnehmen

- Die vielseitige Natur des SAM-Basismodells ist die Grundlage dafür, wie die Forscher das medizinische Bildgebungsmodell abgestimmt haben. Ein weiteres bemerkenswertes Attribut ist die Fähigkeit, sich an verschiedene Aufgaben anzupassen, indem sie Eingabeaufforderungen, Begrenzungsboxen und Masken anpassen.

- Medsam wurde in verschiedenen medizinischen Bildgebungsdatensätzen geschult. Es deckt über 15 Bildmodalitäten und mehr als 30 Krebstypen ab, was zeigt, wie effizient es ungewöhnliche Regionen in medizinischen Scans erkennen kann.

- Die Architektur des Modells verfolgte ebenfalls den richtigen Ansatz. Bestimmte Teile wurden eingefroren, um die Berechnungskosten zu senken, und Begrenzungsboxen wurden als Aufforderung zur Segmentierung eines bestimmten Bildungsbereichs verwendet.

Häufig gestellte Fragen

Q1. Was ist das Segment von Meta etwas Modell (SAM)?A. SAM ist eine Bildverarbeitungstechnik, die von Meta entwickelt wurde, um Objekte zu erkennen und sie in einem beliebigen Bereich in einem Bild zu segmentieren. Es kann auch Objekte segmentieren, die im Datensatz des Modells nicht trainiert sind. Dieses Modell ist für den Betrieb mit Eingabeaufforderungen und Masken geschult und ist in verschiedenen Bereichen anpassbar.

Q2. Wie unterscheidet sich Medsam vom ursprünglichen SAM -Modell?A. Medsam ist eine fein abgestimmte Version von SAM, die speziell für die medizinische Bildgebung entwickelt wurde. Während SAM im Allgemeinen ist, ist Medsam optimiert, um die komplexe Natur der medizinischen Bildgebung zu bewältigen, was zu verschiedenen Bildgebungsmodalitäten und Krebserkennung führt.

Q3. Kann SAM für Echtzeitanwendungen verwendet werden?A. Die Vielseitigkeits- und Echtzeitverarbeitungsfunktionen dieses Modells ermöglichen es, in Echtzeitanwendungen, einschließlich selbstfahrender Fahrzeuge und Robotik, verwendet zu werden. Es kann Objekte in Bildern schnell und effizient erkennen und verstehen.

Die in diesem Artikel gezeigten Medien sind nicht im Besitz von Analytics Vidhya und werden nach Ermessen des Autors verwendet.

Das obige ist der detaillierte Inhalt vonErforschung von Meta -Segment irgendetwas Modell für die medizinische Bildgebung. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

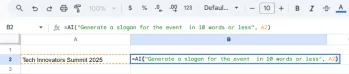

Wie benutze ich Gemini in Google Sheets?Apr 26, 2025 am 09:34 AM

Wie benutze ich Gemini in Google Sheets?Apr 26, 2025 am 09:34 AMGoogle Sheets erhält ein erhebliches Upgrade mit der Einführung der Funktion von Gemini = AI, wobei die bisher manuellen Datenaufgaben automatisiert werden. Diese KI-betriebene Formel vereinfacht die Kategorisierung, Zusammenfassung und Formelentwicklung durch Simply

Python One Liners Datenreinigung: Schnellhandbuch - Analytics VidhyaApr 26, 2025 am 09:33 AM

Python One Liners Datenreinigung: Schnellhandbuch - Analytics VidhyaApr 26, 2025 am 09:33 AMDie Datenreinigung wurde bei Python-Einzeilern einfach gemacht Stürzen Sie Ihren Datenreinigungsprozess mit leistungsstarken Python-Einzeilern! Dieser Leitfaden zeigt wesentliche Pandas -Techniken zum Umgang mit fehlenden Werten, Duplikaten, Formatierungsproblemen und vielem mehr innerhalb eines

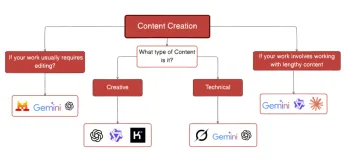

Eine Anleitung zur Auswahl des besten KI -Chatbots für Ihre AufgabeApr 26, 2025 am 09:31 AM

Eine Anleitung zur Auswahl des besten KI -Chatbots für Ihre AufgabeApr 26, 2025 am 09:31 AMWie halten Sie die besten und neuesten LLMs im Auge? Wenn Sie die Nachrichten verfolgt haben, bin ich sicher, dass Sie von den Models da draußen überwältigt wurden, insbesondere in den letzten Monaten. Heute haben wir mehr KI -Chatbots als Fi

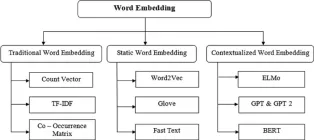

14 leistungsstarke Techniken, die die Entwicklung der Einbettung definieren - Analytics VidhyaApr 26, 2025 am 09:29 AM

14 leistungsstarke Techniken, die die Entwicklung der Einbettung definieren - Analytics VidhyaApr 26, 2025 am 09:29 AMIn diesem Artikel wird die Entwicklung von Texteinbettungen untersucht, von einfachen zählbasierten Methoden bis hin zu komplexen kontextbezogenen Modellen. Es unterstreicht die Rolle von Besten

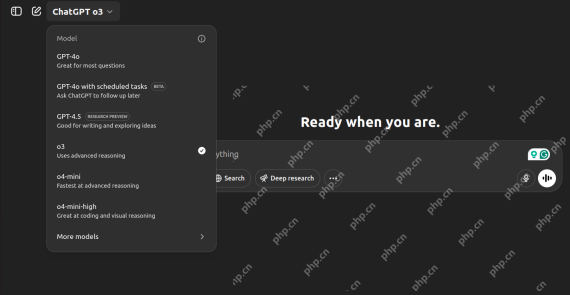

O3 gegen O4 -Mini gegen Gemini 2.5 Pro: Der ultimative Argumentationskampf - Analytics VidhyaApr 26, 2025 am 09:28 AM

O3 gegen O4 -Mini gegen Gemini 2.5 Pro: Der ultimative Argumentationskampf - Analytics VidhyaApr 26, 2025 am 09:28 AMDieser Blog passt drei führende KI-Modelle-O3, O4-Mini und Gemini 2.5 Pro-in einer strengen Argumentationsherausforderung. Wir testen ihre Funktionen in Physik, Mathematik, Codierung, Webdesign und Bildanalyse und enthüllen ihre Stärken und enthüllen eine

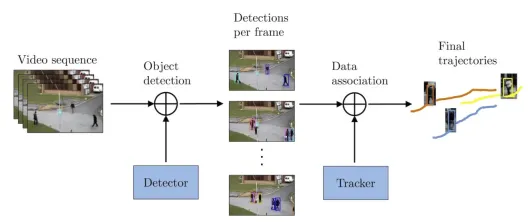

Verfolgung mit effizientem erneuten ID in Yolo - Analytics VidhyaApr 26, 2025 am 09:26 AM

Verfolgung mit effizientem erneuten ID in Yolo - Analytics VidhyaApr 26, 2025 am 09:26 AMEchtzeit-Objekterkennungswerkzeuge wie Yolo, SSD und DETR sind entscheidend für die Überwachung von Objektbewegungen und -aktionen. Branchen wie das Verkehrsmanagement und die Sicherheit nutzen diese Tools für die Verfolgung und Analyse. Eine große Herausforderung ist jedoch gewartet

Generative KI -Datenwissenschaftler: Eine boomende neue JobrolleApr 26, 2025 am 09:22 AM

Generative KI -Datenwissenschaftler: Eine boomende neue JobrolleApr 26, 2025 am 09:22 AMGenerative AI (Genai) Datenwissenschaftler: Ein boomender Karriereweg Zusammenfassung: Das aufkeimende Bereich der generativen KI erfordert Fachkräfte, die in der großen Datensatznavigation, der LLM-beschleunigten Modellentwicklung und der realen KI-Bereitstellung geschickt werden. Thi

Wie benutze ich MCP mit Cursor AI?Apr 26, 2025 am 09:21 AM

Wie benutze ich MCP mit Cursor AI?Apr 26, 2025 am 09:21 AMAI verändert die Erstellung von Software. Tools wie MCP (Modellkontextprotokoll) und Cursor AI führen diese Verschiebung an. Mit Cursor AI können Sie Code mit natürlicher Sprache schreiben, während MCP intelligente Verarbeitung und Automatisierung übertreffen. Tog

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

DVWA

Damn Vulnerable Web App (DVWA) ist eine PHP/MySQL-Webanwendung, die sehr anfällig ist. Seine Hauptziele bestehen darin, Sicherheitsexperten dabei zu helfen, ihre Fähigkeiten und Tools in einem rechtlichen Umfeld zu testen, Webentwicklern dabei zu helfen, den Prozess der Sicherung von Webanwendungen besser zu verstehen, und Lehrern/Schülern dabei zu helfen, in einer Unterrichtsumgebung Webanwendungen zu lehren/lernen Sicherheit. Das Ziel von DVWA besteht darin, einige der häufigsten Web-Schwachstellen über eine einfache und unkomplizierte Benutzeroberfläche mit unterschiedlichen Schwierigkeitsgraden zu üben. Bitte beachten Sie, dass diese Software

WebStorm-Mac-Version

Nützliche JavaScript-Entwicklungstools

Herunterladen der Mac-Version des Atom-Editors

Der beliebteste Open-Source-Editor

EditPlus chinesische Crack-Version

Geringe Größe, Syntaxhervorhebung, unterstützt keine Code-Eingabeaufforderungsfunktion

MinGW – Minimalistisches GNU für Windows

Dieses Projekt wird derzeit auf osdn.net/projects/mingw migriert. Sie können uns dort weiterhin folgen. MinGW: Eine native Windows-Portierung der GNU Compiler Collection (GCC), frei verteilbare Importbibliotheken und Header-Dateien zum Erstellen nativer Windows-Anwendungen, einschließlich Erweiterungen der MSVC-Laufzeit zur Unterstützung der C99-Funktionalität. Die gesamte MinGW-Software kann auf 64-Bit-Windows-Plattformen ausgeführt werden.