Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI Koka: Kontrastive Bildunterschriften sind Bild-Text-Fundamentmodelle visuell erklärt

Koka: Kontrastive Bildunterschriften sind Bild-Text-Fundamentmodelle visuell erklärtKoka: Kontrastive Bildunterschriften sind Bild-Text-Fundamentmodelle visuell erklärt

Dieses Tutorial für die DataCamp-Community, die für Klarheit und Genauigkeit bearbeitet wurde, untersucht die Modelle der Bild-Text-Grundlage und konzentriert sich auf das innovative Contrastive Captioner (CoCA) -Modell. Coca kombiniert kontrastive und generative Lernziele einzigartig und integrieren die Stärken von Modellen wie Clip und Simvlm in eine einzelne Architektur.

Fundamentmodelle: Ein tiefes Tauchgang

Fundamentmodelle, die auf massiven Datensätzen vorgebracht sind, sind für verschiedene nachgeschaltete Aufgaben anpassbar. Während NLP einen Anstieg der Fundamentmodelle (GPT, Bert) verzeichnet hat, entwickeln sich auch immer noch die Modelle für Visionen und Visionsprachen. Untersuchungen haben drei primäre Ansätze untersucht: Einzel-Encoder-Modelle, Image-Text-Dual-Coder mit kontrastivem Verlust und Encoder-Decoder-Modellen mit generativen Zielen. Jeder Ansatz hat Einschränkungen.

Schlüsselbegriffe:

- Fundamentmodelle: Vorausgebildete Modelle anpassbar für verschiedene Anwendungen.

- Kontrastiven Verlust: Eine Verlustfunktion, die ähnliche und unterschiedliche Eingangspaare vergleicht.

- Quermodal-Wechselwirkung: Wechselwirkung zwischen verschiedenen Datentypen (z. B. Bild und Text).

- Encoder-Decoder-Architektur: Ein neuronales Netzwerkverarbeitungsing und generierende Ausgabe.

- Null-Shot-Lernen: Vorhersage von unsichtbaren Datenklassen.

- Clip: Ein kontrastives Sprachbild-Vor-Training-Modell.

- SIMVLM: Ein einfaches visuelles Sprachmodell.

Modellvergleiche:

- Einzel-Encoder-Modelle: Excel bei Visionsaufgaben, aber kämpfen

- Bild-Text-Doppel-Coder-Modelle (Clip, Align): Hervorragend für Klassifizierung und Abruf von Null-Shots, aber in Aufgaben begrenzt, die fusionierte Bildtextdarstellungen erforderlich sind (z. B. visuelle Beantwortung). . .

- Generative Modelle (SIMVLM): Verwenden Sie die Quermodale Interaktion für die gemeinsame Bildtextdarstellung, geeignet für VQA und Bildunterschriften.

Coca: Überbrückung der Lücke

coca zielt darauf ab, die Stärken kontrastiver und generativer Ansätze zu vereinen. Es verwendet einen kontrastiven Verlust, um Bild- und Textdarstellungen und ein generatives Ziel (Bildunterschriftenverlust) auszurichten, um eine gemeinsame Darstellung zu erzeugen.

Coca -Architektur:

Coca verwendet eine Standard-Encoder-Decoder-Struktur. Seine Innovation liegt in einem entkoppelten Decoder :

- Unter Decodierer: erzeugt eine unimodale Textdarstellung für kontrastives Lernen (unter Verwendung eines [CLS] -Tokens).

- Oberer Decoder: generiert eine multimodale Bild-Text-Darstellung für generatives Lernen. Beide Decoder verwenden kausale Maskierung.

Kontrastes Ziel: lernt, im Zusammenhang mit Bildtextpaaren zu clusterbezogenen und nicht verwandten, in einem gemeinsam genutzten Vektorraum getrennt. Eine einzelne gepoolte Bildeinbettung wird verwendet.

generatives Ziel: verwendet eine feinkörnige Bilddarstellung (256-dimensionale Sequenz) und die modale Aufmerksamkeit, um Text autoregressiv vorherzusagen.

Schlussfolgerung:

coca stellt einen signifikanten Fortschritt in den Modellen der Bild-Text-Grundlage dar. Der kombinierte Ansatz verbessert die Leistung in verschiedenen Aufgaben und bietet ein vielseitiges Tool für nachgeschaltete Anwendungen. Um Ihr Verständnis für fortgeschrittene Deep -Learning -Konzepte zu fördern, betrachten Sie DataCamps fortgeschrittenes Deep Learning mit Keras -Kurs.

Weitere Lesen:

- übertragbare visuelle Modelle von natürlicher Sprache aus natürlicher Sprache lernen

- Bild-Text vor dem Training mit kontrastiven Bildunterschriften

Das obige ist der detaillierte Inhalt vonKoka: Kontrastive Bildunterschriften sind Bild-Text-Fundamentmodelle visuell erklärt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Persönliches Hacking wird ein ziemlich heftiger Bär seinMay 11, 2025 am 11:09 AM

Persönliches Hacking wird ein ziemlich heftiger Bär seinMay 11, 2025 am 11:09 AMCyberangriffe entwickeln sich weiter. Vorbei sind die Tage generischer Phishing -E -Mails. Die Zukunft der Cyberkriminalität ist hyperpersonalisiert und nutzt leicht verfügbare Online-Daten und KI, um hoch gezielte Angriffe zu erzeugen. Stellen Sie sich einen Betrüger vor, der Ihren Job kennt, Ihr F.

Papst Leo XIV zeigt, wie KI seine Namenswahl beeinflusst hatMay 11, 2025 am 11:07 AM

Papst Leo XIV zeigt, wie KI seine Namenswahl beeinflusst hatMay 11, 2025 am 11:07 AMIn seiner Eröffnungsrede an das College of Cardinals diskutierte der in Chicago geborene Robert Francis Prevost, der neu gewählte Papst Leo XIV, den Einfluss seines Namensvetters, Papst Leo XIII., Dessen Papsttum (1878-1903) mit der Dämmerung des Automobils und der Dämmerung des Automobils und des Automobils zusammenfiel

FASTAPI -MCP -Tutorial für Anfänger und Experten - Analytics VidhyaMay 11, 2025 am 10:56 AM

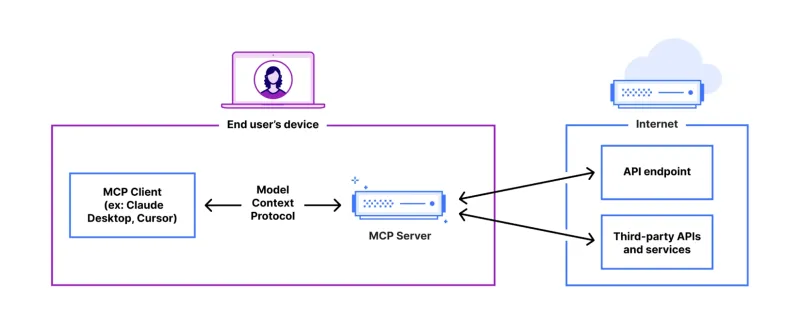

FASTAPI -MCP -Tutorial für Anfänger und Experten - Analytics VidhyaMay 11, 2025 am 10:56 AMDieses Tutorial zeigt, wie Sie Ihr großes Sprachmodell (LLM) mit dem Modellkontextprotokoll (MCP) und Fastapi in externe Tools integrieren. Wir erstellen eine einfache Webanwendung mit Fastapi und konvertieren sie in einen MCP -Server, um Ihr L zu aktivieren

DIA-1.6B TTS: Bestes Modell zur Generierung von Text zu Dialogue-Analytics VidhyaMay 11, 2025 am 10:27 AM

DIA-1.6B TTS: Bestes Modell zur Generierung von Text zu Dialogue-Analytics VidhyaMay 11, 2025 am 10:27 AMEntdecken Sie DIA-1.6B: Ein bahnbrechendes Text-zu-Sprach-Modell, das von zwei Studenten ohne Finanzierung entwickelt wurde! Dieses 1,6 -Milliarden -Parametermodell erzeugt eine bemerkenswert realistische Sprache, einschließlich nonverbaler Hinweise wie Lachen und Niesen. Dieser Artikelhandbuch

3 Wege KI kann Mentoring sinnvoller als je zuvor machenMay 10, 2025 am 11:17 AM

3 Wege KI kann Mentoring sinnvoller als je zuvor machenMay 10, 2025 am 11:17 AMIch stimme voll und ganz zu. Mein Erfolg ist untrennbar mit der Anleitung meiner Mentoren verbunden. Ihre Einsichten, insbesondere in Bezug auf das Geschäftsmanagement, bildeten das Fundament meiner Überzeugungen und Praktiken. Diese Erfahrung unterstreicht mein Engagement für Mentor

AI entblößt neues Potenzial in der BergbauindustrieMay 10, 2025 am 11:16 AM

AI entblößt neues Potenzial in der BergbauindustrieMay 10, 2025 am 11:16 AMKI verbesserte Bergbaugeräte Die Bergbaubetriebumgebung ist hart und gefährlich. Künstliche Intelligenzsysteme verbessern die Gesamteffizienz und -sicherheit, indem Menschen aus den gefährlichsten Umgebungen entfernt und die Fähigkeiten des Menschen verbessert werden. Künstliche Intelligenz wird zunehmend verwendet, um autonome LKWs, Übungen und Lader, die in Bergbauvorgängen verwendet werden, zu betreiben. Diese KI-betriebenen Fahrzeuge können in gefährlichen Umgebungen genau arbeiten und so die Sicherheit und Produktivität erhöhen. Einige Unternehmen haben autonome Bergbaufahrzeuge für groß angelegte Bergbaubetriebe entwickelt. Geräte, die in anspruchsvollen Umgebungen betrieben werden, erfordert eine kontinuierliche Wartung. Wartung kann jedoch kritische Geräte offline halten und Ressourcen konsumieren. Genauere Wartung bedeutet eine höhere Fahrt für teure und notwendige Geräte und erhebliche Kosteneinsparungen. AI-gesteuert

Warum KI -Agenten die größte Revolution am Arbeitsplatz seit 25 Jahren auslösen werdenMay 10, 2025 am 11:15 AM

Warum KI -Agenten die größte Revolution am Arbeitsplatz seit 25 Jahren auslösen werdenMay 10, 2025 am 11:15 AMMarc Benioff, CEO von Salesforce, prognostiziert eine monumentale Revolution am Arbeitsplatz, die von AI -Agenten angetrieben wird, eine Transformation, die bereits innerhalb von Salesforce und seiner Kundenstamme im Gange ist. Er stellt sich eine Verlagerung von traditionellen Märkten zu einem weitaus größeren Markt vor, auf den sich konzentriert wird

AI HR wird unsere Welten rocken, wenn die KI -Adoption steigtMay 10, 2025 am 11:14 AM

AI HR wird unsere Welten rocken, wenn die KI -Adoption steigtMay 10, 2025 am 11:14 AMDer Aufstieg der KI in der Personalabteilung: Navigation einer Belegschaft mit Roboterkollegen Die Integration von KI in die Personalabteilung (HR) ist kein futuristisches Konzept mehr. Es wird schnell zur neuen Realität. Diese Verschiebung wirkt sich sowohl auf HR -Fachkräfte als auch Mitarbeiter aus, DEM aus.

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

SublimeText3 Linux neue Version

SublimeText3 Linux neueste Version

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

WebStorm-Mac-Version

Nützliche JavaScript-Entwicklungstools

MinGW – Minimalistisches GNU für Windows

Dieses Projekt wird derzeit auf osdn.net/projects/mingw migriert. Sie können uns dort weiterhin folgen. MinGW: Eine native Windows-Portierung der GNU Compiler Collection (GCC), frei verteilbare Importbibliotheken und Header-Dateien zum Erstellen nativer Windows-Anwendungen, einschließlich Erweiterungen der MSVC-Laufzeit zur Unterstützung der C99-Funktionalität. Die gesamte MinGW-Software kann auf 64-Bit-Windows-Plattformen ausgeführt werden.

Dreamweaver CS6

Visuelle Webentwicklungstools